Clear Sky Science · nl

Een tijdgesynchroniseerde multi-sensor drone-dataset verkregen met meerdere radars en een RF-ontvanger

Waarom het volgen van de hemel ertoe doet

Drones zijn snel geëvolueerd van speelgoed en filmhulpmiddelen naar onmisbare apparaten voor bezorging, inspectie, landbouw en meer. Maar dezelfde kleine toestellen die ons helpen, kunnen ook worden misbruikt voor spionage, smokkel of zelfs aanvallen. Het tegenhouden van gevaarlijke drones is lastig omdat ze klein, snel en vaak actief zijn in rommelige, reële omgevingen. Dit artikel introduceert een nieuwe open dataset die wetenschappers en ingenieurs helpt bij het bouwen van slimmere systemen om drones te detecteren, te volgen en te identificeren aan de hand van hun onzichtbare radiosignaturen in plaats van alleen op uiterlijk of geluid.

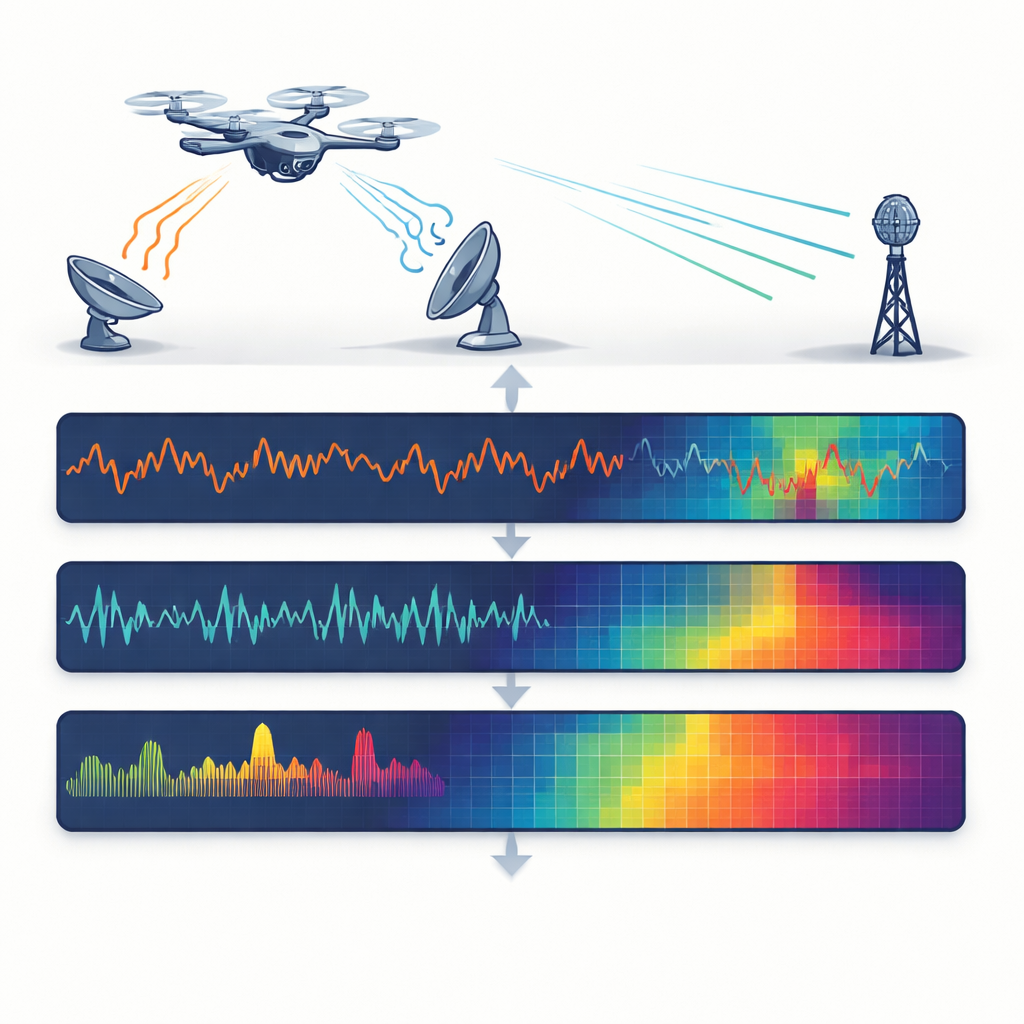

Drones horen met onzichtbare golven

In plaats van te vertrouwen op camera’s of microfoons richten de onderzoekers zich op radiogolven, die dag en nacht werken en ook bij mist, regen of schittering bruikbaar zijn. Ze gebruiken tegelijkertijd drie verschillende op radio gebaseerde sensoren: één radar die een constante toon uitzendt om beweging waar te nemen, een andere radar die zijn frequentie afstroopt om zowel afstand als snelheid te meten, en een radio-ontvanger die simpelweg luistert naar de bediening- en videosignalen van de drone. Elke sensor ziet de drone op een andere manier—via kleine trillingen van ronddraaiende rotorbladen, de veranderende afstand tot de sensor, of de structuur van de draadloze link—zoals het combineren van zien, horen en voelen tot een vollediger beeld.

Een zorgvuldig gecontroleerd testterrein opbouwen

Om betrouwbare data te creëren vloog het team met vier populaire commerciële drones en plaatste een eenvoudige metalen hoekreflector als niet-drone referentie in een open veld zonder grote gebouwen. Alle doelen hingen op dezelfde hoogte en waren gericht naar een cluster sensoren op statieven, zodat elk apparaat het tafereel vanuit bijna exact dezelfde hoek bekeek. De drones werden gemeten op afstanden van 2 tot 30 meter in stappen van 2 meter, met 500 herhaalde opnames voor elke combinatie van dronetype, afstand en sensor. Dit zorgvuldige ontwerp maakt het mogelijk te bestuderen hoe detectie verandert naarmate een drone verder weg beweegt, en om verschillende modellen te vergelijken die variëren in grootte, gewicht en constructie.

Zorgen dat verschillende sensoren in harmonie ademen

Een kernkracht van de dataset is dat de drie sensoren in software tijd-gesynchroniseerd zijn. Alle apparaten worden aangestuurd door één controleprogramma dat ze tegelijk triggert en hun output stappenloos opslaat. Elke opname van één sensor heeft een bijpassende opname van de anderen, uitgelijnd via een gedeelde index in plaats van via complexe hardwareklokken. Voor de twee radars legt het systeem ofwel ruwe signalen vast of verwerkte kaarten die laten zien hoe gereflecteerde energie zich verspreidt over afstand en snelheid. Voor de radio-ontvanger slaat het de ruwe communicatiesignalen op. Deze gedeelde timing maakt het mogelijk informatie direct over sensoren heen te fusen—bijvoorbeeld een flikkering in rotormotion correleren met een uitbarsting in de bedieningslink—zonder achteraf te hoeven worstelen met uitlijning.

Van ruwe golven naar machineklare beelden

Aangezien moderne detectietools vaak steunen op deep learning, zetten de auteurs de ruwe metingen ook om in beeldachtige weergaven die computers gemakkelijk kunnen verwerken. Voor de constante-toon radar halen ze de frequentiepatronen voortgebracht door draaiende propellers naar voren, bekend als micro-bewegingen, en representeren die als eenvoudige spectra. Voor de afstroopradar produceren ze kleurrijke afstand–snelheid beelden die benadrukken waar en hoe de drone beweegt, nadat achtergrondruis is weggeknipt. Voor de radio-ontvanger berekenen ze hoe vermogen over frequenties is verdeeld, waarmee vingerafdrukken van elke drone’s communicatiestijl ontstaan. Elk ruwe bestand heeft een bijpassend beeldbestand, zodat onderzoekers kunnen kiezen of ze op signaalniveau willen werken of direct standaard op afbeeldingen gebaseerde neurale netwerken willen voeden.

Aantonen dat meer ogen beter zijn dan één

Om te laten zien dat de dataset niet alleen interessant maar ook nuttig is, traint het team een bekend beeldherkenningsnetwerk apart op de beelden van elke sensor en vervolgens op gefuseerde combinaties van alle drie. Zoals verwacht presteren de radars minder goed naarmate de drone verder weg is: de gereflecteerde signalen verzwakken en de classificatienauwkeurigheid daalt met afstand. De radio-ontvanger houdt het beter op afstand, maar sommige drones delen vrijwel identieke communicatiebanden en zijn moeilijk van elkaar te onderscheiden met alleen die sensor. Wanneer de onderzoekers de drie gezichtspunten samenvoegen tot één samengesteld input, verbetert de prestatie over de hele linie, vooral voor kleinere, moeilijker te detecteren drones. Dit toont aan dat gesynchroniseerde multi-sensor informatie blinde vlekken van een enkel apparaat kan compenseren.

Wat dit betekent voor veilig luchtruim

Simpel gezegd hebben de auteurs een gedetailleerd, openbaar "oefenterrein" opgebouwd waar slimme algoritmen kunnen leren drones te herkennen met meerdere soorten radio-ogen tegelijk. Door zowel ruwe signalen als kant-en-klare beelden vrij te geven, samen met voorbeeldcode, verlagen ze de drempel voor anderen om detectiesystemen te ontwerpen die betrouwbaar werken onder veranderende omstandigheden en op verschillende afstanden. In de loop van de tijd zouden op deze dataset gebaseerde gereedschappen luchthavens, kritieke faciliteiten en stadsautoriteiten kunnen helpen vriendelijike drones van verdachte te onderscheiden, waardoor het laagvliegende luchtruim veiliger wordt zonder uitsluitend te vertrouwen op camera’s of menselijke waarnemers.

Bronvermelding: Han, SK., Jung, YH. A Time-Synchronized Multi-Sensor drone dataset acquired from multiple radars and RF receiver. Sci Data 13, 407 (2026). https://doi.org/10.1038/s41597-026-06802-6

Trefwoorden: drone-detectie, radarwaarneming, radiofrequente signalen, sensorfusie, open dataset