Clear Sky Science · nl

Een keten-van-denken redeneringsdataset voor borstultrasound die alle histopathologiecategorieën omvat

Waarom dit onderzoek ertoe doet

Borstkankerscreening steunt steeds vaker op echografie, vooral bij jongere vrouwen en in gebieden waar mammografie minder beschikbaar is. Toch gedragen zelfs de beste kunstmatige intelligentie (AI)-hulpmiddelen voor het beoordelen van deze scans zich vaak als black boxes: ze geven een oordeel — goedaardig of kwaadaardig — zonder te laten zien hoe ze daartoe zijn gekomen. Dit artikel introduceert BUS-CoT, een nieuwe, openbaar beschikbare borstultrasounddataset die niet alleen AI helpt kanker te herkennen, maar die het ook leert om "hardop te denken" op een manier die nabootst hoe deskundige radiologen door complexe gevallen redeneren.

Van vage scans naar gestructureerde aanwijzingen

Echobeelden zijn rumoerig en moeilijk te interpreteren, zelfs voor specialisten. Menselijke experts kijken niet slechts vluchtig naar een scan en trekken meteen een diagnose; ze zoeken een keten van visuele aanwijzingen — of een massa ovaal of onregelmatig is, of de randen glad of gekarteld zijn, of er een schaduw wordt geworpen en of kleine heldere stippen op verkalkingen wijzen. Deze aanwijzingen worden vervolgens gewogen met gestandaardiseerde regels, zoals het BI-RADS-systeem, om de kans dat een afwijking kwaadaardig is te schatten en te beslissen of een biopsie nodig is. Bestaande AI-systemen slaan meestal deze stap-voor-stap redenering over en gaan rechtstreeks van pixels naar een voorspelling, wat hun beslissingen moeilijk betrouwbaar en lastig toepasbaar maakt bij ongewone of zeldzame gevallen.

Een rijke nieuwe verzameling real-world gevallen

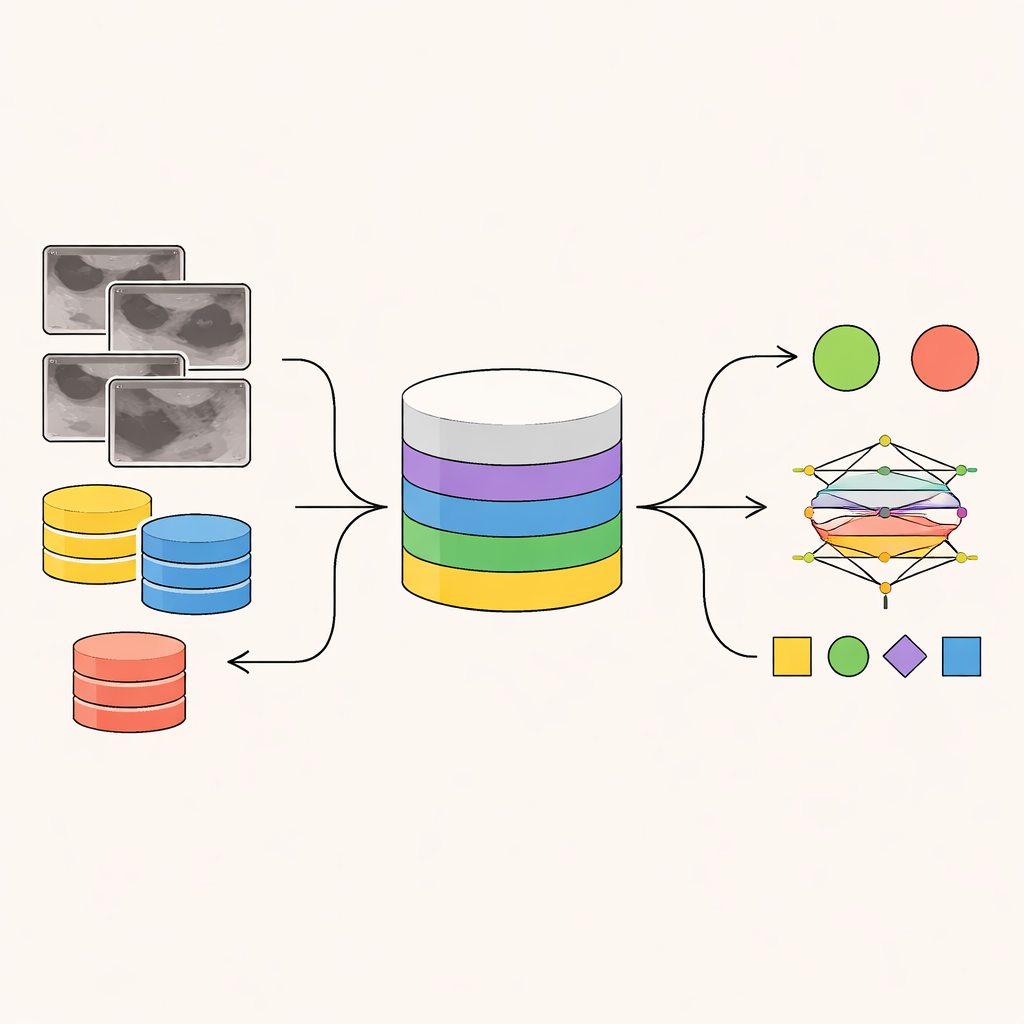

De BUS-CoT-dataset pakt deze problemen aan door 11.439 borstultrasoundbeelden samen te brengen van 11.850 afwijkingen bij 4.838 patiënten, afkomstig uit publicaties, open datasets en online casusrepositories verspreid over meerdere continenten en verschillende echografietoestellen. Cruciaal is dat de verzameling alle 99 borstweefselcategorieën bevat die door de Wereldgezondheidsorganisatie zijn gedefinieerd, van veelvoorkomende goedaardige knobbels zoals fibroadenomen tot zeldzame en agressieve kankers. Deze brede dekking lost een grote zwakte van eerdere datasets op, die vaak zeldzame ziekten helemaal missen en AI-systemen slecht voorbereiden op precies de gevallen waarin artsen het meest moeite hebben.

Machines leren een redeneerlijn te volgen

Buiten ruwe beelden biedt BUS-CoT meerdere lagen van deskundige annotatie. Radiologen leggen eerst basiswaarnemingen vast: of er een massa aanwezig is, of er verkalkingen zijn en waar de afwijking zich bevindt. Vervolgens annoteren ze gedetailleerde visuele kenmerken — vorm, marges, interne echo-patronen en meer — voordat ze BI-RADS-categorieën toekennen en deze beeldvindingen koppelen aan bevestigde pathologie uit weefselmonsters. Ten slotte zetten ze deze gestructureerde informatie om in een narratieve keten-van-denken: een korte stap-voor-stap verklaring die verbindt wat op de scan te zien is met waarom een bepaalde diagnose waarschijnlijk is. In tegenstelling tot automatisch gegenereerde tekst zijn deze redeneerketens opgesteld en geverifieerd door ervaren specialisten in borstaandoeningen, waarmee echte klinische logica behouden blijft waarvan modellen kunnen leren.

De dataset op de proef stellen

Om te laten zien wat deze bron kan opleveren, trainden de auteurs een reeks moderne beeld- en visie–taalmodellen op BUS-CoT, met nadruk op een zorgvuldig samengestelde, hoogwaardige subset van 5.163 lesie-gecentreerde afbeeldingen. Traditionele beeldnetwerken leerden afwijkingen als goedaardig of kwaadaardig te classificeren, terwijl een geavanceerd visie–taalmodel werd getraind zowel het beeld te bekijken als een redeneerketen te genereren vóór het aangeven van het antwoord. Wanneer het model gedwongen werd op deze gestructureerde manier te redeneren, verbeterde de nauwkeurigheid, vooral bij ambigue gevallen waarin goedaardige en kwaadaardige afwijkingen op elkaar lijken. Met andere woorden: het begeleiden van het model om dezelfde visuele aanwijzingen te doorlopen die radiologen gebruiken, hielp het om betere, veiligere beslissingen te nemen.

Hoe dit werk toekomstige zorg kan vormen

Voor patiënten en clinici ligt de belofte van BUS-CoT in AI-hulpmiddelen die niet alleen menselijke nauwkeurigheid evenaren, maar zichzelf ook op een klinisch betekenisvolle manier verklaren. Door duizenden ultrasoundbeelden te koppelen aan zorgvuldig gedocumenteerde redeneringen en het volledige spectrum van borstweefsel-diagnoses te bestrijken — zelfs zeldzame — legt deze dataset de basis voor AI-systemen die moeilijke randgevallen aankunnen en hun aanbevelingen kunnen onderbouwen. Hoewel de dataset nog geen uitgebreidere klinische informatie zoals genetica of medische voorgeschiedenis bevat, is BUS-CoT een belangrijke stap richting meer transparante, betrouwbare echografie-gebaseerde diagnostiek, waarin machines minder als mysterieuze orakels functioneren en meer als ijverige junior-collega’s wiens denkprocessen kunnen worden ingezien en verfijnd.

Bronvermelding: Yu, H., Li, Y., Niu, Z. et al. A Chain-of-thought Reasoning Breast Ultrasound Dataset Covering All Histopathology Categories. Sci Data 13, 370 (2026). https://doi.org/10.1038/s41597-026-06702-9

Trefwoorden: borstultrasound, medische beeldvorming AI, verklaarbare AI, borstkankerdiagnose, klinische datasets