Clear Sky Science · nl

Voorkomen dat proteomica‑data in een digitaal grafmonument belanden door collectieve verantwoordelijkheid en betrokkenheid van de gemeenschap

Waarom uw medische gegevens niet in een digitaal kerkhof thuishoren

De moderne geneeskunde leunt steeds meer op enorme datasets die de duizenden eiwitten in onze cellen beschrijven. Deze bestanden worden vaak openlijk online gedeeld, met de belofte dat andere wetenschappers resultaten kunnen controleren of nieuwe vragen kunnen stellen zonder nieuwe experimenten uit te voeren. Maar als de data in verwarrende formaten staan, essentiële details ontbreken of ze afhankelijk zijn van propriëtaire software, veranderen ze in “data‑grafmonumenten”: zichtbaar voor iedereen, maar praktisch onbruikbaar. Dit artikel laat zien hoe een universitaire cursus studenten transformeerde tot data‑detectives om dit verborgen probleem aan het licht te brengen—en doet enkele eenvoudige voorstellen die gedeelde data echt herbruikbaar zouden maken.

Wetenschap leren door echte studies opnieuw te doen

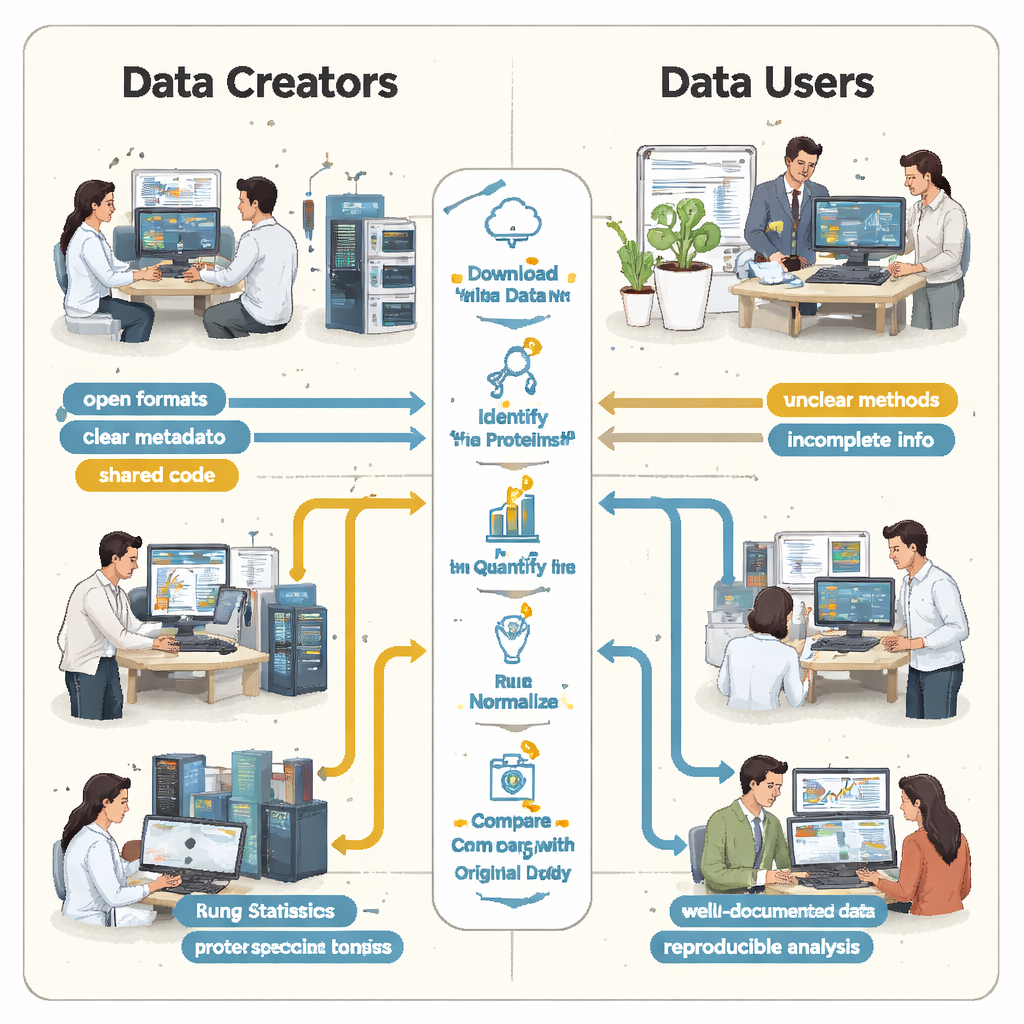

Aan de Universiteit van Helsinki kregen promovendi in een course over massaspectrometrie‑proteomica een ambitieuze opdracht: kies echte, publiek beschikbare eiwitdatasets uit een grote repository en probeer de gepubliceerde bevindingen te reproduceren. In kleine teams downloadden ze zes projecten van het ProteomeXchange‑netwerk, dat massaspectrometrie‑resultaten van vele laboratoria wereldwijd huisvest. Met een gedeelde analyse‑pipeline in de programmeertaal R volgden de studenten grotendeels dezelfde stappen als de oorspronkelijke onderzoekers: eiwitten identificeren, hun abundanties meten, de data opschonen en testen welke eiwitten verschillen tussen condities zoals ziekte versus gezond weefsel.

Grote beloften, ontbrekende instructies

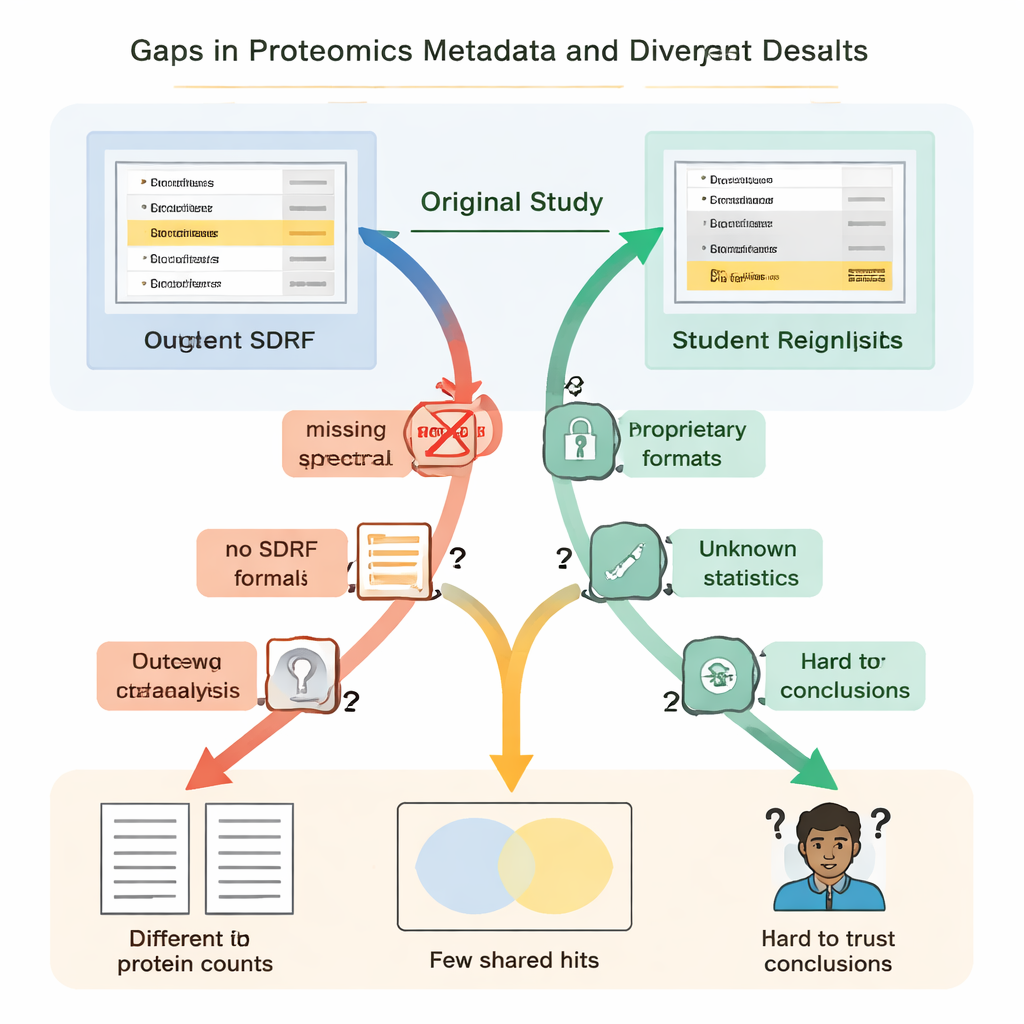

De studenten ontdekten snel dat “open” niet altijd “herbruikbaar” betekent. In elk geval ontbraken essentiële instructies of waren die moeilijk te vinden. Cruciale koppelingen tussen monsters en data‑bestanden waren niet beschreven in een eenvoudige, machineleesbare vorm, waardoor teams moesten raden welke ruwe bestanden bij welke biologische groepen hoorden door artikelen te lezen en bestandsnamen te ontcijferen. Details over hoe valse positieven werden beheerst—zoals het gebruik van speciale “decoy” eiwitsequenties—ontbraken, waardoor het onmogelijk werd om op rigoureuze wijze te beoordelen hoe betrouwbaar de gerapporteerde eiwitlijsten werkelijk waren. In meerdere projecten zaten de belangrijkste resultaten opgesloten in propriëtaire bestandsformaten of waren ze afhankelijk van commerciële software waar de studenten geen toegang toe hadden, waardoor ze grote delen van de analyse vanaf nul moesten herbouwen.

Wanneer kleine lacunes grote verschillen veroorzaken

Deze ontbrekende elementen waren niet alleen irritaties; ze leidden tot drastisch verschillende wetenschappelijke uitkomsten. In één nierziekteonderzoek rapporteerden de oorspronkelijke auteurs net geen vijfduizend eiwitten, terwijl de heranalyse door de studenten—met een open tool en een zelfgebouwde spectrale bibliotheek—meer dan dertienduizend vond. Een eiwit dat in het oorspronkelijke artikel als bijzonder belangrijk werd uitgelicht, verscheen niet overtuigend in het onderliggende identificatiebestand en werd helemaal niet gedetecteerd in de workflow van de studenten. In een ander geval vermeldde de oorspronkelijke studie 108 eiwitten als veranderend tussen condities, maar de studenten, werkend vanaf dezelfde ruwe data maar met onvolledige informatie over hoe de oorspronkelijke statistiek was uitgevoerd, konden er zeker slechts 11 aanwijzen. Elders maakte het ontbreken van biologische replicaten in de geüploade bestanden juiste statistische toetsing simpelweg onmogelijk.

Wat een “herbruikbare” dataset echt zou moeten bevatten

Uit deze zes casestudies kwam een duidelijk patroon naar voren: de belangrijkste barrières voor reproduceerbaarheid waren niet de massaspectrometrie‑instrumenten zelf, maar de manier waarop resultaten werden verpakt en gedeeld. De auteurs bepleiten dat elke proteomica‑dataset geleverd zou moeten worden met een minimaal re‑analyse‑pakket. Dit omvat de ruwe data plus open, gemeenschapsgestandaardiseerde resultaatformaten; een gestandaardiseerde tabel die elk monster koppelt aan zijn experimentele condities; basisoverzichten voor kwaliteitscontrole; eventuele spectrale bibliotheken of eiwitsequentiebestanden die nodig zijn om de zoekopdracht te herhalen; en volledige analyseparameters en code, bij voorkeur opgeslagen met versiebeheer in softwarecontainers. Repositories, tijdschriften en reviewers kunnen helpen door inzenders aan te sporen of te verplichten dit pakket vooraf te leveren, zodat anderen de workflow niet uit verspreide aanwijzingen hoeven te reconstrueren.

Wetenschappers opleiden terwijl je het systeem verbetert

De cursus diende een dubbele doelstelling. Voor studenten bood het een praktijkgerichte manier om complexe proteomica‑methoden, statistiek en programmeren te beheersen, terwijl het tegelijk aantoonde hoe fragiel gepubliceerde conclusies kunnen zijn wanneer documentatie onvolledig is. Voor de bredere gemeenschap vormden de worstelingen van de studenten een stresstest voor de huidige data‑deelpraktijken en maakten ze precies zichtbaar waar metadata en analyserapporten tekortschieten. De auteurs suggereren dat vergelijkbare cursussen elders kunnen worden gegeven, waarbij klaslokalen veranderen in kwaliteitscontrolemotoren die voortdurend aandringen op duidelijkere, transparantere data.

Van data‑grafmonumenten naar levende hulpbronnen

Kort gezegd concluderen de auteurs dat veel eiwitdatasets die nu in openbare repositories staan het risico lopen digitale grafmonumenten te worden—kostbare experimenten waarvan de resultaten niet betrouwbaar gecontroleerd of uitgebreid kunnen worden. De oplossing is echter relatief eenvoudig: behandel metadata, open formaten en deelbare code als integrale onderdelen van het experiment, niet als bijzaak. Als onderzoekers, reviewers en repositories gezamenlijk aandringen op een eenvoudig, goed gedocumenteerd pakket telkens wanneer proteomica‑data worden gedeeld, kunnen die datasets “levend” blijven: klaar om opnieuw te worden geanalyseerd, te worden gecombineerd met nieuwe studies en te worden gebruikt om het bewijs achter biomedische ontdekkingen te versterken.

Bronvermelding: Vadadokhau, U., Soliman, M., Castillon, L. et al. Preventing Proteomics Data Tombs Through Collective Responsibility and Community Engagement. Sci Data 13, 287 (2026). https://doi.org/10.1038/s41597-026-06614-8

Trefwoorden: proteomica, gegevensreproduceerbaarheid, open wetenschap, massaspectrometrie, deling van onderzoeksgegevens