Clear Sky Science · nl

Een grootschalige coherente 4D-beeldsensor

De wereld in vier dimensies zien

Zelfrijdende auto’s, bezorgdrones en headsets voor augmented reality vertrouwen op machines die in realtime de 3D-wereld om hen heen kunnen begrijpen. Dergelijk zicht is momenteel vaak omvangrijk, duur of energie-intensief. Dit artikel rapporteert een belangrijke stap richting een “4D-camera” — een sensor ter grootte van een chip die niet alleen de vorm van een scène in 3D kaart, maar ook meet hoe objecten bewegen, wat compacte machinale visie binnen bereik kan brengen van alles, van robots tot smartphones.

Van platte foto’s naar levende kaarten

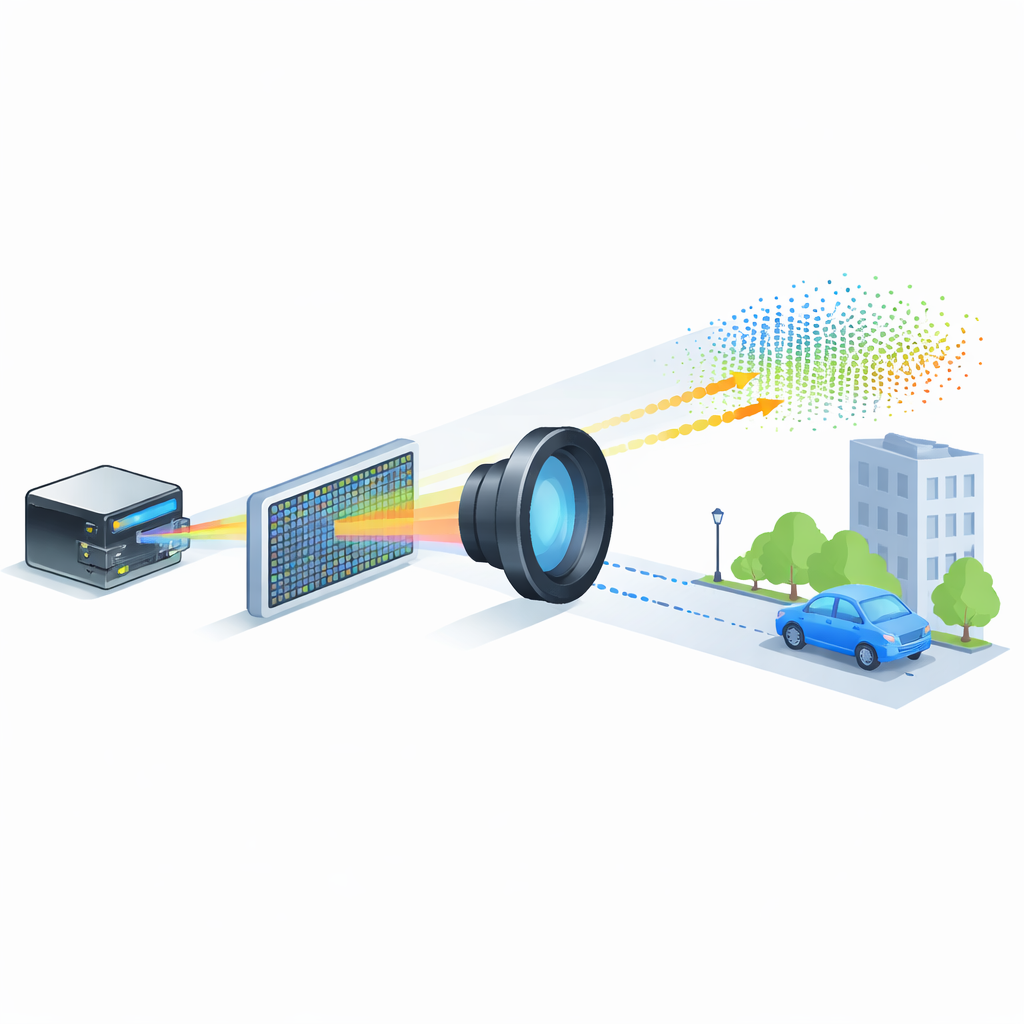

Conventionele camera’s leggen de lichtintensiteit vast op een vlak oppervlak en produceren fraaie 2D-beelden, maar geven geen directe informatie over afstand. Lichtdetectie en -afstandsbepaling (LiDAR) zendt daarentegen laserpulsen uit en meet hoe lang ze erover doen om terug te keren, waarmee een 3D-kaart van de omgeving wordt opgebouwd. Bestaande benaderingen kunnen ver en met hoge resolutie zien, maar vereisen vaak bewegende delen, grote optiek of veel energie per gemeten punt. Daardoor is het moeilijk iets te bouwen dat zo klein, goedkoop en robuust is als een smartphonecamera en toch straten, industriële terreinen of drukke ruimtes veilig en gedetailleerd kan scannen.

Een chip die afstand en beweging meet

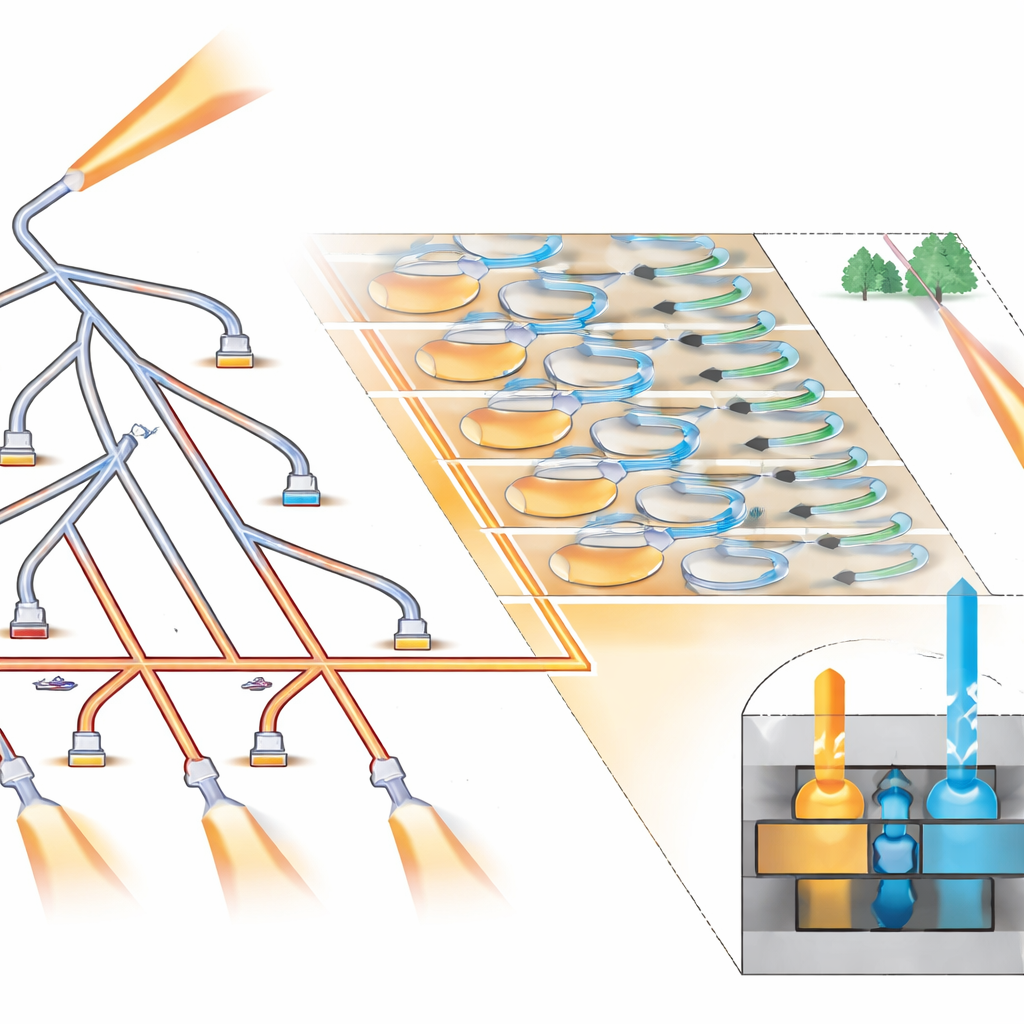

De onderzoekers presenteren een nieuw soort LiDAR-focal-plane-array — in wezen een LiDAR-variant van de beeldsensor in een digitale camera. Hun apparaat bevat 352 bij 176 pixels, in totaal meer dan 60.000 sensorkernen, allemaal gebouwd op één siliconenfotonica-chip samen met de besturingselektronica. In plaats van korte laserpulsen te gebruiken, steunt het systeem op frequentie-gemoduleerd continue-golflicht (FMCW), waarbij de kleur van de laser in een gecontroleerde “chirp” wordt geschoven. Wanneer licht van objecten terugkaatst naar de chip, wordt het coherent gecombineerd met een referentiebeam. Kleine frequentieverscheiden onthullen zowel hoe ver elk punt verwijderd is als hoe snel het naar de sensor toe of ervan af beweegt, waardoor snelheid als vierde gemeten dimensie wordt toegevoegd.

Hoe het kleine lichtrooster werkt

Om veel pixels te dekken zonder energie te verspillen, leidt de chip het geschuifde laserlicht door een boomstructuur van miniatuurschakelaars en stuurt het achtereenvolgens naar groepen van acht aangrenzende pixels. Binnen elke groep wordt het licht gelijkmatig opgesplitst zodat alle acht gelijktijdig als zenders en ontvangers fungeren. Elke pixel gebruikt een paar gratingcouplers om licht te zenden en te verzamelen, plus een set gebalanceerde fotodetectoren en een versterker op de pixel om het beat-signaal te extraheren dat afstand en snelheid codeert. Speciaal ontworpen microlenzen, direct op de chip aangebracht, helpen meer licht in- en uit te leiden en verbeteren de efficiëntie. Omdat dezelfde opening licht verzendt en ontvangt (een “monostatische” opzet), voorkomt het systeem ongewenste koppeling tussen pixels en heeft het slechts één externe beeldlens nodig, vergelijkbaar met een gewone camera.

De 4D-camera aan de tand voelen

Met standaard kortegolf-infraroodlenzen bouwde het team een camera-achtig module rond de chip en legde gedetailleerde 3D-puntenwolken vast van binnen- en buitenruimtes. Met één lens bereikte de sensor een gezichtsveld van ongeveer 33 bij 19 graden en een hoeksresolutie tot 0,06 graden — voldoende om meubels in een kantoor en architectonische details aan gebouwen op tientallen meters afstand te onderscheiden. Het systeem mat objecten van 4 tot 65 meter met slechts tientallen nanojoules optische energie per punt en een gemiddelde op-doel-vermogen van ongeveer 178 microwatt per pixel, binnen strikte oogveiligheidsgrenzen. Het volgde ook beweging: in één experiment mat het de veranderende radiale snelheid van een draaiende schijf met millimeter-per-seconde nauwkeurigheid.

Prestaties, beperkingen en toekomstige groei

Zorgvuldige metingen tonen aan dat de prestaties van de sensor dicht bij fundamentele fysieke limieten liggen die door de kwantumnatuur van licht worden opgelegd, maar nog niet helemaal bereikt zijn. Vandaag is de belangrijkste beperking elektronische ruis van de versterkers in elke pixel, wat de signaal-ruisverhouding iets vermindert vergeleken met een ideaal, puur fotonbegrensd detector. De auteurs schetsen eenvoudige ontwerpwijzigingen — voornamelijk het verhogen van het interne referentielichtniveau en het verfijnen van de optische lay-out, mogelijk gebruikmakend van mengsels van silicium en silicumnitride — die het systeem in een werkelijk shot-noise-beperkt regime kunnen brengen en het bruikbare bereik boven 200 meter kunnen verhogen. Het verplaatsen van sommige on-chip schakelaars uit de pixelarray zou ook kleine gaten in de verafvelddekking verwijderen en schonere puntenwolken opleveren.

Op weg naar alledaagse 4D-visie

Dit werk demonstreert een compacte, volledig geïntegreerde 4D-beeldsensor die het aantal pixels en de reikwijdtes kan evenaren die veel toepassingen in de echte wereld vragen, terwijl vermogen en formaat beperkt blijven. Door lichtbronnen, ontvangers, bundelsturing en besturingselektronica samen op één siliciumchip te brengen, vervult het apparaat een vergelijkbare rol voor 3D- en bewegingsdetectie als de CMOS-sensor voor digitale fotografie. Met verdere verfijningen zouden zulke sensoren goedkoop en robuust genoeg kunnen worden om in auto’s, robots, telefoons en headsets ingebouwd te worden, waardoor machines een nauwkeurig, realtime begrip krijgen van de 3D-wereld en hoe die van moment tot moment verandert.

Bronvermelding: Settembrini, F.F., Gungor, A.C., Forrer, A. et al. A large-scale coherent 4D imaging sensor. Nature 651, 364–370 (2026). https://doi.org/10.1038/s41586-026-10183-6

Trefwoorden: LiDAR, 4D-beeldvorming, siliconenfotonica, autonome systemen, dieptesensing