Clear Sky Science · nl

Betrouwbare onzekerheidsinschattingen in deep learning met efficiënte Metropolis-Hastings-algoritmen

Waarom slimmer omgaan met onzekerheid ertoe doet

Van medische scans tot zelfrijdende auto’s: moderne kunstmatige intelligentie neemt vaak beslissingen waarbij vol vertrouwen fout zijn gevaarlijk kan zijn. Standaard deep learning-systemen zijn uitstekend in patroonherkenning, maar ze zijn berucht slecht in het aangeven van hun eigen onzekerheid. Dit artikel pakt die kloof aan: het presenteert nieuwe manieren om diepe neurale netwerken van betrouwbare onzekerheidsmaten te voorzien, terwijl de zware rekencapaciteit van traditionele Bayesiaanse methoden onder controle blijft.

Van giswerk naar gemeten vertrouwen

In alledaagse deep learning wordt een model eenmaal getraind en daarna onveranderd gebruikt. Het geeft één beste schatting, maar geeft weinig inzicht in hoe betrouwbaar die schatting is. Bayesiaanse neurale netwerken kiezen een andere weg: in plaats van één vaste set modelparameters te gebruiken, behandelen ze parameters als willekeurig en proberen ze een gehele verdeling van plausibele modellen vast te leggen. Door voorspellingen over deze verzameling te middelen, kun je zowel het meest waarschijnlijke antwoord zien als hoezeer het model zichzelf zou moeten vertrouwen. De uitdaging is dat het nauwkeurig sampelen uit deze verdeling met goudstandaardmethoden zoals Hamiltoniaanse Monte Carlo extreem kostbaar is voor de grote netwerken en datasets van vandaag.

Snellere sampling zonder het grotere plaatje te verliezen

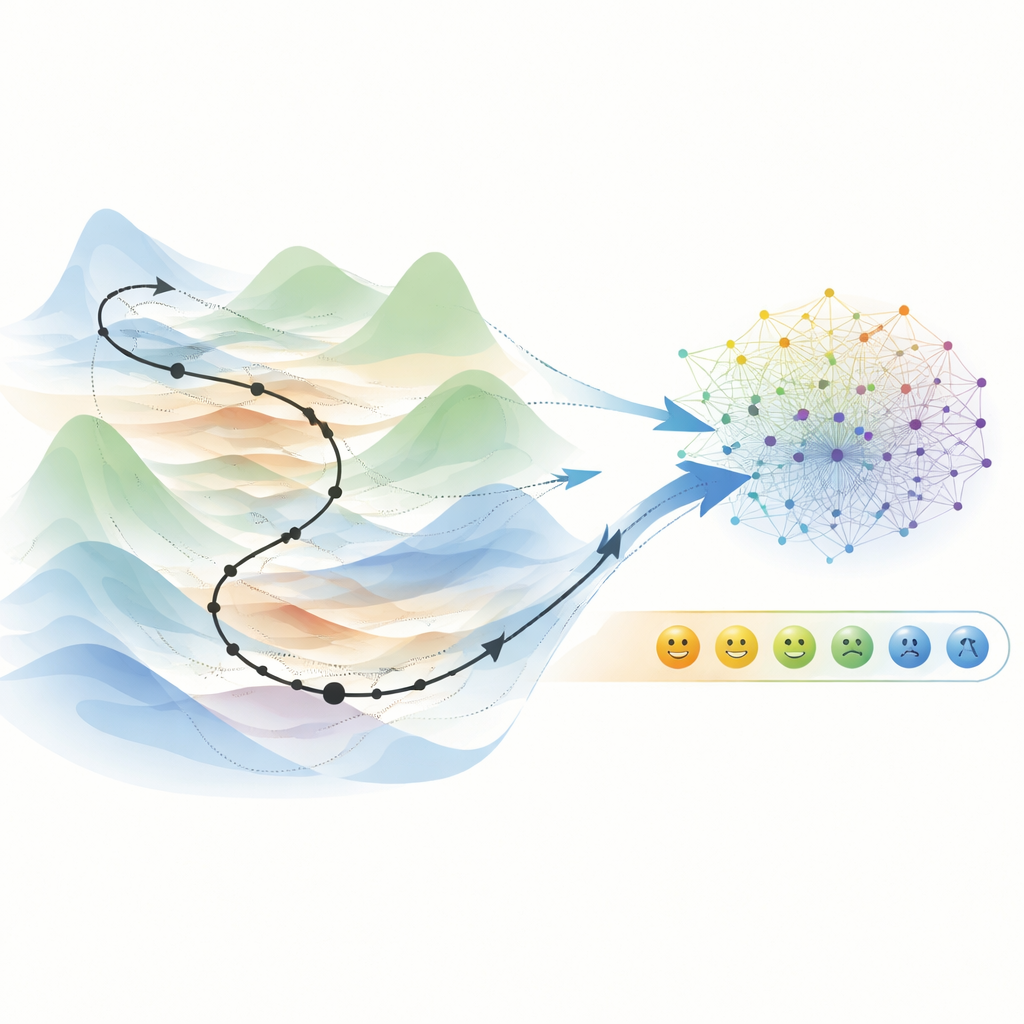

De auteurs richten zich op een familie methoden genaamd stochastische gradient Hamiltoniaanse Monte Carlo, die al ideeën uit standaardtraining hergebruikt—mini-batches en noiserijke gradiënten—om het sampelen te versnellen. Het ontbrekende ingrediënt is een betrouwbare “filter” die beslist welke voorlopige parameterupdates behouden blijven. In klassieke Hamiltoniaanse Monte Carlo vervult een Metropolis-Hastings-acceptatiestap deze rol: die corrigeert numerieke fouten en voorkomt dat de sampler naar de verkeerde regio’s wegdrijft. Het invoeren van deze acceptatiestap in de noisy, mini-batchwereld van deep learning is moeilijk, omdat het doorgaans volledige dataset-evaluaties vereist en de voortgang kan stilleggen als acceptatiepercentages te laag zijn.

Twee nieuwe manieren om het landschap te bewandelen

Het artikel introduceert twee aanvullende strategieën. De eerste, genoemd generalized stochastic gradient Hamiltonian Monte Carlo (GSGHMC), ontwerpt een acceptatietest die op mini-batches kan draaien terwijl ze de belangrijke eigenschap behoudt dat werkelijke optima van het volledige probleem nog steeds correct worden herkend. Het gebruikt een zorgvuldig gekozen numerieke integrator zodat stap-voor-stapacceptatie stabiel blijft, ook al ziet die slechts een deel van de data per keer. Dit levert een efficiënte sampler op die dicht bij het echte Bayesiaanse beeld blijft en ensembles van modellen produceert met bijzonder goed gekalibreerde betrouwbaarheidscores.

Lange trajecten benutten voor betere voorspellingen

De tweede methode, het Hamiltonian Trajectory Ensemble (HTE), maakt een bewuste afweging: in plaats van te blijven vasthouden aan exact Bayesiaans gedrag, geeft het de voorkeur aan lange, momentumgedreven wandelingen door de parameterruimte die lijken op agressieve trainingsruns. Aan het einde van elk dergelijk traject beslist een Metropolis-achtige test of de resulterende modelsnapshot moet worden bewaard. Omdat deze paden de neiging hebben zich te nestelen in brede, generaliseerbare valleien van het verlieslandschap, vormen de verzamelde modellen een diverse maar gerichte ensemble. In beeldclassificatieroutines zoals EMNIST en CIFAR-10 verbetert HTE de nauwkeurigheid met tot ongeveer zes procentpunten ten opzichte van sterke Bayesiaanse referenties, en met enkele punten ten opzichte van gewone deterministische training, terwijl het nog steeds nuttige onzekerheidsinformatie en sterke detectie van out-of-distribution inputs biedt.

Kleinere ensembles, slimmer gebruik

Het sampelen van honderden of duizenden modellen klinkt duur tijdens testen, dus onderzoeken de auteurs ook hoeveel ensembleleden echt nodig zijn. Door gretig modellen weg te laten die weinig effect op de prestatie hebben, vinden ze dat ruwweg een derde van het ensemble vaak kan volstaan zonder de nauwkeurigheid te schaden, hoewel het behouden van zeer scherpe kalibratie doorgaans meer leden vereist. Over beeldtaken en een chaotisch tijdreeksvoorspellingsprobleem presteren hun methoden consequent beter of gelijk aan populaire alternatieven zoals variationale inferentie, Monte Carlo dropout en eenvoudigere deep ensembles, zij het tegen een hogere trainingskost dan gewone deterministische leerprocedures.

Wat dit betekent voor AI in de praktijk

Voor niet-specialisten is de kernboodschap dat we deep learning niet alleen accuraat maar ook eerlijk over wat het niet weet kunnen maken, zonder supercomputer-schaal middelen. Door klassieke samplingideeën zorgvuldig te verweven met moderne, mini-batchgebaseerde training, leveren de twee voorgestelde benaderingen betere voorspellingen en betrouwbaardere betrouwbaarheidsinschattingen dan veel bestaande technieken. Deze combinatie van efficiëntie, robuustheid en gekalibreerde onzekerheid is een belangrijke stap richting het veilig inzetten van deep learning in gevoelige domeinen waar de kosten van overmoedigheid in levens gemeten kunnen worden, en niet alleen in procentpunten.

Bronvermelding: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Trefwoorden: Bayesiaanse neurale netwerken, onzekerheidsinschatting, Hamiltoniaanse Monte Carlo, deep learning-ensembles, stochastische gradient MCMC