Clear Sky Science · nl

Een equivariant voorgetrainde transformer voor verenigd 3D-molecuulrepresentatieleren

Computers leren moleculen in 3D te zien

Het ontwerpen van nieuwe geneesmiddelen en materialen hangt af van begrip van hoe moleculen er werkelijk uitzien en bewegen in drie dimensies, niet alleen als platgedrukte formules op papier. Dit artikel introduceert een krachtig nieuw kunstmatig intelligentiemodel dat kan leren van de 3D-vormen van vele soorten moleculen tegelijk — van kleine geneesmiddelachtige verbindingen tot grote eiwitten en hun complexen — en die kennis vervolgens gebruikt om te voorspellen hoe sterk ze op elkaar inwerken en welke kandidaten mogelijke toekomstige geneesmiddelen kunnen worden.

Één kaart voor veel moleculaire werelden

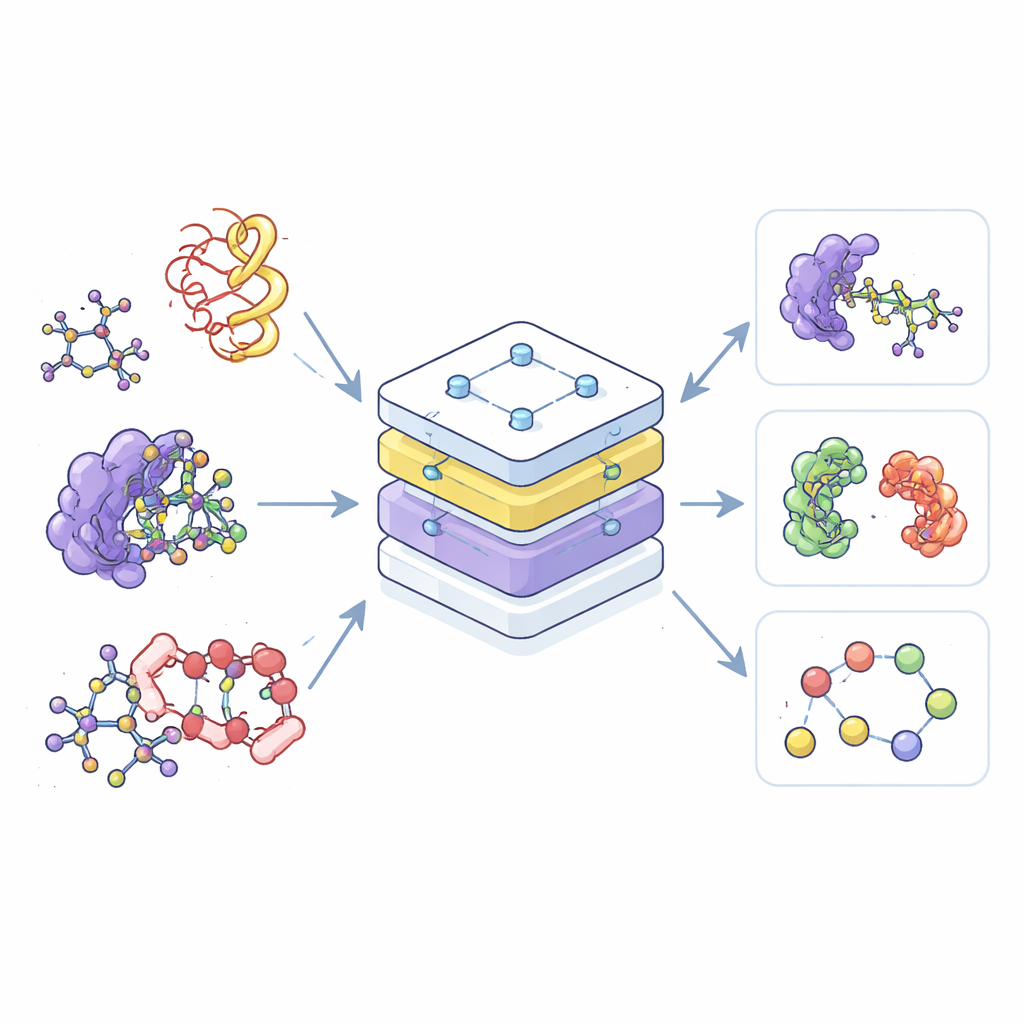

De meeste huidige AI-hulpmiddelen voor chemie zijn specialisten: het ene is alleen getraind op kleine moleculen, een ander alleen op eiwitten en weer een derde alleen op hun complexen. Die scheiding verspilt data en maakt het moeilijk om wat in het ene domein geleerd is, over te dragen naar een ander. De auteurs bouwen in plaats daarvan één “fundamenteel” model, de Equivariant Pretrained Transformer (EPT), dat leert van een enorme verzameling 3D-molecuulstructuren uit meerdere openbare databanken. Door al deze structuren binnen één gedeeld kader te behandelen, kan het model gemeenschappelijke patronen herkennen in hoe atomen zich ordenen en interageren, of ze nu tot een eenvoudige geneesmiddelmolecule behoren of tot een ingewikkelde knoop van eiwitketens.

Moleculen in hanteerbare stukken opdelen

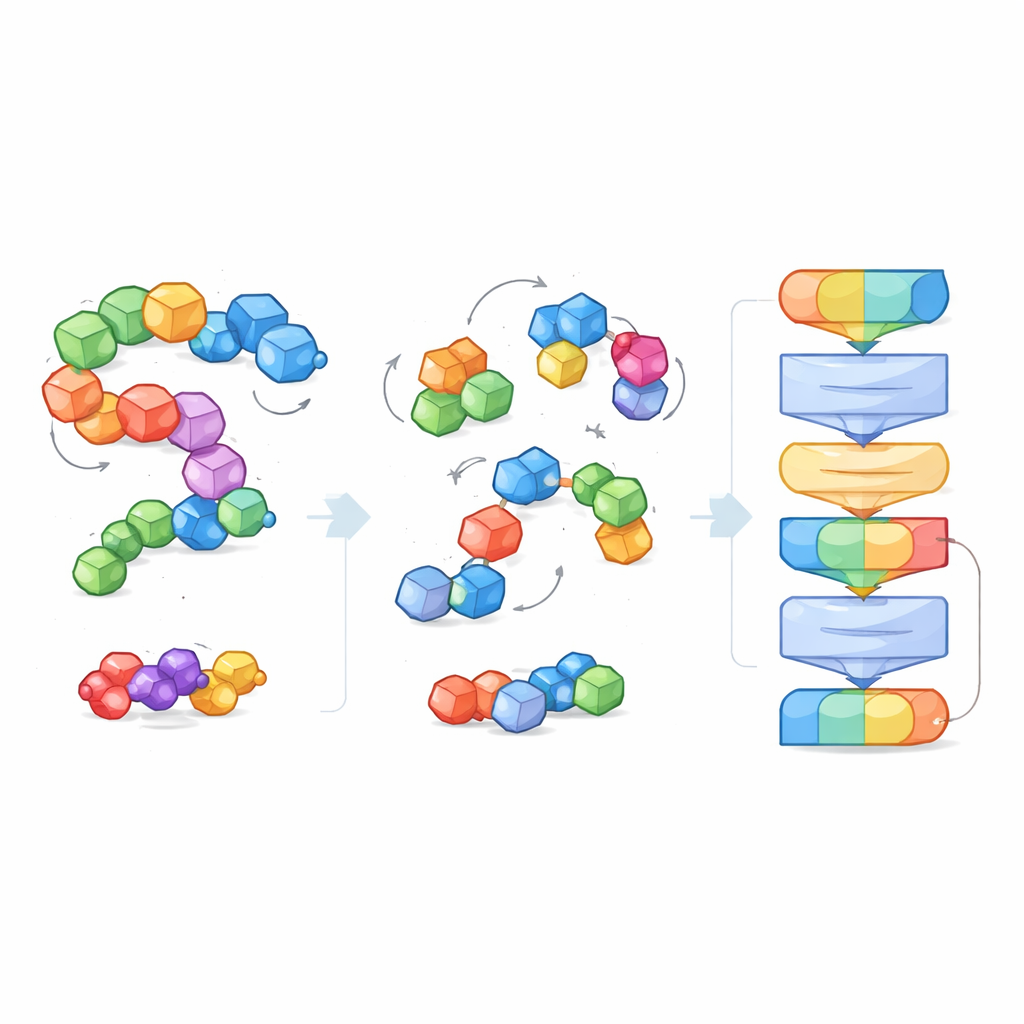

Om om te gaan met de enorme variëteit en grootte van moleculaire systemen introduceren de onderzoekers het idee van “blokken” — kleine, betekenisvolle clusters van atomen. Voor kleine moleculen groepeert een blok een zwaar atoom met de eraan gebonden waterstoffen; voor eiwitten wordt ieder aminozuur een blok. Tijdens het trainen ziet het model zowel de fijnmazige atomen als de grovere blokstructuur, waardoor het lokale chemische details kan verbinden met ruimere 3D-vormen zoals eiwitbackbones of bindingspockets. Dit blokperspectief creëert ook een gemeenschappelijke taal die werkt over zeer verschillende moleculaire typen heen, waardoor één model ze allemaal kan begrijpen.

Leren door het opruimen van rumoerige structuren

In plaats van expliciete labels te krijgen zoals “dit molecuul is oplosbaar” of “dit bindt sterk”, wordt EPT op een zelfgestuurde manier getraind. De auteurs verstoren elk moleculair blok opzettelijk, door het willekeurig te verschuiven en te roteren ten opzichte van de ware positie, en vragen het model vervolgens de krachten en rotaties af te leiden die nodig zijn om de oorspronkelijke structuur te herstellen. Omdat de training fundamentele geometrische regels respecteert — het molecuul zou er hetzelfde uit moeten zien als het hele systeem wordt geroteerd of verplaatst in de ruimte — leert het model een fysisch consistente gevoeligheid voor 3D-vorm. Dit denoising-spel leert EPT hoe atomen binnen en tussen blokken samenhangen en hoe subtiele veranderingen in geometrie de stabiliteit beïnvloeden.

Het model op de proef stellen

Na voortraining op meer dan vijf miljoen structuren wordt EPT fijngeslepen voor meerdere echte wetenschappelijke taken. Het voorspelt hoe sterk een klein molecuul aan een eiwitpocket bindt, hoe een enkele mutatie aan een eiwitinterface de binding beïnvloedt, en belangrijke fysieke eigenschappen van kleine moleculen die chemici interesseren. Over diverse benchmarks heen bereikt het verenigde model resultaten die gelijk zijn aan of beter presteren dan de beste bestaande hulpmiddelen, inclusief die specifiek voor één domein zijn afgestemd. Opmerkelijk is dat training op één type data, zoals kleine moleculen, nog steeds helpt bij ogenschijnlijk verschillende taken, zoals eiwitbinding, wat laat zien dat het algemene chemische principes heeft vastgelegd in plaats van beperkte trucs.

Zoeken naar nieuwe COVID‑19-behandelingen

De auteurs tonen de praktische waarde van EPT verder aan door het in te zetten voor een drug-repurposing-uitdaging. Ze fijngeslepen het model eerst op eiwit–ligandcomplexen en gebruiken het vervolgens om bijna 2.000 reeds goedgekeurde geneesmiddelen te rangschikken op hun voorspelde vermogen te binden aan het hoofdprotease van SARS‑CoV‑2, een sleutelenzym dat het virus nodig heeft om zich te repliceren. Bekende anti‑COVID‑19-middelen stijgen in de ranglijst, en het model wijst aanvullende veelbelovende kandidaten aan. Twaalf hoog scorende moleculen worden nader onderzocht met computersimulaties, en twee — waaronder één die oorspronkelijk niet voor COVID‑19 ontwikkeld was — vertonen bijzonder sterke voorspelde binding en worden experimenteel bevestigd als remmers van het virale protease op micromolaire niveaus.

Een stap richting algemene moleculaire AI

In eenvoudige bewoordingen laat dit werk zien dat één geometrie-bewust AI-model een gedeeld 3D‑begrip van vele moleculaire systemen kan leren en dit vervolgens kan gebruiken om een breed scala aan wetenschappelijke vragen te beantwoorden. Door moleculen in blokken te organiseren en het model te trainen om vervormde structuren te “repareren”, creëren de auteurs een hulpmiddel dat niet alleen getallen nauwkeuriger voorspelt maar ook taken zoals het vinden van nieuwe antivirale middelen kan versnellen. EPT wijst de weg naar een toekomst waarin algemene moleculaire AI-systemen chemici en biologen helpen chemische ruimte efficiënter te verkennen, experimenten sturen en het pad van atomaire structuur naar praktische therapieën en materialen verkorten.

Bronvermelding: Jiao, R., Kong, X., Zhang, L. et al. An equivariant pretrained transformer for unified 3D molecular representation learning. Nat Commun 17, 2606 (2026). https://doi.org/10.1038/s41467-026-69185-7

Trefwoorden: 3D-molecuulrepresentatie, equivariant transformer, geneesmiddelontwikkeling, eiwit–ligandbinding, zelfgestuurd leren