Clear Sky Science · nl

Gesloten-vorm feedbackvrij leren met voortwaartse projectie

Machines onderwijzen zonder terugwaartse berichten

Moderne kunstmatige intelligentie leert meestal met een methode die backpropagation heet, waarbij fouten terug door een netwerk worden gestuurd om de interne verbindingen aan te passen. Maar dit proces verschilt van hoe echte hersenen werken en kan traag en energie-intensief zijn. Dit artikel introduceert een nieuwe manier voor neurale netwerken om te leren, genaamd Voortwaartse Projectie, die de terugwaartse stap volledig overslaat en toch sterke prestaties levert, vooral bij uitdagende biomedische taken met beperkte data.

Een nieuwe manier om leren te sturen

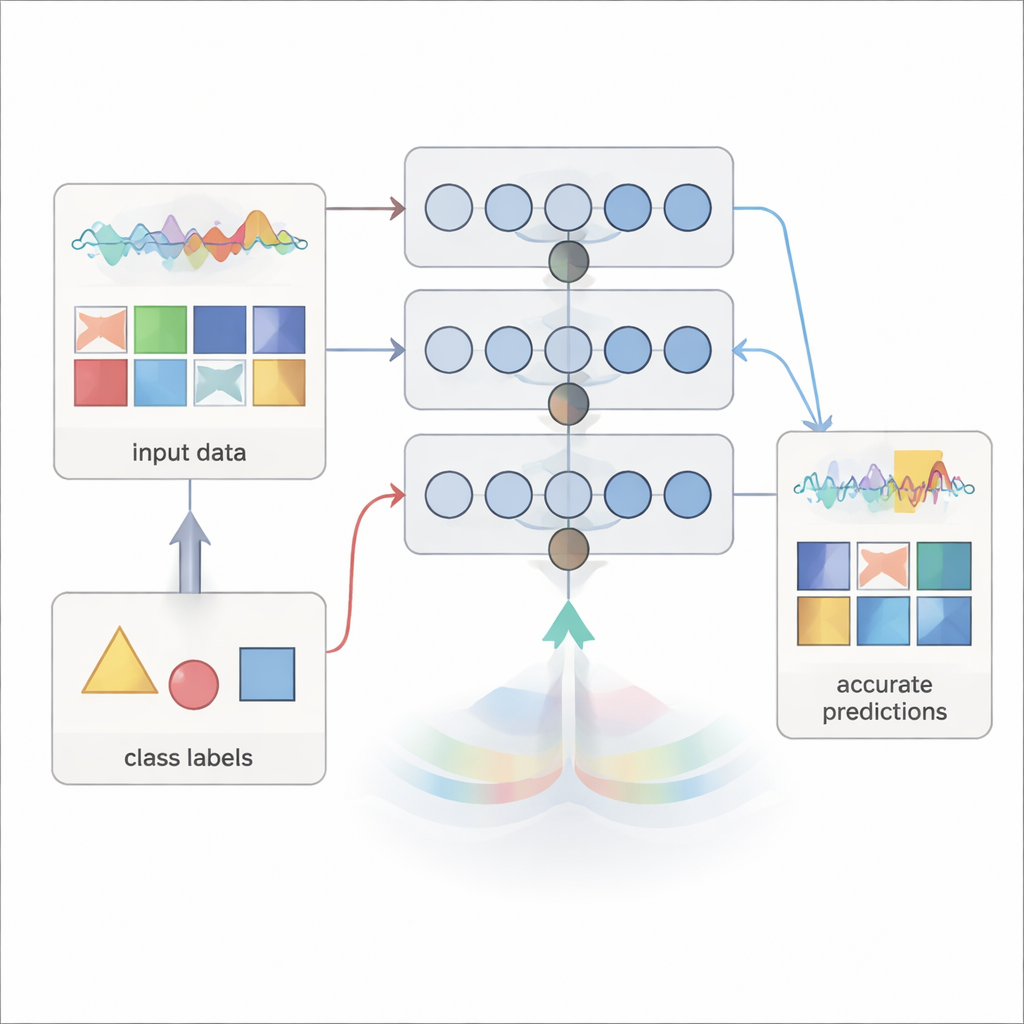

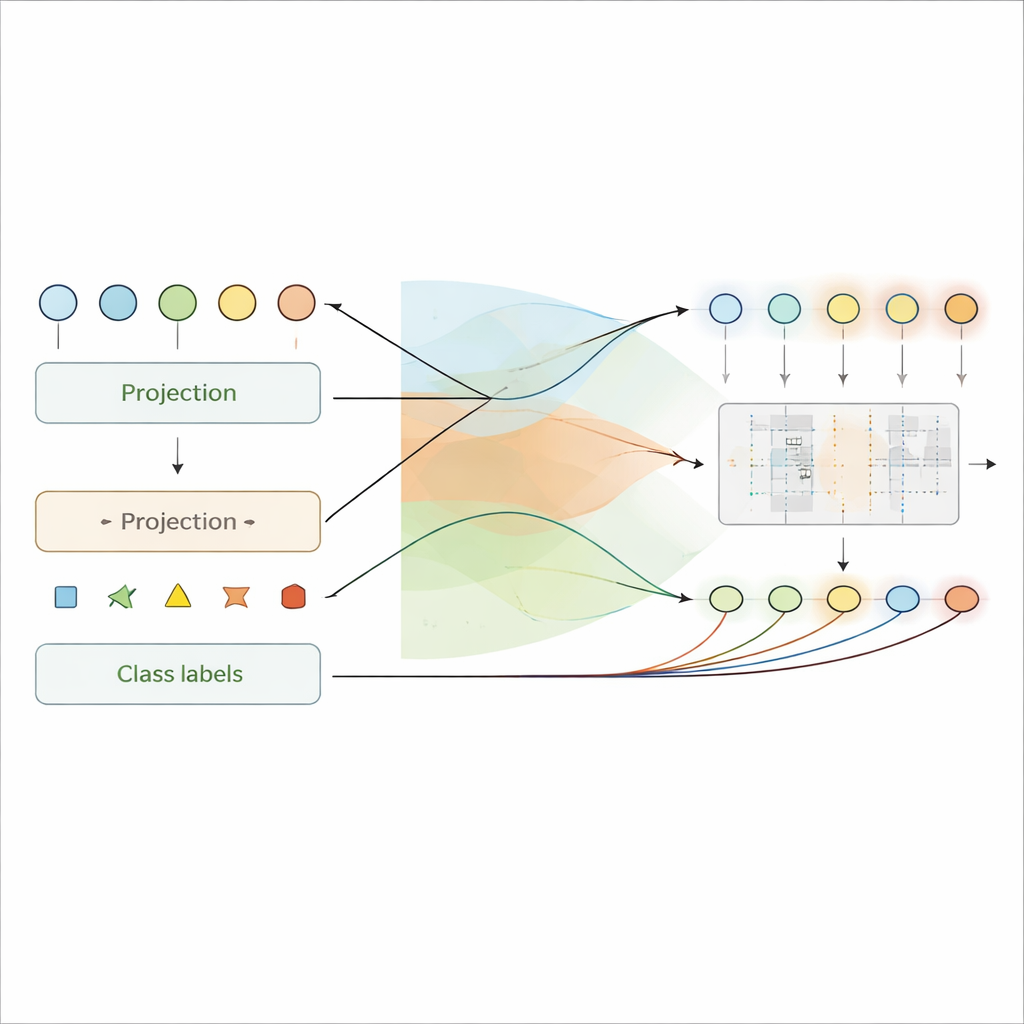

Traditionele neurale netwerken leren door hun voorspellingen te vergelijken met de juiste antwoorden en foutsignalen terug door elke laag te sturen om de verbindingen fijn af te stemmen. Voortwaartse Projectie kiest een andere route. In plaats van te vertrouwen op deze terugwaartse foutboodschappen, gebruikt het alleen informatie die beschikbaar is terwijl signalen naar voren bewegen: de activiteit van de huidige laag en het doellabel. In elke laag combineert de methode de invoer van die laag en het gewenste uitvoerlabel via vaste willekeurige projecties die door een eenvoudige niet-lineariteit worden geleid. Dit produceert een "doel" intern signaal voor die laag—een patroon van membraanachtige activiteit dat de laag moet proberen te benaderen.

Zodra deze doelen zijn gecreëerd, worden de verbindingsgewichten van elke laag in één keer opgelost met gesloten-vorm regressie, een standaard statistische formule in plaats van iteratieve gradient descent. Dit betekent dat het netwerk in één doorgang over de dataset kan worden getraind, zonder herhaaldelijk dezelfde voorbeelden te herzien of grote aantallen tussenliggende activaties op te slaan. Omdat geen informatie achterwaarts hoeft te reizen, respecteert de methode de eenrichtingscommunicatie die in biologische neuronen wordt gezien en kan ze gemakkelijker te implementeren zijn op gespecialiseerde hardware met eenduidige verbindingen.

Betekenis zien in verborgen activiteit

Een opvallend voordeel van Voortwaartse Projectie is dat de interne signalen in verborgen lagen direct interpreteerbaar worden. Omdat elke laag expliciet wordt getraind om zowel de invoer als het label in zijn membraanachtige potentialen te coderen, kunnen deze interne waarden worden gelezen als lokale voorspellingen van de klasse. De auteurs laten zien hoe deze signalen ongeveer terug te "decoderen" zijn naar labellandschap, waardoor activiteitspatronen veranderen in per-laag verklaringen van wat het netwerk op elk stadium gelooft. In experimenten worden deze verklaringen nauwkeuriger in diepere lagen, wat progressief leren weerspiegelt—vroege lagen zien brede patronen, terwijl latere lagen zich richten op beslissingskritische details.

Deze interpreteerbaarheid is bijzonder waardevol in de geneeskunde, waar begrijpen waarom een model een beslissing nam net zo belangrijk kan zijn als de beslissing zelf. Met behulp van elektrocardiogramgegevens tonen de auteurs aan dat Voortwaartse Projectie klinisch bekende tekenen van een hartaanval benadrukt—zoals veranderingen in specifieke golfsegmenten—op de juiste momenten in de tijd. Bij oogscans die gebruikt worden om abnormale bloedvatgroei te detecteren, richt de methode zich van nature op vochtophopingen, heldere afzettingen en littekenachtige gebieden waar specialisten naar zoeken, zelfs wanneer getraind met slechts 100 voorbeelden per klasse.

Snel trainen, sterke resultaten

Het team heeft Voortwaartse Projectie vergeleken met meerdere alternatieven die ook proberen volledige backpropagation te vermijden, evenals met standaard backpropagation zelf. Bij afbeeldings- en sequentietaken zoals Fashion-MNIST cijfers, DNA-promoterherkenning, hartaanvaldetectie uit elektrocardiogrammen en objectherkenning, evenaarde of overtrof de nieuwe methode de prestaties van andere lokale leeregels. In standaardinstellingen had backpropagation nog steeds een algemeen voordeel, maar de nauwkeurigheid van Voortwaartse Projectie kwam verrassend dichtbij terwijl slechts één enkele trainingspassage werd gebruikt.

De voordelen werden duidelijker in "few-shot" scenario's, waar slechts een handvol gelabelde voorbeelden beschikbaar is, zoals vaak het geval is in de klinische praktijk. Hier generaliseerde Voortwaartse Projectie vaak beter dan zowel backpropagation als concurrerende lokale methoden op thoraxfoto's, netvliesbeelden en kleine afbeeldingssubsets. Backpropagation neigde ertoe de kleine datasets te overfitten of niet rijke genoeg kenmerken te leren, terwijl Voortwaartse Projectie stabielere, herbruikbare interne representaties produceerde. Vanuit computationeel oogpunt vereiste het trainen van een grote laag orders of magnitude minder vermenigvuldig-en-optelbewerkingen dan het draaien van vele epochs van backpropagation, wat leidde tot aanzienlijke snelheidsverbeteringen en lager energieverbruik.

Wat dit betekent voor toekomstige AI en door de hersenen geïnspireerde computing

In eenvoudige bewoordingen laat dit werk zien dat neurale netwerken niet afhankelijk hoeven te zijn van zware, biologisch onwaarschijnlijke feedbacklussen om nuttige en begrijpelijke interne representaties te leren. Door invoer en labels slim te mengen in een enkele voortwaartse sweep en de gewichten in gesloten vorm op te lossen, biedt Voortwaartse Projectie een manier om modellen snel te trainen, hun interne werking te interpreteren en te werken met kleine, lawaaierige biomedische datasets. Hoewel backpropagation het gouden standaard blijft voor veel grootschalige taken, wijst deze feedbackvrije benadering op meer hersenachtige en hardwarevriendelijke leerstrategieën die de volgende generatie efficiënte, uitlegbare AI-systemen kunnen ondersteunen.

Bronvermelding: O’Shea, R., Rajendran, B. Closed-form feedback-free learning with forward projection. Nat Commun 17, 2414 (2026). https://doi.org/10.1038/s41467-026-69161-1

Trefwoorden: feedbackvrij leren, neurale netwerken, few-shot training, biomedische AI, uitlegbare deep learning