Clear Sky Science · nl

Het trainen van tactiele sensoren om krachtsensing van elkaar te leren

Robots die kunnen voelen en hun gevoel voor aanraking kunnen delen

Naarmate robots de fabriek verlaten en hun intrede doen in huizen, ziekenhuizen en magazijnen, hebben ze een zintuig nodig dat wij vaak als vanzelfsprekend beschouwen: aanraking. Net zoals onze vingers automatisch anders reageren wanneer we een knapperige chip oppakken dan bij een zware doos, moeten toekomstige robots leren hoe hard ze moeten knijpen en wanneer een voorwerp op het punt staat weg te glijden. Dit artikel introduceert een nieuwe manier waarop robotachtige "huid" krachtsensing van andere huiden kan leren, waardoor dure kalibratie wordt verminderd en machines dichter bij mensachtige behendigheid komen.

Waarom aanraking voor robots zo moeilijk goed te krijgen is

Moderne robots hebben al veel soorten kunstmatige huid. Sommige gebruiken kleine camera’s die in zachte gels kijken, andere vertrouwen op magneten of elektronische rasters die druk meten. Elk ontwerp blinkt uit in bepaalde taken, maar ze spreken allemaal verschillende "dialecten" van aanraking: dezelfde druk op twee sensoren kan zeer verschillende signalen opleveren. Vandaag de dag heeft elke nieuwe sensor meestal zijn eigen arbeidsintensieve trainingsproces met precieze krachtmeters nodig, duizenden keren herhaald. Nog erger is dat zachte materialen verouderen en slijten, waardoor deze kostbare kalibratie opnieuw moet worden uitgevoerd telkens wanneer een sensor wordt vervangen.

Een idee lenen van het menselijk brein

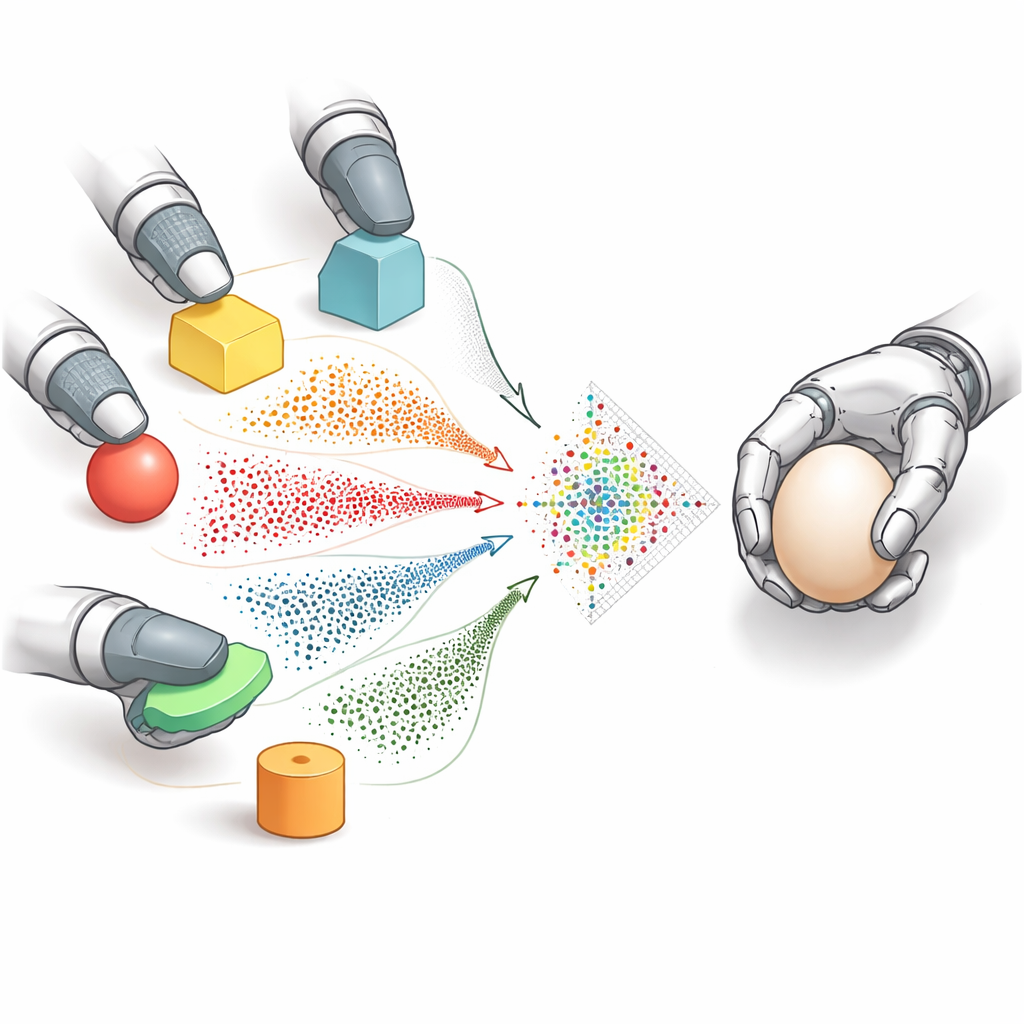

Mensen lossen een vergelijkbaar probleem moeiteloos op. Onze huid is vol verschillende soorten tastreceptoren, maar het brein zet al hun signalen om in een gedeelde interne code. Die eenduidige tactiele representatie stelt ons in staat in te schatten hoe iets zou voelen op een deel van de hand dat het nog nooit heeft aangeraakt, door simpelweg te putten uit eerdere ervaringen. De onderzoekers achter dit werk imiteren dat idee bij robots. Ze zetten alle sensoruitgangen—camerabeelden, magnetische metingen of elektronische signalen—om in een gemeenschappelijke, beeldachtige vorm bestaande uit stippen, die staan voor hoe de huid vervormt. Deze gedeelde markerrepresentatie fungeert als een eenvoudige "taal van aanraking" die elke sensor kan gebruiken.

Een sensor leren de ander na te bootsen

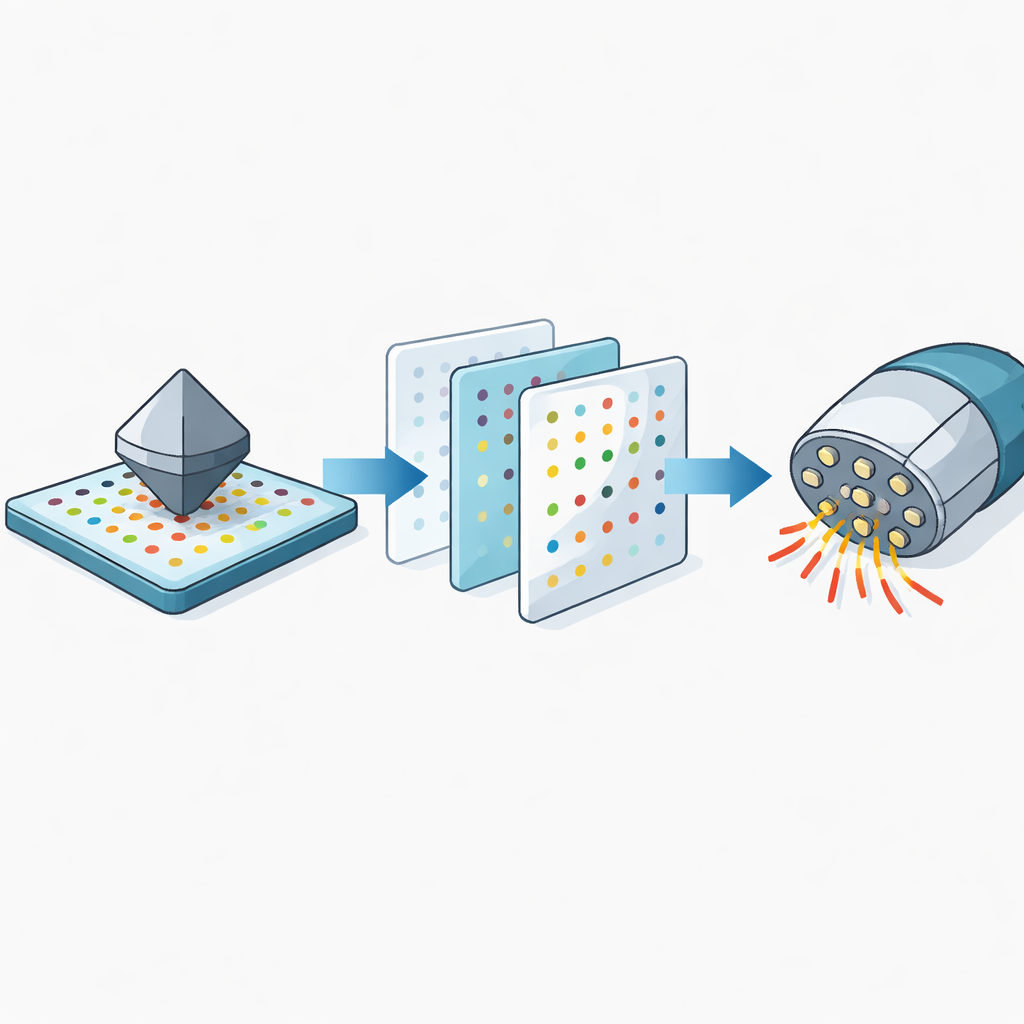

Zodra alle sensoren deze op stippen gebaseerde taal spreken, introduceert het team een vertaalsstap die marker-naar-markervertaling wordt genoemd. Met behulp van krachtige generatieve modellen trainen ze een systeem dat het stippenpatroon van de ene sensor kan transformeren in het patroon dat een andere sensor zou hebben laten zien onder hetzelfde contact. Dat betekent dat een goed gekalibreerde sensor effectief kan "voorstellen" wat een niet-gekalibreerde sensor zou voelen, en er synthetische trainingsdata voor kan genereren. Een tweede model bekijkt vervolgens korte reeksen van deze stippenbeelden om te voorspellen hoe krachten in de loop van de tijd in drie richtingen veranderen, waarbij zowel duwen als zijwaarts schuiven in aanmerking worden genomen.

Omgaan met verschillen in zachte huid in de echte wereld

In de praktijk zijn verschillende robothuiden niet alleen anders van vorm en bedrading; ze zijn ook gemaakt van materialen die zachter of stijver kunnen zijn en die veranderen naarmate ze ouder worden. Deze verschillen kunnen krachtinschattingen vervormen, zelfs als de patronen er vergelijkbaar uitzien. De onderzoekers meten hoe elk type zacht materiaal buigt onder belasting en bouwen een eenvoudige correctiestap die krachtlabels omhoog of omlaag schaalt voordat de training begint. Deze materiaalkompensatie vermindert fouten sterk, vooral bij het overdragen van kennis tussen zeer zachte en zeer stijve huiden.

Van labbank naar alledaagse manipulatie

Het team test hun methode, genoemd GenForce, op een brede mix van sensoren, van meerdere exemplaren van hetzelfde camera-gebaseerde pad tot zeer verschillende ontwerpen die magneten of gebogen, vingertopachtige vormen gebruiken. Over meer dan 200 combinaties in simulatie en hardware reduceert GenForce de voorspelfouten aanzienlijk vergeleken met het simpelweg hergebruiken van een model dat op een andere sensor is getraind. In demonstraties gebruikt een robothand, uitgerust met verschillende tactiele huiden op elke vinger, overgedragen modellen om voorzichtig kwetsbare voorwerpen zoals fruit en chips te grijpen en om wegglijdende objecten te detecteren en te corrigeren door de metingen van beide zijden van een greep te coördineren.

Wat dit betekent voor de toekomst van robothanden

Door tactiele sensoren toe te staan krachtsensing van elkaar te leren in plaats van vanaf nul te beginnen, wijst GenForce de weg naar robothanden die eenvoudiger en goedkoper op schaal te implementeren zijn. Eén zorgvuldig gekalibreerde sensor zou vele anderen kunnen trainen, zelfs van verschillende ontwerpen, en voorgetrainde modellen zouden met slechts een kleine hoeveelheid nieuwe data kunnen worden bijgesteld. Voor niet‑specialisten is de kernboodschap simpel: dit werk maakt het praktischer voor robots om te voelen hoe hard ze knijpen en snel te reageren wanneer voorwerpen beginnen te glijden, waardoor we dichterbij machines komen die de echte wereld met hetzelfde zekere gevoel van een menselijke hand behandelen.

Bronvermelding: Chen, Z., Ou, N., Zhang, X. et al. Training tactile sensors to learn force sensing from each other. Nat Commun 17, 2101 (2026). https://doi.org/10.1038/s41467-026-68753-1

Trefwoorden: robot aanraking, tactiele sensoren, krachtsensing, robotmanipulatie, transfer learning