Clear Sky Science · nl

Het mozaïekgeheugen van grote taalmodellen

Waarom bijna‑kopieën ertoe doen

Grote taalmodellen zoals ChatGPT leren van oceanen tekst en soms memoriseren ze fragmenten daarvan. Dat roept zorgen op over privacy, auteursrecht en hoe eerlijk we kunnen beoordelen wat deze systemen werkelijk weten. Dit artikel laat zien dat memorisatie niet alleen gaat om exact kopiëren en plakken. In plaats daarvan kunnen taalmodellen passages reconstrueren uit vele licht verschillende versies, vergelijkbaar met het samenstellen van een mozaïek. Het doorgronden van dit verborgen soort geheugen is cruciaal voor iedereen die geeft om veilige en betrouwbare AI.

Een nieuwe manier om aan machinaal geheugen te denken

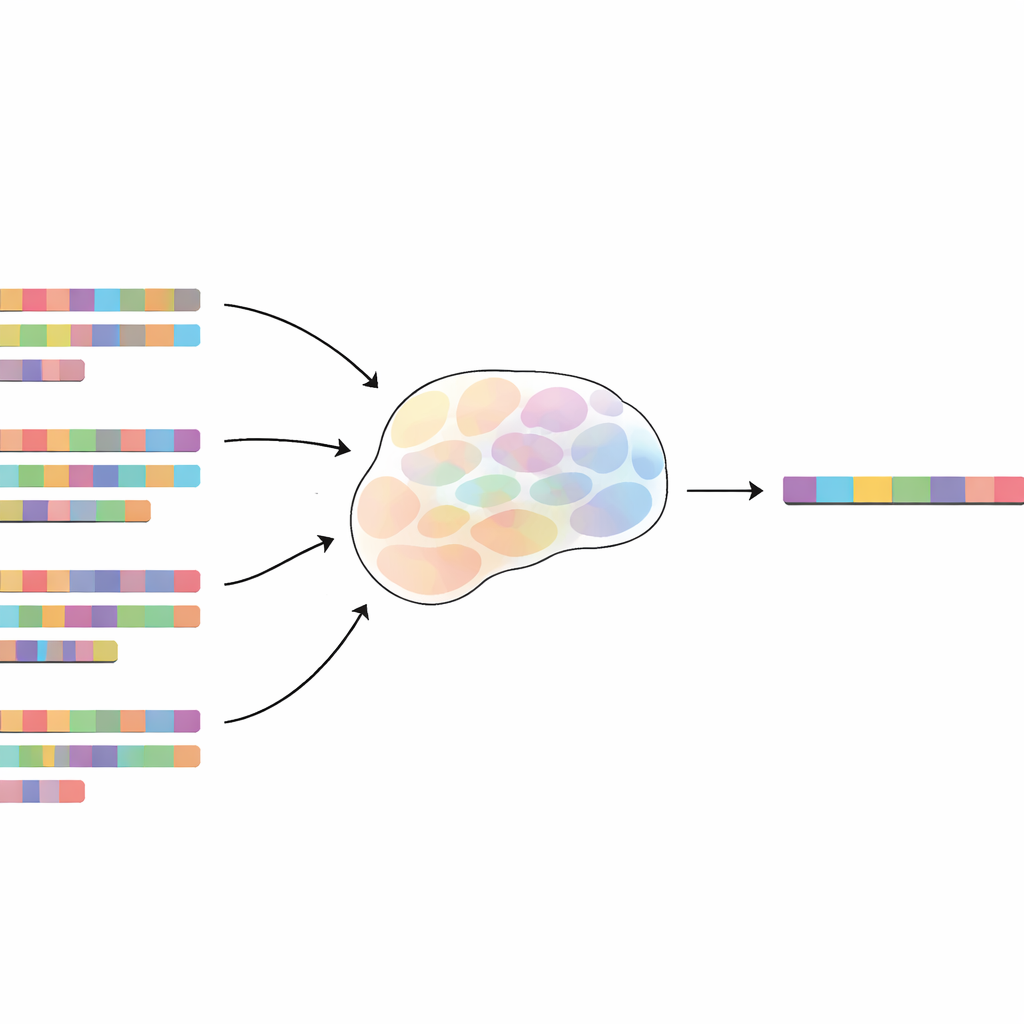

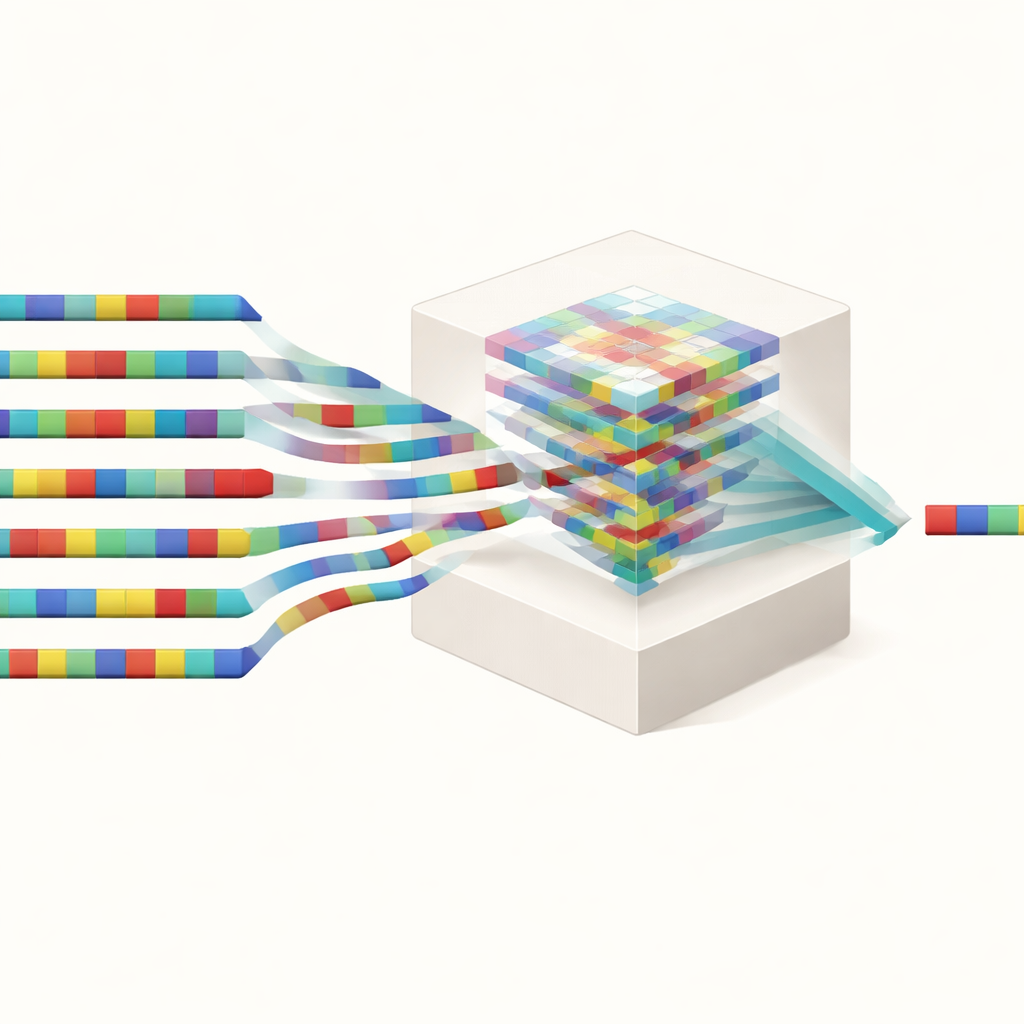

De meeste mensen gaan ervan uit dat een taalmodel iets alleen memoriseert als het exact dezelfde zin steeds opnieuw ziet. De auteurs dagen dit beeld uit door “mozaïekgeheugen” te introduceren. In dit perspectief kan een model een passage van 100 woorden memoriseren niet alleen door exacte herhalingen, maar ook door vele vage duplicaten—versies waarin sommige woorden ontbreken, veranderd of herschikt zijn. Om dit nauwkeurig te bestuderen planten ze kunstmatige testzinnen, canaries genoemd, in de trainingsdata van een model, samen met veel gewijzigde versies. Na training meten ze hoe gemakkelijk het is om te bepalen of een gegeven canary in de trainingsset stond, met behulp van een soort privacyschaaltest die bekendstaat als een membership inference attack.

Hoe vage kopieën toch een duidelijke spoor achterlaten

Door vage duplicaten te vergelijken met exacte herhalingen definiëren de onderzoekers een “exact duplicate equivalent”: hoeveel één vage kopie bijdraagt aan memorisatie vergeleken met een perfecte kopie. Ze vinden dat zelfs zeer milde wijzigingen de memorisatie nauwelijks verzwakken. Als ongeveer 10% van de woorden in elke duplicaat willekeurig wordt vervangen, levert een enkele vage kopie nog steeds ruwweg 60–65% op van wat een exacte duplicaat bijdraagt. Zelfs wanneer de helft van de woorden is gewijzigd, telt elke gewijzigde versie nog steeds voor ongeveer 15–20% van een volledige kopie. Het effect is robuust: het toevoegen van willekeurige vulwoorden tussen sleutelzinnen of het herschikken van zinsdelen vermindert memorisatie, maar maakt het niet ongedaan. Het model lijkt in staat om ruis over te slaan, zich te concentreren op overlappende fragmenten en die weer aan elkaar te lijmen.

Vorm boven betekenis in wat modellen opslaan

Aangezien moderne taalmodellen wiskundeproblemen kunnen oplossen, instructies volgen en vertalen tussen talen, zou je kunnen verwachten dat hun herinneringen over betekenis gaan. Verrassend genoeg vindt de studie het tegenovergestelde. Wanneer de auteurs woorden vervangen door alternatieven die de betekenis van de zin behouden, verbetert memorisatie slechts marginaal vergeleken met vervanging door willekeurige woorden. Parafraseringen gegenereerd door andere AI‑systemen—die hetzelfde idee behouden maar veel oppervlakkige details veranderen—dragen relatief weinig bij aan memorisatie tenzij ze nog steeds veel korte woordreeksen delen met de originele passage. Over een reeks tests is wat geheugen echt aandrijft overlap in exacte tokens (de basiseenheden van het model), niet gedeelde ideeën. Met andere woorden: het mozaïekgeheugen van het model gaat vooral over vorm, niet betekenis.

Verborgen duplicaten in trainingsdata uit de echte wereld

De auteurs vragen vervolgens hoe vaak vage duplicaten voorkomen in een populair, sterk opgeschoond webdataset dat wordt gebruikt om taalmodellen te trainen, bekend als SlimPajama. Hoewel dit dataset al bijna‑identieke documenten had verwijderd, vindt het team dat veel 100‑tokenreeksen die exact 1.000 keer voorkomen, ook duizenden bijna‑miss versies hebben. Voor kleine bewerkingsafstanden—ongeveer 10% van de tekens gewijzigd—zijn er gemiddeld ongeveer 4 keer zoveel vage duplicaten als exacte, en tienduizenden meer bij grotere maar nog steeds invloedrijke afstanden. Belangrijk is dat standaard deduplicatietechnieken in de industrie, die typisch alleen lange exacte overlappen verwijderen, het grootste deel van deze vage kopieën ongemoeid laten. Dat betekent dat modellen nog steeds gevoelige of auteursrechtelijk beschermde inhoud kunnen memoriseren door die uit vele licht gewijzigde bronnen samen te stellen.

Waarom dit ertoe doet voor privacy, eerlijkheid en controle

Deze bevindingen hebben verstrekkende implicaties. Voor privacy tonen ze aan dat het simpelweg verwijderen van exacte herhalingen uit trainingsdata niet genoeg is: persoonlijke of vertrouwelijke informatie kan worden gememoriseerd via families van vergelijkbare passages. Voor auteursrecht en benchmarking kunnen vage duplicaten ertoe leiden dat modellen beschermde tekst reproduceren of kunstmatig scores op tests opkrikken die ze in vermomde vorm effectief hebben gezien. Voor pogingen om specifieke data te “verleren” is het niet voldoende om één voorbeeld te verwijderen als veel varianten blijven bestaan. Over het geheel genomen onthult dit werk dat het geheugen van taalmodellen een complex mozaïek is opgebouwd uit vele kleine overlappen, wat de huidige veiligheidsmiddelen uitdaagt en vraagt om slimmere, fijnmazigere manieren om trainingsdata op te schonen en te auditen.

Bronvermelding: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

Trefwoorden: memorisatie van taalmodellen, vage duplicaten, gegevensprivacy, deduplicatie van trainingsdata, benchmarkvervuiling