Clear Sky Science · nl

Model‑agnostisch lineair‑geheugen online leren in spikende neurale netwerken

Waarom het trainen van hersenachtige computers zo moeilijk is

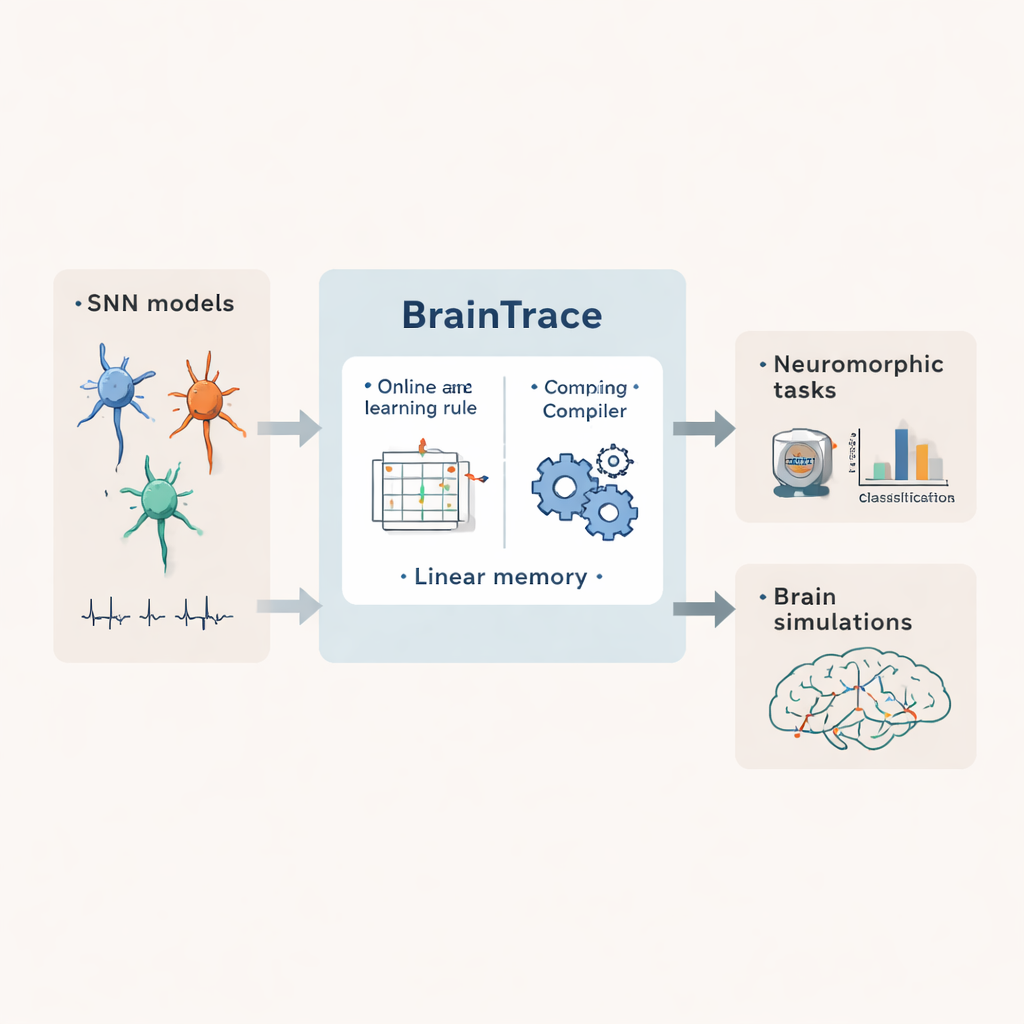

Spikende neurale netwerken zijn een klasse kunstmatige netwerken die communiceren met korte elektrische pulsen, vergelijkbaar met echte hersencellen. Ze beloven uiterst efficiënte, door de hersenen geïnspireerde rekenkracht en realistischer simulaties van neurale circuits. Maar deze netwerken trainen om complexe taken uit te voeren, vooral over lange tijdsintervallen, vereist doorgaans enorme hoeveelheden computergeheugen en handmatig geschreven code. Dit artikel introduceert BrainTrace, een systeem dat trainen van spikende netwerken zowel praktisch als breed toepasbaar wil maken.

Netwerken leren die in realtime werken

De meest krachtige trainingsmethoden voor hersenachtige netwerken werken door een hele activiteitsreeks opnieuw af te spelen en foutsignalen terug te sturen over elke tijdstap. Deze aanpak, bekend als backpropagation through time, kan zeer nauwkeurig zijn maar loopt snel vast wanneer reeksen lang zijn of netwerken groot: elke tussenliggende toestand moet worden opgeslagen, wat leidt tot geheugengroei die schaalt met zowel tijd als netwerkgrootte. Alternatieve “online” methoden werken door verbindingen stap voor stap bij te werken terwijl gegevens binnenkomen, wat de opslagbehoefte sterk vermindert. Bestaande online regels werken echter vaak alleen voor sterk vereenvoudigde neuronenmodellen of vereisen nog steeds geheugen dat kwadratisch met netwerkgrootte toeneemt, waardoor ze moeilijk toepasbaar zijn op realistische hersenschaalsystemen.

Een algemene methode voor veel soorten spikende netwerken

BrainTrace pakt dit aan door spikende netwerken eerst op een eenduidige manier te beschrijven. De auteurs tonen aan dat veel typen neuronen en synapsen kunnen worden uitgedrukt als twee elkaar beïnvloedende delen: interne dynamica die beschrijven hoe de toestand van elk neuron in de tijd verandert, en interactiedynamica die binnenkomende spikes omzetten in stromen tussen cellen. Ze introduceren bovendien twee modelleerperspectieven, AlignPre en AlignPost, die synapsen organiseren rond respectievelijk het zendende neuron of het ontvangende neuron. Deze abstractie maakt het mogelijk een grote verscheidenheid aan biologische en ontworpen modellen met dezelfde wiskundige gereedschappen te behandelen, van eenvoudige lekneuronen tot rijkere cellen met adaptieve drempels en complexe synapsen.

Geheugenzuinige manier om oorzaak en gevolg te volgen

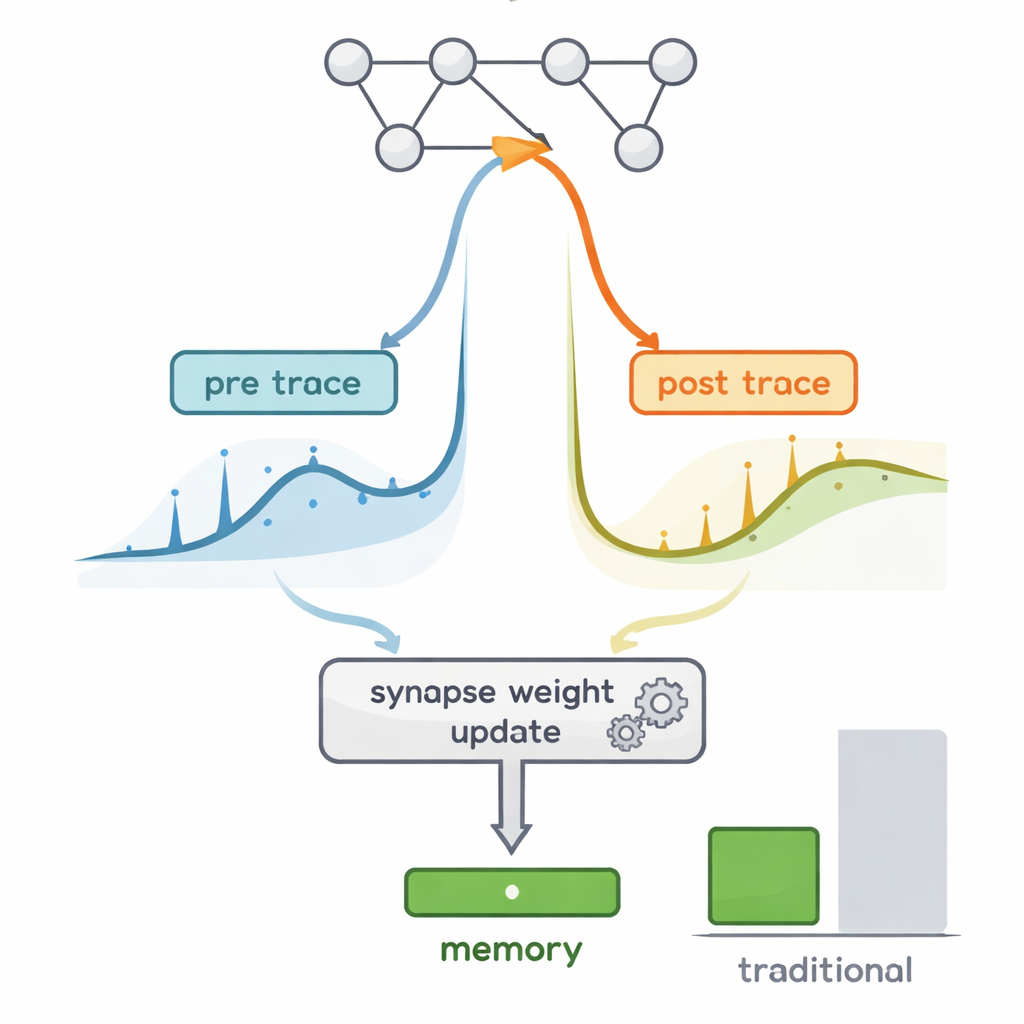

De kernuitdaging in online leren is bijhouden hoe kleine veranderingen in elke verbinding uiteindelijk het gedrag van het netwerk zouden beïnvloeden, een grootheid die vastgelegd wordt door zogenaamde "eligibility traces" (geschiktheidssporen). In principe vereist het behouden van volledige eligibility‑informatie het bijhouden van enorme matrices die schalen met de derde macht van het aantal neuronen. BrainTrace benut drie belangrijke eigenschappen van spikende netwerken: de meeste neuronen zijn het grootste deel van de tijd stil; de lek en reset van elk neuron domineren hoe zijn toestand verandert; en spikes en synaptische conductanties zijn altijd positief. Met deze feiten laten de auteurs zien dat de zware eligibility‑matrices nauwkeurig kunnen worden benaderd door het product van slechts twee compacte sporen per synaps, één die presynaptische activiteit samenvat en één die postsynaptische activiteit samenvat. Deze pre‑post propagatieregel, pp‑prop genoemd, gebruikt geheugen dat slechts lineair met de netwerkgrootte toeneemt, en levert toch gradiënten op die goed overeenkomen met die van volledige backpropagation.

Automatische hulpmiddelen die de wiskunde verbergen

Buiten de leerregel zelf levert BrainTrace een compiler die een rol speelt vergelijkbaar met automatische differentiatiebibliotheken in deep learning. Een gebruiker schrijft de dynamica van zijn spikende model in een hoog‑niveau taal. De BrainTrace‑compiler analyseert vervolgens hoe toestanden en parameters verbonden zijn, bouwt de benodigde eligibility‑sporen op en genereert geoptimaliseerde code die pp‑prop of een gerelateerd algoritme efficiënt uitvoert op CPU's, GPU's of gespecialiseerde versnellers. Dit betekent dat modelleurs zich kunnen richten op wetenschappelijke vragen in plaats van fragiele gradiëntcode met de hand te schrijven, terwijl ze toch profiteren van online, geheugen‑efficiënt leren.

Van kleine sensoren tot een volledig vliegenbrein

De auteurs testen BrainTrace op standaard neuromorfe benchmarks, waarbij spikende netwerken gebeurtenisgebaseerde versies van beelden, geluiden en gebaren classificeren. Over meerdere datasets en architecturen behaalt pp‑prop dezelfde nauwkeurigheid als volledige backpropagation, terwijl het orders‑of‑magnitude minder geheugen gebruikt en sneller draait dan andere online methoden. Cruciaal is dat het systeem ook opschaalt naar veeleisende neurowetenschappelijke problemen. In één voorbeeld leert een biologisch gedetailleerd spikend netwerk met aparte exciterende en inhibitorische populaties een bewijs‑accumulatie besluitvormingstaak en ontwikkelt activiteitspatronen die lijken op die gemeten in de muiscortex. In een ander voorbeeld wordt een spikend model met meer dan 125.000 neuronen, verbonden volgens het connectoom van de fruitvlieg, getraind om rusttoestandactiviteit over het hele vliegbrein te reproduceren — een prestatie die de geheugencapaciteit van conventionele training op een enkele grafische kaart overstijgt.

Wat dit betekent voor toekomstig hersenachtig rekenen

Voor niet‑experts is de belangrijkste boodschap dat BrainTrace een eerder onpraktische droom — het trainen van rijke, hersenschaal spikende netwerken in realtime — omvormt tot een realistische mogelijkheid. Door een slimme manier te vinden om oorzaak en gevolg bij te houden met slechts een kleine hoeveelheid geheugen, en dit te verpakken in geautomatiseerde hulpmiddelen, brengt dit werk door de hersenen geïnspireerd rekenen dichter bij dagelijks gebruik in zowel kunstmatige intelligentie als fundamentele neurowetenschap. Het suggereert een pad naar machines die leren en zich aanpassen met de efficiëntie en temporele precisie van echte zenuwstelsels, zonder te vereisen dat er supercomputer‑niveau middelen beschikbaar zijn.

Bronvermelding: Wang, C., Dong, X., Ji, Z. et al. Model-agnostic linear-memory online learning in spiking neural networks. Nat Commun 17, 1745 (2026). https://doi.org/10.1038/s41467-026-68453-w

Trefwoorden: spikende neurale netwerken, online leren, neuromorfe computing, hersensimulatie, gradiëntgebaseerde training