Clear Sky Science · nl

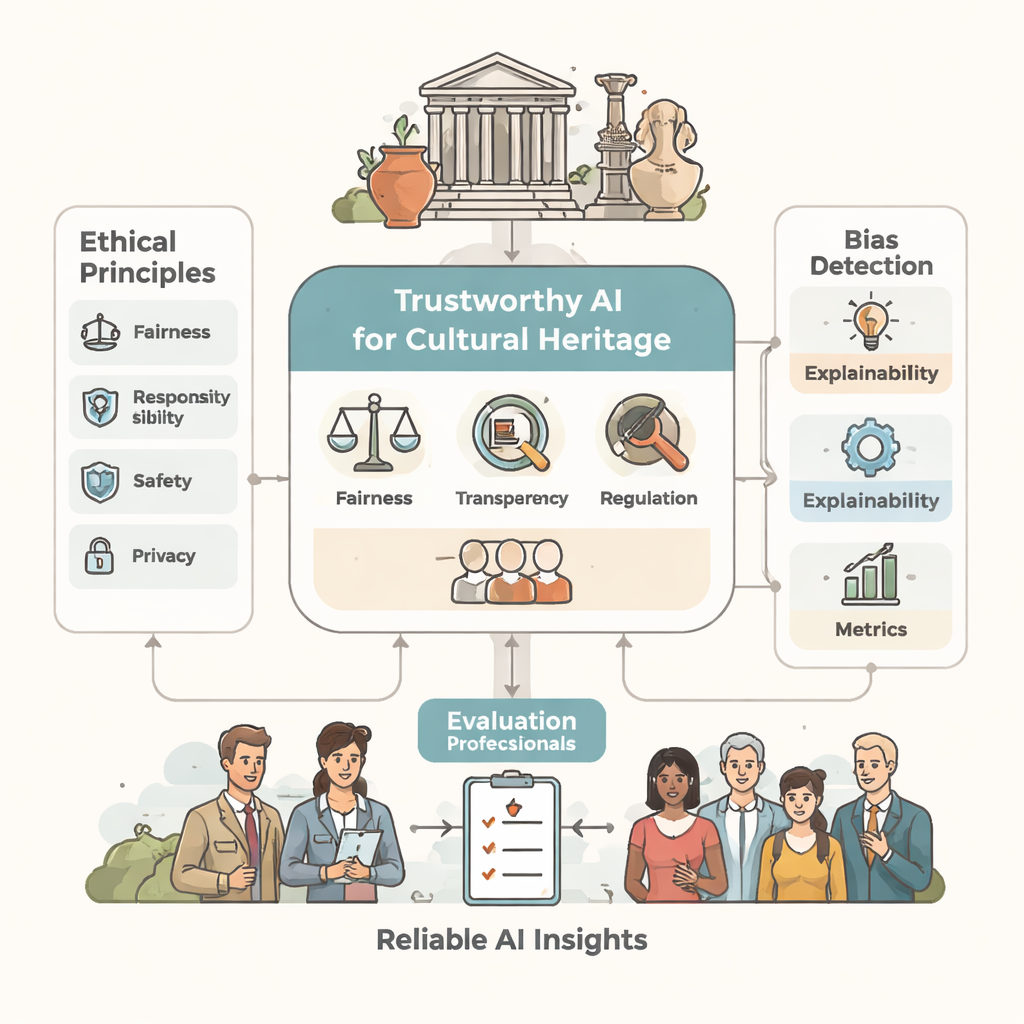

Op weg naar betrouwbare AI in het cultureel erfgoed

Waarom slimere hulpmiddelen belangrijk zijn voor ons verleden

Van vervallen tempels tot kwetsbare perkamenten: de hedendaagse erfgoedprofessionals vertrouwen op digitale hulpmiddelen om de sporen van menselijke geschiedenis te begrijpen en te beschermen. Kunstmatige intelligentie (AI) kan enorme hoeveelheden afbeeldingen, scans en archieven veel sneller doorzoeken dan een mens, maar ze kan ook de verhalen die deze objecten vertellen verkeerd lezen of vervormen. Dit artikel onderzoekt hoe we AI niet alleen krachtig, maar ook eerlijk, transparant en betrouwbaar kunnen maken wanneer ze wordt gebruikt om cultureel erfgoed te bestuderen en te behouden.

Nieuwe helpers voor oude schatten

Musea, archeologen en conservatoren zetten AI in om foto’s te classificeren, schade aan gebouwen in kaart te brengen en verloren details van gebroken objecten te reconstrueren. Technieken die oorspronkelijk zijn ontwikkeld voor zelfrijdende auto’s of online winkelen helpen nu bij het interpreteren van oude mozaïeken, sculpturen en historische straten. Toch zijn gegevens over cultureel erfgoed buitengewoon rommelig en ongelijk verdeeld: sommige regio’s en tijdperken zijn rijkelijk gedocumenteerd, terwijl andere slechts sporadisch opduiken in archieven. Als AI vooral leert van bekende monumenten en westerse collecties, kan ze het erfgoed van minderheidsgroepen of minder gevierde plaatsen negeren of verkeerd interpreteren. Het artikel betoogt dat fouten op dit terrein, omdat cultureel erfgoed identiteiten en herinneringen vormt, niet louter technische fouten zijn maar ook ethische problemen.

Waar algoritmen de mist in kunnen gaan

De auteurs schetsen de vele manieren waarop vooringenomenheid in AI voor erfgoed kan sluipen. Sommige vooroordelen ontstaan door leemten in de gegevens: bijvoorbeeld beschadigde mozaïeken waarbij ontbrekende tegels patroonherkenning verwarren, of historische documenten die hele gemeenschappen weg laten. Andere vooroordelen komen voort uit wie er wordt weergegeven: populaire datasets bevatten vaak munten, iconen en gebouwen uit Europa, waardoor niet‑westerse objecten ondervertegenwoordigd zijn. Zelfs wanneer materiaal beschikbaar is, kunnen labels tussen experts verschillen, en foto’s op sociale media van beroemde locaties weerspiegelen vaak toeristische kiekjes in plaats van lokale gezichtspunten. Het artikel groepeert deze problemen in categorieën zoals ontbrekende data, ondervertegenwoordiging van minderheden, contextuele verschillen tussen regio’s en verouderde opvattingen vastgelegd in oude scans of archieven. Voor elk type worden praktische tegenmaatregelen voorgesteld, van het uitbreiden van collecties met minderheidsnarratieven tot het routinematig bijwerken van digitale modellen naarmate locaties veranderen.

Machinebeslissingen begrijpelijk maken

Vertrouwen, stellen de auteurs, hangt niet alleen af van betere data maar ook van helderder uitleg. Veel moderne AI‑systemen functioneren als “black boxes”: ze labelen een boog als gotisch of een muur als beschadigd zonder uit te leggen waarom. Het artikel stelt een gelaagde benadering van verklaarbaarheid voor. Eén laag kijkt naar de interne werking van het model, een andere naar hoe lokale geschiedenis en context de beslissingen beïnvloeden, en weer andere richten zich op wat het resultaat in de praktijk betekent en hoe zeker het systeem is. Uitleg kan globaal zijn, waarbij wordt beschreven hoe het systeem zich in het algemeen gedraagt, of lokaal, gericht op één specifieke voorspelling over een bepaald gebouw of artefact. Om te beoordelen of deze verklaringen echt helpen, definiëren de auteurs eenvoudige, mensgerichte maatstaven zoals gebruikerstevredenheid, nieuwsgierigheid, vertrouwen en het effect op de kwaliteit van beslissingen.

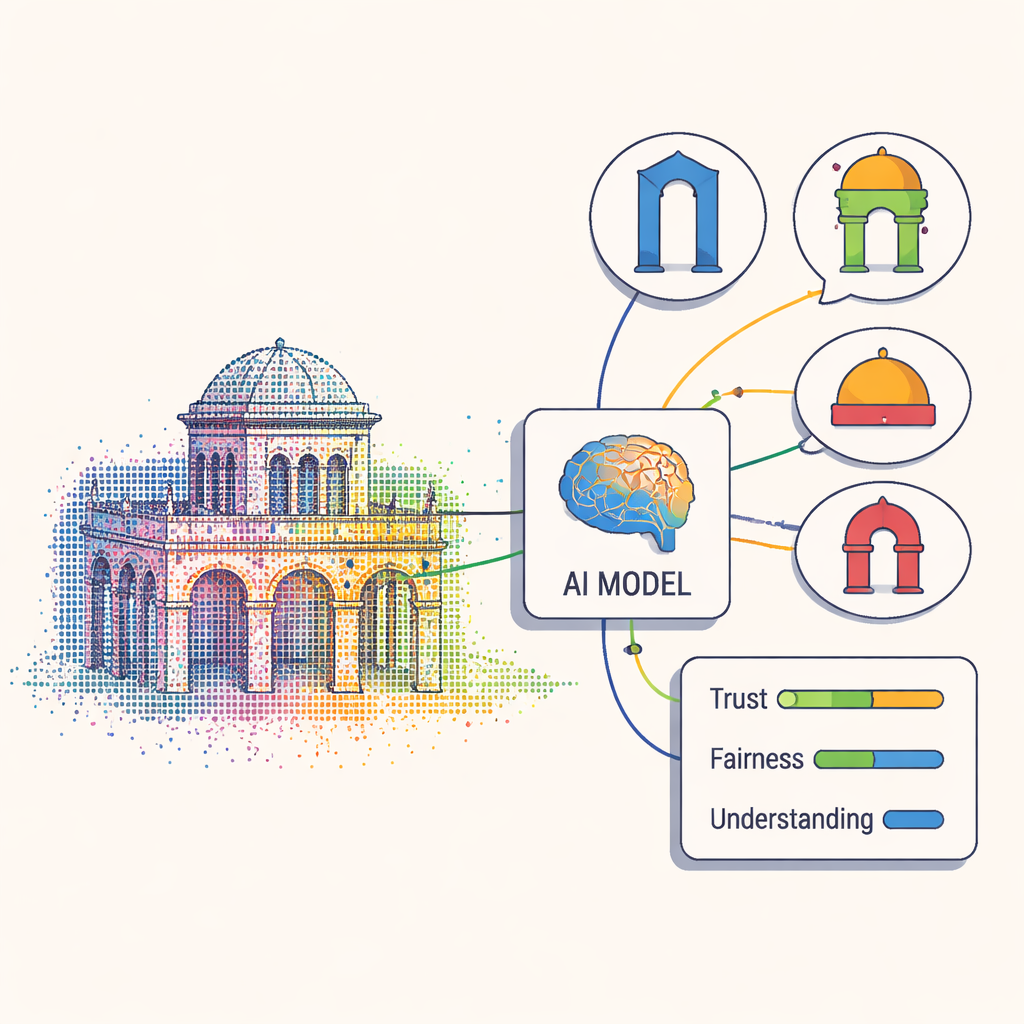

Het kader testen op echte erfgoeddata

Om te zien hoe hun ideeën in de praktijk werken, bekijken de onderzoekers een eerder AI‑systeem dat dichte 3D‑puntenwolken van historische gebouwen analyseert. Dat systeem is zeer goed in het automatisch toewijzen van elk cluster punten aan architectonische elementen zoals bogen, ramen of zuilen, maar het was niet ontworpen met eerlijkheid of transparantie in gedachten. Bij evaluatie met de nieuwe ethische maatstaven ontdekten experts dat ze de manier waarop het systeem tot zijn conclusies kwam slechts deels begrepen, en dat het systeem weinig deed om alternatieve interpretaties uit te leggen. De auteurs stellen voor nieuwere modellen te gebruiken die verklaring in hun ontwerp inbouwen. Deze modellen vergelijken delen van een gebouw met aangeleerde “prototype”vormen en benadrukken welke voorbeelden een bepaalde labelkeuze hebben gestuurd, zodat erfgoedspecialisten de redenering kunnen zien en bediscussiëren in plaats van een ondoorzichtig antwoord klakkeloos te accepteren.

Toekomstbestendige hoeders van cultuur bouwen

Kort gezegd betoogt dit artikel dat AI het menselijke beoordelingsvermogen bij erfgoedwerk moet ondersteunen en niet stilzwijgend mag vervangen. Door systematisch naar bias te zoeken en te eisen dat systemen hun keuzes uitleggen in taal en beeldspraak die experts begrijpen, streeft het voorgestelde kader ernaar AI in lijn te houden met waarden als inclusie, nauwkeurigheid en respect voor culturele diversiteit. De auteurs suggereren dat vergelijkbare ethiekbewuste ontwerpen ook gevoelige domeinen zoals gezondheid, onderwijs en milieu ten goede zouden kunnen komen. Voor cultureel erfgoed is de boodschap duidelijk: alleen AI die transparant, eerlijk en bevraagd kan worden, is te vertrouwen om de verhalen van ons gedeelde verleden te helpen vertellen.

Bronvermelding: Paolanti, M., Frontoni, E. & Pierdicca, R. Towards trustworthy AI in cultural heritage. npj Herit. Sci. 14, 131 (2026). https://doi.org/10.1038/s40494-026-02403-z

Trefwoorden: cultureel erfgoed, betrouwbare AI, algoritmische vooringenomenheid, verklaarbare AI, erfgoedconservatie