Clear Sky Science · ja

検索付強化生成を用いた構造化動的プロンプトで大規模言語モデルの少ショット固有表現認識を改善する

なぜ医療テキストをより賢く読むことが重要か

現代医療は集中治療の記録から薬物使用に関するオンラインの会話まで、膨大なテキストを生み出します。そこに隠れた言葉は、疾患、治療、そして副作用についての重要な手がかりを含んでいます。こうした情報の断片を自動的に見つけてラベル付けする作業、すなわち「固有表現認識」は、アウトブレイクの追跡、薬剤問題の早期発見、医師へのリアルタイム支援に役立ちます。しかし従来のシステムは大規模な手作業でラベル付けされたデータセットを必要とし、それらは構築にコストがかかり、希少疾患や新たな健康課題では欠落しがちです。本研究は、今日のチャットボットの背後にあるような大規模言語モデルを、精巧に設計したプロンプトと事例の賢い検索で誘導することにより、注釈付きサンプルが少数しかない状況でもこのラベル付け作業を高精度で行えるかを探ります。

重要な語を見つけるよう機械に教える

著者らは医療分野の固有表現認識に焦点を当て、テキスト中の疾患、薬剤、症状、社会的影響の言及を見つけることを目指します。これは医療用語が高度に専門的で施設やサブ分野ごとに変わり、データセットにほとんど出現しない希少な状況が多いため困難です。既存の機械学習モデルは人間に匹敵する性能を出し得ますが、通常は作成や共有に高コストがかかる大規模で精度の高い注釈付きコーパスを必要とします。少ショット学習は、わずかなラベル付き例から学ぶことでこのボトルネックを回避する道を提供します。大規模言語モデルは、内部の重みを再学習することなく、プロンプト中の指示や例から直接パターンを学べるため、特に有望です。

言語モデルのためのより良い指示設計

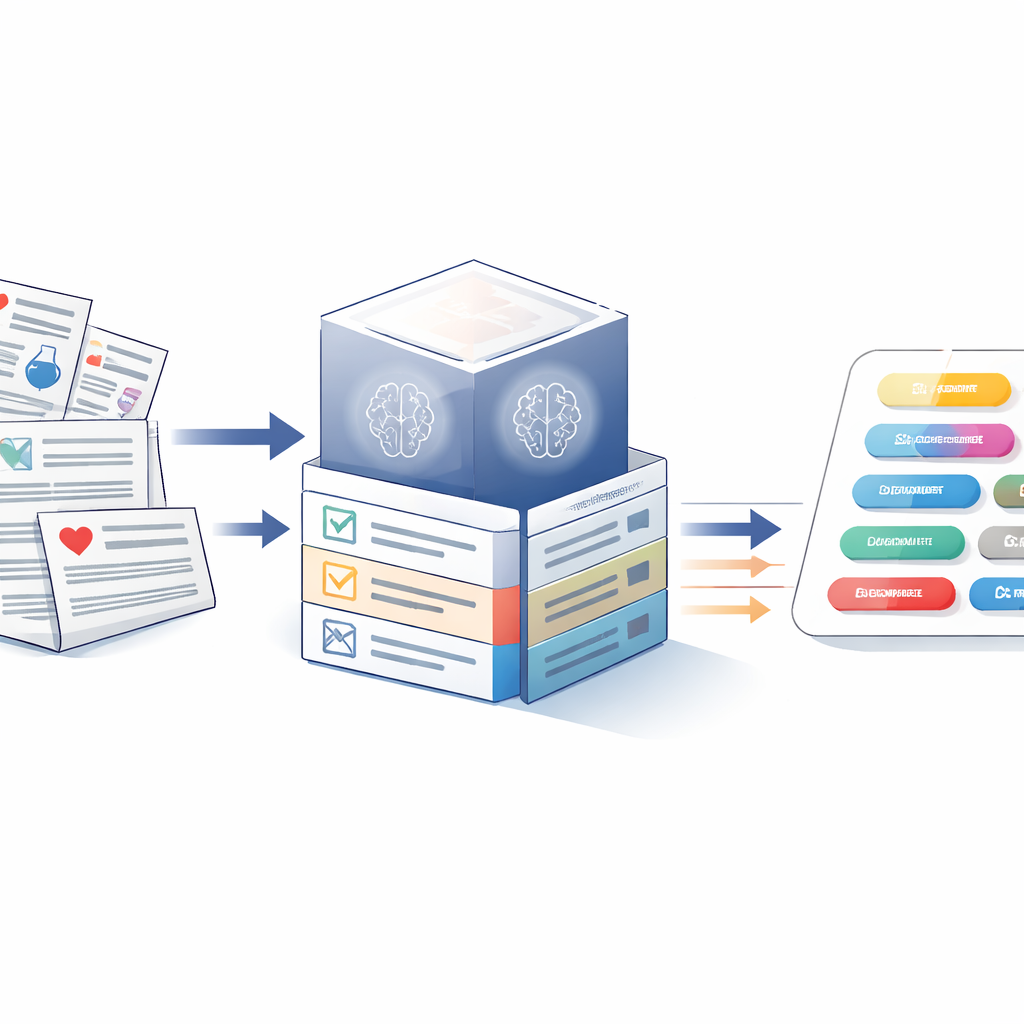

研究の第一部では、高度に構造化された「静的」プロンプトを設計します。これは、各文をラベル付けする際にモデルへ繰り返し与える再利用可能な指示と例のブロックです。単にモデルにタグ付けを指示する代わりに、プロンプトは6つの要素に分けられます:明確なタスク説明とエンティティ定義、データセットの出所とテーマの簡潔な説明、各エンティティに典型的な高頻度語、任意の医学的背景知識、以前のモデル誤りからまとめたフィードバック、そして数件の完全注釈付き例文。チームはこのフレームワークをGPT-3.5、GPT-4、LLaMA 3-70Bの3つの大規模言語モデルで、臨床記録、学術抄録、オピオイド使用に関するReddit投稿を含む5つの生物医学データセットに対してテストしました。これらの要素を慎重に重ねることで、基本的なプロンプトに比べF1スコア(精度と再現率の均衡)が約11~12ポイント向上し、GPT-4が最良の総合性能を示しました。

モデルが適切な例をその場で参照できるようにする

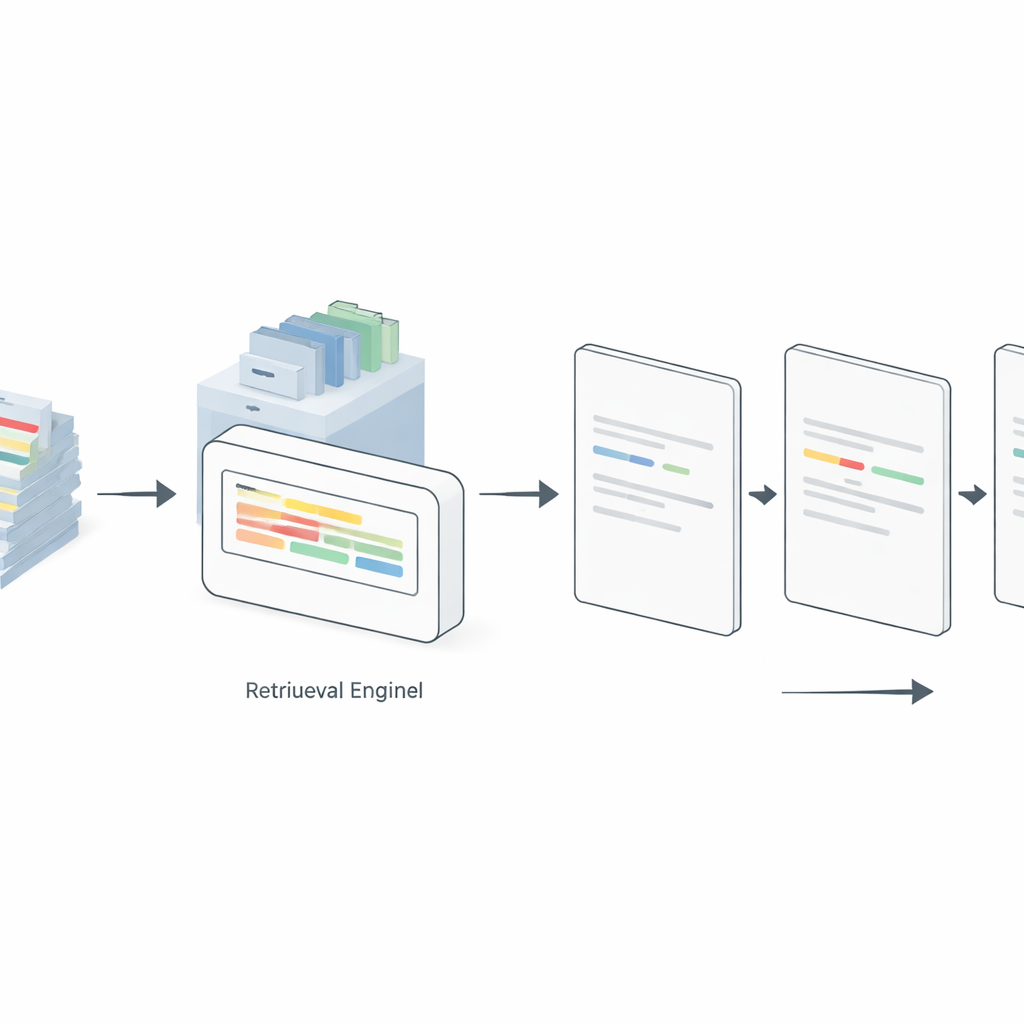

しかし静的プロンプトは常に同じ例を示すため、新しい文に適合しない場合があります。これに対処するため、著者らは検索付強化生成を用いた「動的」プロンプト戦略を導入します。ここでは別個の検索エンジンが利用可能な注釈付き例を全てインデックス化します。新しい入力文ごとに、このプールから最も類似したラベル付き文を検索してプロンプトに挿入します。研究は、単純な語頻度ベースの手法(TF–IDF)から、Sentence-BERT(SBERT)、ColBERT、Dense Passage Retrievalのようなニューラル埋め込みモデルまで、いくつかの検索手法を比較しています。GPT-4、LLaMA 3、オープンウェイトのGPT-OSS-120Bで、動的に関連例を選択する方法は、5、10、20ショットの設定で一貫して静的プロンプトを上回りました。驚くべきことに、単純なTF–IDF手法は、特により整然としたデータセットでは複雑な手法に匹敵するか勝ることが多く、一方でSBERTは雑多なソーシャルメディアのテキストで優れた性能を示しました。

少ない注釈例からより多くを引き出す

医療テキストの注釈は高コストなため、著者らは検索エンジンが有用になるためにどれだけの注釈例をインデックス化する必要があるかも検討しました。LLaMA 3-70Bを用いて、検索プールの大きさを50例からトレーニングセット全体まで変化させました。一般にプールが大きくなるほど性能は向上しましたが、利得は急速に平坦化しました:約100〜200例のプールで全データをインデックスした場合とほぼ同等の精度が得られ、統計的誤差範囲内で達成されることが多かったのです。場合によっては非常に大きなプールがわずかに性能を悪化させることもあり、これは無関係または混乱を招く例が増え、プロンプトが長くなるためと考えられます。これらの発見は、強力な言語モデルとよく設計されたプロンプトを組み合わせれば、控えめな注釈努力でも堅牢な生物医学的固有表現認識が達成できることを示しており、希少疾患、新しい臨床概念、資源の限られた施設でも実用的であることを示唆します。

現場の医療にとっての意義

総じて、本研究は、大規模言語モデルが構造化されたプロンプトと最も関連性の高い過去事例を提示する検索システムに導かれることで、わずかな注釈例だけで重要な医療概念を信頼性高く抽出できることを示しています。GPT-4は最も強い汎用性能を示しましたが、オープンで小規模なモデルも同じプロンプトと検索の手法から大きな恩恵を受けました。現場の実務家にとっては、新たなエンティティタイプや健康問題が出現するたびに巨大なデータセットを構築する必要はなく、厳選されたコンパクトな事例集と賢いプロンプトで十分である可能性があることを意味します。医療記録のデジタル化が進み、患者がオンラインで体験を語るにつれて、このような効率的で適応性のあるツールは、膨大で雑多な医療テキストから臨床的に役立つ知見を引き出すことを大幅に容易にするでしょう。

引用: Ge, Y., Guo, Y., Das, S. et al. Improving few-shot named entity recognition for large language models using structured dynamic prompting with retrieval augmented generation. npj Artif. Intell. 2, 39 (2026). https://doi.org/10.1038/s44387-025-00062-2

キーワード: 医療分野の固有表現認識, 少ショット学習, 大規模言語モデル, 検索付強化生成, 臨床テキストマイニング