Clear Sky Science · ja

大型言語モデルにおける推定的不確実性の評価

リスクをあいまいに表す言葉が本当に重要な理由

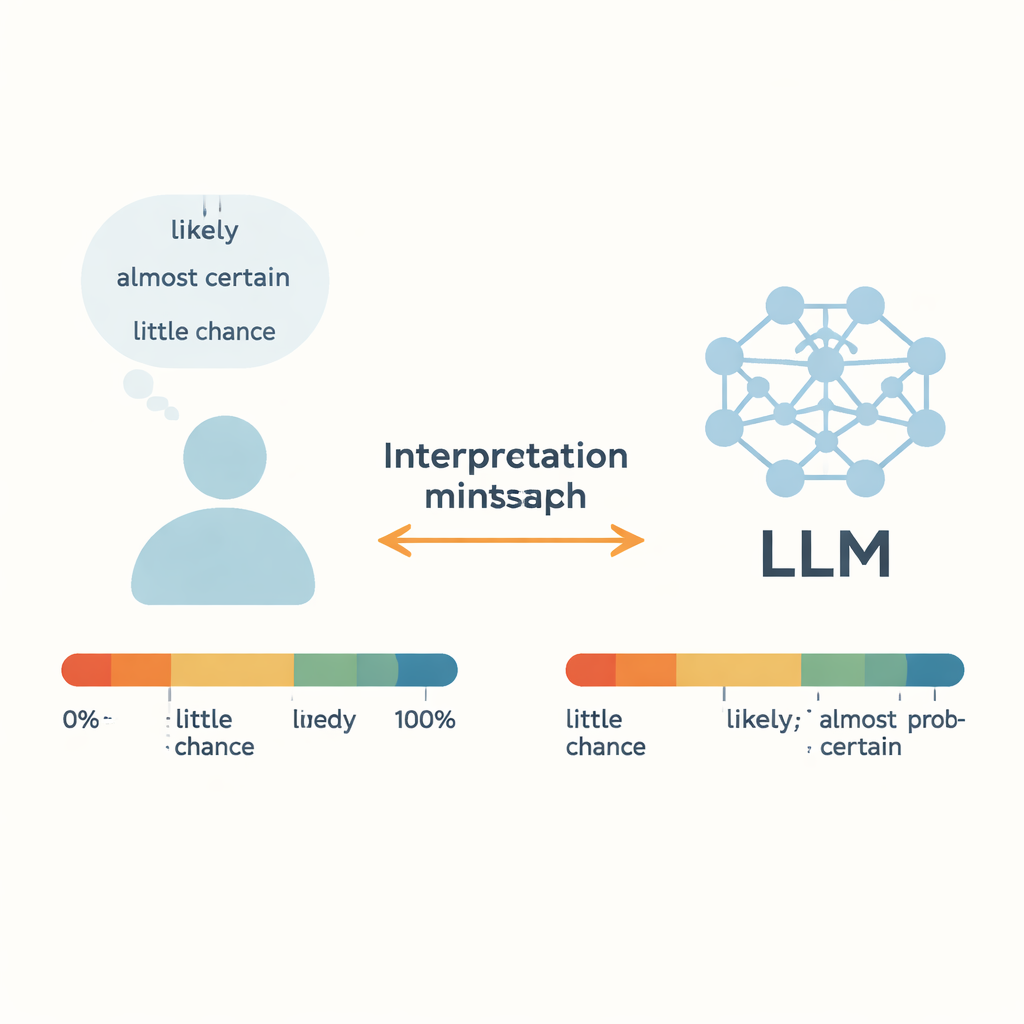

医師が治療は「おそらく」効くと言ったり、気象予報士がハリケーンの「可能性は低い」と警告したりするとき、私たちはこうしたあいまいな言葉に頼って現実の判断を下します。今日、オンラインのチャットボットなど大型言語モデル(LLM)も同じ語彙を使い始めています。本研究は単純だが重要な問いを立てます:AIが「たぶん」と言ったとき、それは私たちの意味するところと同じなのか——そして生の数値を日常的な不確実性の言葉に確実に変換できるのか?

日常の不確実性を顕微鏡にかける

著者らは「推定確率の語」(Words of Estimative Probability:WEP)に着目しています。「ほとんど確実」「ありそうだ」「可能性は低い」など、人々が正確なパーセンテージの代わりに使う用語です。1960年代の情報分析官による先行研究では、これらの語を数値確率に結びつけるために人々に尋ねる調査が行われました。本研究では、そのような人間の判断をGPT-3.5、GPT-4、MetaのLlama群、中国語系システムのERNIE-4.0を含む5つの最新LLMの出力と比較しています。17種類の一般的な不確実性の語について、各モデルに英語または中国語の短い物語風プロンプトを与え、0〜100パーセントの数値確率で答えるよう求めました。多くの文脈でこれを繰り返すことで、各語と各モデルに対する確率分布を構築し、それを人間の調査データと比較しました。

人間とAIが同じ言語を話す領域

最も極端な表現、たとえば高い側の「ほとんど確実」や低い側の「ほとんど可能性がない」といった言葉については、LLMと人間の対応が驚くほど一致します。人間もモデルも、これらの語を狭い高確率または低確率の範囲に集める傾向があり、強い表現は文脈を超えて比較的安定した意味を持つことを示唆しています。同様に「ほぼ五分五分(about even)」についても、多くの人間とモデルは概ね50%前後と扱います。統計的検定ではこれらの語に関して人間とモデルの分布に有意な差はほとんど見られず、LLMはほぼ確実やほぼ不可能といった明瞭なケースを人間並みの精度で捉えられることを示しています。

意味が静かにずれる領域

あいまいで中間的な語は別の物語を語ります。「likely(ありそうだ)」「probable(高い確率で起こる)」「we doubt(我々は疑う)」「little chance(可能性は小さい)」のような表現では、モデルの数値的解釈が人間の判断と有意に異なることがありました。総じてより高機能なGPT-4でさえ、しばしば大きな隔たりを示すことがあります。著者らは、これらの語には確率感と話者の態度・立場という二つの要素が混ざり合っている可能性を示唆します。実際の会話では「likely」は語調や文脈によって慎重な印象にも自信のある表現にも聞こえ得るし、「we doubt」は厳密な確率というより懐疑を示すこともあります。インターネット上の多様で混在するジャンルの大量テキストで訓練されたLLMは、多くの矛盾する用法を平均化してこれらの微妙な違いをぼかしてしまうかもしれません。その結果、同じ文を見ても人間とAIが同じ語に異なる数値を密かに結びつけるという不一致が生じます。

性別表現、言語、文化の反映

研究者らは性別を示す表現や言語の違いがこれらの確率語にどう影響するかも検証しました。「彼」「彼女」と性別が明示されたプロンプトを用いると、GPT-3.5やGPT-4はしばしばばらつきの小さい、より「固定化」した確率推定を出し、単一の値に収束してしまうことがありました。これはモデルが訓練データ中のステレオタイプ的なパターンを吸収している可能性を示唆します(ただし男女プロンプトの平均値自体は概ね似ていました)。英語と中国語のプロンプトを比較すると、同じ不確実性語の解釈に明らかなシフトが見られました。中国語テキストを主に訓練に使ったERNIE-4.0は多くの語で中国語話者の人間に近かったものの、いくつかの表現では過大または過小評価する傾向が残っていました。これらの結果は、AIが不確実性について語る際には語そのものだけでなく、言語や訓練に含まれる文化的パターンが影響することを示しています。

AIは数値を日常語の疑念に変換できるか?

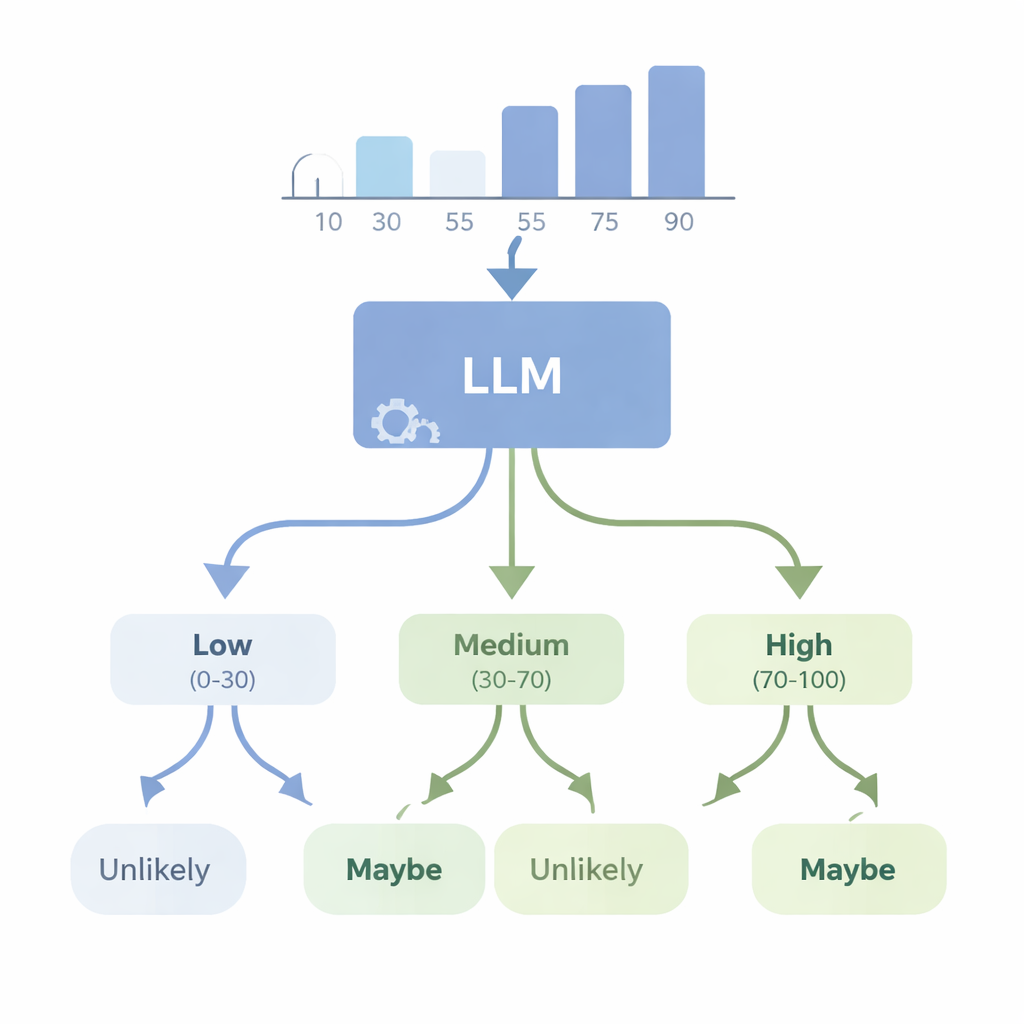

第2の実験群では逆問題を検討しました:GPT-4のような高度なモデルは数値データから適切な不確実性語を選べるか?研究者らは身長やテストの点数のリストなど単純なデータセットをモデルに与え、将来の結果に関する記述に対して最適なWEP(例:「ほとんど確実に」「ありそうだ」「たぶん」「起こりにくい」「ほとんど起こらない」)を選ばせました。次に確率が上がる・下がるとき、補事象が描かれるとき、基礎数値が制御された方法で変わるときにモデルの語選択が論理的に整合するかを確かめる4つの「一貫性」スコアで評価しました。GPT-4はランダム推測よりかなり良く、確率の大まかな変化を追えることが多かったものの、完璧な一貫性には程遠い結果でした。あるテストでは異なる信頼度レベルでほとんど同じ応答を返すことがあり、これらの語を実際のデータに連動した細かい尺度というより広いラベルとして扱っていることを示唆しました。

現実の意思決定にとっての意味

読者へのメッセージは警戒を促すものであっても過度に恐れる必要はありません。LLMは既に私たちの確信や不可能性を示す強い表現を模倣でき、しばしばデータを合理的な「ありそうだ」「ありそうもない」といった表現にまとめることができます。しかし本研究は、多くの日常的な不確実性の語について内部の較正が人間の直感と完全に一致しておらず、数値から言葉への対応が一貫していないことを示しています。医療、政策、科学コミュニケーションのように、リスクや確信の表現のわずかな変化が影響を及ぼす分野では、モデルの「たぶん」があなたの「たぶん」と同じとは限りません。著者らは、これらのシステムを安全に使うには、不確実性の語を共通の符丁として扱い、慎重な調整・テスト・場合によっては明示的な数値の裏付けが必要であり、人間と機械が自動的に同じ意味を共有していると仮定すべきではないと主張しています。

引用: Tang, Z., Shen, K. & Kejriwal, M. An evaluation of estimative uncertainty in large language models. npj Complex 3, 8 (2026). https://doi.org/10.1038/s44260-026-00070-6

キーワード: 不確実性 言語, 大型言語モデル, 確率を表す言葉, 人間とAIのコミュニケーション, リスクの解釈