Clear Sky Science · ja

大規模言語モデルが共感的なコミュニケーションを判断する際に信頼できるとき

機械の共感があなたにとって重要な理由

人々は、ストレスや孤独、難しい決断に直面したときにチャットボットやデジタルアシスタントに頼ることが増えています。これらのシステムは思いやりがあり理解を示すように聞こえることがありますが、メッセージが本当に支援的で親切かどうかを評価できるのでしょうか。本稿は、多くのチャットボットの背後にある技術である大規模言語モデル(LLM)が、書かれた応答の「共感」をどの程度信頼して評価できるか、そしてそれがウェルネスアプリ、バーチャルセラピスト、カスタマーサービス用ボットのような日常的なツールにとって何を意味するかを探ります。

支援的な会話の研究

研究者たちは、ある人が仕事のストレス、家族間の対立、金銭的な不安、あるいは精神的な悩みなどの個人的問題を説明し、別の人がそれに対して支援的に応答しようとした200件の実際のテキスト会話を分析しました。これらの会話は4つの既存データセットからのもので、それぞれが共感を評価するための異なる質問群に紐づいています。あるものは応答者が理解を示したか、感情的な慰めを与えたかに焦点を当て、別のものは実用的な助言をしたか、話し手にもっと話すよう促したか、あるいは会話を自分中心にしてしまったかを問います。これらの枠組みを合わせると、「共感的であること」を21の具体的行動に細分化でき、それらは顧客満足度調査のように尺度で評価できます。

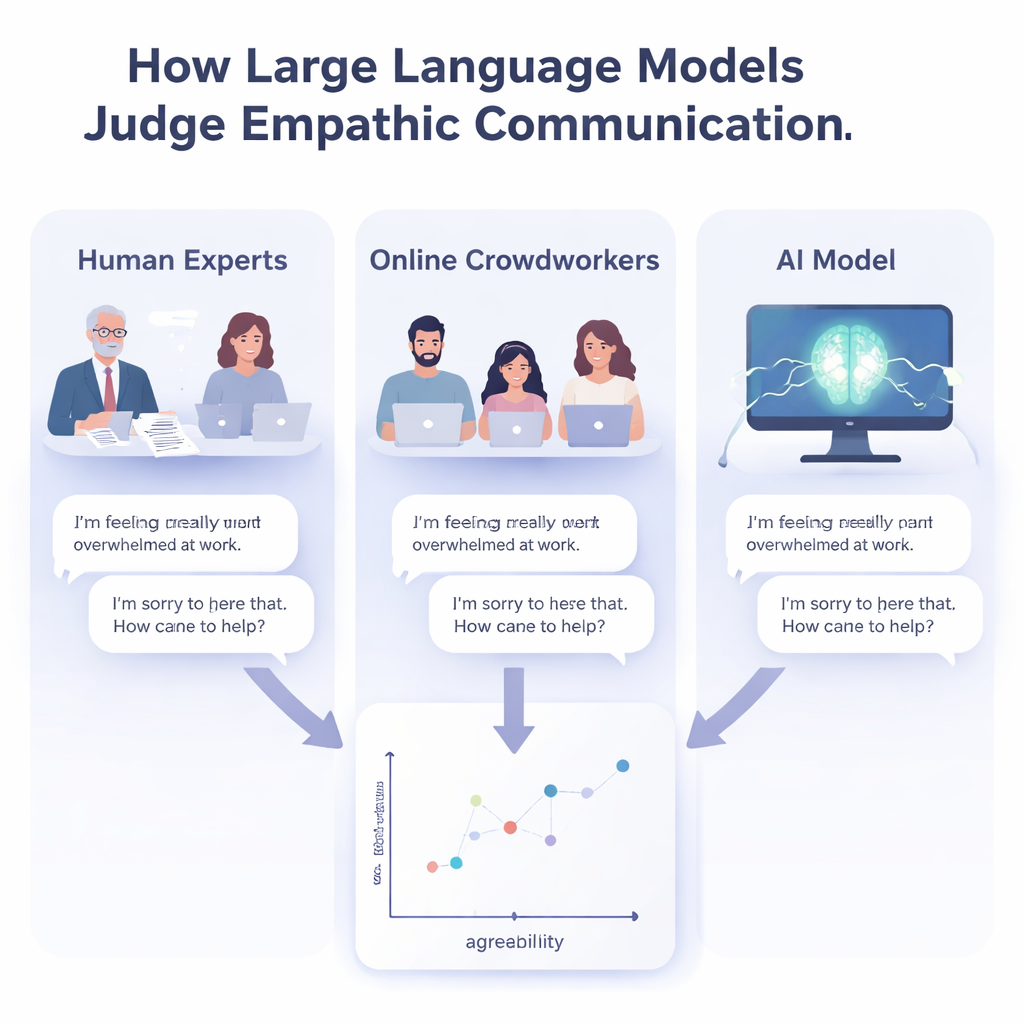

専門家、クラウドワーカー、そして機械

LLMがどれほど共感を評価できるかを確かめるために、研究チームは3種類の評価者を比較しました:コミュニケーションの専門家、オンラインのクラウドワーカー、そして最新の言語モデルです。共感的コミュニケーションに詳しい3名の研究者が、それぞれ独立して全会話を21の行動すべてについて評価しました。クラウドワーカー――一般のインターネット利用者――は以前の研究で同じメッセージに対する評価を既に提供していました。最後に、3つの主要な言語モデルが専門家による平易なガイドラインと評価例を丁寧に与えられ、同じ尺度で各会話を採点するように求められました。この設定により、研究者は各グループが「正解」と一致するかどうかだけでなく、互いにどれほど一致しているかを測ることができました。

どのくらい一致しているのか?

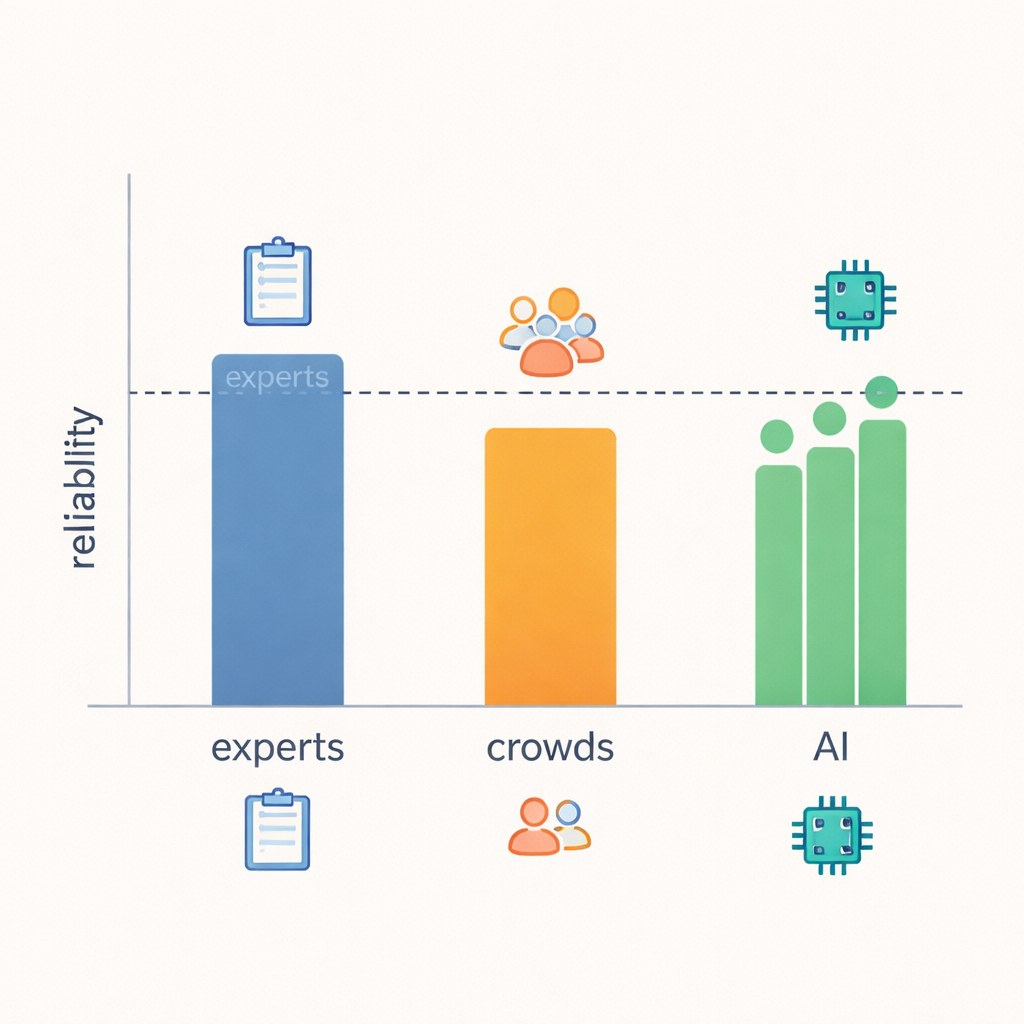

主要な発見は、LLMが専門家レベルの信頼性に驚くほど近づいたという点です。評価が一致する頻度や不一致の大きさを測ると、モデルは21の行動の多くで専門家に匹敵するかほぼ匹敵し、明らかにクラウドワーカーより優れていました。実用的な助言を与えたか、フォローアップの質問をしたか、注意を話し手に戻したかのように明確で観察可能な信号がある領域では、専門家、LLM、さらにはクラウド評価者も一致しやすい傾向がありました。しかし、「理解を示した」と本当に言えるかや応答者の意図が何であったかのようなあいまいな概念を判断する際には、専門家間でも意見が分かれやすく、LLMの信頼性もそれに伴って低下しました。これは、共感の一部はテキストだけから確定するのがそもそも難しいことを示唆しています。評価する主体が誰であれ同様です。

単純なスコアの誤解を招く危険

多くのAI研究は、専門家の評価を疑いなく正解と見なしてモデルの一致度を測るような馴染みのある分類スコアで成功を報告します。著者らは、こうした方法が微妙な人間の判断を扱う際に歪んだ印象を与えかねないことを示しています。たとえば、偏った尺度で多数派の評価を主に当てるだけで高得点を取れる一方で、まれだが重要なケースに弱いことがあります。同様に、ほとんど「ほぼ正しい」—たった1点ずれている—評価を主に与える方法は、厳密な一致基準では低く見えるが、実際には人間の専門家と行動が似ていることがあります。異なる評価者がどれほど一貫して採点するか(評価者間信頼性)に注目することで、本研究は人間と機械が何を確実に評価できるかについてより正直な見方を提示します。

日常のAIにとっての意味

一般向けの結論は希望と注意喚起が混在しています。適切に設定されたLLMは、専門家の基準に照らして書かれた応答が共感的コミュニケーションの水準を満たしているかをチェックするのに役立ち、未訓練の人間評価者よりも一貫していることが多くなりました。これにより、医療、教育、カスタマーサービスで使われるチャットボットの監視や改善が容易になる可能性があります。一方で、研究はすべての「共感テスト」が同じではないことを警告します。あいまいで重複する質問は人間の合意を弱め、それが機械の判断の不確かさにつながります。感情的支援のような微妙な評価をAIに任せる前に、まず専門家自身が「良い」が何かで合意できるかを確認し、その基準を使って機械が安全に支援できる領域と人間の判断が不可欠な領域を決めるべきです。

引用: Kumar, A., Poungpeth, N., Yang, D. et al. When large language models are reliable for judging empathic communication. Nat Mach Intell 8, 173–185 (2026). https://doi.org/10.1038/s42256-025-01169-6

キーワード: 共感的コミュニケーション, 大規模言語モデル, AIコンパニオン, メンタルヘルス支援, 人間とAIの相互作用