Clear Sky Science · ja

大規模言語モデルを用いた医療機器規制科学のスケーリング

患者と医師にとってなぜ重要か

現代医療は、スキャンの読影、バイタルサインの追跡、医師の意思決定支援に人工知能を使う「スマート」機器で急速に満たされつつあります。米国だけでも、既に千を超えるこうしたツールが食品医薬品局(FDA)によって認可または承認されています。各機器には複雑な報告書や安全記録という紙の跡が残ります。現在、その情報の大部分は依然として手作業で精査されており、遅く、高コストで、現実にすぐ追いつかなくなります。本稿は、先進的なチャットボットの背後にあるのと同種のAIである大規模言語モデルが、これらの文書を大規模に確実に読み取り、規制当局、研究者、一般の人々が機器の設計や安全性を理解するための利用可能なデータに変換できるかを検討します。

複雑な文書が多すぎるという問題

AI搭載の医療機器には、詳細な決定要約、安全報告、リコール通知などの分厚い文書が伴います。これらの文書は長く、専門用語が多く、表や画像、不統一なフォーマットを含むことが多いです。過去の研究は、承認前にどのように検査が行われたか、あるいは故障が起きた際に何が正確に問題になったかといった基本的な質問に答えるには、専門家チームが何百ものPDFを行ごとに読み解かなければならなかったことを示しています。単純な検索ツールやパターンマッチングは識別番号のような明白な詳細を見つけられますが、複数の病院で実施されたかどうか、あるいは機器が本当に患者の傷害や死亡に寄与したかどうかのような判断を要する深い問いには苦戦します。AI対応機器の数が爆発的に増えるにつれて、この手作業のやり方は追いつかなくなっています。

専門家が読むように動くAIパイプライン

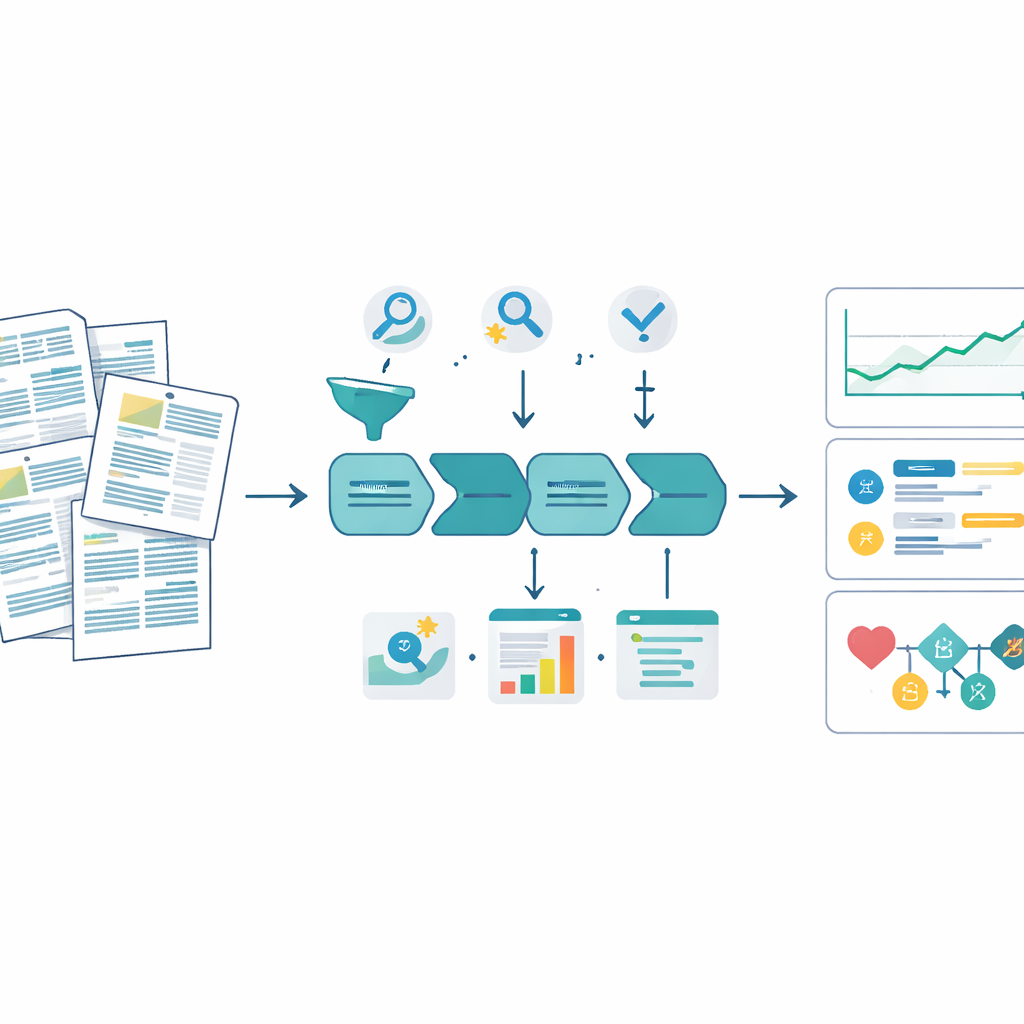

著者らは、この課題に取り組むために最先端の大規模言語モデルに基づく汎用パイプラインを構築しました。まず、公開されているFDAの決定要約と安全報告を、2025年中頃までに1,247件のAIまたは機械学習機器と1,852件の関連有害事象報告について収集し、PDFのクリーンアップや必要に応じて光学文字認識を行いました。次に、モデルに広範な質問を一度にさせるのではなく、作業をより小さく明確に定義されたサブタスクに分割しました。各文書タイプごとに、モデルには公式のFDAガイダンスに基づく詳細な指示と、人間がどのように情報にラベル付けするかの例が与えられました。モデルには段階的に推論するよう求め、出力は厳格で構造化された形式に限定させることで、自由形式のテキストを「試験施設数」「安全事象の種類」「機器変更の種類」などの明確なフィールドに変換しました。

実際の規制上の問いで精度を検証する

このシステムが信頼できるかを判断するため、チームは以前の研究者が手作業で数か月を費やした3つのケーススタディを実行しました。まず、承認前の試験が前向き(データを将来に向けて収集)に実施されたか、また複数の病院が関与していたかを問うことで、機器がどのように試験されたかを再検討しました。モデルの出力と専門家のラベルを比較すると、しばしば80〜90%以上の一致率が得られ、人間の注釈者間の一致率と同等でした。次に、故障、傷害、死亡を記述する安全報告をモデルで再ラベルし、何が問題だったのかを分類しました。人間のレビュアーがメーカーの元のコードとモデルが示したコードをどちらがどちらか分からない状態で比較したところ、とくに死亡と故障のような敏感なカテゴリで、モデルの選択が大多数の場合で好まれました。第三に、研究者らは承認前の文書の詳細を後の安全報告と結び付け、先代機にリコール歴があるか、大幅なハードウェア変更があったかといった初期の選択が将来の問題リスクに統計的に結び付くかを調べました。

安全性と監視について示す所見

検証が完了すると、このパイプラインにより数十台の機器から既知のAI搭載医療機器全体へと分析を拡張することが可能になりました。例えば、前向きな臨床評価は過去三十年で比較的稀で、約10台に1台程度で推移している一方、多施設試験の言及は大幅に増加していることが分かりました。安全報告では、本文で記述された問題の種類がFDAに提出されたコードと一致していないパターンも明らかになりました。例えば、ハードウェアの故障が画像品質の問題としてラベル付けされている状況がありました。承認前の特徴を後の安全事象に結び付けたところ、先代機にリコールや有害事象の履歴がある機器は新たな報告のハザードがはるかに高く、一方で臨床試験を裏付けに持つ機器はリスクが低い傾向がありました。これらの結果は探索的なものですが、今や一過性のプロジェクトとしてではなく日常的に問い得る種類の問題を示しています。

限界、安全策、今後の道筋

著者らは、自らのアプローチが完全無欠ではなく専門家の判断を置き換えるべきではないことを強調します。約80%の精度は大局的な傾向を分析するには十分であっても、個々の機器や患者に関する決定を下すには不十分な場合があります。性能は機器のタイプや年次によって変動する可能性があり、基礎となるFDA文書や安全データベースの質が依然として大きな制約となります。それでも、本研究は慎重に設計された言語モデルシステムが、構造化されていない膨大な規制文書の山を数年ではなく数日で構造化・監査可能なデータに変えうることを示しています。一般読者への要点は、消費者向けチャットボットを支えるのと同じAI技術が、監視機関や研究者がAI医療機器の構築、試験、監視のあり方を追跡するのを助ける可能性があり—問題の検出を速め、より安全な規則や製品を形作るためのより良い証拠につながる可能性がある、ということです。

引用: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

キーワード: AI医療機器, 規制科学, 大規模言語モデル, FDA安全報告, 保健技術の監視