Clear Sky Science · ja

GWKNN: Gメトリック再構築とグレイウルフ最適化器を用いた改良k近傍法

増え続けるデータに対応するより賢いパターン認識

医療画像から銀行取引まで、現代は膨大なデータを生み出しています。多くの情報は自動的に分類される必要があり、例えば健康/病気、詐欺/正常、迷惑メール/正当メールなどに振り分けられます。この種のタスクで古典的に用いられてきた手法の一つがk近傍法(KNN)で、新しい事例を過去の類似例を参照してラベル付けします。しかしデータセットがより大規模で複雑、かつ不均衡になると、この単純な発想は限界を迎えます。本論文はGWKNNを提案し、点間距離の利用方法を改良し、希少だが重要なケースをより公平に扱うことを目指しています。

なぜ単純な類似度で十分でないのか

従来のKNNはデータ点の全ての特徴が同等に寄与すると仮定し、標準的なユークリッド距離のような直線距離で類似度を測ります。これは低次元で分離が明瞭なデータでは有効ですが、現実のデータは高次元でノイズを含み、多様な情報が混在することが多いです。そのような場合、通常の距離は誤解を招き、アルゴリズムが役に立たない近傍を選んでしまうことがあります。同時に、多くのデータセットはクラス不均衡で、一般的なカテゴリが支配し、早期段階の疾患など希少だが重要なカテゴリは過小表現されがちです。KNNが近傍の多数決で判断すると、多数クラスが少数クラスを押し流し、偏った、時には危険な決定を招きます。

距離に対するより良い感覚をアルゴリズムに教える

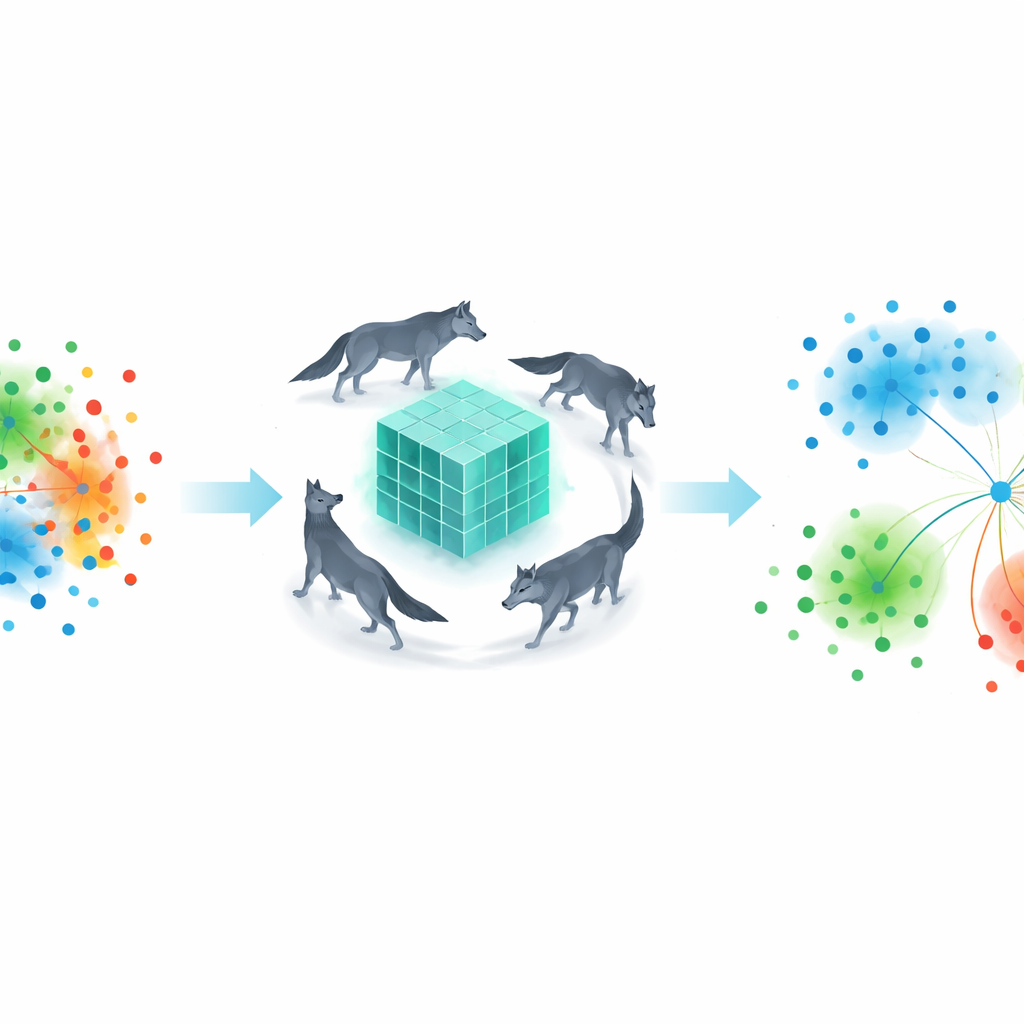

GWKNNの第一の革新は、学習された距離尺度です。従来の直線的ルールに固定する代わりに、データ点同士の「適切な」距離をアルゴリズム自身に見つけさせ、クラス間の分離が最も良くなるようにします。これを柔軟な「Gメトリック」として表現し、有益な特徴の影響を大きくし、冗長な特徴の影響を小さくなるよう空間を再形成します。このメトリックを調整するために、手法はグレイウルフの狩猟行動から着想を得ます。群知能に基づく最適化手続きであるグレイウルフ最適化器が、データ空間の伸縮の多様な候補を探索し、分類誤差を減らしつつ数学的安定性を保つ選択を残します。多くの反復を経て、仮想の“ウルフ”たちは高次元で絡み合ったデータでも類似点がより確実に集まるような距離規則に収束します。

希少な事例の声を大きくする

第二の改良点は投票の偏りへの対処です。標準的なKNNは単純にk個の近傍のうち各クラスに属する個数を数えて多数派を選びます。GWKNNは代わりに各投票に対して、そのクラスが訓練データ全体でどれだけ一般的かに応じた重みを付与します。出現頻度の低いクラスにはより強い重みを与え、非常に頻繁なクラスには弱い重みを与えます。極端に稀なカテゴリが判断を支配しないよう小さな平滑化項も導入されます。こうして新しいデータ点が少数クラスの例に近い一方で多数クラスの例にも囲まれている場合でも、少数の信号が自動的にかき消されることはありません。この仕組みは計算上単純ですが強力な効果を持ち、分類器が希少だが意味のあるパターンにより注意を払うよう促し、少数クラスの公平性と再現率を向上させます。

新手法の実地検証

GWKNNが実際に有効かを確かめるため、著者らはUCIリポジトリからの12のベンチマークデータセットで評価しました。これらは金融データ、医療測定、手書き文字、植物の種子、さらには多数の特徴を持つがんや遺伝子発現データセットなどを含み、2クラス問題と多クラス問題の両方が含まれます。比較対象として、ベースラインの単純なKNN、距離尺度だけを導入した版、投票重みだけを導入した版、そして両方を組み合わせた完全なGWKNNの4種類を用意しました。さらにサポートベクターマシン、決定木、ランダムフォレスト、ロジスティック回帰、ナイーブベイズ、ニューラルネットワークといった広く使われる7つの分類器とも競合させました。繰り返しの訓練–テスト分割を通じて、平均精度だけでなく結果のばらつきも追跡しました。

結果:より高精度でより一貫した性能

結合されたGWKNNアプローチは、多くのデータセットで最良あるいは同等の性能を示し、特に特徴数が多くクラスサイズが不均衡な場合に優れました。比較的単純なタスクでは全手法が良好に機能し、利得は控えめでしたが、GWKNNは精度をわずかに改善し変動を減らす傾向がありました。数千の特徴を持つ難しい遺伝子発現データセットでは利点がさらに明瞭になり、学習された距離尺度がより意味のある近傍を形成するのに貢献し、重み付き投票が過小表現クラスの識別を改善しました。全データセットにわたる統計検定でも、GWKNNのランキングは標準KNNや一部の古典的モデルより有意に優れており、その改善が単なる偶然のゆらぎではなくさまざまなデータ条件で頑健であることを示しています。

日常的なデータ判断への示唆

専門外の読者への要点は、GWKNNが「過去の類似事例を見る」という直感的な考え方を、現代の複雑なデータによりよく適合させる形で洗練したことです。データ駆動で類似性の測り方を学習し、投票時に希少カテゴリの影響力を高めることで、手法はより正確で公平であることを目指します。この追加の洗練は特に大規模かつ高次元のデータでは計算コストを伴いますが、早期疾患検出や詐欺検出など少数ケースの正確な分類が重要なタスクには大きな可能性を示します。本研究は、古典的なアルゴリズムを最適化と公平性の知見でアップグレードし、今日の情報の規模と複雑さに対応する一例を提供します。

引用: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

キーワード: k近傍法, 距離尺度学習, クラス不均衡, 群知能, データ分類