Clear Sky Science · ja

ニューラルネットワークにおける正確な特徴衝突

異なる画像が高性能な機械を欺くとき

現代の人工知能システムは顔認識や医療画像の読影、自動運転の誘導などを行えます。わずかな、注意深く設計された画像の変化によって騙されることがあるのは既に知られていますが、本稿はさらに驚くべき事実を示します:同じネットワークが大きく明白な変化に対して盲目になり、非常に異なる画像をあたかも同一のように扱うことがあるのです。この現象の仕組みと原因を理解することは、本当に信頼できるAIを作るために極めて重要です。

小さな調整から大きな盲点へ

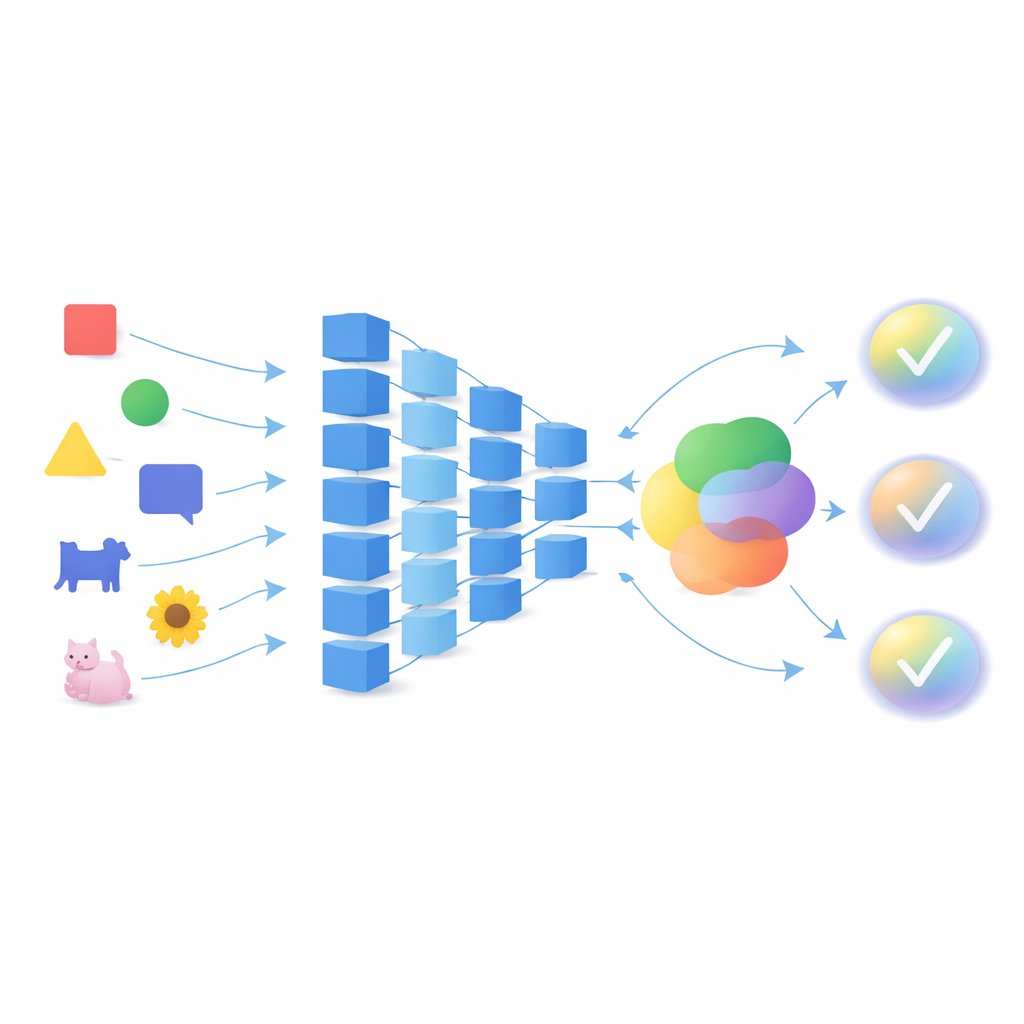

深層ニューラルネットワークは、視覚や言語など多くの分野で今日のブレークスルーを支えています。従来の敵対的事例の研究は、ほとんど見えない変化がネットワークを高い確信度で誤分類させることを明らかにしました。最近の研究ではその逆の問題も明らかになっています:一部のネットワークは大きく明白な変化にほとんど反応せず、ほぼ同一の予測を出し続けるのです。そうした場合、二つの非常に異なる画像から抽出される内部特徴が「衝突」し、ネットワークはそれらをほぼ同じように表現します。本研究はその考えをさらに推し進め、一般的なネットワークが近似的な衝突を持つだけでなく、二つの異なる入力が厳密に同一の内部信号へ写像される「正確な」特徴衝突を持ちうることを証明します。

ネットワーク内で衝突が生じる仕組み

これらの衝突を説明するために著者らはニューラルネットワークの内部、特に層と層をつなぐ学習済みの重み行列に注目します。特徴衝突は二つの異なる入力がある層で同じ出力を生むときに起きます。一度そうなると以降のすべての層も同じものを見るため入力を区別できません。数学的には、二つの入力の差分がその層の重みの「ヌル空間」に属する場合にこれが起きます。ヌル空間とは、その層が完全に無視する入力空間の方向です。著者らは、重み行列が零固有値を持つ場合や高次元から低次元へ写す場合には、そのような無視される方向が必ず存在することを示します。分類、セグメンテーション、物体検出などの人気ある実装を含む多くの実用的なアーキテクチャがそのような層を多数用いているため、衝突は稀な例外ではなくこれらのネットワークにほぼ必然的に備わった性質であると結論付けられます。

衝突する入力を作る新しい方法

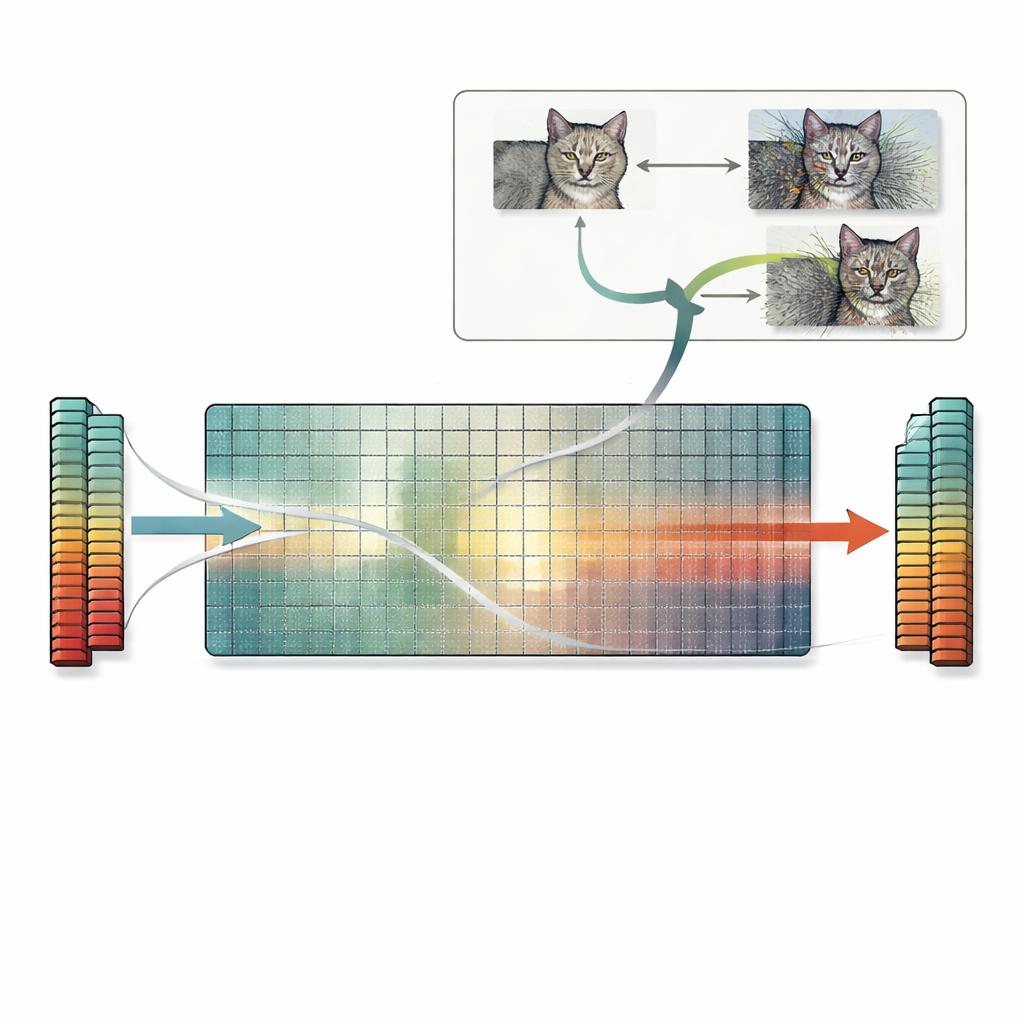

この洞察に基づき、論文は実用的な手順「ヌル空間探索」を導入します。試行錯誤や勾配に基づくトリックに頼る代わりに、この方法は第一の重み行列のヌル空間を直接利用します。任意の画像から始めて、第一層が無視するベクトルを計算し、そのベクトルの適切なスケーリング版を画像に加えます。その方向は第一層にとって不可視であるため、ネットワークの内部特徴と最終的な予測は、画像自体が人間の目には大きく歪んで見えても正確に同じまま残ります。同じ考えは畳み込み層や理論的には後の層にも拡張できます。著者らは多くの標準モデルを調査し、ほとんどのモデルがこのような無視される方向を多数持つことを見出しました。したがって、さまざまなタスクに対して無数の衝突画像をこの方法で生成できることになります。

類似性、説明、セキュリティに潜むリスク

これらの正確な特徴衝突は広範な影響を持ちます。特徴が衝突する二つの画像は同じ予測を共有するだけでなく、人気のある解釈手法が生成する説明マップまでも共有することが多くあります。これにより、認識困難で大きく改変された画像が、きれいな画像と同じように十分に支持されているように見えてしまい、説明手法への信頼を損ないます。また、この問題はニューラルネットワークに依存する特徴ベースの類似性測度にも影響します:特徴が完全に一致するため、重度に劣化した画像が元の画像と「同一」と評価されうる一方で、単純なピクセルベースのスコアは大きな差異を正しく検出することがあります。最後に、ヌル空間探索は標準的な敵対的攻撃と組み合わせることができ、すべて同じ誤った予測をもたらし標準的な摂動制限内に収まる多様な敵対的画像を生み出して既存のセキュリティ懸念を深刻化させます。

より安全なAIを作るための含意

平たく言えば、本研究は今日のニューラルネットワークが予測可能な形で情報を捨てており、決定にまったく影響を与えない入力空間内の方向が存在していることを示しています。攻撃者はこれらの盲点を利用して、ネットワークが通常の画像と同一視する奇妙な画像や敵対的な画像を作り出すことができます。著者らは、これらの無視される方向の単純な数え上げをモデルがどれだけ脆弱かを測る指標として用いることを提案し、ヌル空間が小さい、よりスリムで正則化の効いたネットワークのほうが堅牢である可能性が高いと主張します。実践で検証すべき点は多いものの、中心となるメッセージは明確です:信頼できるAIを目指すなら、ネットワークが何に反応するかだけでなく、何を無視しているかにも注意を払わなければなりません。

引用: Ozbulak, U., Rao, S., De Neve, W. et al. Exact feature collisions in neural networks. Sci Rep 16, 10139 (2026). https://doi.org/10.1038/s41598-026-40605-4

キーワード: ニューラルネットワーク, 敵対的事例, 特徴の衝突, モデルの堅牢性, ヌル空間探索