Clear Sky Science · ja

ルールベースの説明可能な畳み込みニューラルネットワークによる撮影機器の出所帰属

写真が思っている以上のことを語る理由

あなたが撮るすべての写真には、撮影に使われたカメラに関する隠れた手がかりが含まれています。デジタル鑑識の専門家にとって、これらの手がかりは画像が真実のものか、どの機器から来たかを確かめたり、異なる現場の写真を結びつけたりするのに役立ちます。近年、強力な人工知能(AI)ツールは人間よりもこうしたパターンを見抜けますが、多くは「ブラックボックス」として動作します。本稿はその箱を開く方法を提示します:深層学習モデルがどのようにしてある写真の撮影機器を決定したかを、人間の鑑識者が理解し信頼できる形で説明するルールベースの手法です。

高度な鑑識ツールを信頼することの難しさ

現代のデジタル鑑識は、スマートフォン、クラウドバックアップ、ソーシャルメディアなどから得られる膨大なデータを処理しなければならず、人間のアナリストが手作業で検査できる範囲をはるかに超えています。深層学習システムは画像を迅速に選別したり重要なものを示唆したりできますが、その内部は非常に不透明です。法廷のような慎重さが求められる場面では、「ニューラルネットワークがそう判断した」というだけでは不十分です。既存の説明手法は通常、モデルが重要とした画像領域をハイライトしますが、これは顔や物体の認識のようなタスクには有用でも、撮影機器の識別では決定的な信号が目に見える特徴ではなく、わずかなセンサー固有のノイズパターンという点で限界があります。そのため、現在の可視的な説明ツールはモデルがなぜ特定のカメラ由来と判断したのかを明確に示さず、またモデルが誤っている場合に鑑識者がそれを見抜く助けにもなりにくいのです。

ニューラルネットワークの思考過程を観察する新手法

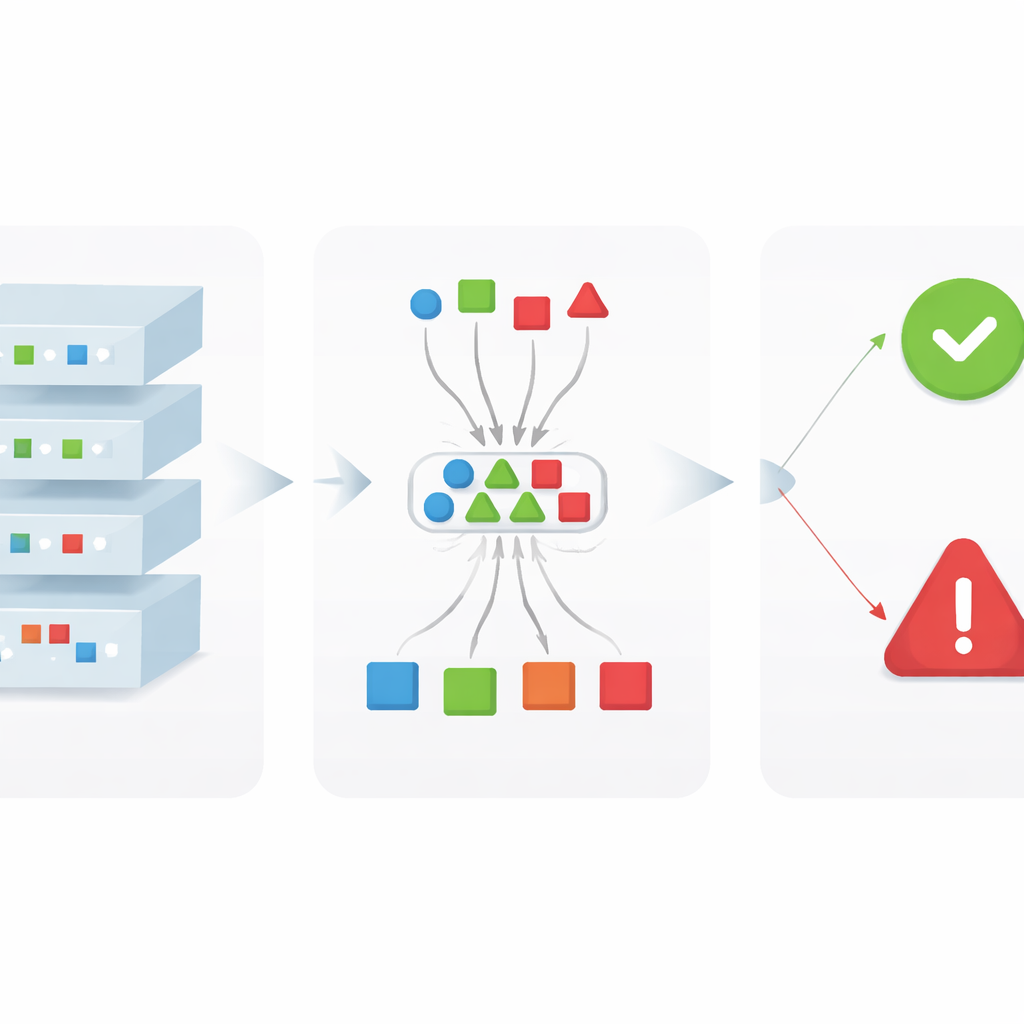

著者らは xDFAI と呼ばれる、デジタル鑑識向けに設計されたフレームワークを紹介します。これは元のモデルを変更せずに畳み込みニューラルネットワーク(CNN)がどのように判断に至るかを説明する方法です。ネットワークを単一の不透明な箱として扱う代わりに、xDFAI は層ごとに内部を観察します。各層および各カメラクラスについて、モデルがそのカメラに属すると判断するときに一貫して活性化する再現性のある内部パターン、いわゆる「トレース」を特定します。これらのトレースは訓練済みモデルから既存の帰属手法を用いて抽出され、その後多くの訓練画像で安定して現れるパターンのみがフィルタリングされます。こうして得られたトレースは、画像がネットワークを通過するにつれてカメラ識別の手がかりがどのように変化するかを示す構造化された地図を形成します。

層ごとの投票とその投票をルールに変える仕組み

トレースが分かったら、xDFAI はそれらを使って未知の画像を検査します。あるテスト写真に対して、フレームワークは各層における内部活性が各カメラの保存されたトレースとどれほど類似しているかを測定します。各層は実質的に、自身が最も類似すると判断したカメラモデルに票を投じます。層を横断した「多数決」は、ネットワーク全体として各候補カメラをどれだけ強く支持しているかを要約します。重要なのは、この投票結果をモデルの予測に置き換えるのではなく、照合のためのチェックとして用いる点です。単純な論理ルールが多数決と元の予測を比較します:予測されたカメラが多くの層から強い支持も受けていれば決定は確認され、票が分散していたり別のカメラが支持されていれば挙動は異常としてフラグが立てられ、鑑識者に潜在的なモデル誤りとして提示されます。

フレームワークの実地テスト

xDFAI の実証のため、著者らは 7 層の CNN に適用し、既知の鑑識データセットを用いて 27 種類のカメラモデルのうちどれが撮影したかを識別する実験を行いました。ベースの CNN 単体でもテスト画像の約 97% を正しく分類するなど非常に高い性能を示します。xDFAI のルールを上に適用すると、誤った予測 37 件のうち自動的に 27 件が疑わしいものとしてフラグ付けされました。フラグ付けされたケースはもはや自信ある識別としてはカウントされず、受け入れられた決定のうち実際に正しいものの割合(精度)は 97.33% から 99.2% に上昇し、全体の正解率はわずかに低下するにとどまりました。鑑識の現場では、単一の誤帰属が重大な結果を招く可能性があるため、このようなトレードオフは非常に望ましいものです:鑑識者が信頼する結論の中で誤りが減ることを意味します。

実際の捜査への含意

本研究は、最新の深層学習モデルの性能を損なうことなく、法医学的整合性を尊重した人間に理解しやすい説明を付加できることを示しています—再訓練せず、元のモデルに手を加えず、漠然としたヒートマップのみには依存しません。安定した内部トレースを露呈し、それらを透明な投票スキームで集約し、結果を単純なルールとして表現することで、xDFAI は鑑識者が AI によるカメラ帰属を確認したり疑問を呈したりする手段を提供します。本研究はカメラ出所識別に焦点を当てていますが、同じ考え方は他の鑑識帰属タスクにも拡張できる可能性があります。長期的には、このようなアプローチが高精度な AI システムと、法廷や捜査実務で求められる透明性・信頼性とのギャップを埋める助けになるかもしれません。

引用: Nayerifard, T., Amintoosi, H. & Ghaemi Bafghi, A. Source camera attribution using a rule-based explainable convolutional neural network. Sci Rep 16, 9137 (2026). https://doi.org/10.1038/s41598-026-40387-9

キーワード: デジタル鑑識, 説明可能なAI, カメラ識別, 畳み込みニューラルネットワーク, 画像鑑識