Clear Sky Science · ja

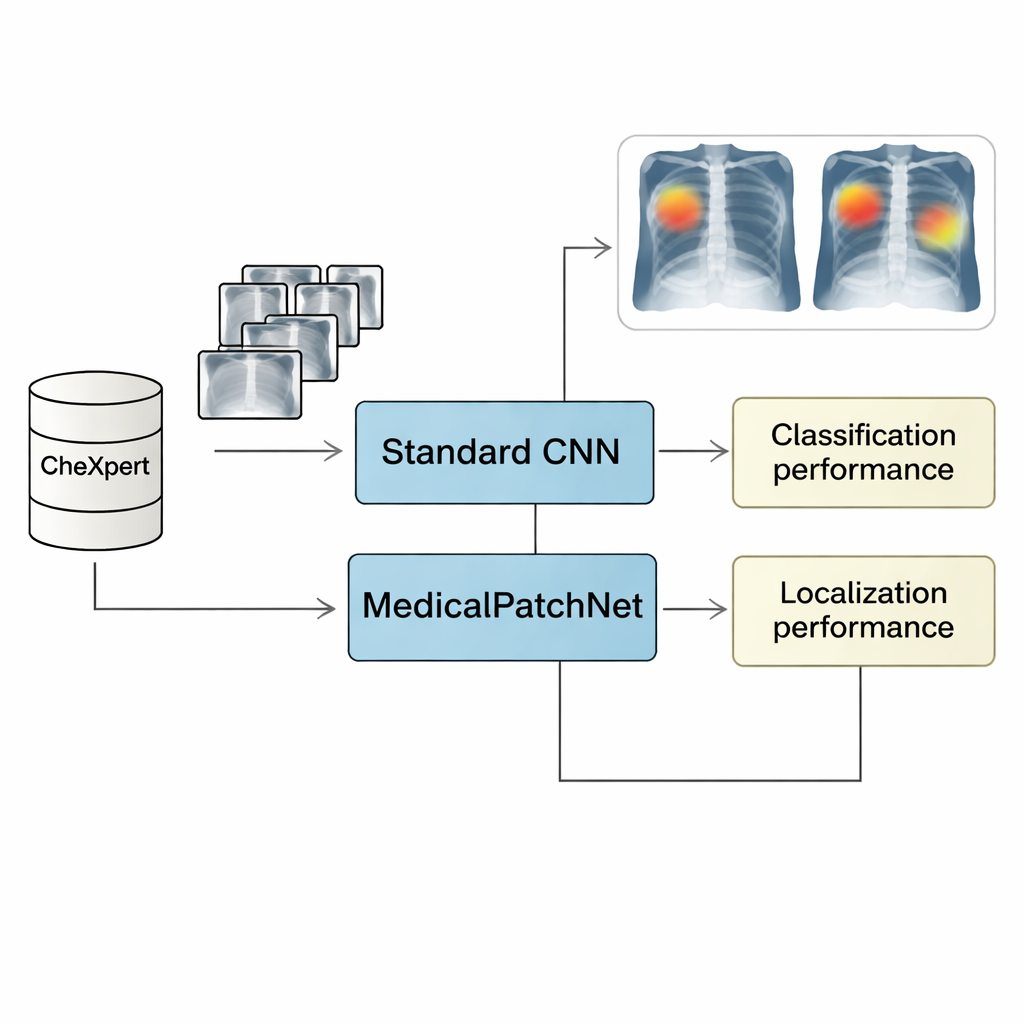

MedicalPatchNet: 胸部X線分類のためのパッチベースの自己説明型AIアーキテクチャ

より賢いX線が重要な理由

胸部X線は世界で最も一般的な医療検査の一つであり、人工知能(AI)システムが診断の補助をする機会が増えています。しかし、現在の高性能なAIモデルの多くは「ブラックボックス」のように振る舞い、精度は高くても、専門家でさえ特定の診断に至った理由を容易に把握できません。この透明性の欠如は、臨床でAIを信頼し安全に使用することを困難にします。本研究はMedicalPatchNetを提案し、高い精度を維持しつつ、その推論過程を機械学習の専門知識がない人にも見て理解できる形で示すことを目指しています。

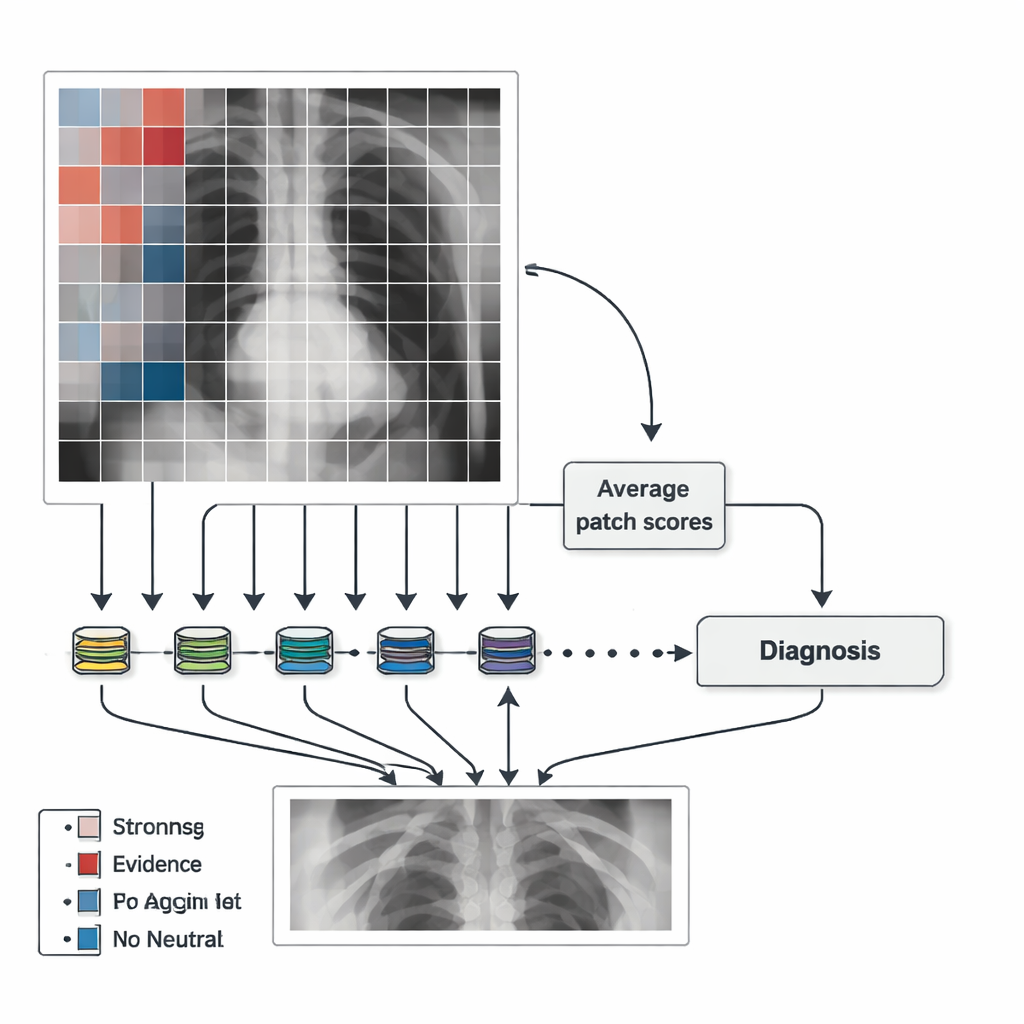

画像を小さく意味のある領域に分割する

胸部X線を一つの大きな「謎めいた全体」として解析する代わりに、MedicalPatchNetは画像を多数の小さな非重複の正方形、つまり「パッチ」に分割して処理します。各パッチは同じニューラルネットワークに入力され、肺の不透明化、肺炎、胸水(肺の周りの液体)など、いくつかの所見に対するスコアを出力します。これらのパッチ単位のスコアを単純に平均することで画像全体に対する最終判定を得ます。最終的な答えが多くの局所的な投票の合算に過ぎないため、どのパッチが診断にどれだけ貢献したかを示すのが容易です。重要な点は、隠れた注意機構や複雑な内部重み付けがなく、各領域の影響が不透明に学習されるのではなく明示的に定義されていることです。

モデルの判断を明瞭な可視地図に変える

著者らはこうしたパッチスコアを用いて、AIが病変の証拠をどこで見つけたかを強調する「サリエンシーマップ」を作成します。所見を強く支持するパッチは暖色(例えば赤)、反対するパッチは寒色(例えば青)、中立的な領域は灰色で示されます。これにより、モデルが肺や心臓に注目しているのか、あるいは境界アーチファクトやテキストラベルのような無関係な特徴に注目しているかを簡単に確認できます。マップのブロック状を和らげ滑らかにするために、画像をわずかにシフトした複数のステップで地図を生成し、その結果を平均化する手法も用いています。これには計算コストが追加されますが、各領域と最終決定への寄与との明確な結びつきを保ちながら、解剖学的構造により合致したヒートマップが得られます。

ブラックボックス性能に匹敵しつつ信頼性を向上

MedicalPatchNetを検証するため、研究者たちは14種類の一般的所見にラベル付けされた22万点を超える胸部X線画像からなる大規模公開データセットCheXpertで学習させました。同じバックボーンネットワーク(EfficientNetV2-S)を用いた強力な従来の画像レベルモデルと比較したところ、平均的にAUROC(受信者動作特性曲線下面積)、感度、特異度、精度といった診断性能指標でほぼ同等の成績を示しました。つまり、モデルにパッチごとに推論させて結果を平均化するよう強制しても、疾患を認識する能力が実質的に損なわれることはありませんでした。これは多くの胸部X線タスクにおいて局所的な画像情報で十分であり、性能を出すために複雑で完全にグローバルなパターンに依存する必要がないことを示唆しています。

モデルが病変を「どこで見るか」を可視化する

全体的な精度を超えて重要なのは、MedicalPatchNetがGrad-CAMやその派生法のような事後的な説明手法よりも一貫して自身を説明できるかどうかです。その評価のために、研究チームは放射線科医が描いた実際の病変領域の輪郭を含む第二のデータセットCheXlocalizeを用いました。手法の最も強調された点が真の異常領域内に入っている頻度(“ヒット率”)と、強調領域が専門家の注釈とどれだけ重なっているか(平均Intersection over Union、mIoU)を測定しました。MedicalPatchNetのパッチベースのマップは、10条件中9条件でGrad-CAM型の説明より高いヒット率を達成し、正解と不正解の予測を合わせて数えた場合においても最良の重なりを示しました。この包括的評価は、モデルが正しい場合にのみ見栄えの良い説明を提供し、モデルが誤っているときに誤解を招く挙動を露呈しない説明手法に対してペナルティを与える点で重要です。

不透明な推測から透明なパートナーへ

専門外の読者にとっての主要な成果は、MedicalPatchNetが胸部X線診断においてほぼ最先端に近い性能を維持しながら、AIの推論をはるかに透明にできることを示した点です。何が決定を駆動したかを反映しているかどうか不確かな神秘的なヒートマップの代わりに、この手法は各ハイライトをモデル計算における局所的な投票に直接結びつけます。臨床医はAIが疾患を検出したかどうかを見るだけでなく、画像のどの部分で支持あるいは反証する証拠を見つけたかを正確に確認できます。方法論には離れた領域の同時考慮が必要な病態など限界もありますが、ブラックボックス的な振る舞いを減らし、医用画像における明確で説明責任のあるパートナーとなるAIツールへの実用的な道筋を提供します。

引用: Wienholt, P., Kuhl, C., Kather, J.N. et al. MedicalPatchNet: a patch-based self-explainable AI architecture for chest X-ray classification. Sci Rep 16, 7467 (2026). https://doi.org/10.1038/s41598-026-40358-0

キーワード: 胸部X線AI, 説明可能な深層学習, MedicalPatchNet, 医用画像のサリエンシーマップ, 放射線診断支援