Clear Sky Science · ja

全天周画像からの疑似LiDARを用いた照明変化下での頑健な場所認識

暗闇でも迷わないロボット

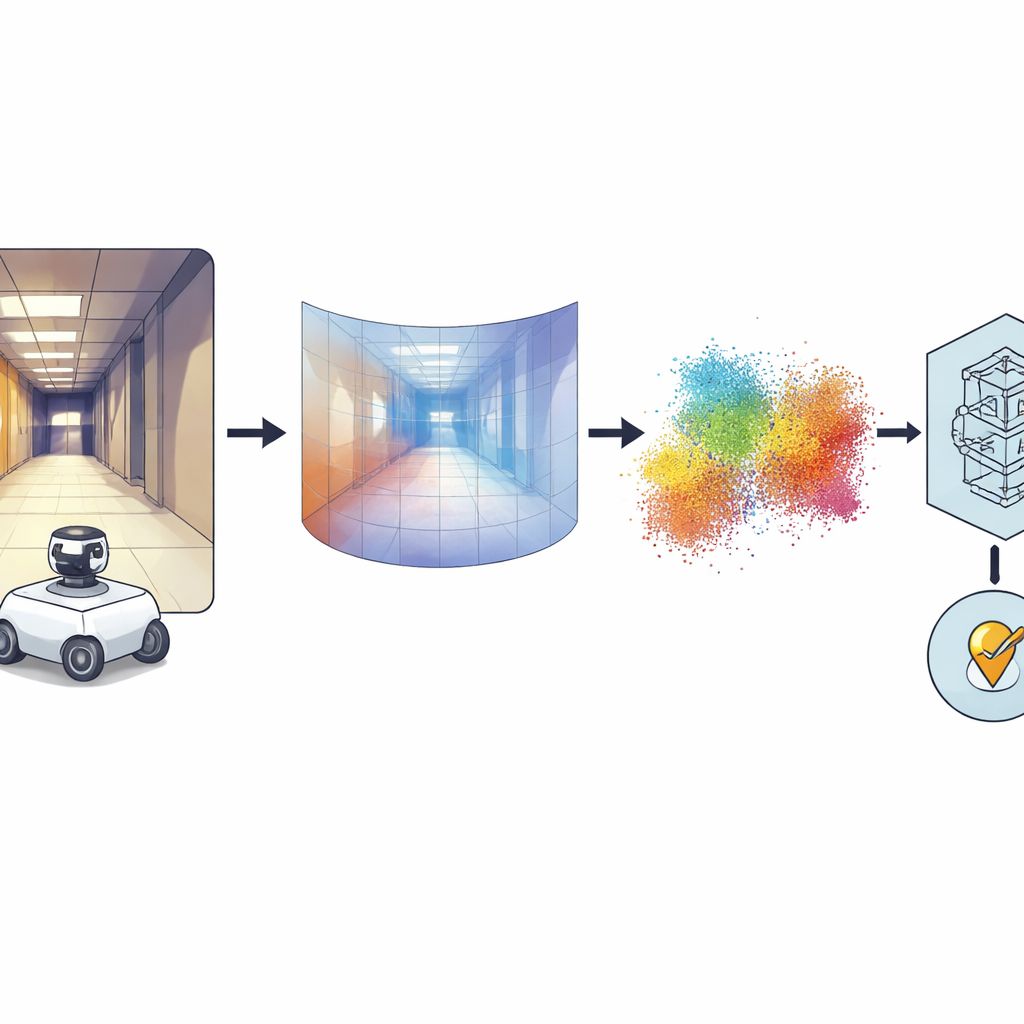

窓から陽が差す昼間であっても、薄暗い夜間でランプの光だけしかない状況であっても、自分が建物のどこにいるかを認識できるロボットを想像してください。本論文は、比較的安価な単一カメラだけでロボットにそのような堅牢な場所認識能力を与える新しい手法を示します。平面画像を3次元情報に変換することで、影やまぶしさ、その他の照明変化によって従来のビジョンベース手法が混乱する問題を大幅に軽減します。

同じ場所を再び見つけるのが難しい理由

ロボットにとって「場所認識」とは、「ここには以前来たことがある」と判別して地図上で自己位置を特定し、安全に移動することを意味します。従来のシステムは、一般的なカメラかレーザー測距センサ(LiDAR)に依存してきました。カメラは安価で色やテクスチャなど豊富な情報を捉えますが、曇り、晴天、夜間といった条件で見た目が大きく変わります。一方LiDARは距離を直接計測するため安定していますが、機器が大きく高価です。センサを組み合わせるロボットもありますが、価格とシステムの複雑さが増します。著者らは別の道を選び、ハードウェアは単純に保ちつつ、全天周カメラ1台だけで周囲を見渡し、ソフトウェア側で生画像ではなく3D構造に基づいて推論するようにしています。

全方位写真から3D形状へ

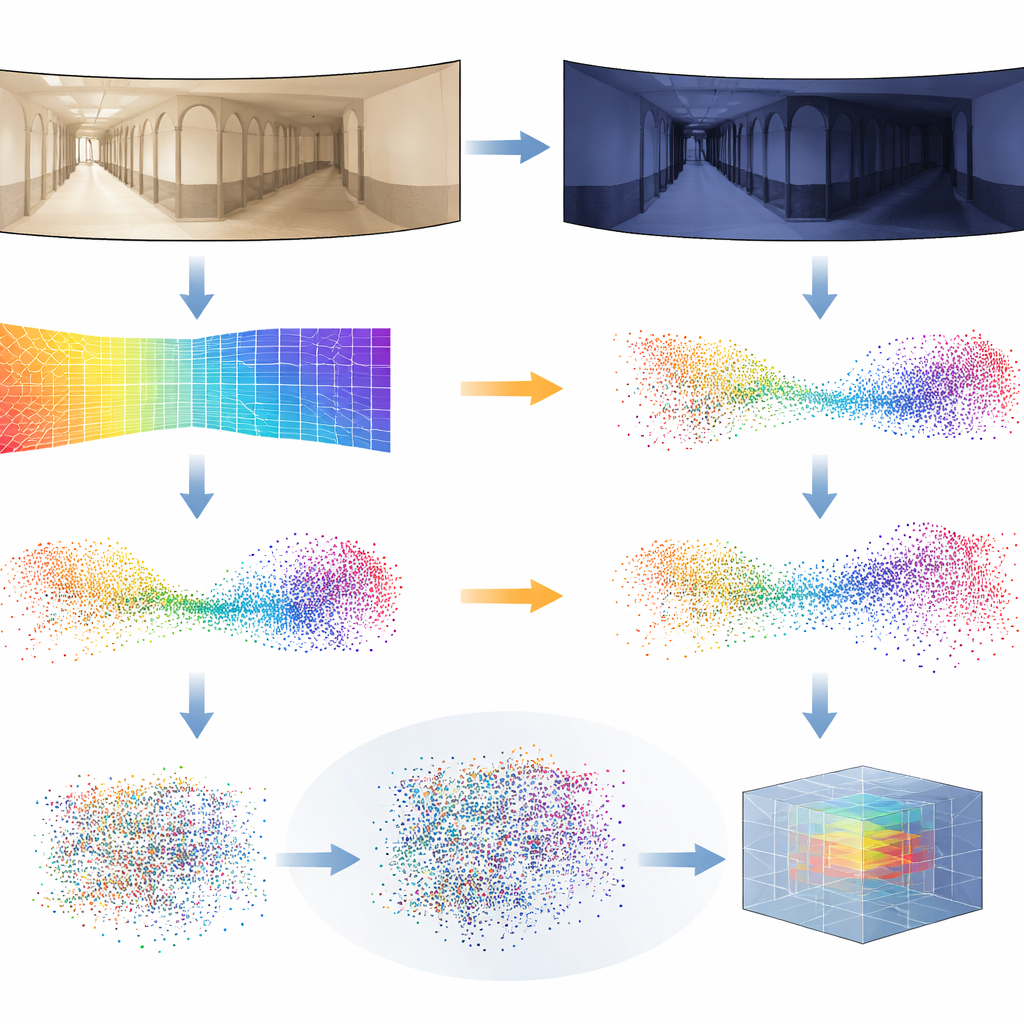

鍵となる考え方は、各パノラマ画像をピクセルごとにその部分がカメラからどれだけ離れているかを示す密な深度画像に変換することです。これには、大量の画像から深度推定を学習した強力な「ファンデーション」モデルであるDistill Any Depthを用います。得られた深度マップは3次元点群、つまり実際のレーザースキャナを使わない仮想的なLiDAR(疑似LiDAR)に変換されます。360度カメラ用の特殊なミラーに起因するアーティファクトは追加処理で除去され、欠損や遮蔽された領域は補間されます。最後に、3D点群を直接扱うよう設計されたニューラルネットワークMinkUNeXtが各点群を圧縮して、その場所の全体的な配置を表すコンパクトなフィンガープリントを生成します。

照明のトリックを無視するようシステムを教える

深度推定は完全ではなく、特に照明が大きく変化する場合に誤差が生じます。システムを頑健にするために、研究者たちはDistilled Depth Variationsと呼ぶ新しい学習手法を導入します。単一の深度モデルを信用する代わりに、複数の小さく精度の低い深度推定モデルの予測を意図的に混ぜ込みます。この制御された「ノイズ」は、異なる照明条件で現れる歪みを模倣し、3Dネットワークに対して場所の幾何学で本質的に重要な部分と安全に無視できる部分を学ばせます。さらに、各3D点に画像のエッジやテクスチャ強度といった情報を付加します。これらの特徴は生の色よりも照明変化に対して安定しやすいためです。

実世界での有効性の実証

手法の検証には、屋内ロボットの走行を収めた厳しい公開データセットを用いました。これらのデータセットでは、ロボットが廊下や部屋を曇天、強い日差し、夜間など複数回にわたって移動し、その間に家具や人の位置も変わります。著者らはある建物の曇り画像のみを用いてシステムを訓練し、見たことのない建物や照明条件を含む全ての建物・条件で評価しました。疑似LiDAR手法は、2D画像ベースの先行手法や他の3Dシステムに対して一貫して同等かそれ以上の性能を示し、特に夜間走行やまったく新しい環境への転移といった困難なケースで優れた結果を出しました。また、同じパイプラインは全天周カメラだけでなく、適切な深度から3Dへの射影を入れ替えることで通常の前方視カメラにも適用できることも示しました。

将来のロボットにとっての意義

日常的な観点から見ると、本研究は単一のカメラと工夫されたソフトウェアだけでLiDARに近い周囲認識をロボットに与えられることを示しています。照明や色の不確かさに左右される細部ではなく3D構造に着目することで、昼夜や天候の変化にわたって場所を安定して認識でき、ハードウェアは簡素で手頃なままです。これにより、サービスロボットや倉庫車両、支援機器向けの堅牢な屋内ナビゲーションの普及が進む可能性があり、将来的には深度情報とより高次のシーン理解を組み合わせた、さらに信頼性の高い自律システムへの道を開きます。

引用: Cabrera, J.J., Alfaro, M., Gil, A. et al. Robust place recognition under illumination changes using pseudo-LiDAR from omnidirectional images. Sci Rep 16, 8817 (2026). https://doi.org/10.1038/s41598-026-39848-y

キーワード: ロボットの自己位置推定, 3Dビジョン, 場所認識, 深度推定, 全天周カメラ