Clear Sky Science · ja

動的信頼度伝播と適応正規化による深層分類器の較正

なぜAIの信頼度を信用できることが重要か

現代の人工知能システムは、写真やセンサーの読み取りが何であるかを出力するだけでなく、その予測にどれだけ自信があるかも出力します。この自己申告的な信頼度は、医用画像、域制御走行、産業監視など安全性が重要な場面で極めて重要です。誤った確信が危険を招くことがあるためです。しかし、今日の深層ニューラルネットワークは間違いに対して過信しがちであり、既存の修正手法はデータが不均衡だったり環境が変化したりすると効果を失うことが多いです。本研究は、Dynamic Confidence Propagation with Alternating Normalization(DCP‑AN)と呼ばれる新手法を提示し、現実的で変化する条件下でもAIシステムの信頼度スコアをより誠実で安定的かつ効率的にすることを目指します。

賢い機械が自分に自信を持ちすぎるとき

一般的な深層学習モデルは正しいラベルを予測するように訓練されており、各予測がどれだけ信頼できるかを判定するようには作られていません。その結果、ネットワークはある画像が猫であると99%確信していても、実際には犬であることがあります。温度スケーリングや予測を信頼度ビンに分けるといった標準的な較正手法は、訓練後にグローバルな調整を適用してこの問題を修正しようとします。しかし、これらの方法はすべてのカテゴリやすべての例を同じように扱います。現実世界ではデータが均等であることは稀で、いくつかの多数派(ヘッド)クラスには多くの例があり、希少な(テール)クラスはごく少数しか現れません。ネットワークは多数派クラスで過信しやすく、希少クラスでは自信が低く出る傾向があり、静的で一律の補正ではこのギャップを埋められません。特に芸術的なスケッチから実世界の写真へといったドメイン間でデータ分布が変わるときには効果が落ちます。

データとラベル間で情報を共有する新しい方法

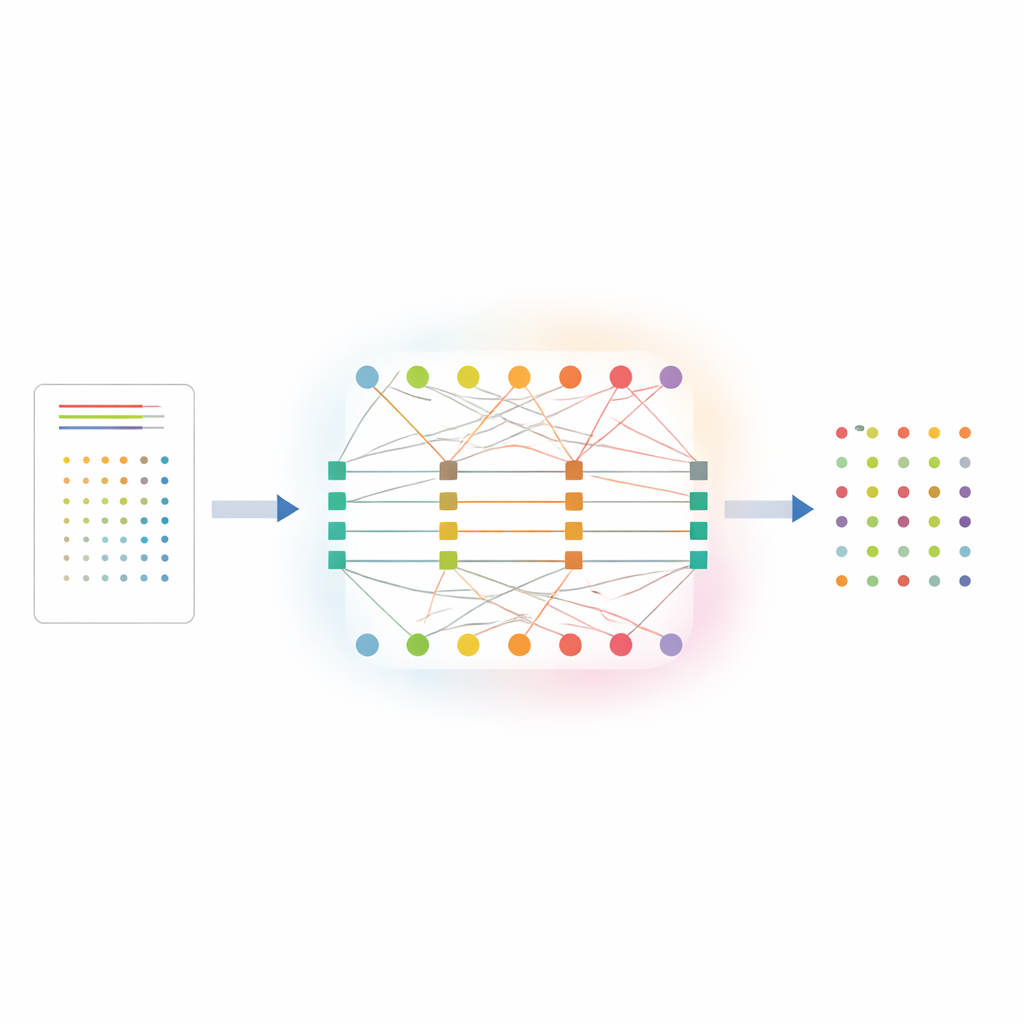

DCP‑ANは、各サンプルとそれが属するクラスの間で信頼度がどのように流れるべきかを明示的にモデル化することでこの問題に対処します。手法はサンプル層とクラス層の二層ネットワークとして関係を表現し、初期の予測強度を符号化した重み付きの結合でつなぎます。信頼度は二段階のやり取りを通じて洗練されます。第一段階ではサンプルからクラスへ情報が流れ、各クラスの予測の広がり方を現在の不確かさに基づいて調整します。第二段階ではクラスからサンプルへ情報が戻り、各サンプルの信頼度プロファイルを以前の推定とどれだけ整合しているかに応じて微調整します。この往復プロセスを限定回数繰り返すことで、例とラベルの間の“協調”を促進し、希少クラスが多数派にかき消されるのではなく、より明確な信号を得られるようになります。

必要な場所で調整を強める

DCP‑ANの重要な革新は、局所的および全体的な不確かさの状況に応じて信頼度の再形成をどれだけ強く行うかを変える適応的な「温度場」です。すべての予測に単一の温度値を使う代わりに、クラスとサンプルそれぞれについて不確かさや時間的な不一致の指標に基づく個別の調整強度を算出します。ネットワークが既に自信を持って扱っているヘッドクラスでは、実効温度を穏やかに冷却して過度の平滑化を防ぎ、鋭い区別を維持します。テールクラスやあいまいなサンプルでは温度が上がり、正当化される場合に彼らの信頼度を高め、誤ったスパイクを抑えるために強い補正を可能にします。こうした動的な振る舞いは、原理に基づく更新則から生じ、不確かさが増すと迅速に反応し、モデルが既に整合しているときは安定を保つことが示されています。

タスクやハードウェアを問わない確かな改善

著者らはDCP‑ANを複数の広く使われる画像データセットで慎重に評価しています。中には一部のカテゴリが他より何百倍も多いロングテール版のImageNetが含まれ、そこで本手法は希少なテールクラスの精度を約絶対値で10ポイント向上させ、標準的な較正誤差指標を未補正のベースラインと比べて半分以上削減しました。アートワークで訓練したモデルを実世界の写真に転送するクロスドメインテストでも、DCP‑ANは新しいドメインでの精度を高めると同時にソースとターゲットデータ間のギャップを示す統計量を低減しました。重要なのは、こうした利得が大幅な計算コストの増大を伴わない点です。最新のグラフィックスカード上で動作させた場合、遅延は1ミリ秒強の上乗せに過ぎず、追加メモリ量も0.5メガバイト未満に収まるため、リアルタイムやエッジデバイスでの実用性が保たれます。

日常のAIにとっての意味

平たく言えば、本研究はAIシステムをより賢くするだけでなく、自分が間違っている可能性があるときにそれをより自覚できるようにできることを示しています。例とカテゴリ間で信頼度情報を往復させ、変化する不確かさに応じてどれだけ積極的に自己修正するかを適応させることで、DCP‑ANは現実により一致する確率推定を提供します——希少な事象や分布が変わる状況でもです。反復更新が速やかに収束するという数学的保証が付与され、かつオーバーヘッドが最小限であるため、このフレームワークは医療、ロボティクス、セキュリティ監視などの既存のニューラルネットワークに組み込むことが可能です。その結果、AIは依然として誤りを犯しますが、自分がどれだけ確かなのかについてはるかに正直になるため、人が安全に頼れるシステムに近づきます。

引用: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

キーワード: 信頼度の較正, 深層ニューラルネットワーク, ロングテール認識, 不確かさの推定, ドメイン適応