Clear Sky Science · ja

AsynDBT: 大規模言語モデルによる効率的なインコンテキスト学習のための非同期分散二層チューニング

日常のAIにおいてプロンプトを賢くする意義

大規模言語モデルはチャットボット、検索エンジン、執筆支援など、多くの人が日常的に利用するサービスを支えています。しかし、有用な回答を得るには質問の言い回しやモデルに示す例の選び方に大きく依存します。本稿では、各ユーザーのデータを秘匿したまま、多数の端末にまたがってこれらのプロンプトや例を自動的に改良する新しい手法を紹介します。その結果、特に電気通信ネットワークの保守など専門的なタスクで、より正確かつ効率的に応答するAIシステムが得られます。

再学習ではなく例を見せて教える

巨大なモデルを常時再学習させる代わりに、プロンプト内でいくつかの選ばれた例を与えて「その場で」学ばせるインコンテキスト学習が注目されています。例えば、映画レビューを肯定・否定に分類する際、小さなラベル付き例をモデルに示してから新しいレビューのラベル付けを依頼します。しかし、例の選定や指示文の細かい表現が性能を劇的に左右するのが難点です。手作業で良い組み合わせを見つけるのは遅く高価であり、組織間で生データを共有することはプライバシー規制上不可能な場合も多いです。

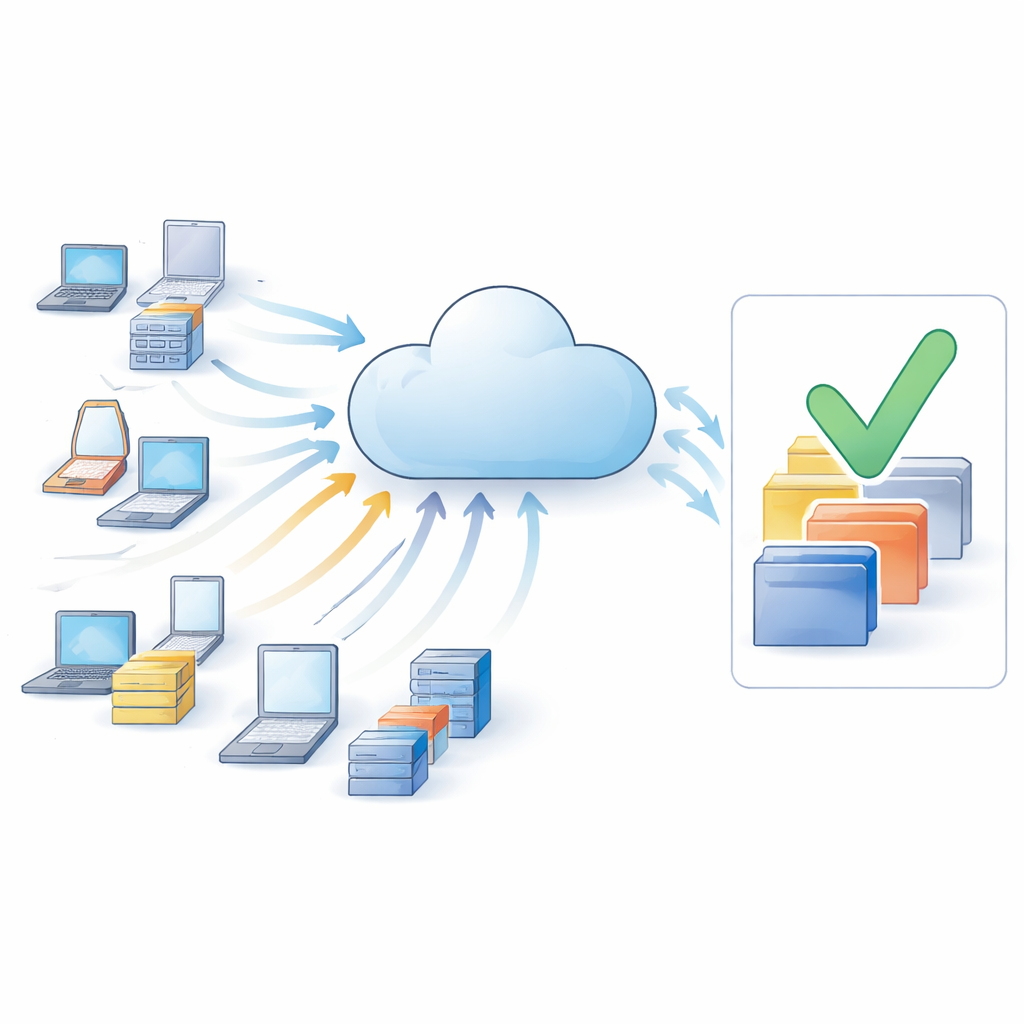

プライベートなデータを共有せずに協力する

データ共有の障壁を回避するために、著者らはフェデレーテッドラーニングの仕組みを利用します。これは多くの独立した端末や組織がデータを局所に保持しつつ、中央サーバーを介して協調する設定です。各ワーカー(例えば基地局や企業サーバー)は同じクラウド上の言語モデルとやり取りしますが、生のテキストはアップロードしません。代わりに、どのプロンプトや例の選択が有効かについてのフィードバック信号だけを返します。AsynDBT(非同期分散二層チューニング)と呼ばれる新しいアルゴリズムは、こうしたワーカーを調整して、プライバシーを守りつつ遅延や不安定な接続に対処しながら共有のプロンプト戦略を共同で改善します。

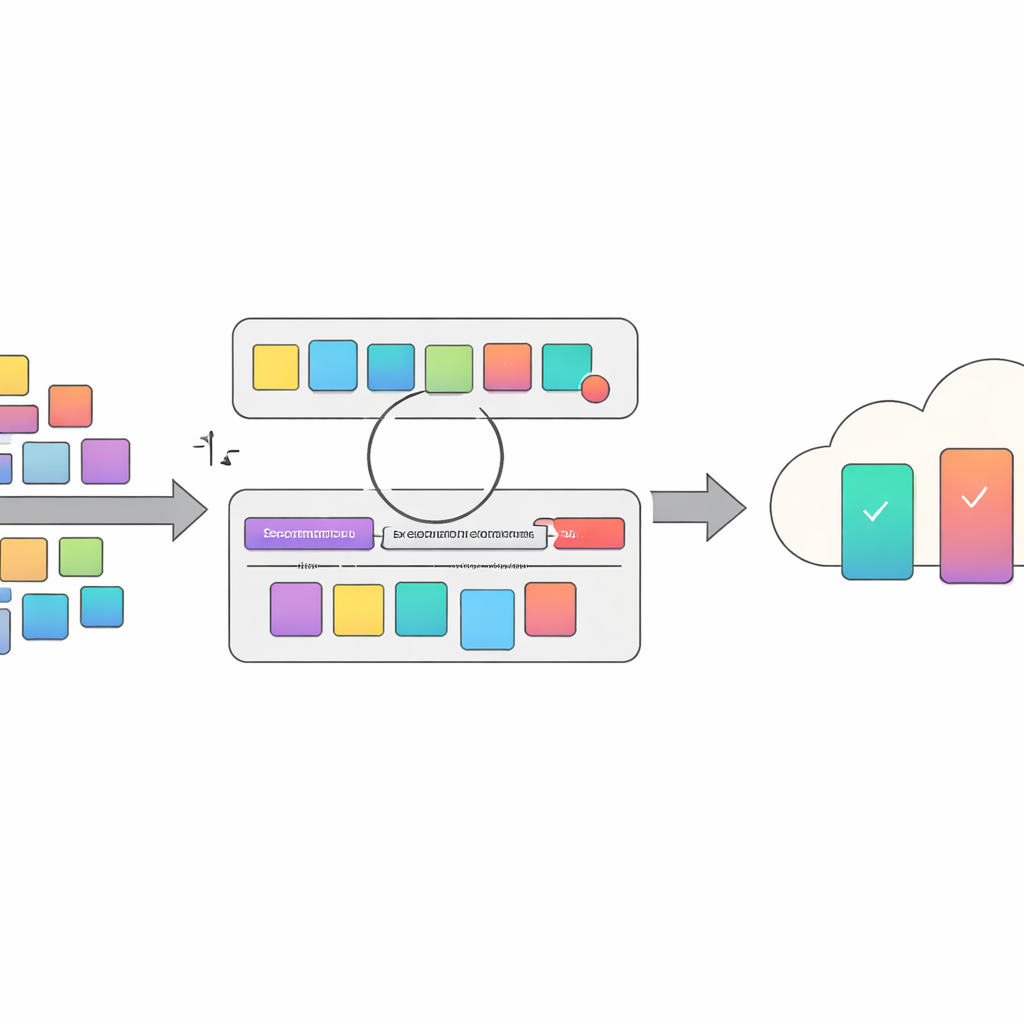

問いかけと例の両方を最適化する

本論文の重要な着想は、プロンプト設計を二層の最適化問題として扱うことです。下位層ではタスク指示に付加される短い文断片を微調整し、表現の小さな変化でモデルの推論を改善します。上位層では、どのラベル付き例をデモンストレーションとして含めるかを決定します。これら二つの層は相互に影響し合います:例の集合によって求められる文言が変わり、その逆もまた然りです。AsynDBTはこの関係を数理的に定式化し、効率的な近似手法を用いることで、各ワーカーが局所的な選択を徐々に更新する一方で中央サーバーが下位層の決定の一貫したグローバルな見解を保持できるようにします。

遅い端末や悪意ある参加者への対処

実際のネットワークでは、応答が遅れたり切断されたりする端末が存在し、同期型の学習を停滞させる“ストラグラー”が生じます。AsynDBTは代わりに非同期で動作し、サーバーは全員を待たずに一部のワーカーから報告があるたびに変数を更新します。本手法はまた、意図的あるいは誤送信による誤った更新を送るワーカーに対しても堅牢です。正則化技術とロバストな集約ルールを組み合わせることで、毒されたり低品質な例の選択がグローバル戦略に与える影響を軽減し、攻撃下でも全体のシステムを安定かつ信頼性のある状態に保ちます。

言語と電気通信タスクで実証された効果

研究者たちはAsynDBTを6つのテキスト分類課題で評価し、電気通信規格の断片だけを文脈情報として与え専門用語の関係性を判定するという難しい5Gネットワークのデータセットも含めました。既存の種々のプロンプト・例選択手法と比較して、新手法はほぼすべてのタスクで最高か2番目の精度を達成しました。特に5Gタスクでは、最強のベースラインと比べておよそ10パーセントポイントの精度向上を示しました。同時に、非同期設計により、分散させない類似の中央集権型手法と比べて学習時間を約40パーセント短縮できました。

将来のAIツールにとっての意義

非専門家向けの要点は、基礎モデルを変更せずに、より良いプロンプトと賢い例の選択がAIの振る舞いを大きく改善しうることです。AsynDBTは、多数の協調する端末にまたがってこれを自動化しプライバシーを保護する手段を提供し、電気通信運用やカスタマーサポートなどの専門領域でより正確かつ効率的な言語ツールを実現します。今後の展望として、著者らはグラフベースの知識検索と手法を統合し、プロンプトが最新の事実情報を参照できるようにして幻覚をさらに抑え、高リスクな場面でもAIアシスタントの信頼性を高めることを計画しています。

引用: Ma, H., Dou, S., Liu, Y. et al. AsynDBT: asynchronous distributed bilevel tuning for efficient in-context learning with large language models. Sci Rep 16, 9381 (2026). https://doi.org/10.1038/s41598-026-39582-5

キーワード: インコンテキスト学習, プロンプト最適化, フェデレーテッドラーニング, 大規模言語モデル, プライバシー保護型AI