Clear Sky Science · ja

報酬更新型GRPOを通じて大規模言語モデルの推論を別の大規模言語モデルで強化する

機械に考え抜くことを教える

今日の多くの言語モデルは会話や翻訳、質問応答をこなせますが、優れた数学の生徒や慎重な分析者のように「どのように考えたか」を見せる点ではまだ苦手です。本稿は、あるAIシステムを用いて別のシステムの推論能力を向上させる方法と、膨大な専門データセットを手作業で作らずにそれを実現する方法を探ります。金融、医療、科学研究といった分野でAIがより信頼できる存在になることに関心がある読者にとって、モデルに対して回答をより明瞭かつ一貫して説明させるための実践的な手順を示しています。

生の文書から教えられる例へ

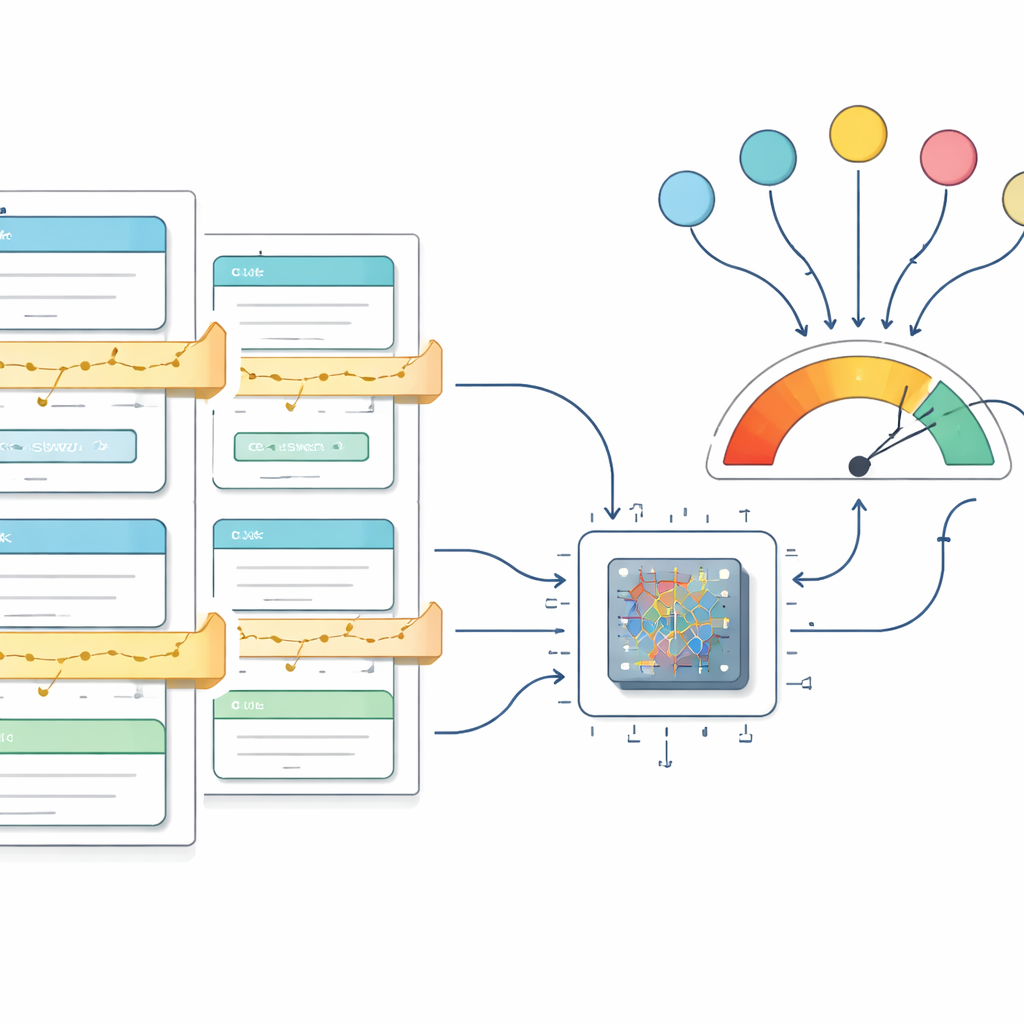

著者らは単純な観察から出発します:実世界の情報の多くは報告書、株主への手紙、ウェブページなどの形で散在しており、きれいな質問応答形式になっているわけではない。これを埋めるために、Huggify-Data と CoT Data Generator という二つのソフトウェアツールを導入します。これらのツールは非構造化テキストを取り、質問と回答のペアに自動で切り分け、強力な言語モデルにその間の推論ステップを補完させます。その結果、各例について「質問」「推論の連鎖」「回答」という構造化された三つ組が得られます。重要なのは、このパイプラインは学校の数学から企業の財務までほぼどんな領域にも向けられるため、大勢の人手アノテーターを必要とせずに推論重視の学習データを構築できる点です。

あるモデルが別のモデルをどう訓練するか

こうして作られた質問–推論–回答の三つ組は、小さめの「生徒」モデルに同じ構造的な思考を身につけさせるために使われます。生徒モデルには単に最終回答を出すのではなく、明確に区切られた説明と結論を順に生成するよう求められます。訓練は Group Relative Policy Optimization(集団相対方策最適化)と呼ばれる手法により導かれ、同じ質問に対する複数の候補応答を比較してより良い応答へとモデルを促します。論文はこれに、出力が望ましい形式に従っているかどうかを検査する追加の報酬項を加えて改良します。これは、よく整った参照例にどれほど近いかまで評価し、乱れた説明や不完全な説明にわずかなペナルティを与えることで、読みやすく解釈可能な回答へとモデルを押し進めます。

手法を試験する

この枠組みが実際に機能するかを確かめるために、著者らは二つの非常に異なるデータセットに適用します。第一は GSM8K で、小学生向けの文章題からなる多段階の算術推論を要する問題集です。第二はウォーレン・バフェットの年次株主への手紙を材料にして作られたもので、投資や企業判断に関する長文の推論を捉えることが目的です。いずれの場合もパイプラインは生テキストを構造化された学習データに変換し、中型のモデルである Qwen 2.5 をファインチューニングします。訓練中、正しく整形された応答には単純なスコアリングルールで報酬が与えられ、学習が進むにつれて平均報酬は着実に上昇し理論上の最大値で安定します。これは訓練データ上で目標とする振る舞いをモデルが大部分身につけたことを示しています。

改善されたモデルの実力

性能は「平均トークン正確度」で測定されます。これは大まかに言えば、モデルの出力に含まれる小さなテキスト片(トークン)が期待されるものとどれだけ一致するかの割合です。これは従来の合否式の採点とは異なりますが、説明と回答が正しい構造で生成されているかを評価するのに適しています。GSM8K では最良モデルが98.2パーセントのトークン正確度に達し、バフェットの手紙では98.5パーセントに達します。これらのスコアは同じ指標下で報告されている GPT-4 や Claude 3.5 Sonnet といった広く知られたシステムの数値を上回っており、しかも訓練に用いたのはわずか3ビリオンパラメータ級のモデルで、レンタルハードウェア上で二日未満で訓練可能でした。著者らは計算コストやハードウェア構成の詳細も共有し、調査や再利用のためにすべてのコード、モデル、データセットを公開しています。

日常的なAI利用にとっての意義

非専門家にとっての主な結論は、AIは単に答えるだけでなく、規律ある分かりやすい方法で答えるよう教えられるという点です。これは普通の文書から自動抽出したデータを用いることで可能になります。推論豊かな教師モデル、柔軟なデータパイプライン、正確性と明瞭性の両方を評価する報酬スキームを組み合わせることで、著者らは小さなモデルをより信頼できる問題解決者へと形作る方法を示しています。真の理解や安全性を問うより厳密なテストの必要性など限界も指摘されていますが、この枠組みは組織が自らの文書アーカイブを教育、金融など向けの透明で用途別のAIアシスタントに転用できる未来を示唆しています。

引用: Yin, Y. Use large language model to enhance reasoning of another large language model through reward updated GRPO. Sci Rep 16, 8360 (2026). https://doi.org/10.1038/s41598-026-39296-8

キーワード: 大規模言語モデル, チェーン・オブ・ソート推論, 報酬最適化, データキュレーション, ドメイン特化型AI