Clear Sky Science · ja

ハイル地域のコミュニケーションアクセシビリティを高める継続手話認識のための二重ストリーム深層学習フレームワーク

コミュニケーションの溝をつなぐ

多くの難聴者にとって手話は主要なコミュニケーション手段ですが、コンピュータや電話、公共サービスの多くはまだ手話を理解できません。本稿は、連続する手話の映像をより正確に書き言葉に変換できる新たな人工知能システムを提示します。手の動きだけでなく、頭の位置や顔の手がかりにも注意を向けることで、技術を用いたコミュニケーションをより自然で利用しやすくすることを目指しています。特にデジタル支援がまだ限られているサウジアラビアのハイル地域の難聴コミュニティに有益である可能性があります。

なぜ手だけでは不十分なのか

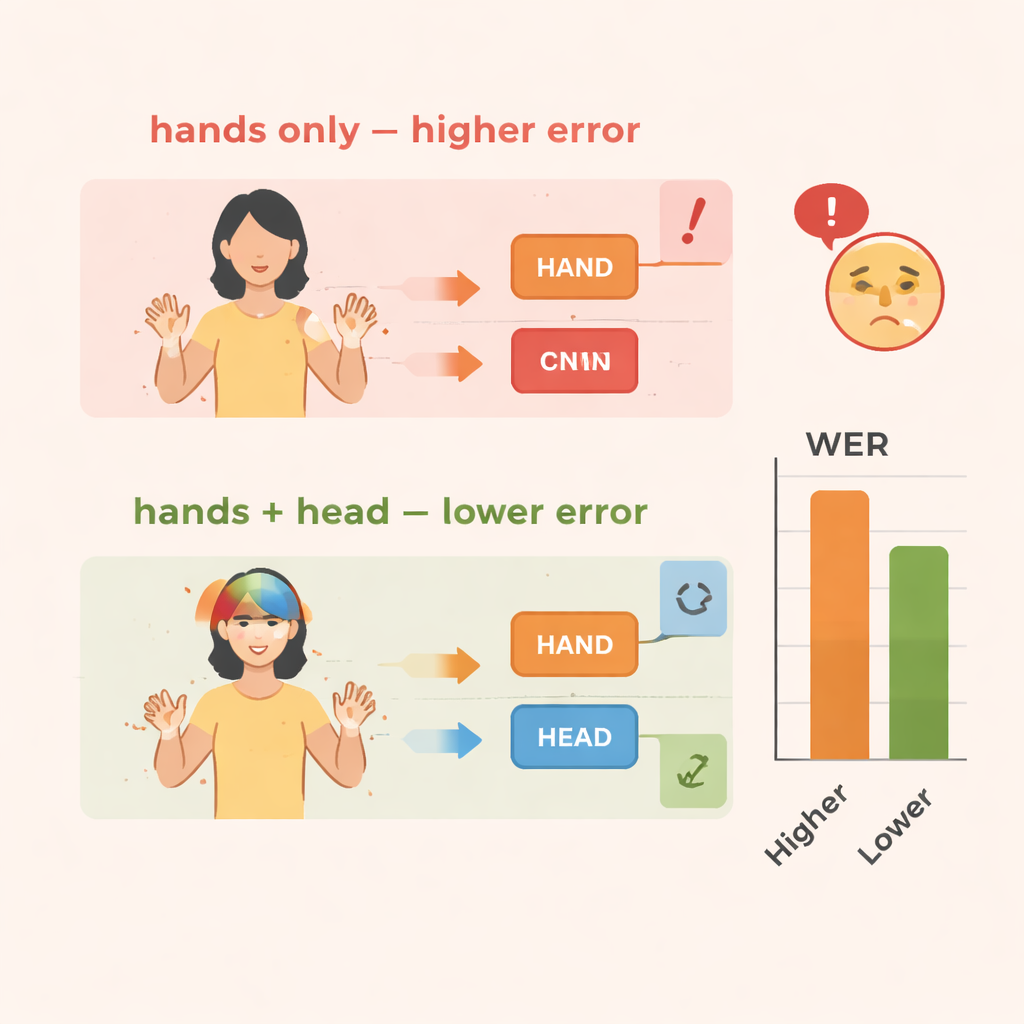

手話は上半身全体を使う豊かで複雑な体系です。意味は手の動きだけでなく、表情、視線、頭の傾きや頷きといった要素からも生まれます。これら非手部の信号は、疑問、否定、強調、感情などを示します。人間はこれらすべてを難なく読み取れますが、多くの手話認識システムはほとんど手の情報にだけ注目します。その近道は学習を単純化しますが、特に単語ごとに区切られず高速で連続する文脈では重要な手がかりが失われがちです。

並列で働く二つのストリーム

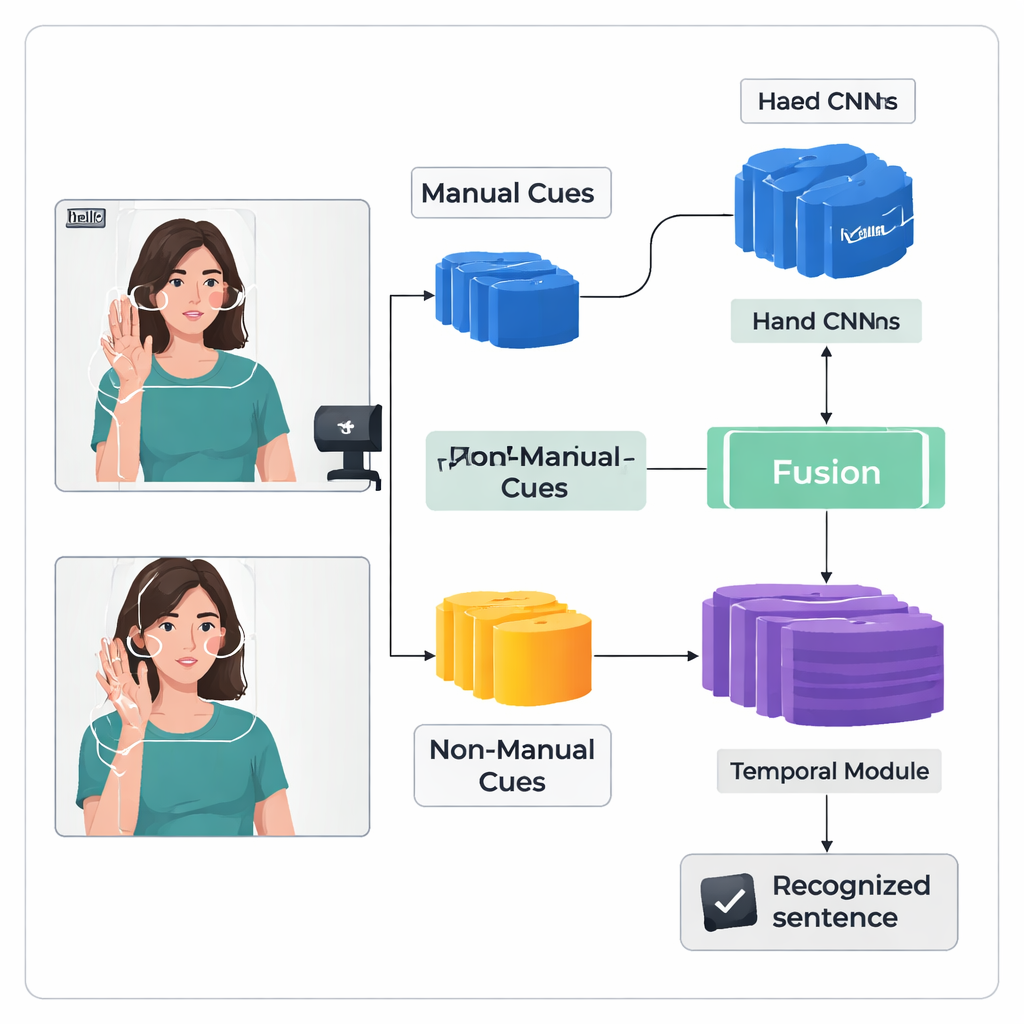

著者らは、手と頭部を別々に処理し、それらを統合する「二重ストリーム」深層学習フレームワークTS-CNNを導入します。一方のストリームは切り出した手の画像に着目し、形状、動き、位置のパターンを学習します。もう一方のストリームは、ランドマーク点や頭部姿勢推定から得られる顔・頭部のコンパクトなマップを入力として受け取ります。両ストリームは各ビデオフレームを数値的特徴に変換する標準的なビジョンネットワークを用います。その後、システムはフレームごとにこれらの特徴を融合し、手と頭部の手がかりが同時に現れるという事実を尊重します。続く時間的モジュールは多くのフレームを横断して手話が時間的に展開する様子を理解し、再帰層が予測された手話単位(グロス)の系列を出力します。

手話の記憶を鋭くする

連続手話の認識は、訓練データが限られ、フレームごとの明確なラベルがないため難しい課題です。これに対処するために、著者らは訓練中にネットワークに追加の指導を与える特徴強調モジュールを導入します。広く使われている手法は、予測されたグロス列を映像に整列させ、各グロスの時間的な起こり得る位置を算出します。この新しいモジュールはその整列結果を取り、それを直接的な教師信号として使い、グロス特徴の内部表現を洗練させます。簡単に言えば、システムは正しい系列を出力するだけでなく、各手話が異なる映像にわたってどのように見えるかについて、より明確で一貫した内部の“記憶”を構築することを学びます。

手法の実証

チームはTS-CNNを二つのよく知られた手話データセットで評価しています:ドイツ手話用のRWTH-PHOENIX-Weather 2014と中国手話用のCSL Split IIです。評価には音声認識でも使われる標準的な指標である単語誤り率を用います。手の動きだけを見たベースラインと比べ、頭部姿勢情報を加えることでドイツ語データで約4ポイント、中国語データで約3–4ポイントの誤り率削減が得られました。さらに特徴強調モジュールを加えると、両データセットで全体的に約10–14%ほど誤り率がさらに低下する大きな改善が得られます。システムはまた効率的に動作し、最新のグラフィックスプロセッサでリアルタイム速度に達するため、ライブ通訳やモバイルツールでの利用にとって重要な条件を満たします。

日常生活への意味

日常的な観点から言えば、本研究はコンピュータが話者の全体を観察した場合に手話をより確実に理解できることを示しています。手の動きと並んで頭の動きや表情をモデル化し、限られた訓練データからの学習方法を丁寧に改善することで、TS-CNNフレームワークは教室、病院、公共機関で難聴者を支援しうる実用的なシステムに近づきます。人間の通訳が不足し、技術プロジェクトがまだ発展途上にあるハイルのような地域では、このようなシステムが最終的により包括的なコミュニケーションを支援し、手話の豊かで人間的な体験を置き換えることなく、手話使用者と聴者の間の溝を埋める手助けになる可能性があります。

引用: Harrouch, H., Guesmi, H., Alalfy, H. et al. A dual-stream deep learning framework for continuous sign language recognition to enhance communication accessibility in the Ha’il region. Sci Rep 16, 7070 (2026). https://doi.org/10.1038/s41598-026-38912-x

キーワード: 手話認識, 深層学習, アクセシビリティ, コンピュータビジョン, ヒューマン・コンピュータ相互作用