Clear Sky Science · ja

データストリーム向け動的グラスホッパー強化ニューラルネットワークによるインテリジェントな漸進的分類

常に変化するデータが重要な理由

電力網や工場からオンライン決済まで、現代のシステムは毎秒データを吐き出しています。これらの連続したデータストリームには、設備の故障、サイバー攻撃、あるいは価格急騰の初期警告といった兆候が潜んでいます。問題は、この情報の流れが止まらず、時間とともに挙動が変化し続けることです。本稿で要約する論文は、ネットワークがこうしたライブデータから学び続けられるようにニューラルネットワークの訓練法を改良し、処理速度や精度を落とさずに現実世界の監視や意思決定に役立てられる新しい手法を紹介します。

一度きりの訓練の限界

従来の多くの機械学習モデルは「バッチ」学習で訓練されます。エンジニアが大量の過去データを集めてモデルを調整し、デプロイするという流れです。世界が大きく変わらないならこれで十分ですが、産業現場では条件が変動します——需要パターンの変化、センサーの劣化、市場の変動など。時間で固定されたモデルは徐々に新しいパターンに対応できなくなり、増え続けるデータでゼロから再訓練するのは時間とコストがかかります。グリッドサーチや進化的アルゴリズムのような自動チューニング法も固定データを前提としているため、データ分布が変わるたびに再起動する必要があり、常時稼働のシステムでは実用的ではありません。

その場で学習するニューラルネットワーク

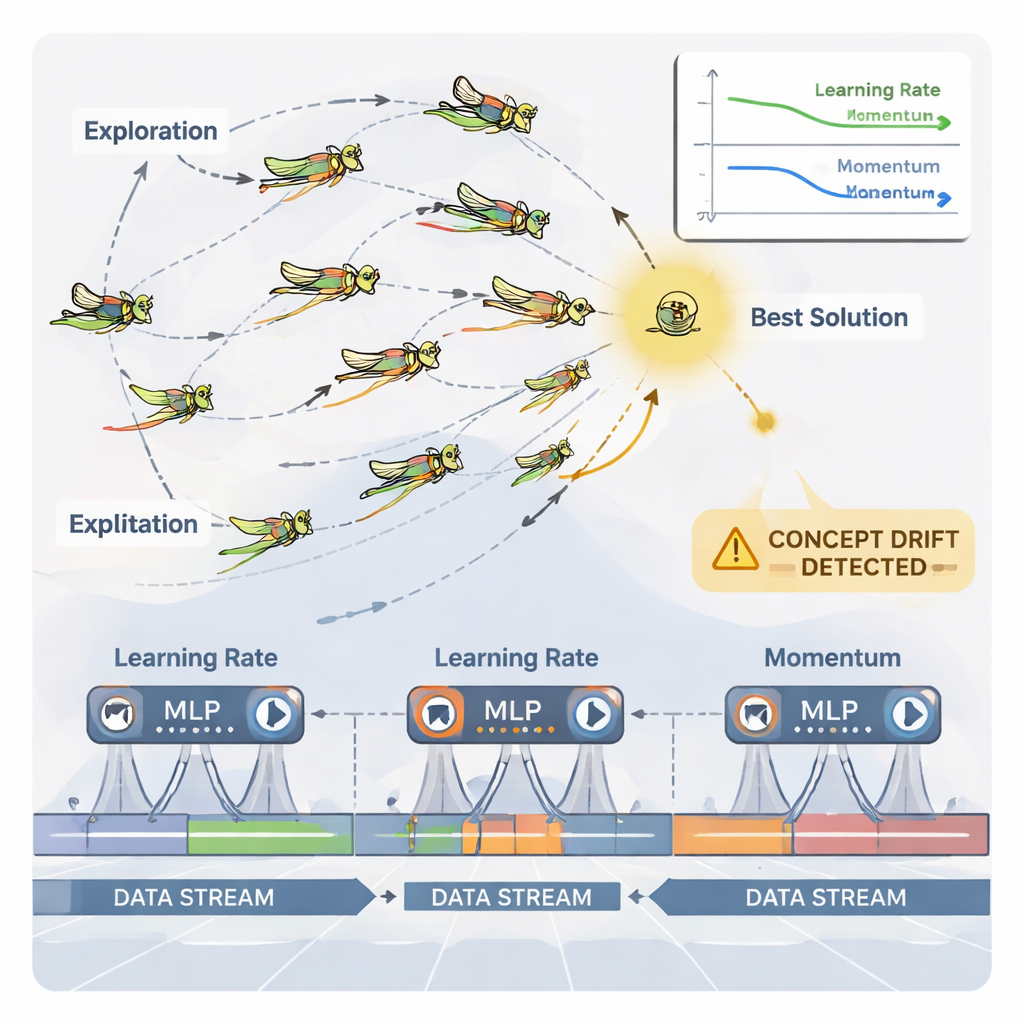

著者らは多層パーセプトロン(MLP)を中心に据えた漸進学習フレームワークを提案します。全過去データを一度に与える代わりに、到着するデータストリームを扱いやすいウィンドウに分割します。各ウィンドウは小さな訓練ステップとなり、ネットワークの内部重みが更新された後に破棄される——メモリ使用量を低く保つ「学習して忘れる」戦略です。重要なのは、システムが固定の訓練設定に依存しない点です。学習率(各更新の大きさ)とモーメンタム(更新の滑らかさ)という学習挙動を左右する2つの主要パラメータを、ストリームの変化に合わせて継続的に調整し、応答性を保ちつつ不安定にならないようにします。

パラメータ調整の賢い手法としてのグラスホッパー

この継続的な調整を実現するために、論文は自然界にヒントを得た最適化手法である動的グラスホッパー最適化アルゴリズム(DGOA)を採用しています。学習率とモーメンタムの組み合わせを探索する仮想的なバッタの群れを想像してください。序盤では広く動き回って良い領域を探し、後半では動きを絞って有望な選択を洗練します。この動的版では、ステップサイズや最良解への引力がネットワークの性能に応じて時間経過で変化します。さらにシステムは「概念ドリフト」──予測誤差やデータ自体の急激な変化──を監視します。ドリフトが検出されると、一部のバッタをリセットして一時的にステップを大きくすることで、新しい領域を素早く探索し、古い設定から脱出できるようにします。

手法の実証

研究者らはオーストラリアの実際の電力市場データセットで手法を評価し、価格が上がるか下がるかを予測することを目標にしました。グリッドサーチ、ランダムサーチ、粒子群最適化、遺伝的アルゴリズム、アントコロニー最適化、標準的なグラスホッパーアルゴリズムと比較して、動的なバージョンを漸進学習と組み合わせた手法は、計算時間と反復回数を抑えつつ最も高い精度(約89.5%)を達成しました。追加実験でも、この方法は安定したストリームと変化するストリームの双方にうまく適応し、数千から数十億のサンプルへスケールしながらメモリを抑え、予知保全、異常検知、不正検出といったタスクや標準的な数理最適化ベンチマークでも競争力のある性能を示しました。

実務上の意義

非専門家向けにまとめると、本研究はデータが止まらず状態が絶えず変わる環境でニューラルネットワークを「生きた」状態に保ち、良好にチューニングし続ける手段を提供します。システムを何度も停止してモデルを作り直す代わりに、軽量なネットワークがウィンドウごとに自己更新を行い、群ベースの最適化器が学習の速さと滑らかさを継続的に調整します。その結果、新しいパターンへの迅速な適応、長期的な精度の向上、計算資源の効率的な利用が得られ、エネルギー、製造、金融といった分野での信頼できるリアルタイム意思決定にとって重要な要素となります。

引用: Darwish, S.M., El-Shoafy, N.A. Intelligent incremental classification using a dynamic grasshopper-enhanced neural network for data streams. Sci Rep 16, 7730 (2026). https://doi.org/10.1038/s41598-026-38571-y

キーワード: データストリーム, 漸進学習, ニューラルネットワーク, ハイパーパラメータ最適化, 群知能