Clear Sky Science · ja

隠れた状態脅威モデルにおける差分プライバシー付き確率的勾配降下法の厳密なプライバシー監査

日常の技術にとってなぜ重要か

現代のアプリは、写真やメッセージから医療記録まで、私たちのデータから絶えず学習しています。こうした学習を安全に保つ主要な手法の一つが差分プライバシーで、個々人のデータが目立たないように慎重に調整されたノイズを加えます。しかし、今日使われる深層ニューラルネットワークに対してこれらの保護が実際に機能しているかをどう確かめればよいでしょうか。本論文はその問題を掘り下げ、モデルの「学習の記録(トレーニングムービー)」を隠すことがいつプライバシーに有効か、あるいはそうでないかを示します。

プライベート学習はどう機能するはずか

差分プライバシー付き確率的勾配降下法(DP-SGD)は、プライバシー保護付き機械学習の実務的な中核アルゴリズムです。小さなバッチごとにモデルを段階的に学習させ、各ステップの勾配(改善の方向)をクリップし、モデルを更新する前にランダムなノイズを加えます。理論は、最終モデルに対して個人のデータがどれだけ影響を与え得るかの上界を提供し、しばしばイプシロンと呼ばれるプライバシー指標で要約されます。同時に「プライバシー監査」は訓練済みモデルを攻撃して、実際にどれだけの情報が抽出できるかを調べます。理論と監査が一致すればプライバシーの評価は信頼でき、不一致であれば重要な見落としがあることになります。

最終モデルだけが公開されると何が変わるか

これまでの多くの監査は、トレーニング中のすべての中間モデルチェックポイントを見られる強力な攻撃者を想定していました。実際には、多くの組織が公開するのは最終モデルだけで、学習履歴全体は公開しません。このより現実的な設定を隠れた状態(hidden state)脅威モデルと呼びます。最近の理論的研究は、少なくとも単純な凸問題においては、中間モデルを隠すことが時間とともにプライバシーを増幅する可能性があると示唆しました。つまり、学習の早期に使われたデータの影響が後のノイズの更新によって“洗い流される”という考え方です。しかし、現代の深層学習は非常に非凸的なモデルに依存しており、損失面は起伏に富んで複雑です。同じ増幅効果がそこで本当に起きるのか、あるいは既存の攻撃手法が単に実際のプライバシー損失を暴くには弱すぎたのかは不明でした。

攻撃者がモデルを押し進める新しい方法

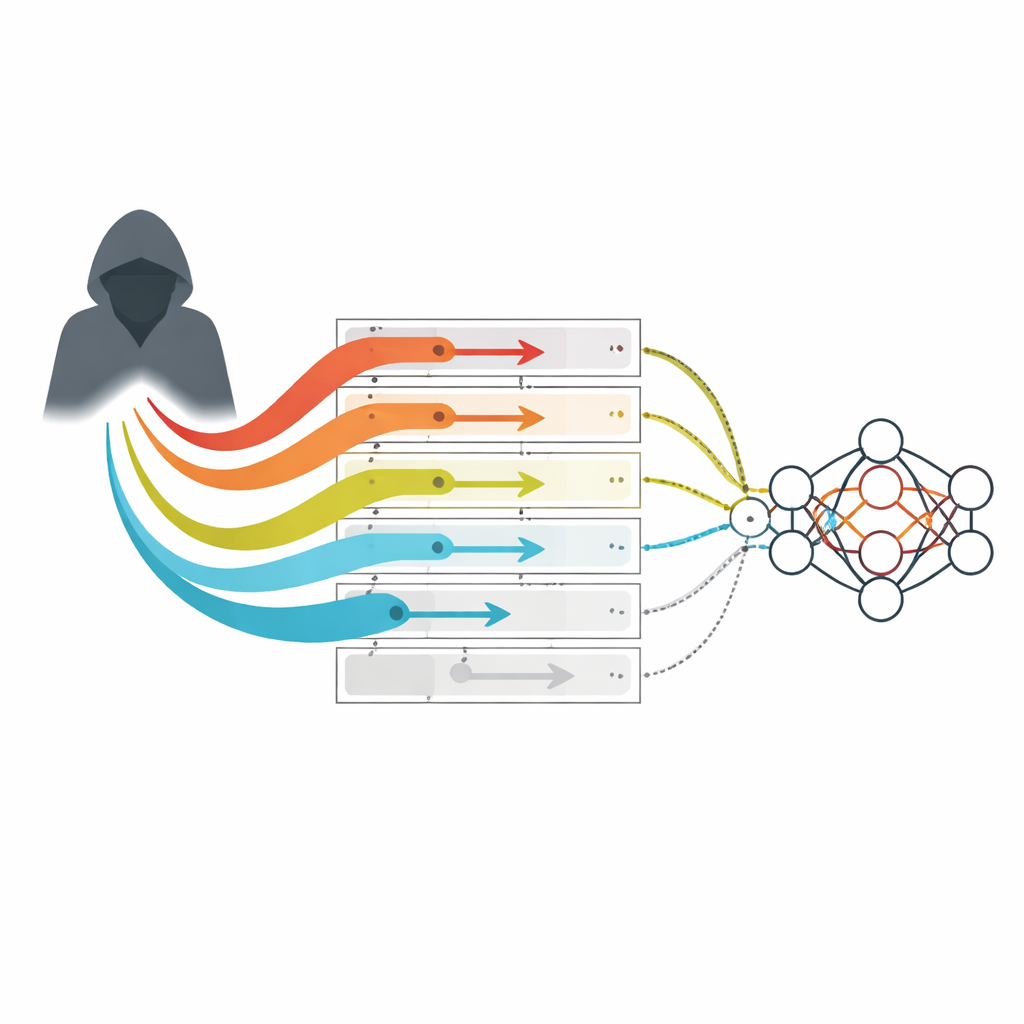

著者は隠れた状態モデルに特化した「勾配構築(gradient-crafting)」攻撃者の新しい族を導入します。従来の損失ベースの攻撃が特別なデータ点を設計し、その損失が学習中にどう変わるかを観察するのに対して、これらの攻撃者は最悪のデータ点が存在した場合に適用されるであろう勾配の列を直接指定します。彼らは常にクリップ閾値に達するような勾配を選び、あまり更新されないパラメータ方向と整合させることで、中間モデルを見られなくてもその影響を検出しやすくします。研究では二つの単純な変種を調べています:ランダムにパラメータ方向を選ぶものと、トレーニング過程をシミュレートして最も更新されにくい方向を見つけ、そこに強力で繰り返しの勾配を注入するものです。

実験が示す実際のプライバシーリスク

このフレームワークを用いて、本論文は畳み込みネットワークや残差ネットワークなどの一般的なアーキテクチャや、小さな全結合モデルを用いた画像および表形式データセット上でDP-SGDを監査しています。構築した勾配を毎回のトレーニングステップで使うと、新しい攻撃者は中間モデルを見ないにもかかわらず理論上の厳しいプライバシー上界に匹敵しました。これは極端な場合において、中間チェックポイントを隠しても追加のプライバシーは全く得られないことを意味します。一方、構築した勾配を挿入する頻度を下げると状況は変わります:ノイズ量に比べてバッチサイズが大きい場合は監査結果は理論に近く(増幅効果は小さいことを示唆)、しかしバッチが小さくノイズが大きい場合にはギャップが現れ、非凸設定で実際のわずかなプライバシー増幅が存在することを示します。

最悪ケースの限界を覗く

隠れた状態モデルにおけるプライバシーの絶対的限界を理解するために、論文は勾配を構築するだけでなく、特別なデータ点の影響を反復を通じて保持するための損失ランドスケープ全体を設計するより極端な理論的攻撃者も研究します。この制御された設定では、結果は二つの領域を明確に分けます:バッチサイズが大きい場合、標準理論に基づくプライバシー評価は事実上タイトである一方、バッチが小さくノイズが大きい場合は、データ点に関する初期情報が時間とともに部分的に忘れられます。重要なのは、この増幅効果は単純な凸問題で知られているものより弱く、プライバシーリスクを完全に消し去ることは決してない点です。

利用者と実務者にとっての意義

非専門家に向けた結論は、深層学習モデルの学習履歴を単に隠すだけでは劇的に強いプライバシーが保証されるわけではないということです。ある人のデータが学習中に非常に頻繁に使われる場合、そのリスクは現在の保守的な理論が既に予測しているものに近いです。より有利な条件、すなわち小さなバッチと十分なノイズがある場合にはいくらかの追加保護は得られますが、それは控えめでリスクをゼロにするほどではありません。これらの発見は既存のプライバシー評価の一部を裏付けると同時に、その限界を浮き彫りにし、最終モデルのみが共有される状況でDP-SGDがどの程度の保護を提供できるかについて、より明確で現実的な見通しを示します。

引用: Bhuekar, A. Tighter privacy auditing of differentially private stochastic gradient descent in the hidden state threat model. Sci Rep 16, 8365 (2026). https://doi.org/10.1038/s41598-026-38537-0

キーワード: 差分プライバシー, DP-SGD, プライバシー監査, 機械学習のセキュリティ, 隠れた状態モデル