Clear Sky Science · ja

クエリ効率の高い意思決定ベースの敵対的攻撃 — 低クエリ予算での手法

なぜごく小さな画像の乱れが高度な機械をだますのか

現代の人工知能は、顔や動物、日常品を驚くべき精度で認識できます。しかし、同じシステムは、人間にはほとんど見分けられないほど微小な画像の変化によって簡単に誤認識されることがあります。本稿は、AIに対する問い合わせ数を極力抑えつつそのような「だます」画像を作る新たな手法を検討し、現行モデルの脆弱性と現実世界で攻撃者がどのようにそれを悪用しうるかを明らかにします。

攻撃者は外部からどのようにAIを探るか

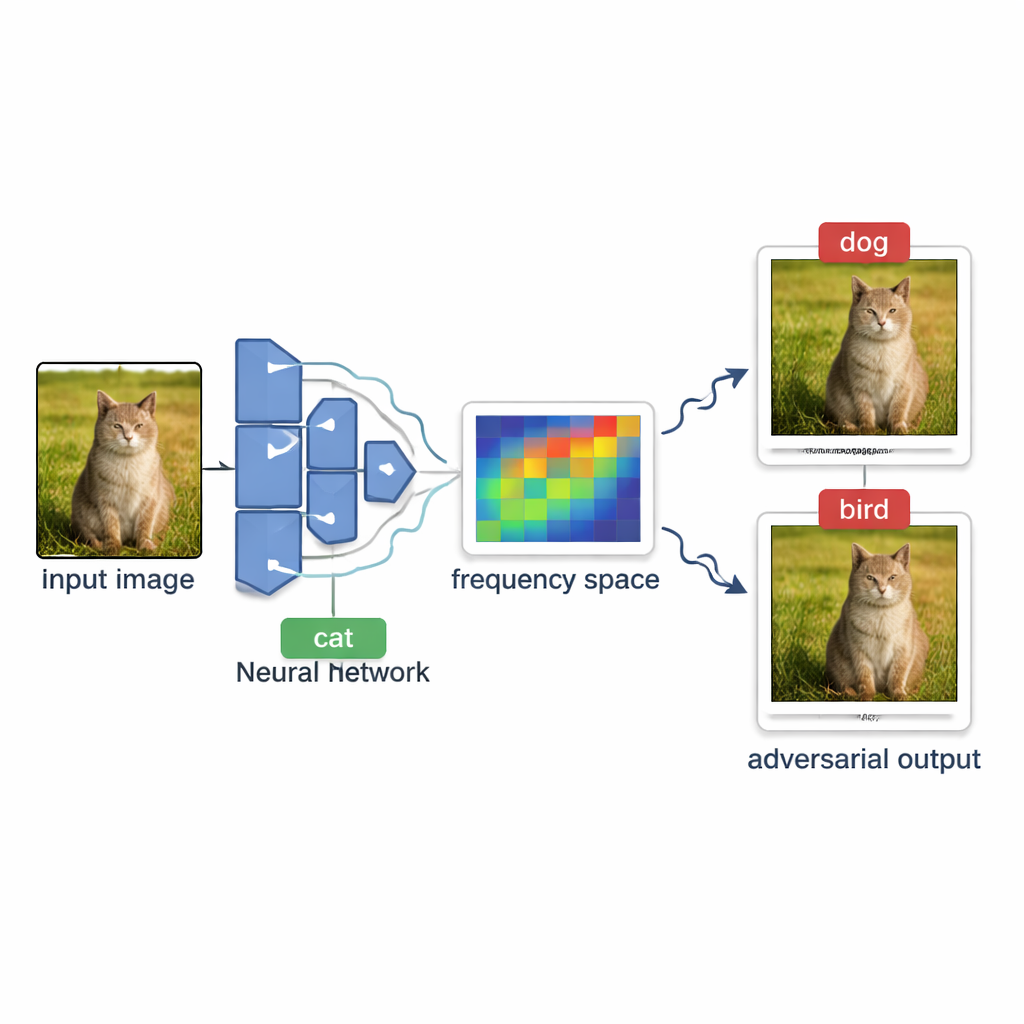

オンラインの写真タグ付けやコンテンツフィルタなど多くの実サービスでは、モデルはブラックボックスのように振る舞います。外部の利用者は画像をアップロードして最終的なラベル(たとえば「犬」や「一時停止」など)しか受け取れず、内部の信頼度スコアやモデル構造を見ることはできません。このような条件下で誤認させる画像を作る攻撃は「意思決定ベースのブラックボックス攻撃」と呼ばれます。課題は、モデルが誤ラベルを返すまで元の画像を慎重にずらしていくことですが、どの程度で判断が変わるかを確認できないうえ、試行回数を増やしすぎるとシステムに気づかれたり問い合わせコストが膨らんだりする点にあります。

ごく少ない問合せで探索する新手法

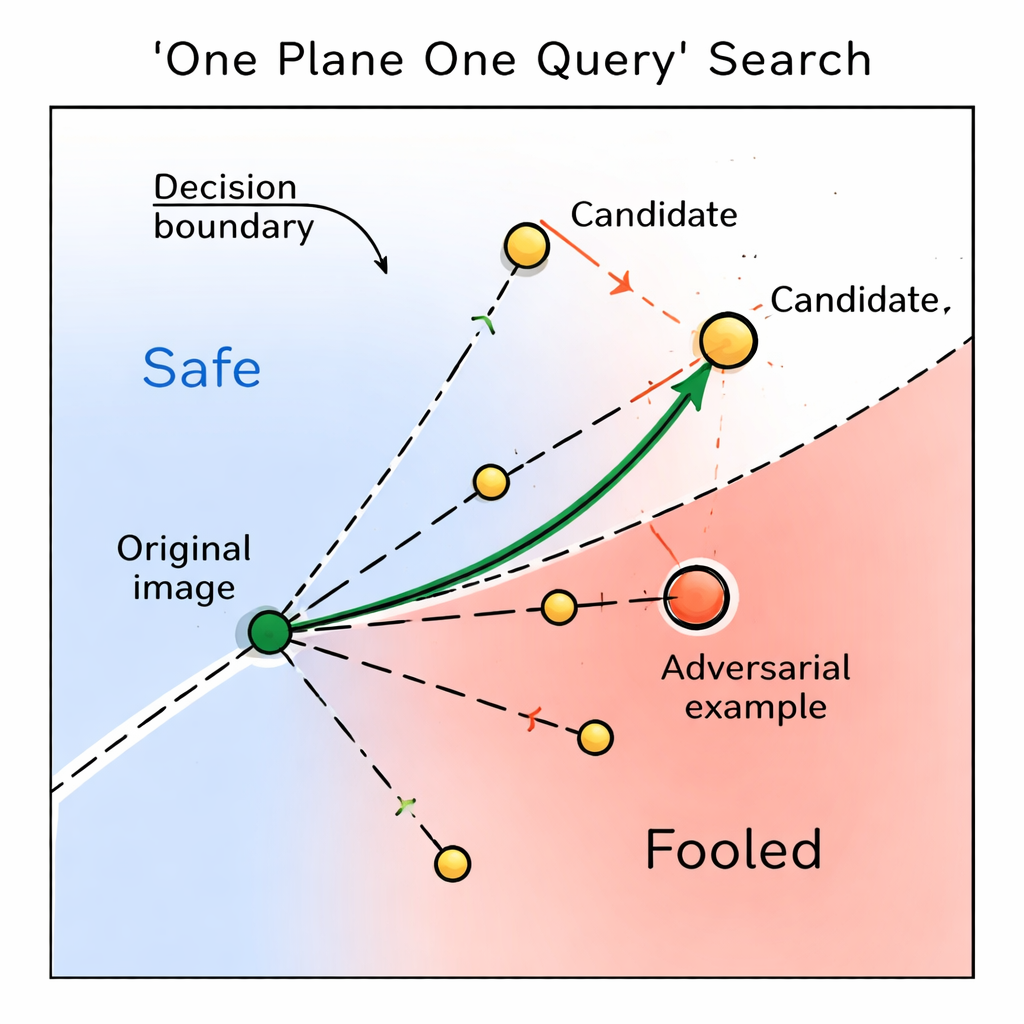

著者らはOPOQA(One Plane One Query Attack)を提案します。これはクエリを節約しつつ高品質な敵対的画像を生成することを目指した手法です。単一の推定方向を何度も試す代わりに、OPOQAはラウンドごとに動きます。各ラウンドでは、既に誤認させている画像と元のクリーンな画像を出発点とし、慎重に選んだ複数の方向に沿った新しい候補画像を提案します。重要なのは、各方向に対して最大1回しか問い合わせを行わない点で、これにより限られたクエリ予算を一つの推測に磨きをかけるよりも多くの可能性の探索に振り向けられます。

画像のなめらかな波をたどる

有望な方向を選ぶために、OPOQAは有効で目立ちにくい変化がしばしば鋭いピクセルノイズではなく、なめらかで広がりのある変化であるという考えに依拠します。手法は離散コサイン変換という数学的道具を用いて画像を「周波数」空間に移し、ゆっくり変動する穏やかな成分がコンパクトにまとまる領域を扱います。その領域から低周波成分をいくつかランダムにサンプリングし、それを通常のピクセル変化に戻して探索の基底方向とします。各サンプル方向は元画像、現在の敵対的画像、新しい候補を結ぶ平坦な二次元面を定義するのに役立ちます。その面上でOPOQAは一つの点を試し、元画像に近づきつつもモデルを誤判断へ導く可能性を両立させます。

最良候補の選択と動的な適応

OPOQAが少数の候補画像を生成したら、それぞれが元画像からどれだけ離れているかを測って、変化の小さい順に並べます。並べた順でモデルに問い合わせを行い、モデルが誤分類した候補を見つけた時点で探索を止め、その画像を次ラウンドの出発点とします。もしどの候補もモデルをだませなかった場合は、これまでの最良の敵対的画像を維持しつつ、次の一連のステップの保守性・攻撃性を調整する内部パラメータを更新します。この「貪欲」戦略—入手可能な誤分類画像を常に受け入れ、ステップサイズを動的に調節する—により、有望でない方向にクエリを浪費することなく、微妙で効果的な摂動へと攻撃を集中させられます。

実験が示すAIの弱点

研究者らはImageNetの大規模データセットから200枚の画像と、Inception-v3、ResNet、VGG、DenseNet、Vision Transformerを含む6種類の広く使われるニューラルネットワークでOPOQAを評価しました。画像あたり1,000クエリという厳しい制限下で、OPOQAは複数の最先端手法に匹敵するか上回る成績を示しました。たとえばInception-v3では、ほとんど人間の目に分からないほど小さな変化で94%の画像を誤認させ、従来の最良法を数ポイント上回りました。全体としてOPOQAは少ないクエリで高い成功率に早く到達する傾向がありましたが、非常に大きなクエリ予算と微調整の時間が与えられると一部の競合手法が追いついたり上回ったりすることもありました。

日常のAI安全性にとっての意味

この研究は、攻撃者が最終的な判断のみを見られ、探査の機会が限られている状況でも現行の視覚系がだまされうることを示しています。なめらかで低周波の変化を賢く探索し、各クエリを慎重に配分することで、OPOQAは人間には同じに見えるが機械を大きく誤誘導する画像を作り出せます。専門外の読者にとっての要点は、AIの「視覚」は依然として脆弱であり、気づきにくい形で容易に逸脱させられるということです。こうした効率的な攻撃を認識し研究することは、監視カメラ、医用画像ツール、自動運転車などの実システムを、見逃されがちな操作から守るための重要な一歩です。

引用: Tuo, Y., Yin, M. & Che, S. Query-efficient decision-based adversarial attack with low query budget. Sci Rep 16, 6886 (2026). https://doi.org/10.1038/s41598-026-38428-4

キーワード: 敵対的事例, ブラックボックス攻撃, ディープラーニングの安全性, 画像分類, クエリ効率の高い攻撃