Clear Sky Science · ja

認知モデルは潜在的な動機のリアルタイム推論を助ける

隠れた目的を推測することが重要な理由

日々、あなたは周囲の人々の意図を無意識に読み取っています――ドライバーが車線を変えようとしているのか、自転車に乗る人が止まるのか、同僚が助けようとしているのか競争しているのか。こうした一瞬の判断は、目に見える動きから隠れた動機を解釈することに依存します。現在の人工知能は予測精度が極めて高いことがありますが、なぜその決定に至ったのかを説明できない“ブラックボックス”になりがちです。本研究は、人間の行動に関する心理学的モデルがAIにより人間らしい他者の動機理解を与え、推論をより迅速で正確にし、信頼しやすくできるかを問います。

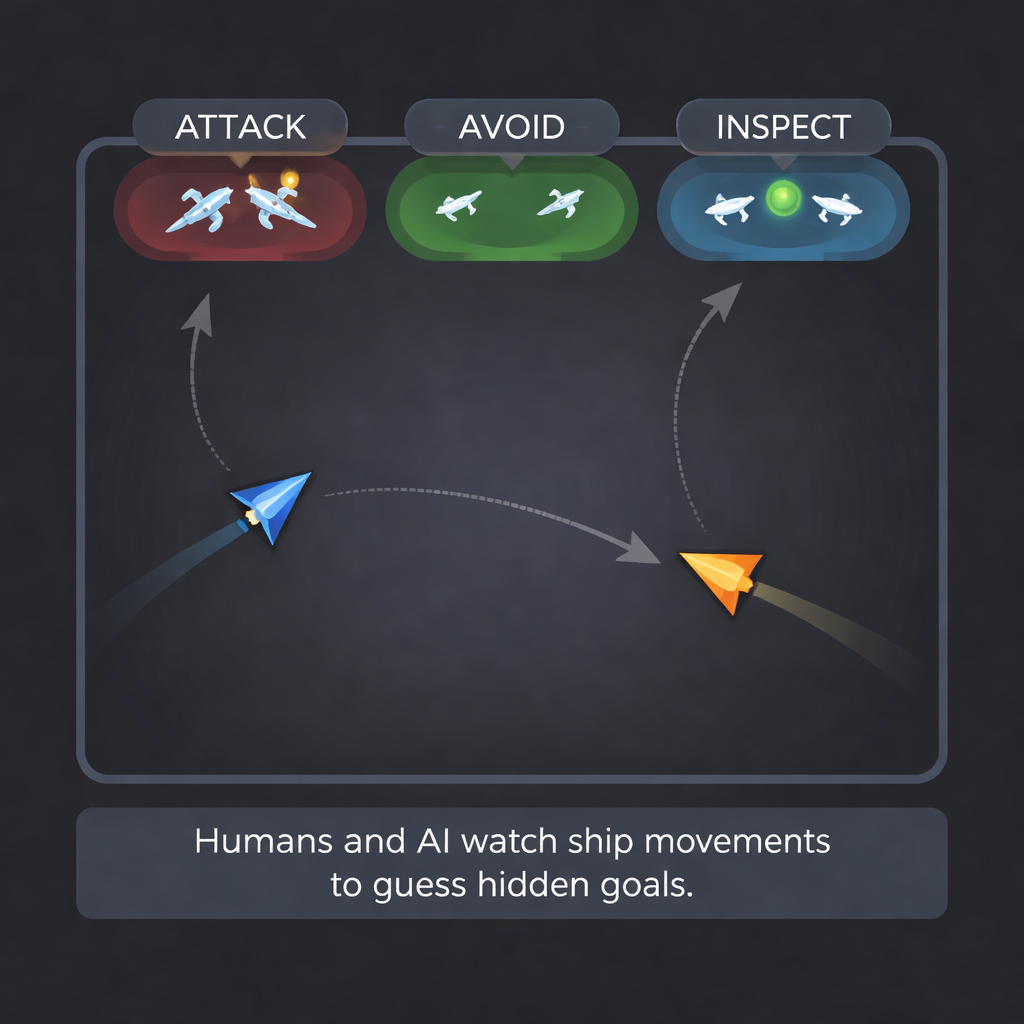

追跡と回避のシンプルなゲーム

これを調べるために、研究者たちは簡素化したビデオゲームを作りました。各ラウンドは10秒で、人間のプレイヤーはジョイスティックで三角形の「船」を操作し、コンピュータ制御の船は複数のパターンのいずれかに従って動きます。人間プレイヤーには密かに三つの目標のいずれかが割り当てられていました:攻撃(相手の船に衝突する)、回避(遠くにいる)、または観察(衝突せず近くにいる)。コンピュータの船は攻撃的、内気、好奇心旺盛、防御的、あるいはただ徘徊するなどの行動を取り得ます。これらの組み合わせにより、船の動きが一致する場合や対立する場合が生じます――例えば、攻撃的な人間が逃げようとする内気なコンピュータを追うような状況です。

人間が隠れた目標をどれだけ読み取れるかの測定

最初のステップは、人々が動きからどれだけ動機を読み取れるかを明らかにすることでした。研究チームは成績上位8人の操縦者のゲームプレイを取り、それぞれのラウンドを短い映像に変換しました。新しい被験者はこれらのクリップを見て、1秒、4秒、7秒、または10秒の動きを見た後に人間プレイヤーの目標(攻撃、回避、観察)を推測しました。自閉症の診断の有無を含む複数のグループを通じて、人々は約3分の2の確率で正しく目標を特定しました。視聴時間が増えるにつれて正確さは上がり、グループ間で性能は類似しており、比較のための堅実な人間のベンチマークが得られました。

動きのための心理学的設計図

生の映像のようなデータをそのままニューラルネットワークに入れる代わりに、著者たちは人の動きを駆動する力を捉える認知モデルを構築しました。彼らの「グローバル・ローカル目的追求(GLOP)」モデルは、プレイヤーが同時にいくつかの引きにバランスを取ると仮定します:相手との望ましい距離を保つこと(近すぎると危険に感じ、遠すぎると機会を逃す)、画面上で隅に追い込まれないよう良い位置を保つこと、相手の速度や方向に合わせるまたは予測すること。これらの要素は一つの“動機的”な移動方向に統合され、加えて人がどれだけ滑らかに動くかや操作にどれほどランダム性があるかを反映する項が加えられています。

動きから心を読むAIの学習

このモデルをリアルタイムで有用にするため、研究者たちはGLOPパラメータのさまざまな設定を用いて100,000ラウンドのゲームをシミュレートしました。次に、再帰型ニューラルネットワークを訓練して、船の位置の時系列を入力として受け取り、望ましい距離や全体位置への重視度などの隠れたパラメータを迅速に推定するようにしました。このネットワークは、わずか数秒の動きからいくつかの重要なパラメータを非常に正確に回復できました。次に、プレイヤーの目標を推測するための分類器群を三つの方法で訓練しました:生の位置データから直接、平均距離や接近対回避といった単純な要約統計から、あるいは認知モデルが推定したパラメータから。最後に、これらの情報源を組み合わせた“アンサンブル”分類器を構築しました。

人間のベンチマークを上回る

すべてのAI分類器は人間の性能に匹敵するか上回りましたが、どのように情報を準備するかが重要でした。生の動きだけに依存するネットワークやモデルパラメータのみを用いるネットワークは、人間と同様に約66%の正答率でした。単純な要約統計を与えた分類器はより良い成績を示し、最良の結果はその統計と認知モデルのパラメータを組み合わせたもので、約72%の正答率に達しました。これらのモデル情報を取り入れたシステムは、生データのみを与えた場合よりも速く、より安定して学習しました。各ラウンドの瞬間ごとに正確さを追跡したところ、AIは画面のリフレッシュ間隔よりも短い時間でプレイヤーの隠れた目標の推測を更新でき、事実上リアルタイムで意図を推論していました。

日常のAIにとっての意味

一般的な結論としては、心理学的理論をAIに織り込むことで、機械が人が何をするかだけでなく、なぜそうするのかを理解する助けになる、ということです。乱雑な動きを「どれくらい近づきたいか」や「安全性と機会をどう天秤にかけるか」といった少数の解釈可能な動機に翻訳することで、システムはより正確になり説明しやすくなります。自動運転車や人間–AIチームのような将来の応用では、この種の「認知フロントエンド」が他の主体の意図をより早く確実に予測する助けとなり、衝突や誤解を防ぎつつ「相手のドライバーは単に流れているのではなく車線を変えようとしている可能性が高い」といった人間に優しい説明を提供できる可能性があります。

引用: Fitch, A.K., Kvam, P.D. Cognitive models facilitate real-time inference of latent motives. Sci Rep 16, 6444 (2026). https://doi.org/10.1038/s41598-026-37587-8

キーワード: 心の理論, 認知モデリング, 意図推定, 人間–AI相互作用, 説明可能なAI