Clear Sky Science · ja

LLMがZigBeeを話すとき:ネットワークトラフィック生成のための低遅延と推論モデルの探究

スマートホームは現実的なリハーサルを必要とする

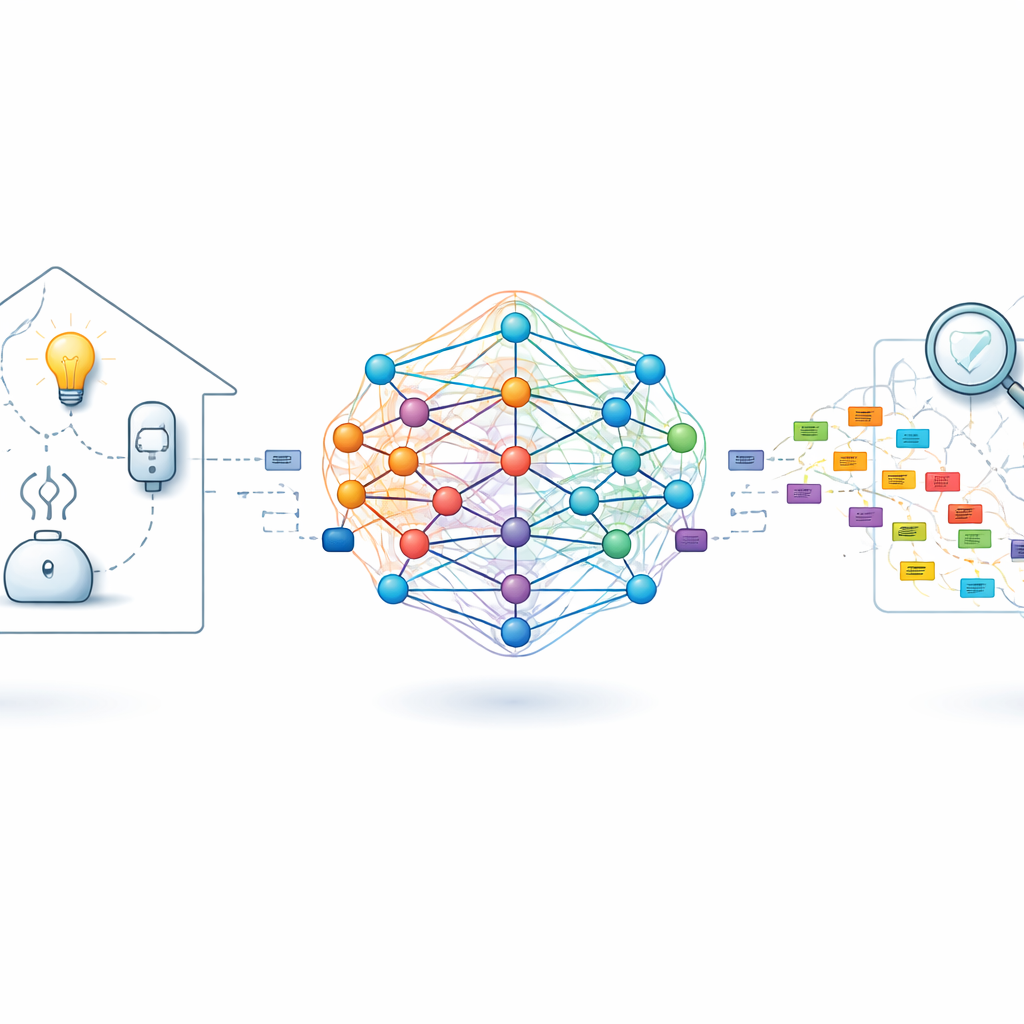

我々の家庭にスマート照明、プラグ、センサーが増えるにつれ、それらの間で交わされる目に見えない通信は利便性であると同時に脆弱性にもなり得ます。これらのシステムを設計・保護する技術者は、稀な障害やサイバー攻撃を含む現実的な条件下でネットワークがどのように振る舞うかを「リハーサル」するための安全な手段を必要としています。本論文は、チャットボットなどで用いられる現代のAI言語モデルが、現実的なスマートホームのネットワークトラフィックを生成するために再利用できるかを検討します。これにより、研究者は実際の家からあらゆるシナリオを録音せずとも強力なテストベッドを得る可能性があります。

人間の言語からデバイス間の会話へ

本研究は、スマート電球、プラグ、モーションセンサーで広く使われる無線規格ZigBeeに焦点を当てます。通常の文章を生成する代わりに、著者らは時刻付きのパケット記録――誰が誰と話したか、どのプロトコルフィールドを使ったかといったサンプルZigBeeパケット――をOpenAIの大規模言語モデル(GPT‑4.1とGPT‑5)に入力します。これらのモデルは各パケットを構造化された「文」とみなし、デバイスと中央ハブが時間経過に伴ってどのように通信するかのパターンを学習します。目的は平均パケットサイズのような基本統計を模倣するだけでなく、ZigBeeの厳密な規則に従い、有効なデバイスアドレスを使用し、現実的なタイミングと要求–応答のパターンを保持する新しいトラフィックを生成することです。

二つの実験:片方向通信と完全な対話

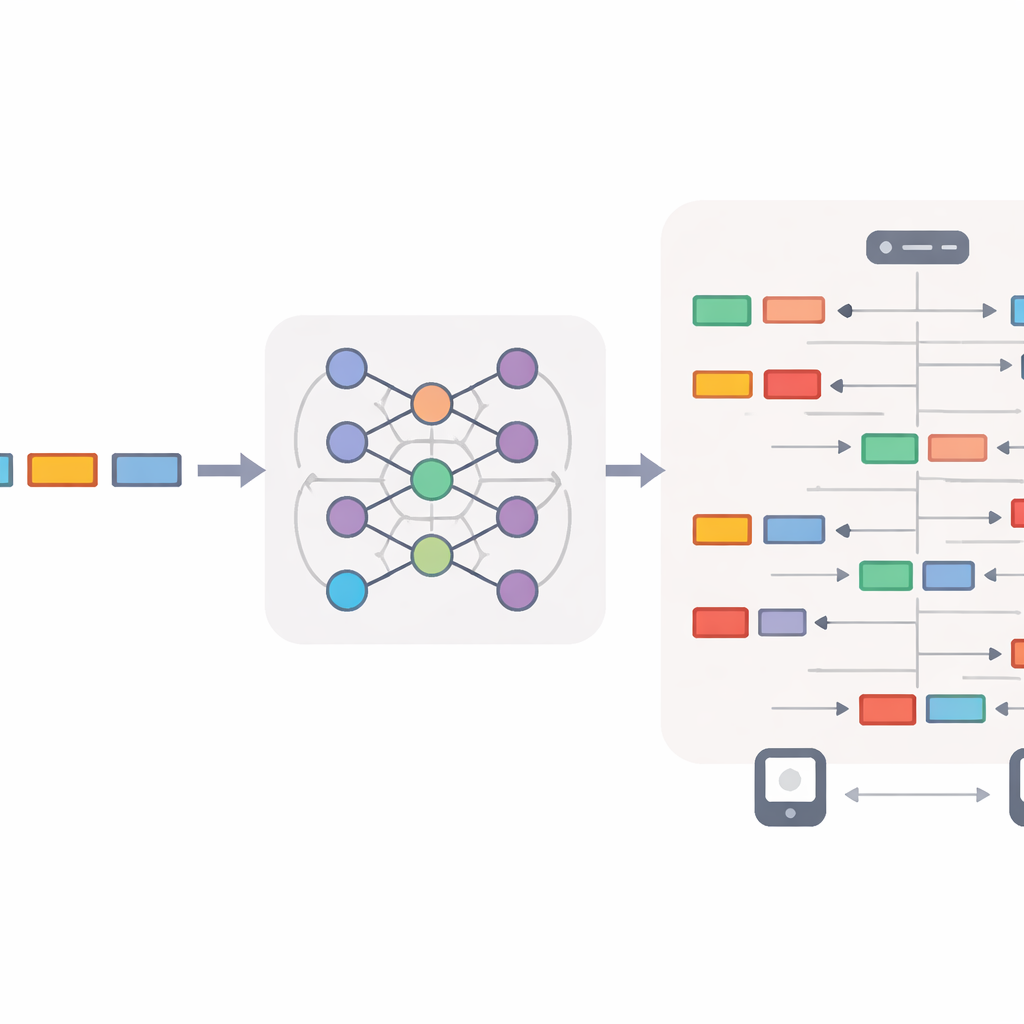

このアイデアを検証するため、研究者らはZigBeeNetという大規模な実データセット(15台のデバイスから20日間で約2500万パケットを収集)を用いて二つの主要な実験を設計しました。第一の実験では、単一のスマート電球からハブへの片方向通信を対象とし、実際のトラフィックの最初の10分のみを例としてLLMに学習させます。第二の実験では、電球とハブが双方にメッセージを交換し、ハブからのブロードキャストも含むより現実的な設定に移行します。どちらの場合も、少数の例示パケットをプロンプト内に示すfew‑shot学習が行われ、モデルに完全に新しい長めのトラフィックを生成させ、それを標準的なパケットキャプチャファイルに変換して一般的なネットワークツールで検査できるようにします。

ルールと人間のチェックでモデルを導く

フィールドの誤りや時刻の順序違反がリアリティの錯覚を壊す可能性があるため、チームは慎重なプロンプト設計とフィードバック体制を構築しました。まず実パケットをフィルタ・エクスポートし、許可されるデバイスアドレス、メッセージ種類、時刻フォーマットを明記したプロンプトを作成します。初期段階では専門家がモデル出力をレビューし、無効なアドレス、あり得ないシーケンス番号、時間のギャップなどの問題を探します。パケットを手作業で修正する代わりに、これらの指摘をより厳格なプロンプト規則に変換します。例えば、デバイスが自分自身に送信することを禁止したり、パケット数を現実的な範囲に保つことを要求したりします。規則が安定したらプロンプトを「凍結」して以後は変更せず、後続の実験が完全に自動かつ再現可能となるようにします。

LLMを従来の生成器と対比する

LLMが本当に価値を付加するかを評価するために、著者らはGPT‑4.1とGPT‑5を、ZigBee様のシーケンス生成に適応させた二つの古典的ディープラーニング手法――リカレントニューラルネットワーク(RNN)と敵対的生成ネットワーク(GAN)――と比較します。すべてのモデルを複数の観点で評価します:到着間隔が実トラフィックにどれだけ近いか、パケットが標準ツールで正しくデコードされるか、プロトコル規則やデバイスの役割が守られているか、パケットの繰り返し頻度、訓練例をそのままコピーする頻度などです。結果は、両方のGPTモデルがほぼ完全にデコード可能でプロトコル準拠のトラフィックを生成し、実際のタイミングパターンと低い乖離で一致する一方、RNNは長期の順序性で苦戦し、GANは特に双方向通信や長時間の生成において不自然に高密度または意味的に無効なトラフィックを作ることが多いことを示しています。

より多くの「思考」は必ずしも役立たない

研究はもう一つ興味深い問いも探ります:推論志向のGPT‑5に内部でより多くの「思考時間」を与えることはネットワークのリアリズムを向上させるか?GPT‑5の隠れた推論努力を低から高へと変えて試したところ、努力を増すとモデルは遅く冗長になるが、トラフィックの現実性が改善されることはなく、時には悪化することすらありました。より高速で推論重視でないGPT‑4.1は、主要な品質指標において一貫してGPT‑5に匹敵または上回り、かつ計算資源をより少なく消費しました。拡張した30分間のシミュレーションでも、両LLMは正しいZigBee挙動を維持しますが、古典的なRNNやGANのベースラインは時間とプロトコルの正確性で大きく逸脱しました。

より安全なスマートホームへの示唆

非専門家向けの主なメッセージは、現代の言語モデルは人間の会話だけでなくスマートホーム機器の「言語」も学習でき、要求に応じて信頼できる規則遵守のトラフィックを生成できるという点です。本研究は、GPT‑4.1のような比較的高速で低遅延のモデルが、テストやセキュリティ評価のための高忠実度なトラフィック生成器として既に機能し得ることを示しており、機密性の高い実世界データの収集を削減する可能性があります。また、より複雑で重厚な推論が常に優れているわけではないことを強調しており、厳密に構造化された技術的タスクでは、より単純で効率的なモデルの方が賢明な選択となる場合があることを示します。著者らがコードとデータを公開すれば、この手法は世界中の研究者がスマートホームシステムを安全な合成環境でストレステストし、侵入検知を改善し、新たなネットワーク設計を探るのに役立つ可能性があります。

引用: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

キーワード: スマートホームIoT, ZigBeeトラフィック生成, 大規模言語モデル, ネットワークセキュリティテスト, 合成ネットワークデータ