Clear Sky Science · ja

ラベルノイズ下の説明可能なAIにおける解釈のドリフト

なぜAIの説明は静かに誤ることがあるのか

多くの人々がいまやAIに単なる答えだけでなく理由も求めています。なぜローンが却下されたのか?なぜシステムは患者を高リスクと判断したのか?本研究は、AIモデルの予測精度が一見安定して見えても、学習データに誤りが含まれていると〈なぜ〉判断したかという説明が劇的に変化し得ることを示します。著者らが「解釈のドリフト」と呼ぶこの隠れた説明の変化は、重要な判断を正当化するためにAIに依存する専門家を誤導しかねません。

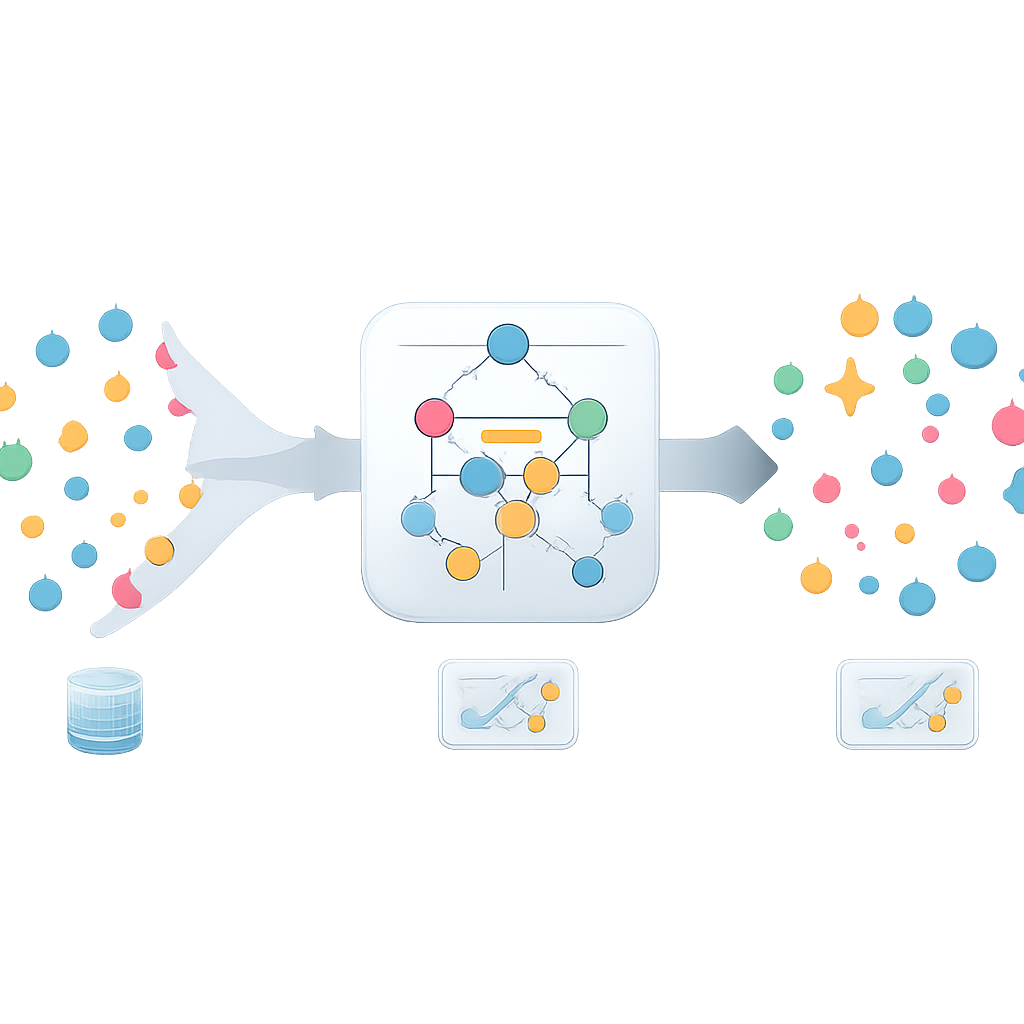

きれいなデータと混乱したラベルが出会うと

現代の多くのAIシステムは「ブラックボックス」であり、明確な理由を提示せずに予測を行います。AIをより透明にするために、多くの応用では人間のif–then的推論に似たルールベースのモデルが用いられます。たとえば「血圧が高く、年齢が60歳以上ならリスクが高い」といった具合です。こうしたルールセットは、医療、法務、金融のように利用者が論理を検査して信頼する必要がある領域で特に魅力的です。しかし現実のデータは完璧であることは稀です。よくある問題の一つがラベルノイズです。これは学習データに含まれる“正しいはずの答え”が誤っているケース、たとえば診断の誤記録や顧客結果の誤ラベリングを指します。ラベルノイズが予測性能に悪影響を与えることは知られていましたが、AI説明の安定性への影響は体系的に調べられていませんでした。

ノイズ下で説明がどのように保たれるかの検証

著者らは、ラベルが徐々に破壊される状況でルールベースの説明がどれほど頑健であるかを評価しました。対象には医療、銀行、肝疾患、さらには数論といった4つの異なるデータセットが使われ、いずれも二値予測タスクに設定されました。比較されたルール学習法は3種類で、2つは広く使われる高速アルゴリズム(IREP と RIPPER)、もう1つはより計算負荷の高い手法である Human Knowledge Models(HKM)で、これは意図的に非常に単純で人間らしいルールセットを生成することを目指しています。各手法について、研究者らは学習ラベルのランダムな反転比率を増やしながら何度もモデルを訓練しました――ほぼクリーンなデータからほとんど無意味な状態まで。彼らは並行して2つの指標を追跡しました:クリーンなテストセットに対する予測性能と、ノイズなしのデータから得られたルールと比較したときに学習されたルールがどれだけ変化したかです。

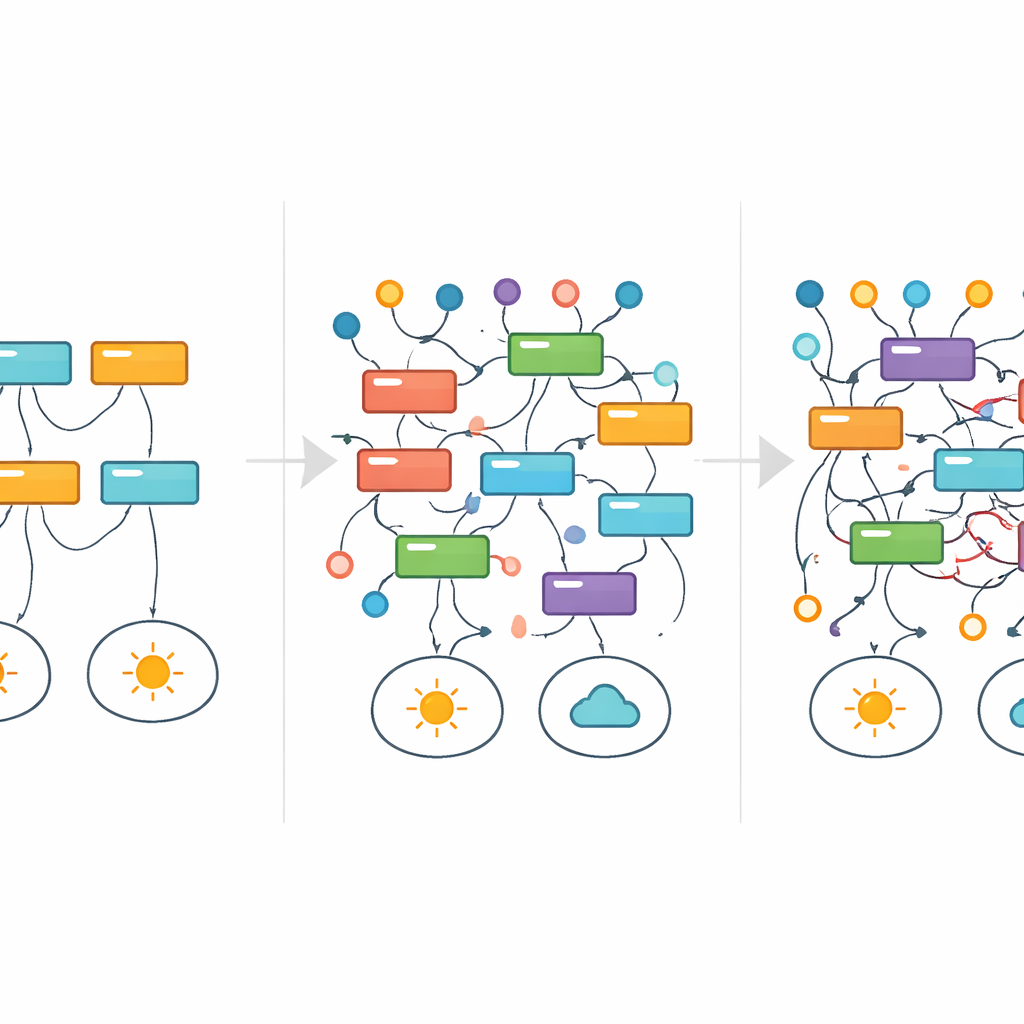

精度は安定して見えるが、論理は変化している

表面上は、結果は利用者を誤った安心感に導く恐れがあります。中程度のノイズ水準では、特にHKM法において、F1スコアなどの一般的な指標で測ると予測性能は比較的安定して見えました。しかしルールセットを詳しく調べると別の物語が現れます。ルール集合を比較する類似度尺度を用いると、わずかなラベルノイズでも元の説明とノイズ下の説明との重なりが急速に失われることが明らかになりました。言い換えれば、モデルは依然として多くの事例に対して正しい判断を下すかもしれませんが、その理由はますます異なっていくのです。より複雑なルールセットは特に脆弱でした:ルール内の条件数が増えるほど、データの小さな変化がそれらのルールを断片化したり置き換えたりしやすくなり、解釈の安定性の喪失が加速しました。

出現するルールと消えるルールを追う

個々の説明がノイズ増加に伴ってどのように存続するかを可視化するために、研究者らは医学で使われる手法を借用しました:サバイバル解析です。患者の生存時間を追う代わりに、特定のルールがラベルノイズの増加に伴ってベストモデル群にどれだけ長く現れ続けるかを追跡しました。多くのルールは穏やかに消えていくのではなく、点滅するように出たり入ったりしました――同じ基礎タスクでもノイズレベルによって全く異なる説明が支配的になる兆候です。単純な数の可除性データセットの例では、クリーンで数学的に正しいルールが徐々により広い近似ルールに置き換えられ、最終的には破損したラベルに合わせてまだ当てはまるものの入り組んでいて一見恣意的なパターンに取って代わられました。この過程の多くで、主要な性能指標は何か問題が起きていることをはっきりとは示していませんでした。

AIに頼る人々にとっての意味

中心的なメッセージは「信頼できる」AIを精度だけで評価してはならないということです。人間に読めるルールで論理を示すモデルであっても、学習に用いるラベルが不完全であるとその理由付けを静かに変えることがあり、これはほとんどの現実世界のデータベースでまさに起きている状況です。著者らは、開発者や規制当局は説明の安定性を精度や公平性と同等の第一級の要件として扱うべきだと主張します。ノイズ下でモデルの説明がどれだけ一貫しているかを直接測る新たな指標や、解釈のドリフトをユーザーに警告するツールは、AIシステムの説明が予測と同じくらい信頼できるものにするために不可欠です。

引用: Raikovskaia, A., Rakhimzhanov, N. & Pianykh, O.S. Interpretation drift in explainable AI under label noise. Sci Rep 16, 8528 (2026). https://doi.org/10.1038/s41598-026-37070-4

キーワード: 説明可能なAI, ラベルノイズ, モデルの解釈性, ルールベースモデル, 解釈のドリフト