Clear Sky Science · ja

PPOとGANで生成された敵対的攻撃による歩容システムの脆弱性評価

歩き方を騙すことが重要な理由

私たちの多くは、遠くからでも友人や家族の歩き方で識別できます。コンピュータも同様のことができるようになってきました。いわゆる「歩容認識」システムは指紋や顔スキャンを使わずに、その人の歩行様式を解析して個人を特定します。これらの技術はセキュリティや監視用途でますます使われています。本研究は気になる問いを投げかけます:人間には気づかれない微細で慎重に設計された変化を用いて、こうしたシステムをどれほど簡単に騙せるのか?その答えはプライバシーや安全性、高いリスクが伴う場面でAIをどれだけ信用できるかに大きな影響を与えます。

コンピュータは歩き方をどう読み取るか

現代の歩容認識はディープラーニングに依拠しており、顔認識や自動運転と同じ技術群に属します。単一の静止画を見るのではなく、歩行する人物の複数のフレームを統合して「gait energy image(歩容エネルギー画像)」と呼ばれる一枚の画像を作ります。これは全歩行サイクルにわたる体の動きをぼんやりと捉えたシルエットのようなものです。専用のニューラルネットワークが学習することで、服装や所持品が変わっても個人の歩容を識別できるようになります。CASIA-BやOU-ISIRといった主要な歩行動画データセットでのテストでは、著者らのベースラインモデルは97%以上の正答率を示しており、現実運用に耐えうる性能があるように見えます。

スマートカメラを欺く目に見えないステッカー

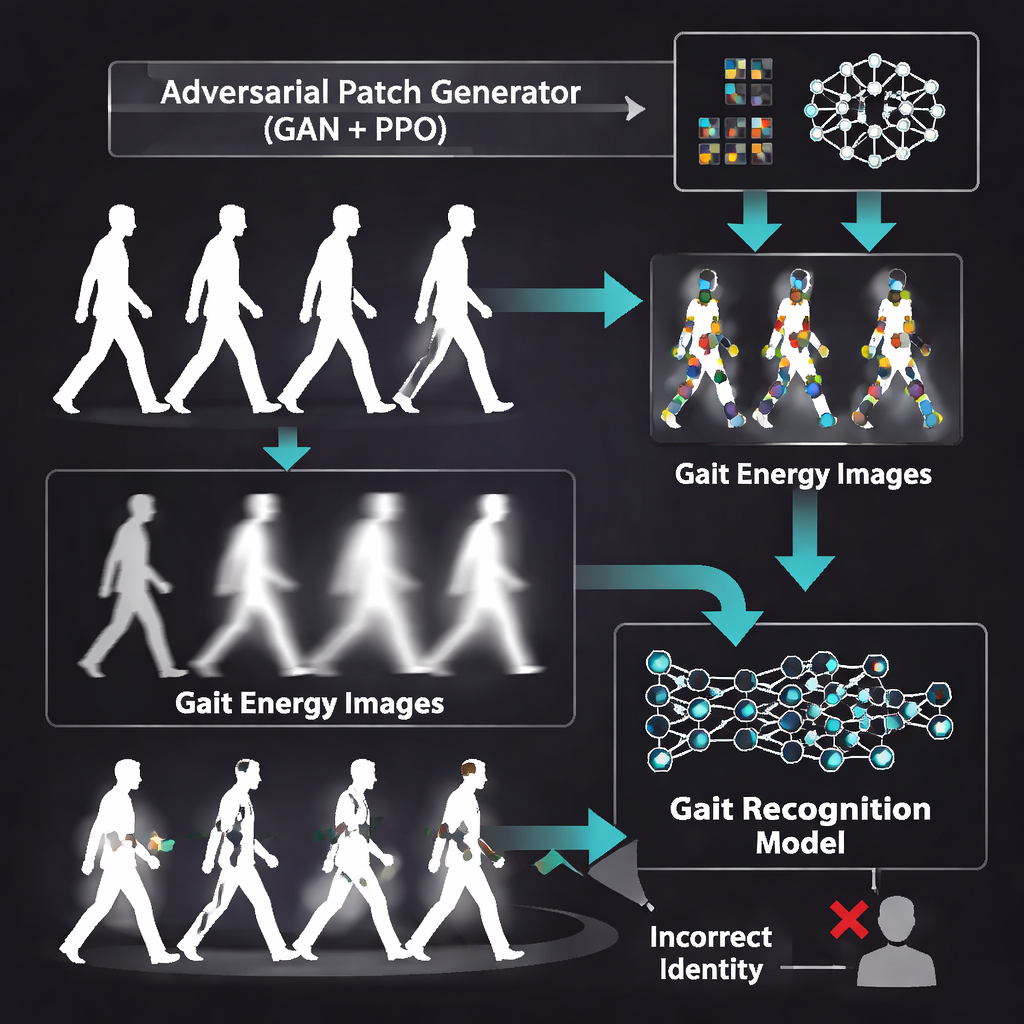

論文の核心はより優れた識別器を作ることではなく、弱点を暴くためにそれを故意に破る点にあります。研究者たちは小さな「敵対的パッチ」を生成します——正方形のピクセル領域で、一見無害に見えるがニューラルネットワークを混乱させるよう数学的に調整されています。これらのパッチを生成するために、彼らは生成対向ネットワーク(GAN)を用います。GANは内部の評価者と競いながら現実らしい画像を生成することを学ぶAIの一種です。GANは歩容エネルギー画像に直接訓練されるので、その出力は幽霊のようなシルエットに自然になじむようになります。こうしたパッチは、人が歩容をちらりと見たときには異常に気づかないほど微妙になるよう設計されています。

弱点を見つける学習エージェントの活用

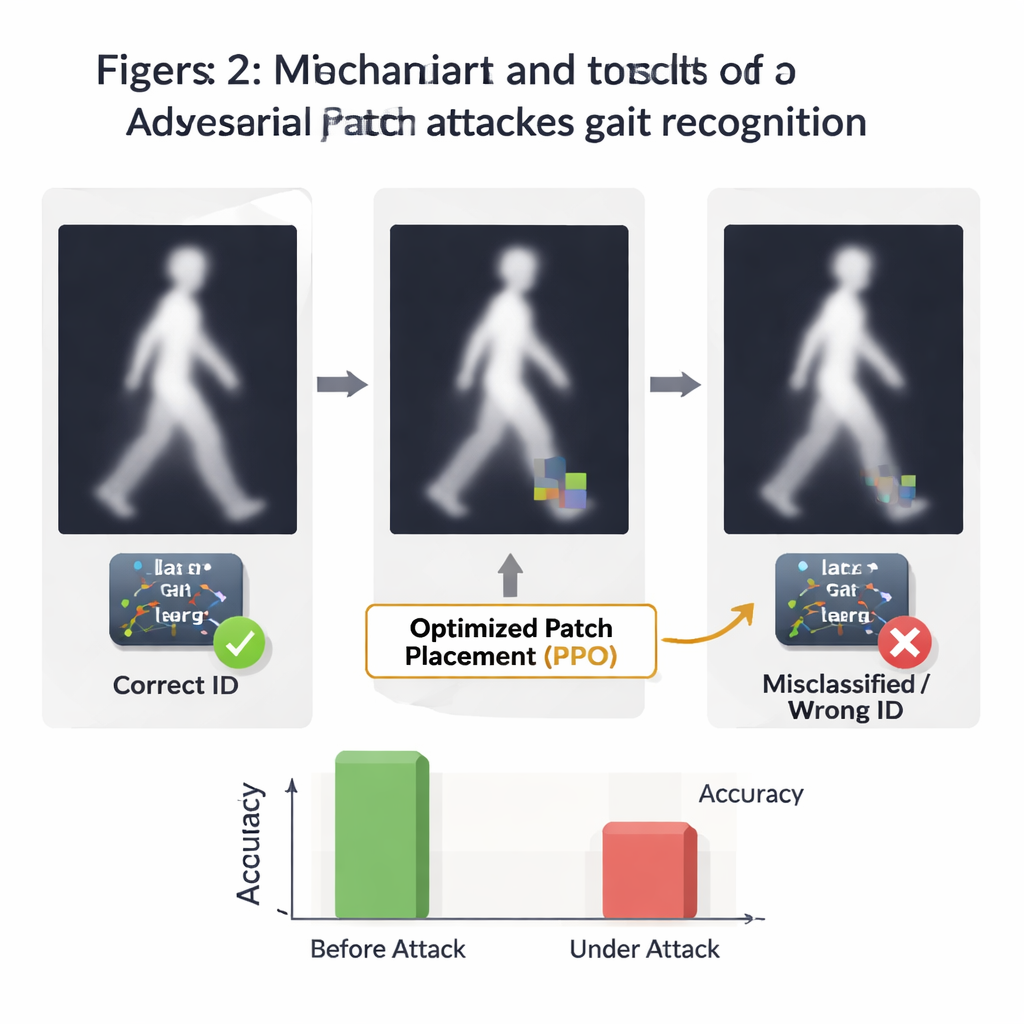

パッチをどこに配置するかは、その見た目と同じくらい重要になり得ます。最もダメージを与える位置を見つけるために、著者らはProximal Policy Optimization(PPO)という強化学習手法に依拠します。各歩容画像を格子状の環境と見なして、ソフトウェアの「エージェント」がパッチを上下左右に動かしながら、識別システムの信頼度がどれだけ下がるかを観察します。ある位置がモデルを誤認識させればエージェントは報酬を得、失敗すれば罰を受けます。多数のエピソードを通じて、エージェントは歩容画像の特に脆弱な領域(しばしばモデルが最も依存する動く体の部分付近)にパッチを配置する方策を学習します。

攻撃を実行したら何が起きるか

パッチ生成器と配置戦略の両方を訓練した後、チームは自分たちの高性能な歩容認識器に対して攻撃を仕掛けます。通常条件下では、システムは優れた精度、低い誤警報率、正解と不正解の間の明確な分離を示します。しかし一旦敵対的パッチが追加されると、性能は急激に低下します。パッチが画像上でどれだけ積極的に移動できるかによっては、攻撃の成功率が60%を超え、正しく識別される人の割合は元の水準のほぼ3分の1にまで落ち込むことがあります。かつて真のユーザーとなりすましの間でほぼ完璧な識別を示していた曲線は、ランダム推測の線に近づくように沈み、目に見えるゆがみなしにモデルが容易に誤誘導される様子を明らかにします。

日常のセキュリティにとっての意味

専門外の読者にとっての要点は明白です:実験室で高い精度を示す歩容認識システムは、巧妙で機械的に設計された改ざんに直面すると驚くほど脆弱になり得ます。本研究は、生成画像ツールと試行錯誤的学習を組み合わせることで、人間にはほとんど見えない微小な変化が重大な識別誤りを引き起こすことを示しています。これは実際の悪用のための設計図ではなく、警告と評価の枠組みです。システム設計者が自分たちのモデルの脆弱性を検査・測定する手段を提供し、歩容認識が監視、アクセス制御、その他重要な用途で広く信頼される前に、こうした攻撃に対する防御を構築する必要があることを強調します。

引用: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

キーワード: 歩容認識, 生体認証セキュリティ, 敵対的攻撃, ディープラーニング, 強化学習