Clear Sky Science · ja

安全な検索強化生成システムのためのセマンティックキャッシュにおける敵対的耐性の強化

なぜ賢いAIの記憶が重要なのか

チャットボットやAIアシスタントが職場や教室、病院に広がるにつれて、過去の質問を「覚えておく」ことで似た質問に対してより速く、安価に応答するという手法に依存する場面が増えています。この記憶はセマンティックキャッシュとして知られ、コストや遅延を大幅に削減できますが、同時に攻撃者がシステムを騙して機密を漏らさせたり誤った回答を引き出したりするための裏口を開くことにもなります。本論文はこれらの潜在的リスクを探り、AIの記憶を高速に保ちつつ悪用を困難にする新しい設計、SAFE-CACHEを提案します。

現在のAIアシスタントが過去の回答を再利用する方法

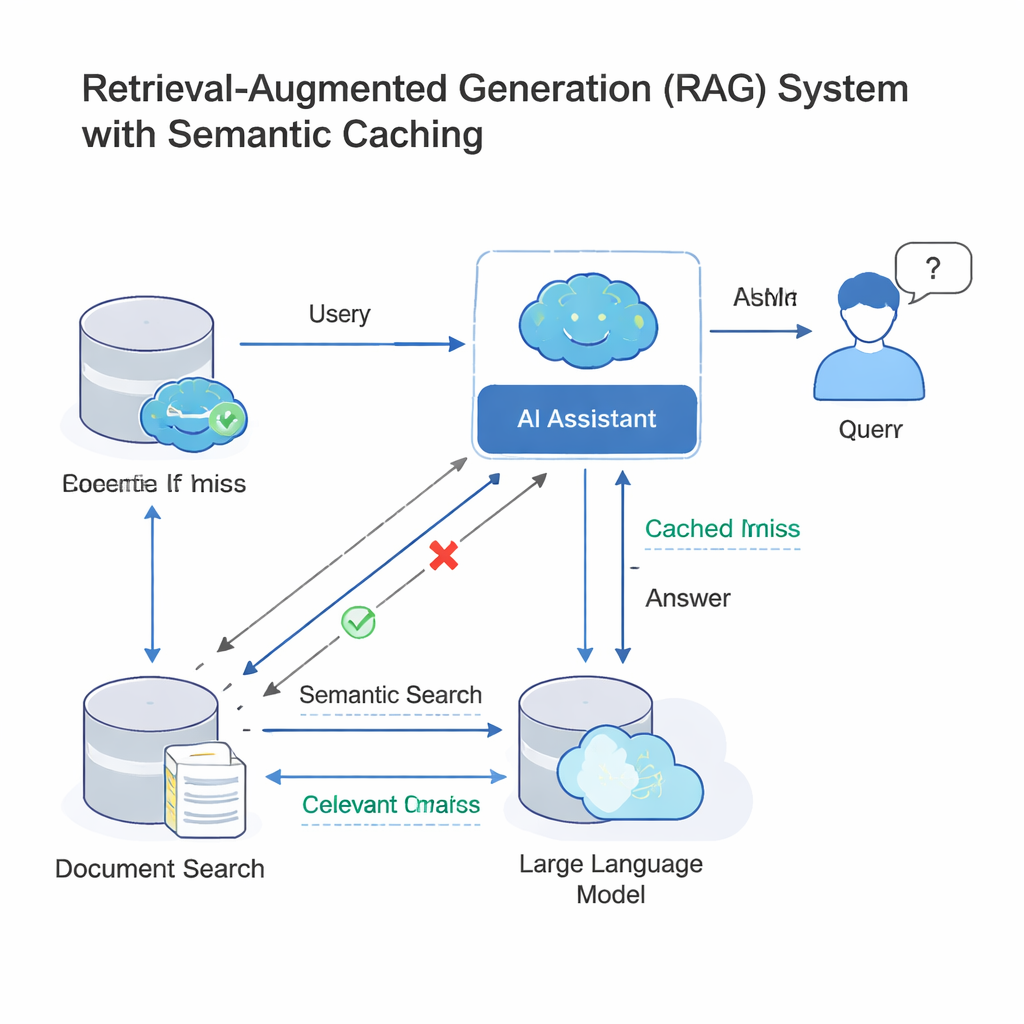

現代の大規模言語モデル(LLM)は、検索強化生成(RAG)と呼ばれる構成で動作することが多いです。質問を受けると、まず関連する文書を検索し、その材料を使ってLLMが回答を生成します。多くの人がほぼ同じ内容を異なる言い回しで尋ねるため、企業はセマンティックキャッシュを導入しています。これは過去の質問と回答、そしてそれらの意味を表す数学的な指紋(埋め込み)を保存する仕組みです。新しいクエリが来ると、その指紋がキャッシュ内のものと「十分に近い」かを確認し、近ければ検索と生成のプロセス全体を実行する代わりに古い回答をそのまま再利用します。GPTCacheやMicrosoftやGoogleのクラウドプラットフォームなどで採用されているこの考え方は、カスタマーサポートボットや企業向けチャットツール、高トラフィックのAIサービスでコストを節約し応答を高速化します。

巧妙な言い回しがセキュリティ上の穴になるとき

速度を高める同じ近道がシステムに対して悪用される場合があります。攻撃者は構造は似ているが意味が異なるクエリを巧妙に作成できます—日付を変えたり、人物や場所を入れ替えたり、質問の意味を反転させたりするなどです。現在のキャッシュは主に埋め込みの数値的類似性を信頼しているため、悪意あるクエリがベクトル空間上で正当なものと「衝突」し、意図が変わっているにもかかわらず誤った回答を返してしまうことがあります。その衝突によりキャッシュが誤った回答を返し、機密情報が露出したり悪質なデータが後で再利用されるために保存されたりする可能性があります。先行研究は、特にマルチテナントシステムで多くのユーザーが同じ基盤のキャッシュを共有する場合に、ベクターデータベースやセマンティックキャッシュがこのように毒され得ることを示しています。

散在する質問を安定した意図クラスタに変える

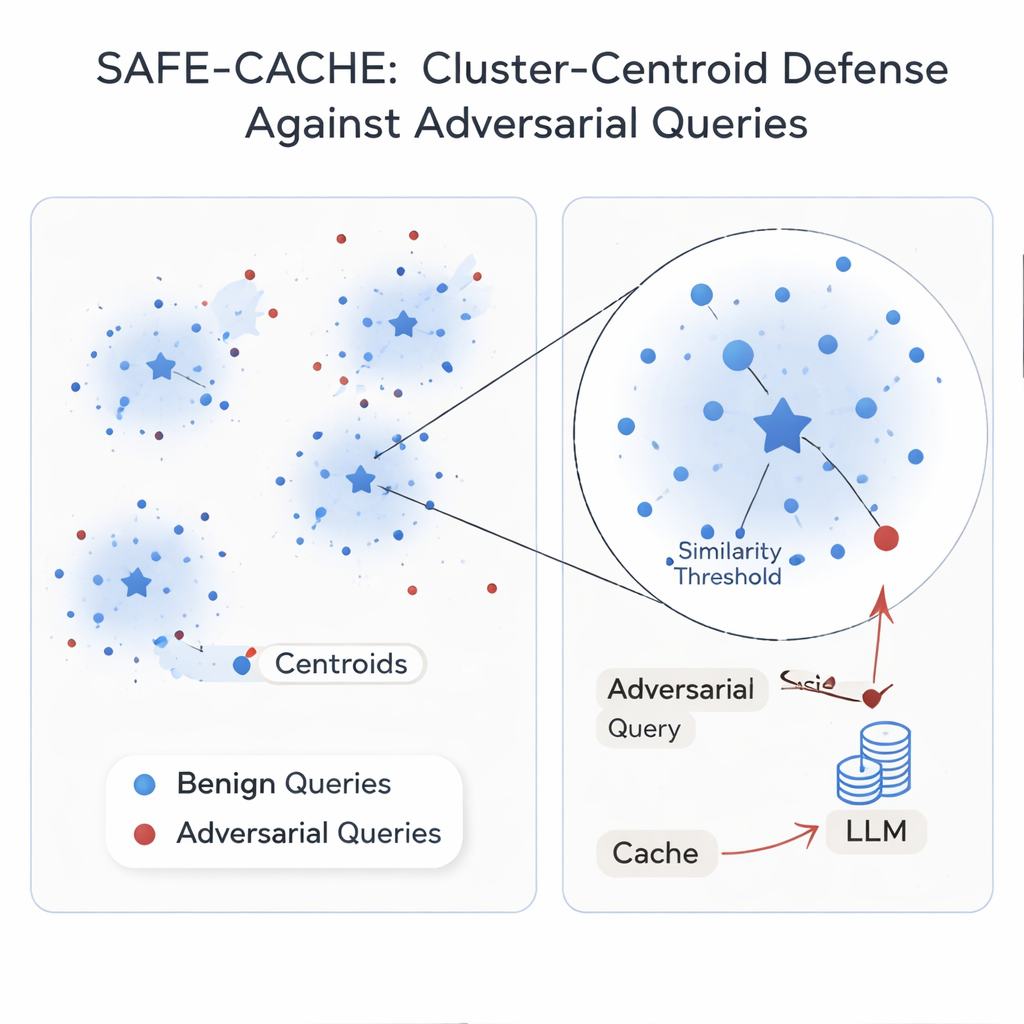

著者らは根本的な問題は各クエリを個別に扱うことにあると主張します。彼らの解決策であるSAFE-CACHEは、過去の質問と回答のペアを「誰が2022年のアリゾナ上院選を勝ったか?」や「テスラの完全自動運転ソフトの価格はいくらか?」のような基礎的な意図を表すクラスタにまとめます。新しいクエリを個々の過去問と直接照合する代わりに、SAFE-CACHEは各クラスタの中心、すなわちセントロイドと比較します。これらのクラスタを構築する際には、まず質問だけでなく質問と回答の全文を埋め込み、例えば機密情報を明かすことを拒否するような応答の違いもグルーピングに反映させます。次にコミュニティ検出アルゴリズムを使って自然なクラスタを見つけ、統計検定で異なる意図や敵対的エントリが混在している可能性のあるノイジーなグループをフラグ付けします。これらの疑わしいクラスタは、正直な例を引き寄せ、毒された例を分離するように学習した専用のバイエンコーダーを使ってクリーニングおよび分割されます。

小さなモデルにAIの記憶を強化させる

一部の意図は実際のトラフィックで数回しか現れず、クラスタが脆弱になります。それらを安定化するために、SAFE-CACHEは微調整された軽量言語モデル(10億パラメータのGemma-3派生)を用いて、意図を保ちながら言い回しを変えたパラフレーズを生成します。これらの追加例によりクラスタはより密になり、セントロイドの信頼性が高まります。数千のバリエーションを人手でラベル付けする必要はありません。実行時には、すべての新しいクエリが埋め込まれ、これらのセントロイドと比較されます。最も一致するセントロイドへの類似度が慎重に調整された閾値を超えればキャッシュされた回答が返され、そうでなければフルRAGパイプラインにフォールバックし、後で新しいペアをどのようにクラスタ化するかを決定します。メタモルフィックな書き換えやGPT-4.1に基づく強力な攻撃手法を用いた実験では、SAFE-CACHEはGPTCacheスタイルの設計と比べて成功する毒性注入の試行を約2分の1から4分の1に削減し、応答速度は事実上変わりませんでした。

日常のAIユーザーにとっての意義

専門外の人向けの要点は、AIシステムに「記憶」を与えることは無償ではないということです。素朴な設計は機密を漏らしたり、誤った回答を広めるように騙されたりする可能性があります。SAFE-CACHEは、記憶をより深い意図レベルのパターンで整理し、標的を絞ったパラフレーズでそれらのパターンを強化することで、セマンティックキャッシュの速度とコスト面での利点を維持しつつ攻撃リスクを大幅に低減できることを示しています。AIアシスタントが企業記録や個人情報など敏感なデータへの入り口となるにつれて、SAFE-CACHEのようなアプローチは、AIが覚えていることが簡単に悪用されないようにするための重要な手段となるでしょう。

引用: Afiffy, M., Fakhr, M.W. & Maghraby, F.A. Enhancing adversarial resilience in semantic caching for secure retrieval augmented generation systems. Sci Rep 16, 5936 (2026). https://doi.org/10.1038/s41598-026-36721-w

キーワード: セマンティックキャッシュ, 検索強化生成(RAG), 敵対的攻撃, クラスターベースの防御, 大規模言語モデルのセキュリティ