Clear Sky Science · ja

モバイルエッジコンピューティングにおける遅延とエネルギーを考慮した適応型サービス移行

アプリをあなたに近づけることが重要な理由

車内でオンラインゲームをプレイしたり、スマートフォンで拡張現実(AR)の案内をストリーミングしたり、スマートシティのセンサーがデータを送信したりするたびに、それらのデジタル処理はどこかで計算される必要があります。モバイルエッジコンピューティング(MEC)は、その処理を遠隔のデータセンターから基地局近くに置かれた小規模サーバへ移すことで遅延を短縮し、アプリの応答性を向上させます。しかし、移動するユーザーの近くにサービスを保つためには、実行中のアプリケーションを近隣のエッジサーバ間で頻繁に“移動(マイグレーション)”させる必要があります。移行が多すぎるとエネルギーやコストを浪費し、少なすぎると遅延や不満を招きます。本研究は、高度な機械学習を用いて賢いバランスの取り方を探ります。

応答性と電力消費のバランス

これまでの多くのMECサービス移行研究は、主に一つの目標――ユーザーが感じる遅延を極力小さくすること――に集中してきました。これは通常、ユーザーに追随して頻繁に最も近いサーバにアプリを移すことを意味します。しかし、各移行は追加の通信エネルギーを消費し、それ自体が遅延をもたらします。さらに、従来の多くの手法はサーバ容量が十分にあることや条件が安定していることを仮定しており、実際のエッジサーバは資源が限られ、多数のユーザーと競合し、負荷や無線品質が急速に変化する現実を無視しています。著者らは、移行エネルギーを遅延と同等の重要な目的として扱うべきだと主張し、移行方針はユーザーの移動、サーバ負荷、ネットワークの変動に応じてオンラインで適応する必要があると述べています。

数学的問題から学習エージェントへ

研究者らはまず、複数の基地局、併設されたエッジサーバ、移動するユーザーを含むMECシステムの詳細な数理モデルを構築します。各ユーザーはワイヤレスリンクを介して近隣のサーバに計算タスクをオフロードします。総サービス遅延は、タスクを基地局に送る時間、サーバで計算する時間、そしてサービスが有線バックホール経由でサーバ間移動する際に生じる時間の三つに分解されます。移行エネルギーは主にサービス移動時に転送しなければならないデータ量からモデル化されます。全体の目標は、各サーバの計算容量や各サービスのデッドラインの制約を守りつつ、遅延と移行エネルギーの両方を最小化することです。この混合整数非線形問題をリアルタイムで厳密に解くことは計算上現実的でないため、研究チームはシミュレートした環境と相互作用することで良好な意思決定を学ぶ深層強化学習に活路を見出します。

適応的移行制御の仕組み

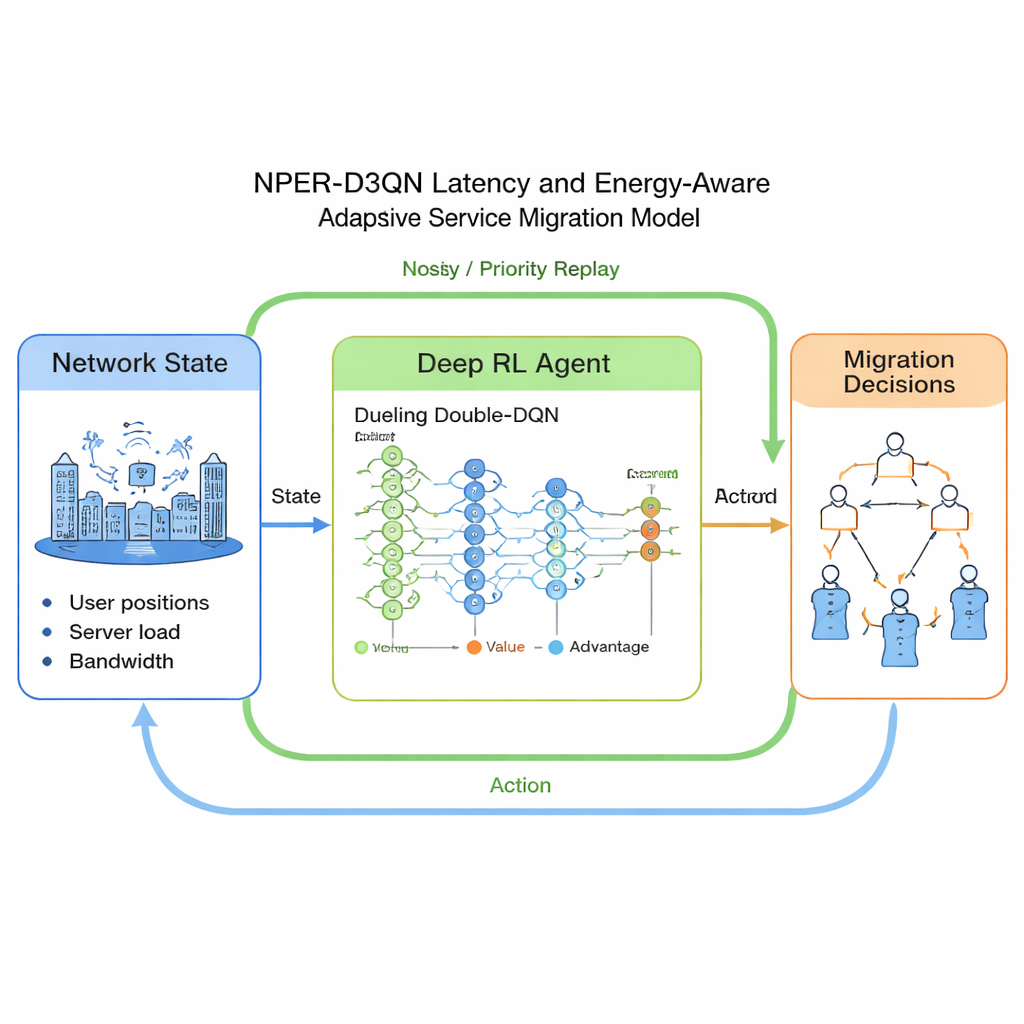

提案手法NPER‑D3QNは、Deep Q‑Networks(DQN)の高度な変種です。エージェントの入力となる「状態」は、ユーザーの位置、担当基地局までの距離、各エッジサーバの負荷状況、利用可能な計算容量、無線データレート、各サービスのサイズと計算需要といった情報を要約します。エージェントの「行動」は、次の時間スロットでどのエッジサーバが各ユーザーのサービスをホストするかを選ぶことです。報酬関数は各サービスのデッドラインに対する遅延の低さを奨励しつつ、移行エネルギーをペナルティとして課すことで、応答性と電力消費のトレードオフを促します。技術的には、本モデルは三つのアイデアを組み合わせています:状態の価値と各行動の優位性を別々に推定するデューリングネットワーク、過剰に楽観的な推定を抑えるダブルQ学習構造、そして複雑で変化する条件下で学習を高速かつ安定化するためのノイジーネットワークと優先経験再生という二つの探索支援機構です。

実験での検証

NPER‑D3QNの有効性を評価するために、著者らは多数の基地局を備え、数十〜数百の移動ユーザーがランダムに動き、さまざまなサイズのタスクを送信する都市風のグリッドをシミュレートします。エッジサーバは計算能力が限られ、ホストできる仮想マシンの数も固定されているため、現実的な待ち行列や競合が発生します。提案手法は、クラシックなDQN、改善されたダブル‑デュエリング変種、常に最寄りサーバを追う戦略や遅延最小化のみを重視する手法など、六つの最先端ベースラインと比較されます。さまざまなシナリオで、NPER‑D3QNはより速く良好な戦略に収束し、平均サービス遅延、移行関連のエネルギー消費、サーバが満杯のときの拒否される移行数を一貫して低減しました。720ユーザーと96サーバの大規模テストでは、ある代替手法と比較して遅延を最大で約3分の1に削減し、移行エネルギーを90%以上削減しつつ、意思決定ごとの計算時間を実用的な範囲内に保ちました。

将来の接続サービスにとっての意味

非専門家にとっての要点は、単にアプリをユーザーに近づけるだけでは不十分で、いつどこへ実行中のサービスを移すかを賢く制御する必要があるということです。本研究は、学習ベースのコントローラが応答性、節電、限られたエッジ容量という相反する目標を手作りのルールなしに「調整」できることを示しています。同様のシステムが実際のネットワークに導入されれば、自動運転、没入型AR、産業用IoTといったアプリに対してより滑らかな体験を提供し、電力コストやインフラへの負荷を抑えるのに役立つ可能性があります。著者らは本研究がシミュレーションベースであり、サーバの完全な消費電力モデルや不完全な監視などの現実世界の詳細を省いている点を指摘していますが、より省エネで適応性の高いエッジコンピューティングへの有望な一歩を示しています。

引用: Li, L., Lv, J., Wang, S. et al. Latency and energy-aware adaptive service migration in mobile edge computing. Sci Rep 16, 6178 (2026). https://doi.org/10.1038/s41598-026-36711-y

キーワード: モバイルエッジコンピューティング, サービス移行, 深層強化学習, 遅延最適化, エネルギー効率