Clear Sky Science · ja

ALBERT駆動の文脈とEHO最適化アーキテクチャを組み合わせた深層感情モデル

なぜ賢い感情読み取りが重要か

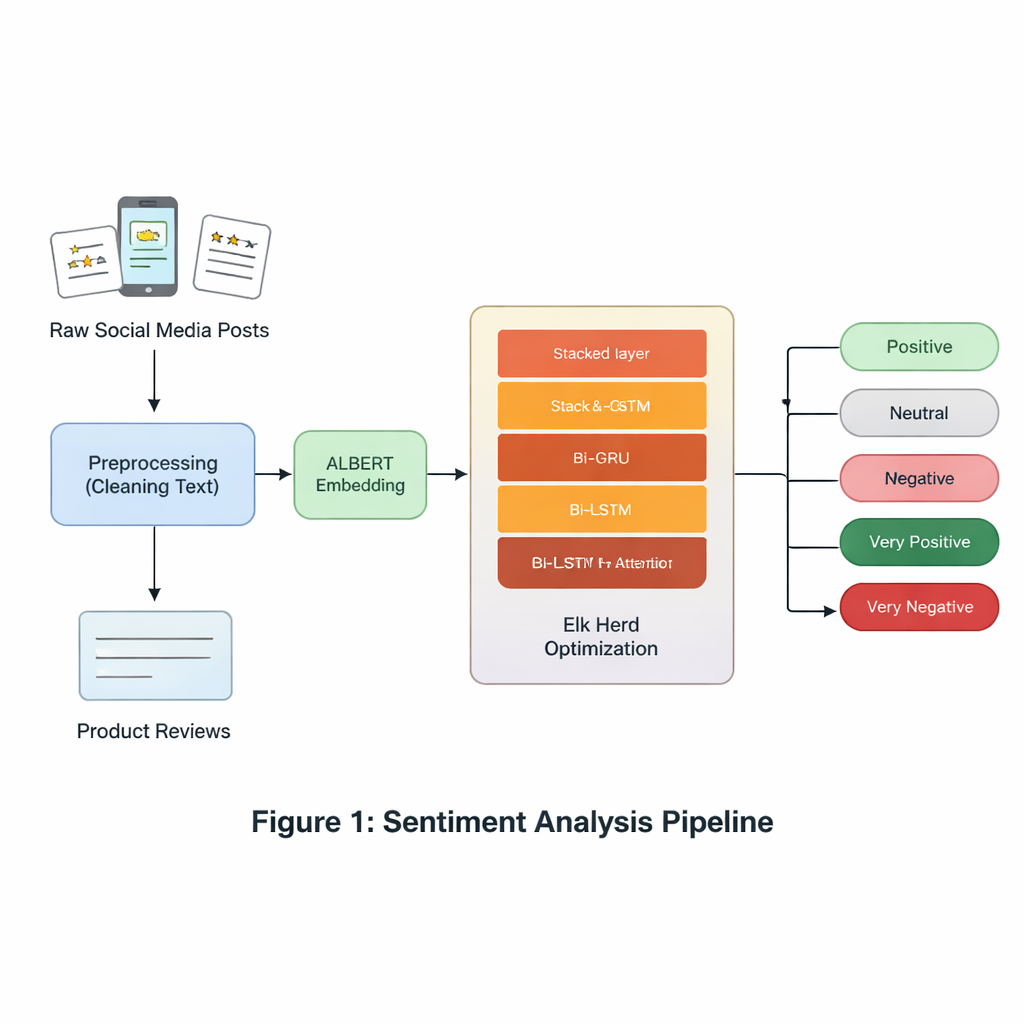

日々、何百万もの人々が製品、サービス、政治、出来事について意見をインターネット上で共有しています。この膨大なテキストを信頼できる洞察に変えることは、企業や政府、研究者にとって不可欠です。しかしオンラインの言語は混沌としており、皮肉やスラング、タイプミス、稀な感情はコンピュータを容易に混乱させます。本稿は、こうした感情をより正確に読み取り、しかも多くの現行AIモデルより少ない計算資源で動作することを目指した新しい感情分析システムを紹介します。

単純な語数カウントから文脈を理解する読み取りへ

初期の感情分析ツールはテキストを切り離された単語の袋として扱い、「good」や「terrible」のような語の出現頻度を数えるだけでした。この手法は語順や微妙な文脈を無視し、「not bad」が「かなり良い」に近い意味になるといったケースを見落としました。深層学習はテキストを系列として処理することで改善しましたが、大量のラベル付きデータと高い計算負荷を必要とすることが多いです。BERTのようなトランスフォーマーモデルはさらなる精度向上をもたらしましたが、その大規模さゆえにカスタマーサービスやソーシャルメディア監視といった実運用環境では導入コストが高くなります。本稿の著者たちは、この課題に対して、より軽量でありながら強力な複数の要素を統合した効率的なシステムを提案します。

テキスト理解のためのよりスリムな頭脳

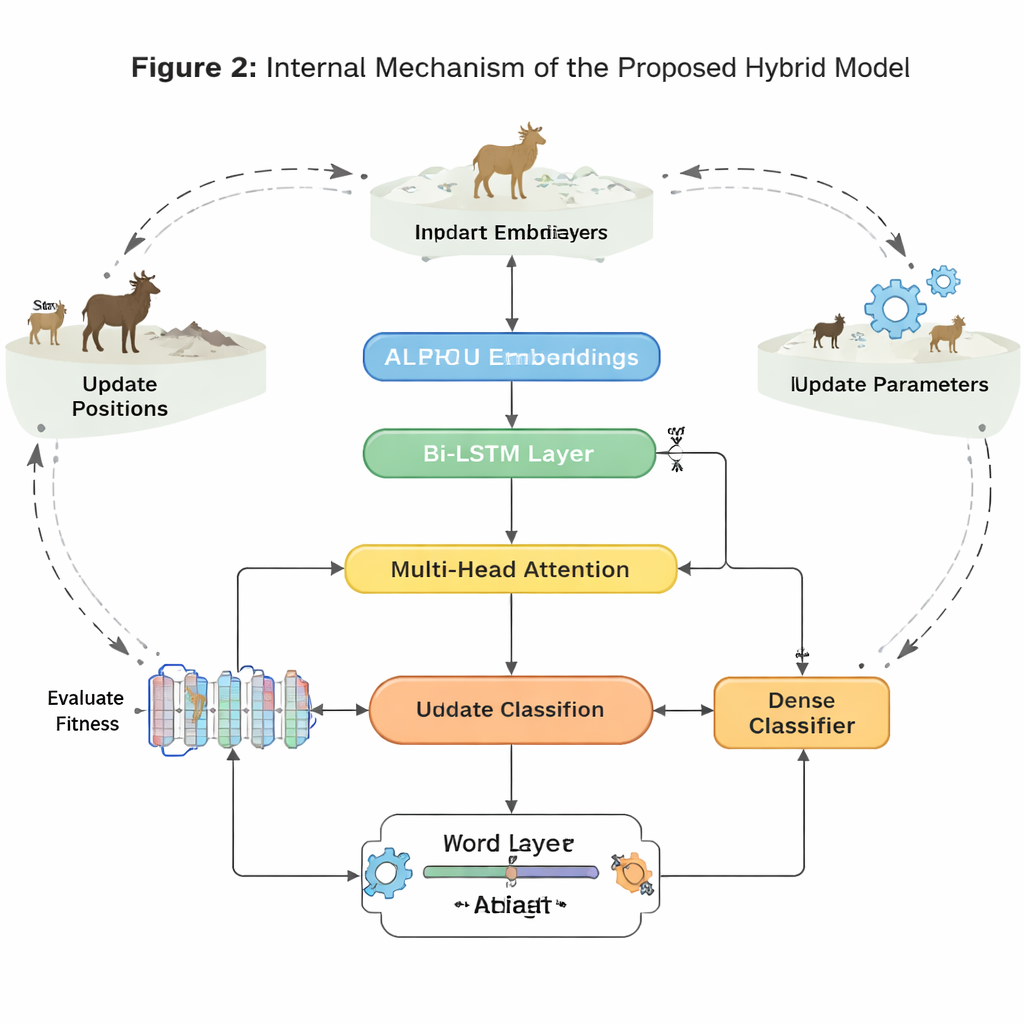

このモデルの中心にあるのは、BERTの小型版であるALBERTです。ALBERTは文中の各単語を文脈に応じた数値表現に変換し、隣接する語によって意味がどのように変わるかをとらえます。大規模モデルと異なり、ALBERTは層間でパラメータを共有し語彙を圧縮することでメモリ使用量を削減します。これにより標準的なハードウェアで動作させやすく、理解力を大きく損なうことなく運用可能です。こうして得られたALBERTベースの語表現が、文中で感情がどのように展開するかに注目する一連の特化レイヤーへの入力になります。

二つの記憶システムを連携させる

語から語へ意味がどう変化するかを追うために、システムは2種類の再帰型ネットワークを使用します:GRU(Gated Recurrent Unit)とLSTM(Long Short-Term Memory)。各々が順方向と逆方向の両方で動作します。GRUは少ないパラメータで短いフレーズの追跡に効率的であり、一方LSTMはより長いテキストにわたる情報を保持するのに優れています。双方向LSTM層の上に双方向GRU層を積み、注意機構を加えることで、モデルは「except the battery life」のように全体は肯定的でも感情に影響する部分を強調できます。このハイブリッド設計は、トーンの急な変化と文全体をひっくり返すような長距離の文脈の両方をとらえることを目指しています。

自然に着想を得た調整で難しいケースに対処

アーキテクチャに加え、著者たちは現実の重要な障害に取り組みます:感情データセットは往々にして不均衡でノイズが多いことです。嫌悪や驚きといった感情や、中立的な表現は、明確に肯定的または否定的なものより出現頻度が低く、多くのモデルはそれらを無視しがちです。これに対抗するため本論文では、エルク・ハード最適化(Elk Herd Optimization)という、エルクの移動・競争・群れ形成の仕組みに着想を得た探索戦略を用いています。ニューラルネットワークが内部の感情ベクトルを出力した後、この最適化ステップが各クラス、特に稀なクラスの表現を微調整し、反復的に「適合度」スコアを改善します。こうしたプロセスによりモデルは浅い解に陥るのを避け、微妙あるいは過小表現された感情を区別する能力が向上します。

モデルの実検証

著者らはシステムを、Twitterの投稿、レストランやノートパソコンのレビュー、非常に肯定的/非常に否定的な意見を中間的評価と区別する5段階の映画レビューなど、6つの広く使われるデータセットで評価しています。こうした多様なデータ源において、新しい手法は複数の高度なグラフベースおよびトランスフォーマーベースの競合モデルを、精度とF1スコアの両面で一貫して上回りました。特に5クラスの映画レビュー課題と過小表現クラスでの改善が顕著であり、細かな感情と偏ったデータの双方に対応できることを示しています。構成要素を一つずつ除去して性能への寄与を調べるアブレーション研究でも、ALBERT、GRU–LSTMの組み合わせ、注意機構、エルク由来の最適化がそれぞれ全体性能に寄与していることが確認されました。

日常的応用への意味

非専門家にとっての主要な示唆は、この研究が大量のオンライン意見をより効率的かつ信頼性高く解釈する手段を提供するという点です。コンパクトな言語モデルと補完的な記憶レイヤー、そして生物学に着想を得た調整ステップを組み合わせることで、システムは行間をより正確に読み取り、特に感情が微妙であったりデータが偏っている場合に強みを発揮します。これにより顧客満足度の追跡、公衆衛生に関する態度のモニタリング、政策や出来事への反応評価など、精度と計算コストの両方が重要な実世界の用途で有望な手法となります。

引用: Oqaibi, H., Sharma, S. A deep sentiment model combining ALBERT-driven context and EHO-optimized architecture. Sci Rep 16, 5784 (2026). https://doi.org/10.1038/s41598-026-36389-2

キーワード: 感情分析, ALBERT, 深層学習, テキスト分類, メタヒューリスティック最適化