Clear Sky Science · ja

トランスフォーマーと説明可能性を用いたReddit上のメンタルヘルス談話の理解

感情についてのオンラインの会話が重要な理由

不安、抑うつ、双極性障害、境界性パーソナリティ障害で苦しむ多くの人が、専門家と話す前にまずインターネットに頼ります。匿名性のあるコミュニティを持つRedditは、恐れを共有したり助けを求めたり、互いに支え合うための大規模な場所になりました。本研究は、何千にも及ぶこうした会話がどのようなものかを探り、人工知能がそれらをどのように分類し、各種の精神的課題について語る際に人々が最も頻繁に使う語をどのように抽出できるかを明らかにします。

支援コミュニティを覗く

研究者らは、不安、抑うつ、双極性障害、境界性パーソナリティ障害(しばしばBPDと略される)に関する大規模な4つのRedditコミュニティに着目しました。データセット内の各投稿は、医療的診断によってではなく、投稿が属するコミュニティによって単純にラベル付けされていました。チームはこれらのコミュニティを「関心の場」として扱い、似たような困難を抱える人々が愚痴をこぼしたり、助言を求めたり、慰め合ったりする場所として分析しました。こうした場での言語の違いを調べることで、診療の場を離れた人々が自分の言葉でどのように経験を描写しているかを理解しようとしました。

会話を分類するコンピュータの学習

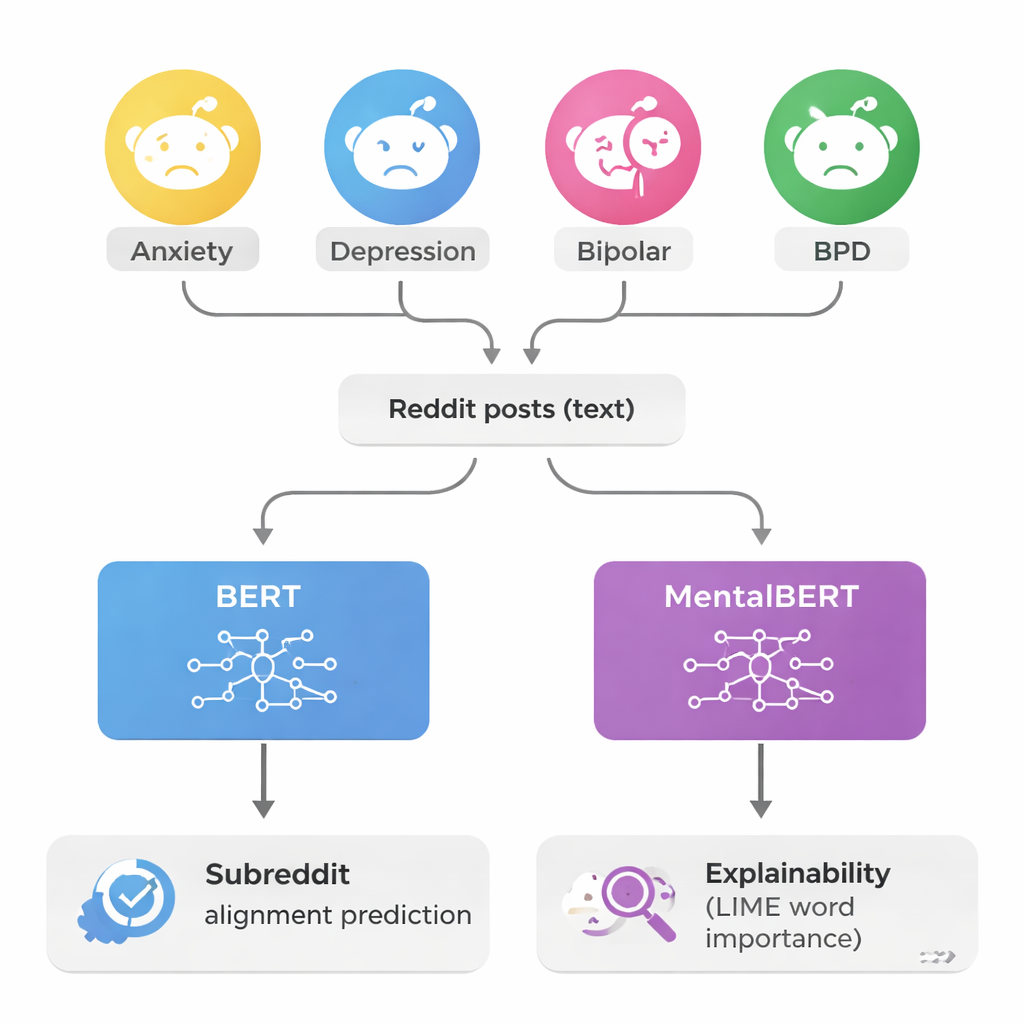

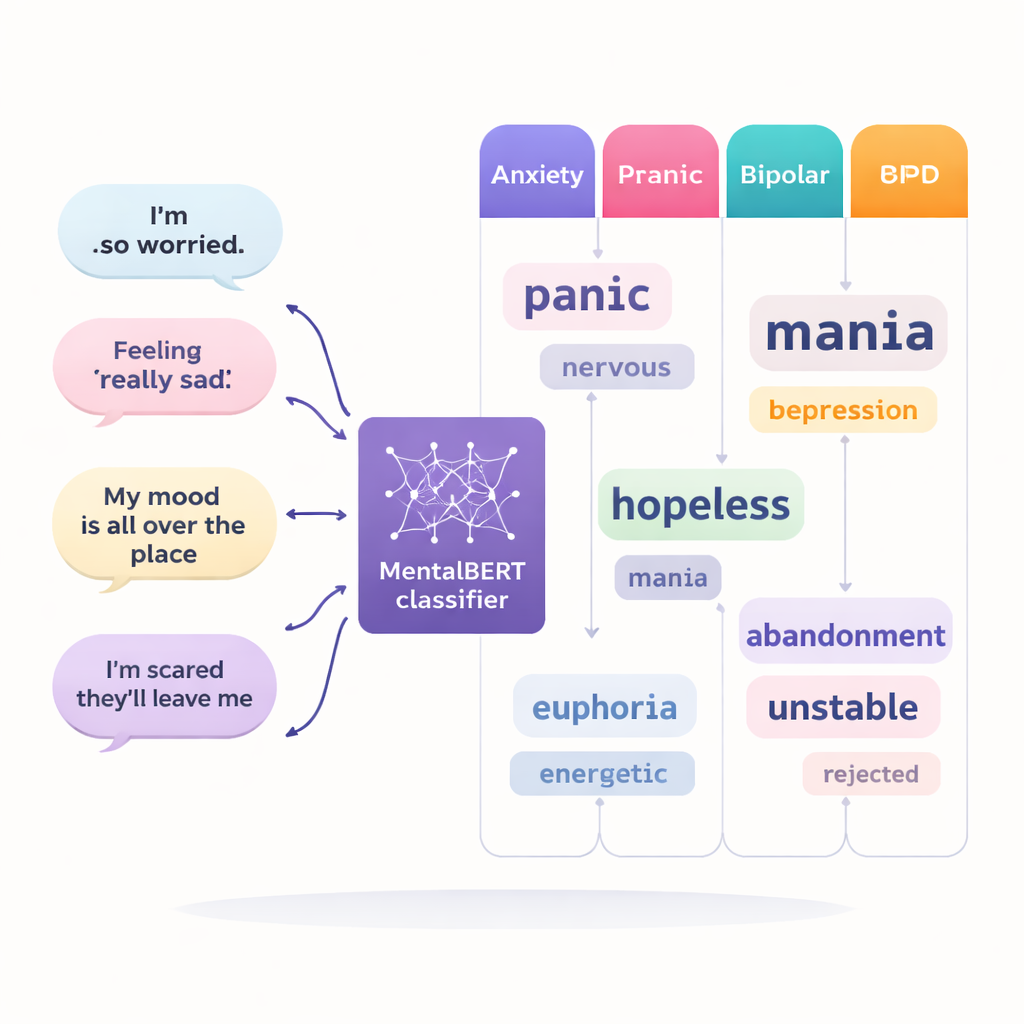

15万件を超える投稿を理解するために、著者らはトランスフォーマーと呼ばれる強力な言語モデル、具体的にはBERTとメンタルヘルスに特化したバージョンであるMentalBERTを使用しました。これらのモデルは各投稿を読み、どの4つのコミュニティのどれに属するかを推定しようとします。あるコミュニティの投稿数が他よりずっと多かったため、チームは各グループが同等に代表されるようにデータセットのバランスを慎重に調整しました。これはタスクを難しくしましたが、公平性を高め、モデルが単に投稿数の多いコミュニティを好むのではなく、言い回しの違いを真に学習するよう促しました。試験では、モデルは約82パーセントの精度で投稿を正しくラベル付けしました。ランダム推測では4分の1しか正解しないため、これは大きな向上です。

AIのブラックボックスを開く

メンタルヘルス技術における大きな懸念は、コンピュータシステムが理由を示さずに予測を出す「ブラックボックス」のように見える点です。これに対処するため、研究者らはLIMEと呼ばれる手法を用いて、モデルの判断に影響を与えた語を明らかにしました。簡単に言えば、LIMEは投稿の一部を隠したり変更したりして、モデルの出力がどのように変わるかを観察します。例えば「panic(パニック)」のような語を取り除くと予測されるコミュニティが突然変わるなら、その語は重要と判断されます。このプロセスを多くの投稿で何千回も繰り返すことで、チームは各コミュニティにとって最も影響力のある語のリストを作成し、これらの語が臨床家の知見と一致するかを確認しました。

異なる苦悩に対する別々の声

説明により、明確な言語パターンが明らかになりました。不安コミュニティでは「panic(パニック)」「attack(発作)」「worry(心配)」などの語が目立ち、しばしば身体症状や突発的な恐怖と結びついています。抑うつの投稿には「hopeless(絶望)」「worthless(無価値)」「life(人生)」「anymore(もう〜ない)」のような語が頻出し、深い悲しみや改善の見込みのなさを反映していました。BPDの議論では「abandonment(見捨てられ感)」「relationship(関係)」「attachment(愛着)」「fp(favorite personの略、当該コミュニティで一般的な用語)」など、対人関係や感情に関連する語が鍵となりました。双極性障害の投稿は気分の変化や治療に関する語が目立ち、「mania(躁)」「manic(躁的)」「hypomania(軽躁)」「mood(気分)」や「lithium(リチウム)」「lamictal(ラミクタール)」などの薬名が含まれました。モデルはまた、条件間で重なりが生じる箇所も示しました。例えば不安と抑うつの投稿はともに苦痛や否定的感情を中心にすることがあり、現実の診断と同様に区別がつきにくい場合があります。

オンライン投稿から現実世界への影響へ

専門家でない人にとっての主要なメッセージは、コンピュータはテーマ別にメンタルヘルスの会話を信頼性を持って分類し、どの語がその選択を促したかを説明できるが、それでも誰かを診断することはできないし、すべきではない、という点です。本研究のモデルはオンライン支援スペースの「司書」のように振る舞い、あるコミュニティでの議論がその掲げる焦点に本当に一致しているかを確認する手助けをします。これはモデレーターが会話の関連性を保つ助けになり、研究者や臨床家が人々が診療外でどのように自分の困難を記述するかをよりよく理解するのに役立つ可能性があります。慎重な人間の監督とプライバシーやスティグマへの配慮を伴えば、こうしたツールはいつか、メンタルヘルスについて話すためのより歓迎され組織化されたオンライン空間を支える助けとなるかもしれません。

引用: Sánchez Rodríguez, I., Bianchi, J., Pinelli, F. et al. Understanding mental health discourse on Reddit with transformers and explainability. Sci Rep 16, 6796 (2026). https://doi.org/10.1038/s41598-026-35918-3

キーワード: メンタルヘルス, ソーシャルメディア, Reddit, 説明可能なAI, テキスト分類