Clear Sky Science · ja

CRFusion: BEVマップ構築のための新しいLiDAR‑カメラ融合ネットワーク

自動運転車のためのより賢いデジタル地図

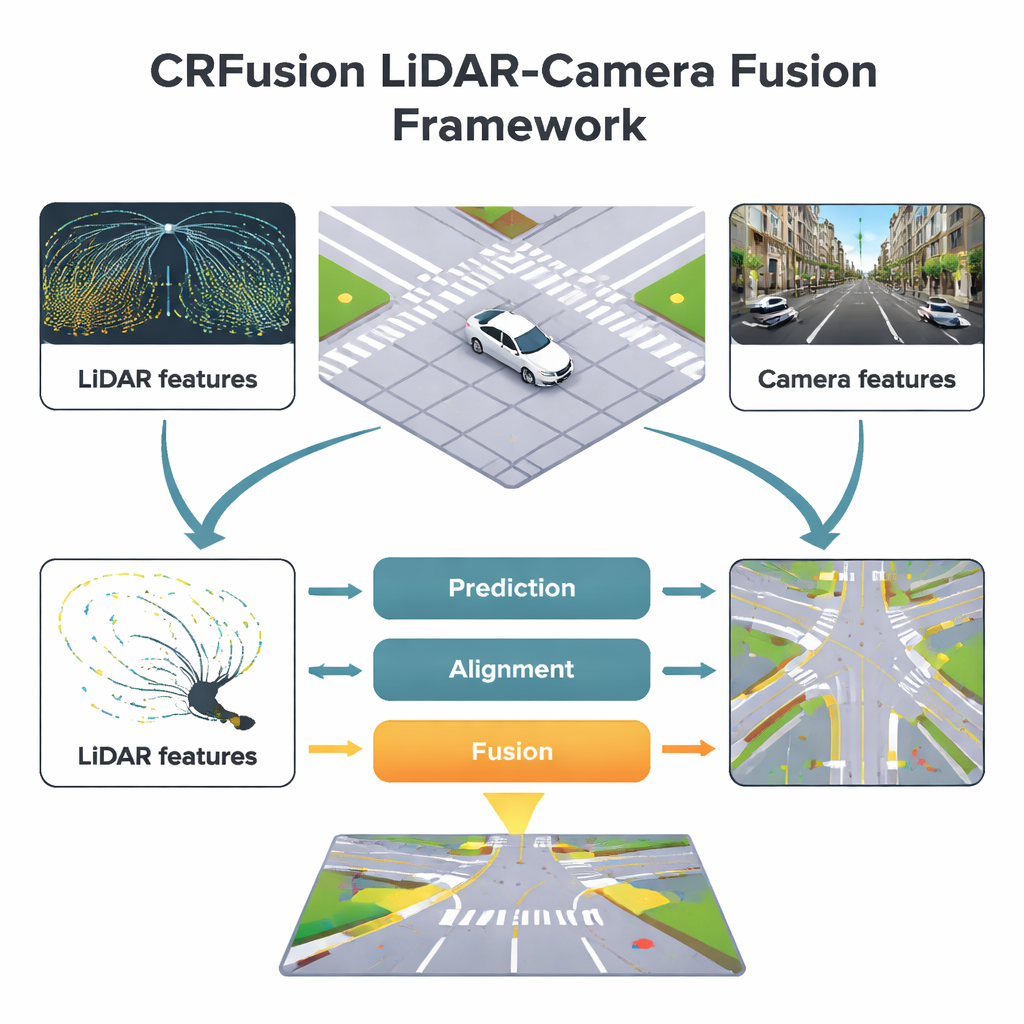

自動運転車にとって、先の道路を理解することは常に変化する地図を読み取るようなものです。車両は、暗闇や雨、視界を遮る物体がある状況でも、車線、横断歩道、路側などの正確な位置を常に把握する必要があります。本稿はCRFusionを紹介します。これはレーザースキャナとカメラを組み合わせて、市街地の上空マップをよりクリーンかつ信頼性高く構築する新しいシステムであり、自動運転車がより高い確信をもって車線を維持し歩行者を回避するのに役立ちます。

なぜ二つの「電子の目」が一つより優れているのか

現代の自動運転車は主に二つのセンサーに大きく依存しています。カメラは豊かな色彩情報を捉え、車線の塗装や交通標識、遠方の横断歩道を識別しやすくします。レーザースキャナ(LiDAR)は光パルスを発して返りを測り、車両周囲の距離や形状の正確な3次元像を構築します。それぞれに弱点があり、カメラは照明不良や悪天候で誤認しやすく、LiDARは距離が伸びると測定がまばらで不完全になります。CRFusionはこれらの長所と短所を統合し、各ピクセルが車線、分離帯、横断歩道などの地面の小領域を示す鳥瞰(トップダウン)マップを生成します。

長距離視野の欠損を埋める

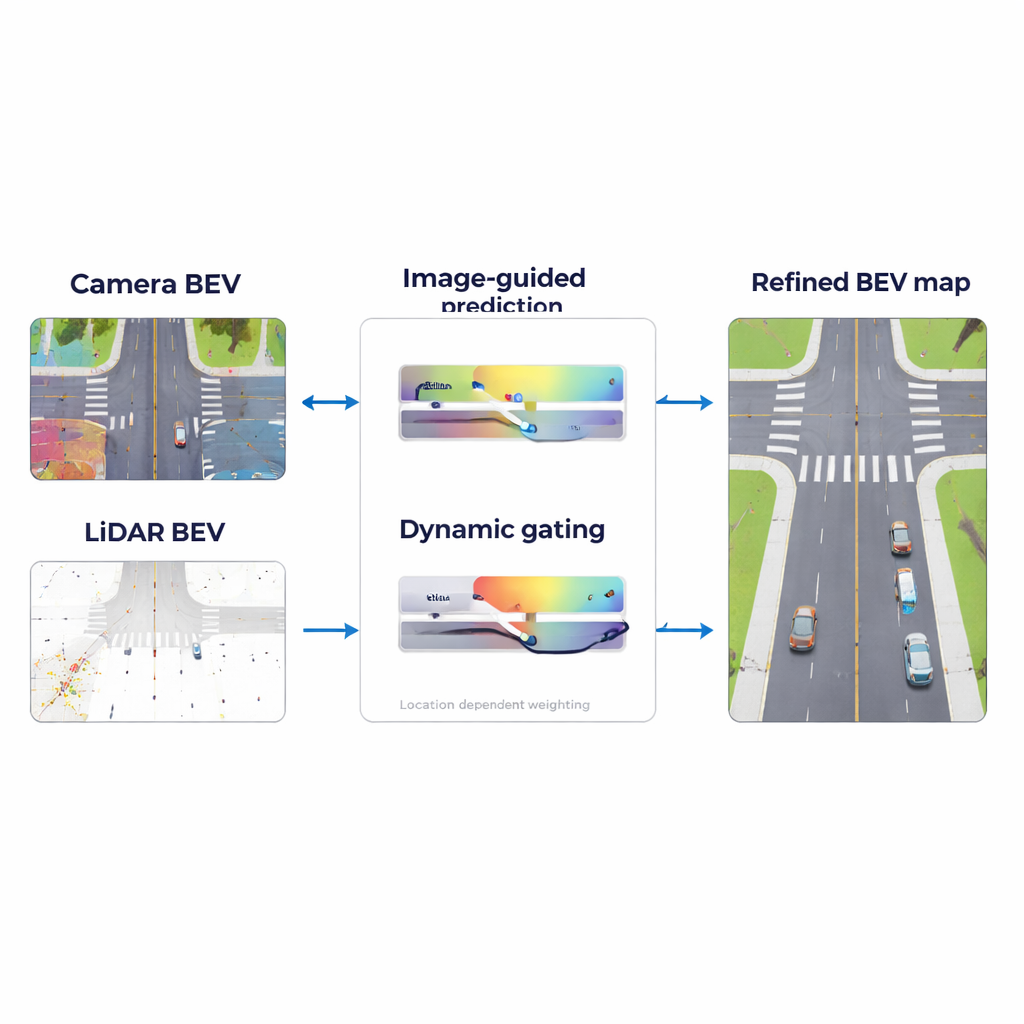

道路マッピングの主要な課題の一つは、LiDARが車両から遠い領域の詳細を見落としがちであることです。先行計画が最も重要となるのはまさにその遠方です。CRFusionは「LiDARレンジ予測器」を用いてこれに対処します。簡単に言えば、システムはカメラが遠方で捉えた映像を見て、もしLiDARが密に完全に計測していたらどのような測定になっていたかを推定します。注意機構(attention)は、カメラのどの部分がLiDARベースの地図の空白や不確かさを最もよく説明するかを判断する手助けをします。その後、地図内の近傍領域と比較して予測を精緻化し、連続した車線線のような一貫したパターンを強化し、ランダムなノイズを低減します。

センサー同士の描画を一致させる

カメラとLiDARの両方が正常に動作していても、完全に一致するわけではありません。距離推定やセンサー取り付け位置の小さな誤差により、カメラで見える車線の位置がLiDARの読みとわずかにずれて見えることがあります。CRFusionはアライメント(整列)ステップを導入し、カメラのトップダウン特徴を穏やかに「歪めて」LiDARビューによりよく一致させます。これは、カメラ地図の各点をどのように微調整すべきかを予測する軽量な補正ネットワークを用いて行われます。その結果、両センサーのビューが同じ物理的道路位置を記述するようになり、後続の融合がはるかに信頼できるものになります。

昼夜や悪天候への適応

二つのセンサービューが整列した後でも、システムは地図上の各地点でどちらをどれだけ信頼するかを決める必要があります。明瞭な車線塗装がある晴れた高速道路と、雨の夜の混雑した市街地は全く異なります。CRFusionは「ダイナミックゲーテッド融合」モジュールを用い、地図上でカメラとLiDARの特徴に柔軟な重みを割り当てます。近距離の路側や堅牢な物体のようにLiDARの応答が強い領域ではLiDARに寄り、遠方の明瞭な横断歩道のような視覚的手がかりが明確な場所ではカメラに重みを置きます。これらの重みはデータから自動的に学習され、状況の変化に応じて融合戦略が滑らかに変化します。

実世界データでの有効性の実証

研究者たちはCRFusionを、さまざまな都市、天候、時刻の走行シーンを含む広く使われている自動運転データセットNuScenesで評価しました。従来の主要手法と比較して、CRFusionは特に中距離から最大90メートルの長距離において車線境界、分離帯、横断歩道をより正確に生成しました。地上真実マップとの重なりや個々の車線セグメント検出能力といった標準的な品質指標が改善され、アブレーション研究では長距離予測、アライメントネットワーク、ダイナミック融合という各主要構成要素がそれぞれ有意な性能向上に寄与していることが示されました。可視化例は車線の連続性が滑らかになり横断歩道がより明瞭になっていることを示し、システムのマップがより慎重に描かれた道路図に近づいていることを確認しました。

日常の運転にとっての意味

専門外の読者にとっての主な結論は、CRFusionがカメラとLiDARをより賢く「対話」させることで、自動運転車がよりクリーンで信頼できる道路マップを構築するのに役立つという点です。カメラ映像から欠落するLiDAR情報を予測し、両センサーの視点を整列させ、状況に応じて各センサーをどれだけ信頼するかを調整することで、死角や推測を減らします。これにより、自動運転車は、よく標示された車線や横断歩道に従う注意深い人間のドライバーと同じような自信を持って、複雑で混雑した市街地を扱える一歩に近づきます。

引用: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

キーワード: 自動運転, LiDAR‑カメラ融合, 高精度セマンティックマップ, 鳥瞰視点(BEV)認識, 都市道路マッピング