Clear Sky Science · ja

Multi-TPC: 音声・動作・視線を備えた三者会話のためのマルチモーダルデータセット

話すときの動きや視線が重要な理由

対面で会話するとき、人々は単に言葉を交換するだけではありません。前へ身を乗り出したり、うなずいたり、互いにちらりと視線を向けたり、適切な箇所でためらったりします。これらの微妙な動きは、三人で話すときに特に重要になります。注目と発話の順番が絶えず移り変わるからです。しかしこれまで、音声、身体の動き、視線が小グループ会話でどのように連携するかを高品質に示すデータはほとんどありませんでした。本稿はそのギャップを埋め、より自然な仮想アシスタントやソーシャルロボット、日常的な人間の相互作用を研究するための道具を作るのに役立つ新しいデータセットを紹介します。

三人会話を覗く新しい窓

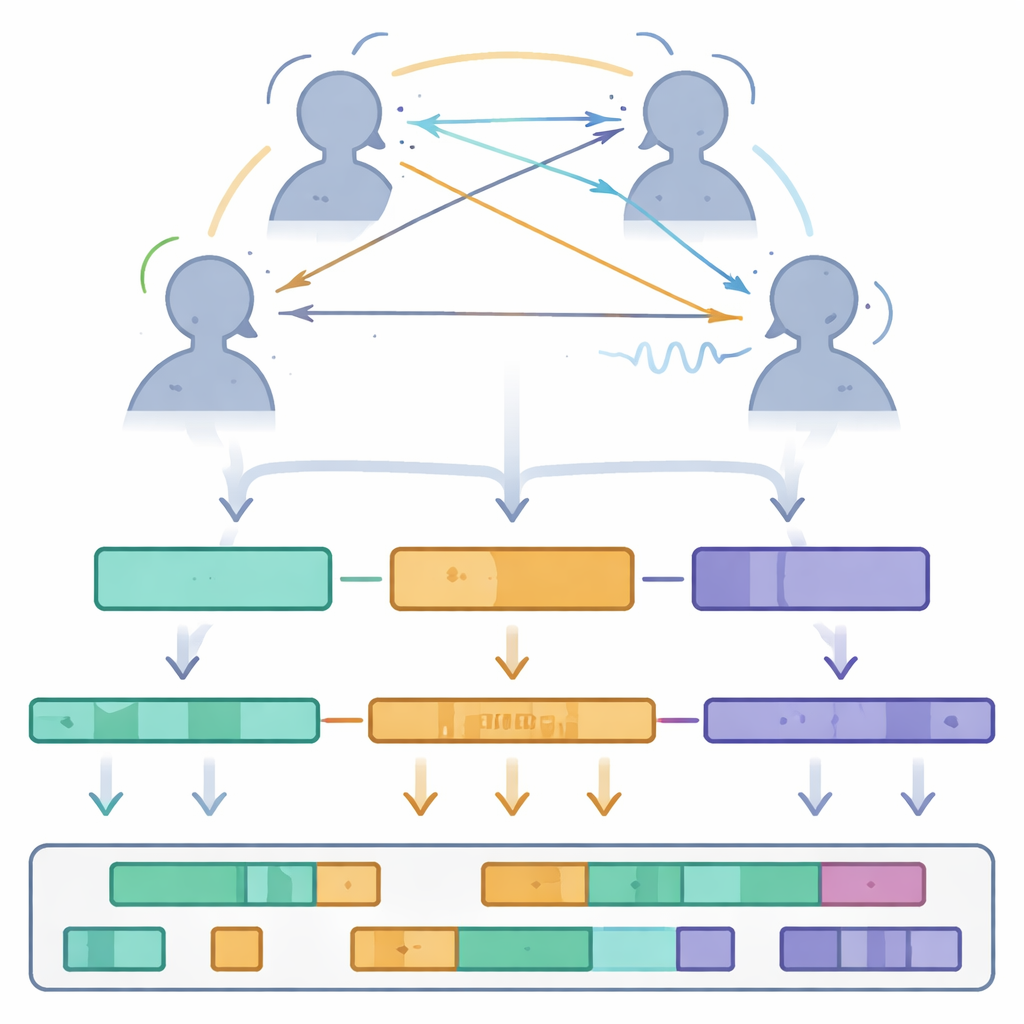

著者らは、モーションキャプチャ、アイトラッカー、個別のマイクを用いて実験室で録音した三者会話を公開するコレクション、Multi-TPCを提示します。単一話者や二者会話に焦点を当てた従来の資源とは異なり、Multi-TPCは三人の見知らぬ参加者が三角形に立ち、自由に話題を選んで行う自然発生的な議論を捉えています。21名の若年成人から得られた合計5.3時間超、24セッション分の記録が含まれ、会話のあらゆる瞬間について各人物の発話、身体動作、視線の詳細が提供されます。

会話の記録方法

このデータセットを構築するために、研究チームはハイブリッドな録音セットアップを作成しました。各参加者は反射マーカーを配した全身モーションキャプチャスーツを着用し、8台のカメラのアレイが姿勢、頭の動き、ジェスチャーを三次元で追跡しました。通常の眼鏡に近い軽量のアイトラッキング眼鏡は、各人が視界のどこを見ているかを測定しました。首元にクリップしたワイヤレスマイクは各話者の声を別々の音声トラックで記録しました。録音前に参加者はシステムでキャリブレーションされ、約1メートルの等辺三角形を形成する固定位置に留まるよう指示されました。カメラ、アイトラッカー、マイクの双方で視認できるクラップボードがすべての機器を時間的に整合させる精密な合図を提供し、動作、視線、音声をフレーム単位で一致させられるようにしました。

データのクリーンアップ、整理、付加

生データの収集は最初の一歩に過ぎません。研究者らはモーションデータを慎重に処理し、すべてのマーカーにラベルを付け、近傍のマーカー位置を照合しながら数学的補間で小さなギャップを埋めました。音声記録はノイズ低減処理で清掃され、その後音声認識ソフトにかけられて単語単位の書き起こしが作られ、最終的に手作業で修正されました。カメラピクセルで測定された視線点は、各人が空間のどこを見ているかを示す三次元角度に変換されました。すべての信号は60フレーム毎秒にダウンサンプリングされて同期され、シンプルでオープンな形式で保存されました。最終的なデータセットはモダリティ別(動作、視線、音声、単語、音量やピッチなどのプロソディ特徴)に整理され、明確なファイル命名規則により研究者が任意の時点を三人すべてにわたって容易にトレースできるようになっています。

グループ会話が示すもの

Multi-TPCを用いて、著者らは三者会話がどのように展開するかの初期的な統計的概観を行いました。発話ターンと無音の間隔を測定したところ、典型的な発話ターンは約2.7秒続き、間に1秒強のポーズが入ることが分かりました。また、聞き手からのフィードバックの一形態としての頭のうなずきや振りの解析では、平均して約0.25回/秒のうなずきや振りが検出され、聞き手が言葉を発さずとも注意や態度を常に示している証拠が得られました。視線解析では、人々が長時間相手の顔をじっと見続けることは稀で、むしろわずかに外した方向を見ることが多く、誰が話しているか、ポーズがあるか、複数人が同時に話しているかによって視線パターンが変化することが示されました。話者が重なる状況では、参加者の視線はより均等に分散したり両方の相手から外れたりし、誰が会話の主導権を持っているか不確かであることを示唆します。

この資源が未来の技術に重要な理由

これらの情報の層を文書化され共有可能なデータセットとしてまとめることで、Multi-TPCは小グループが言葉と動作を使ってターンテイキング、注意、フィードバックをどのように管理しているかを研究する新たな基盤を提供します。一般読者にとっての要点は、会話のダンス—誰がいつ話すか、誰がどこを見るか、そして微妙なうなずきが流れをどう形作るか—が詳細に記録されたことです。研究者や開発者にとっては、これはグループ設定でより人間らしく反応する仮想キャラクタやソーシャルロボットを作る扉を開くだけでなく、音声・身体・視線を通じた我々の協調の仕方をより深く探る研究への道を拓きます。

引用: Lee, MC., Deng, Z. Multi-TPC: A Multimodal Dataset for Three-Party Conversations with Speech, Motion, and Gaze. Sci Data 13, 429 (2026). https://doi.org/10.1038/s41597-026-06819-x

キーワード: マルチモーダル会話, ジェスチャーと視線, 社会的相互作用データセット, ターンテイキング, 仮想エージェント