Clear Sky Science · ja

CNeuroMod-THINGS:視覚神経科学のための高密度サンプリングfMRIデータセット

写真を見ることで私たちの心の働きが分かる理由

私たちは毎日、コーヒーカップやスマートフォンから犬や木々、混雑した通りまで、何千もの画像を目にしています。背後では脳が見たものを瞬時に認識し、しばしば後でそれを記憶します。CNeuroMod-THINGSプロジェクトは、この隠れた活動を驚くほど詳細に記録することを目指し、実世界の画像を見ている間に収集された中でも最も深く測定された脳データセットの一つを作成しました。この資源は次世代の脳科学と人工知能研究を促進することを意図しています。

豊かな脳応答ライブラリの構築

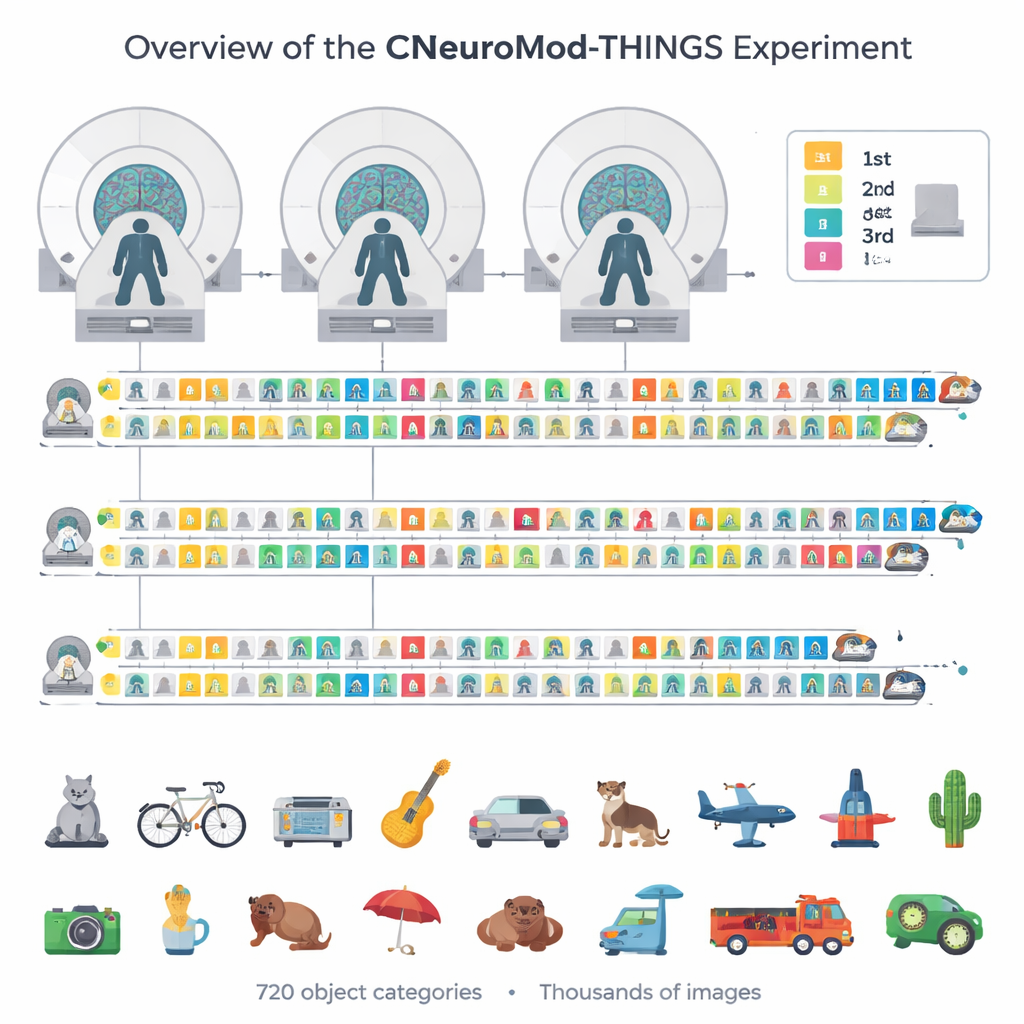

何百人もの被験者を一度か二度スキャンするのではなく、研究チームは強く協力してくれるわずか四名の参加者を繰り返しスキャンしました。各人は33〜36回の来訪を重ね、CNeuroModプロジェクト全体で約200時間の脳イメージングを行い、画像提示だけでも数十時間に及びました。これらのセッションで参加者はTHINGS画像コレクションから抽出された最大4,320枚の異なる写真を見ました。このコレクションは道具、動物、車両、家具など720の身近な物体カテゴリーを網羅しており、単に人気のある物体だけでなく視覚世界の多くの側面が代表されるよう配慮されています。

MRIスキャナー内で行う記憶ゲーム

参加者の集中を維持し記憶を調べるために、研究者たちは画像閲覧を継続的な識別ゲームに仕立てました。各試行では被験者がMRIスキャナーに横たわっている状態で単一の画像が画面中央に表示されます。専用のビデオゲーム風コントローラを使って、参加者はその画像が初出か、新しくない(以前に見た)と思うか、そしてその判断にどの程度自信があるかを報告しました。ほとんどの画像は3回表示されました:初回、同じ来訪内で数分後にもう一度、そして後の来訪で再び(多くは約1週間後)です。このデザインにより、同一画像に対する短期記憶と長期記憶の比較が可能になり、対応する脳活動の変化を追跡できました。

視覚と記憶からの詳細な信号の取得

このデータセットは単純な“オン/オフ”の脳活動測定をはるかに超えています。著者らは高度な解析手法を用いて、各試行および各画像ごとに、脳スキャンの極小の三次元ピクセル(ボクセル)ごとに別々の応答を推定しました。また、参加者の視線位置をアイトラッキングカメラで追跡し、呼吸や心拍、頭部運動も記録しました。品質チェックは信号の安定性が非常に高いことを示しています:参加者はほとんどの試行で応答し、視線は画面中心付近に保たれ、頭部の動きはごく小さかった。顔・身体・風景に強く応答することが知られている主要な視覚領域では、同じ画像が表示されるたびに非常に一貫した活動パターンを生み出しました。これらのパターンは強力で、応答を二次元に単純化してプロットすると、意味的に似た画像(例えば動物や車両)が一緒にクラスタを成す傾向がありました。

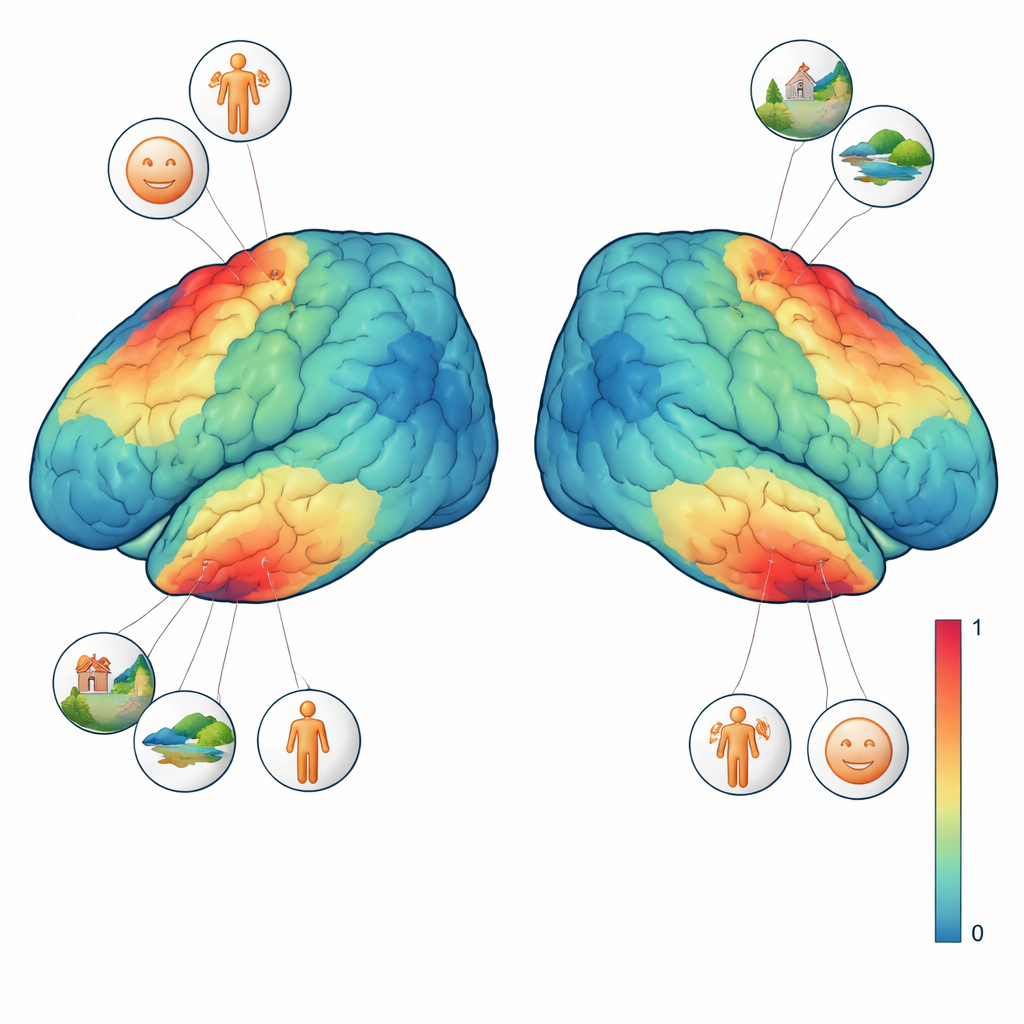

異なる脳領域が何を重視しているかのマッピング

これらの信号をより良く解釈するために、4人のうち3人は追加の視覚検査を受けました。ある検査では、テクスチャの背景上を横切る大きな形が視野のどの部分を各脳領域が“見ている”かを明らかにしました。別の検査では、短いブロックで顔、場所、身体部位、文字(キャラクター)、一般的な物体を提示し、あるタイプの画像を優先する領域を特定しました。これらのローカライザ課題と主実験を組み合わせることで、単一ボクセルが顔があるときにより強く反応するのか、場全体が見えるときに反応するのかなど、精密な問いを立てられます。結果として、顔選択的領域はどの種類の顔が現れても最も強く反応し、一方で風景選択的領域は人物が写っていなくても部屋、通り、風景のような豊かな背景を含む画像を好むことが分かりました。これらの細かな選好は個々の画像レベル、さらには単一ボクセルレベルで現れました。

視覚のより賢いモデルのための基盤

CNeuroMod-THINGSの核は、単発の研究結果ではなく慎重に精選された公開資源です。すべての脳データ、アイトラッキング、行動応答、画像注釈、および解析コードはオープンライセンスの下で自由に共有されています。同じ4名が映画鑑賞、ビデオゲーム、物語の聴取など多くの他の課題でもスキャンされているため、研究者は制御された実験とより自然な体験を結びつける詳細な個人特異的モデルを構築できます。専門外の人への要点は、私たちは今や何千もの日常画像に対して実際の人間の脳がどのように反応するかを示す高解像度の“照合表”を持っているということです。これにより科学者は視覚知覚や記憶に関する仮説を検証し、私たちが世界を見ているのに近い形で捉える人工視覚システムの設計に役立てることができます。

引用: St-Laurent, M., Pinsard, B., Contier, O. et al. CNeuroMod-THINGS, a densely-sampled fMRI dataset for visual neuroscience. Sci Data 13, 141 (2026). https://doi.org/10.1038/s41597-026-06591-y

キーワード: fMRI, 視覚知覚, 物体認識, 脳データ, 記憶