Clear Sky Science · ja

説明力と予測力を兼ね備えた汎用スケールがAI評価を解き明かす

なぜAIのためのより良い成績表が必要なのか

人工知能システムがチャットボットやコーディング補助から、研究室や教室、職場へと移行するにつれて、それらが何をできて何をできないかを知ることが重要になります。現在のAIの成績表は狭いベンチマーク上の単一のテストスコアにとどまることが多く、システムが成功または失敗する理由や、まったく新しい種類の問題でどのように振る舞うかについてはほとんど示しません。本論文は、気温スケールが天候を体系的かつ持続的に測るのと同様に、AIの強み・弱み・将来の性能についてより明確な洞察を与えることを目指した新しい測定方法を提案します。

散発的なテストから共有されるスケールへ

現在の多くのAI評価は、ひとつずつ設計された学校の試験によく似ています。各ベンチマークは多くの能力や難易度を混ぜ合わせ、最終的な評価は単一の割合(パーセンテージ)です。その割合はAIの能力だけでなく、テスト固有の特性にも大きく依存します。著者らは、これでは新しいタスクでの性能を予測することが不可能になり、混乱を招くと主張します。たとえば、ある数学ベンチマークはモデルが「よく推論する」と示し、別のものは逆のことを示唆することがあります。単にスコアを平均するのではなく、それぞれのタスクが一般的で人間に理解可能な一連のスケールに沿ってどれだけ要求しているかで記述することを提案しています。

AI能力の共通の物差しを構築する

この共通の物差しを作るために、研究チームは広範な認知能力や知識領域をカバーする18の要求スケールを設計しました。これには、言語の理解、連鎖的推論の追随、自己の知識に対する省察、自然科学・社会科学・応用科学・形式科学に関する事実知識などの能力が含まれます。また、問題の本質的な能力を変えずに難易度を上下させる「余計な」要求(たとえば問いの珍しさ、情報量の多さ、または選択肢形式かどうか)も追跡します。各スケールは要求ゼロからより高い挑戦レベルへと連続的に設定され、おおむねレベルが上がるほどその項目を解ける人やAIは大幅に少なくなるよう整合されています。

機械に課題の本当の要求をラベル付けさせる

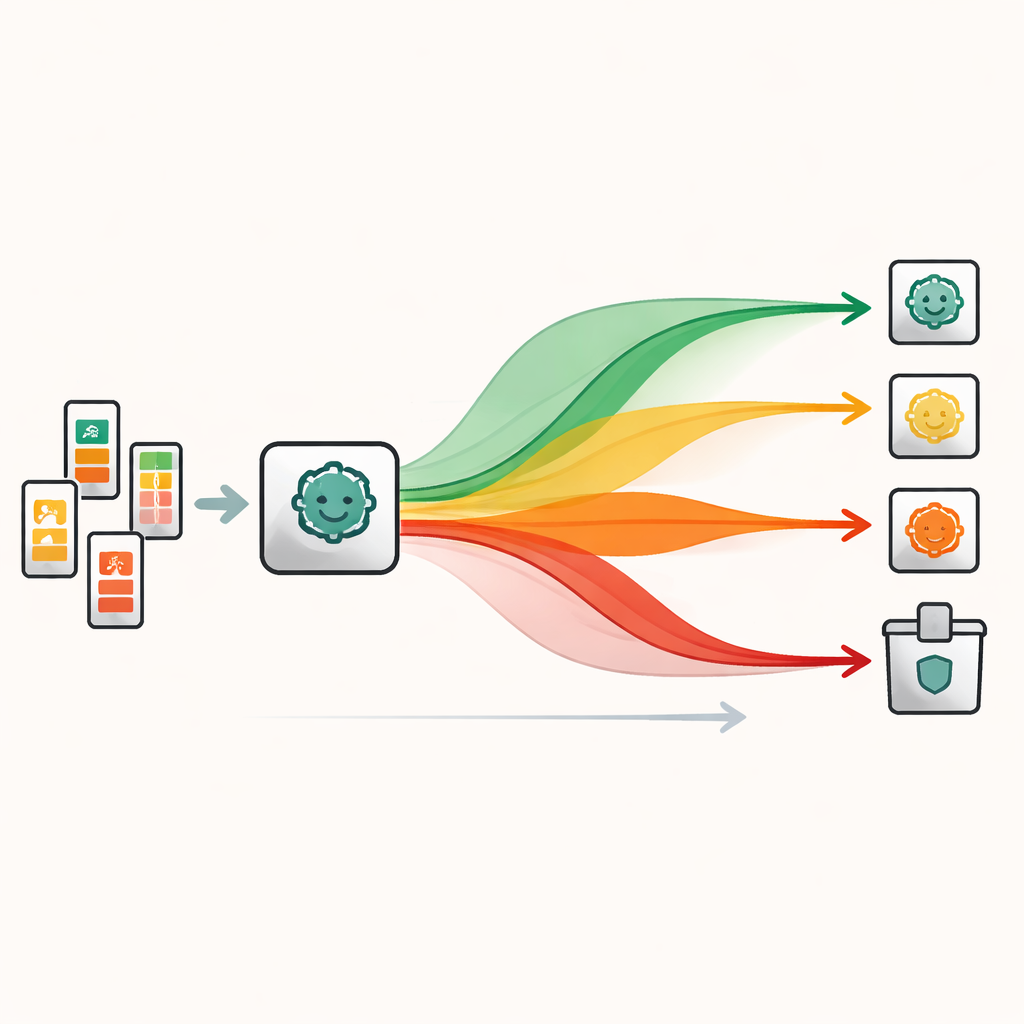

Figure 1.

18のスケールに沿って何千もの問題を専門家だけで手作業で採点することは不可能に近いため、著者らは先端的な言語モデル自体を注釈者として利用します。彼らは各スケールの各レベルに対して例を含む詳細なルーブリックを書き、それからモデル(GPT‑4o)に対して20の現代的なAIベンチマークから抽出した16,000件以上の問題に要求レベルを割り当てさせます。人間の専門家がその一部を確認し、モデルのラベルと高い一致を示しました。一度注釈されれば、各ベンチマークは各能力をどれだけ実際に試しているかを示す「要求プロファイル」として可視化できます。これにより、多くの著名なテストが設計者の意図するものを測っていないことが明らかになります。あるものは推論に焦点を当てると主張する一方で稀な事実知識に依存し、別のものは単一の難易度レベルに集中しており、感度(幅広いレベルをカバーする)と特異性(意図しない技能を避ける)を両立しているものはほとんどありません。

生のスコアではなくAIの能力曲線を読む

タスクに同じスケールを適用したら、次のステップは各次元で要求が高まるときに異なるAIシステムがどのように対処するかを見ることです。著者らは3つの主要ファミリーから15の大規模言語モデルを試し、各スケールについてタスクが難しくなるにつれて成功する確率を調べます。これらの点に滑らかな曲線を当てはめることで、他の要求がそれほど高くないときに約半分の確率で成功する要求レベル、すなわち各モデルの「能力レベル」を求めます。生の正答率とは異なり、これらの能力スコアはベンチマーク内の易しい項目と難しい項目の混合比に依存しません。得られたプロファイルは明確なパターンを示します:大きなモデルは主に事実知識を改善し、一方で「推論」特化モデルは数値的・論理的思考、関連情報の識別、さらには他者の心や社会状況のモデル化においてより大きな伸びを示します。曲線はまた収穫逓減を明らかにします:単にパラメータ数を増やすだけでは最終的に能力の向上は限定的になります。

要求プロファイルを使ったAI行動の予測と制御

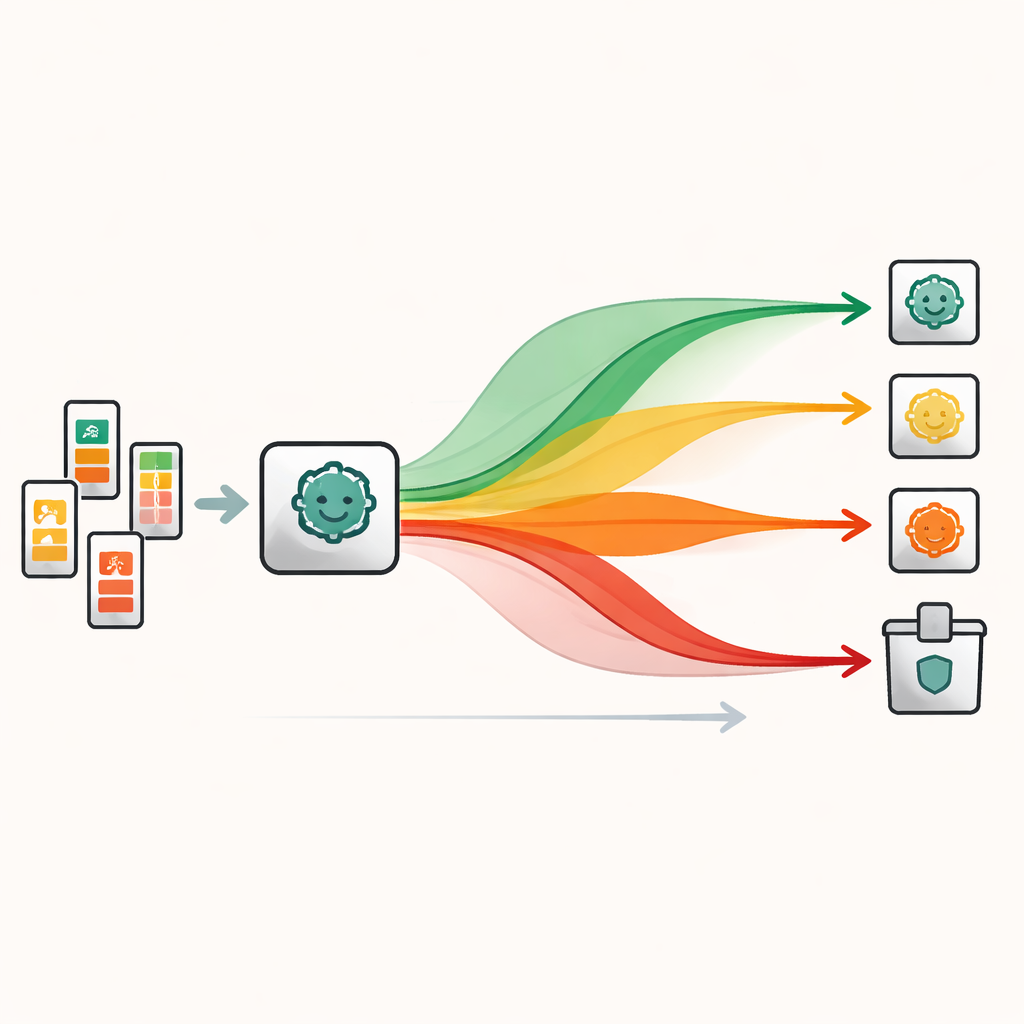

Figure 2.

タスクとシステムが同じ一連のスケール上にあるため、著者らは評価を予測問題として扱うことができます。彼らは問いの18の要求レベルだけを入力とし、特定のAIが正答する確率を出力する単純な機械学習「アセッサー」を訓練します。これらのアセッサーは、なじみのあるタスクだけでなくまったく新しいタスクや訓練から除外したベンチマークでも非常に高精度な成功予測を行います。テキスト埋め込みや大規模モデルの直接ファインチューニングに頼るより重厚なブラックボックスアプローチよりも優れています。これにより、到着する各問い合わせを最も安全に処理できるモデルに振り分けたり、どのモデルの信頼領域にも入らない問い合わせを害が生じる前に拒否したりするなどの実用的な用途が可能になります。

AI評価の科学に向けた一歩

著者らは、汎用の要求スケールと能力スケールがAIの評価と展開の仕方を変え得ると結論づけます。ますます巨大で短命なベンチマークや不透明な集約スコアを追いかけるのではなく、なぜシステムが失敗するのかを説明し、ドメインを横断して公平に比較し、新しいタスクでの振る舞いを予測できる安定的で拡張可能な測定フレームワークを構築できます。物理学の標準化された単位が精密な工学を可能にしたのと同様に、共有されよく設計された一連の認知スケールは、今後のより安全で予測可能なAI利用の基盤となり得ます。

引用: Zhou, L., Pacchiardi, L., Martínez-Plumed, F. et al. General scales unlock AI evaluation with explanatory and predictive power. Nature 652, 58–67 (2026). https://doi.org/10.1038/s41586-026-10303-2

キーワード: AI評価, ベンチマーキング, 大規模言語モデル, 予測的評価, AI安全性