Clear Sky Science · ja

大規模言語モデルのモザイク的記憶

ニアミスコピーが重要な理由

ChatGPTのような大規模言語モデルは膨大なテキストから学習し、その一部を記憶してしまうことがあります。これがプライバシーや著作権、そしてこれらのシステムが本当に何を知っているかを公正に評価できるかという懸念を生じさせます。本論文は、記憶化が単なる完全なコピペにとどまらないことを示します。言語モデルは、多数のわずかに異なるバージョンから断片を再構成でき、まるでモザイクを組み立てるように通読文を再現します。この隠れた種類の記憶を理解することは、安全で信頼できるAIを目指す者にとって不可欠です。

機械の記憶を考える新しい枠組み

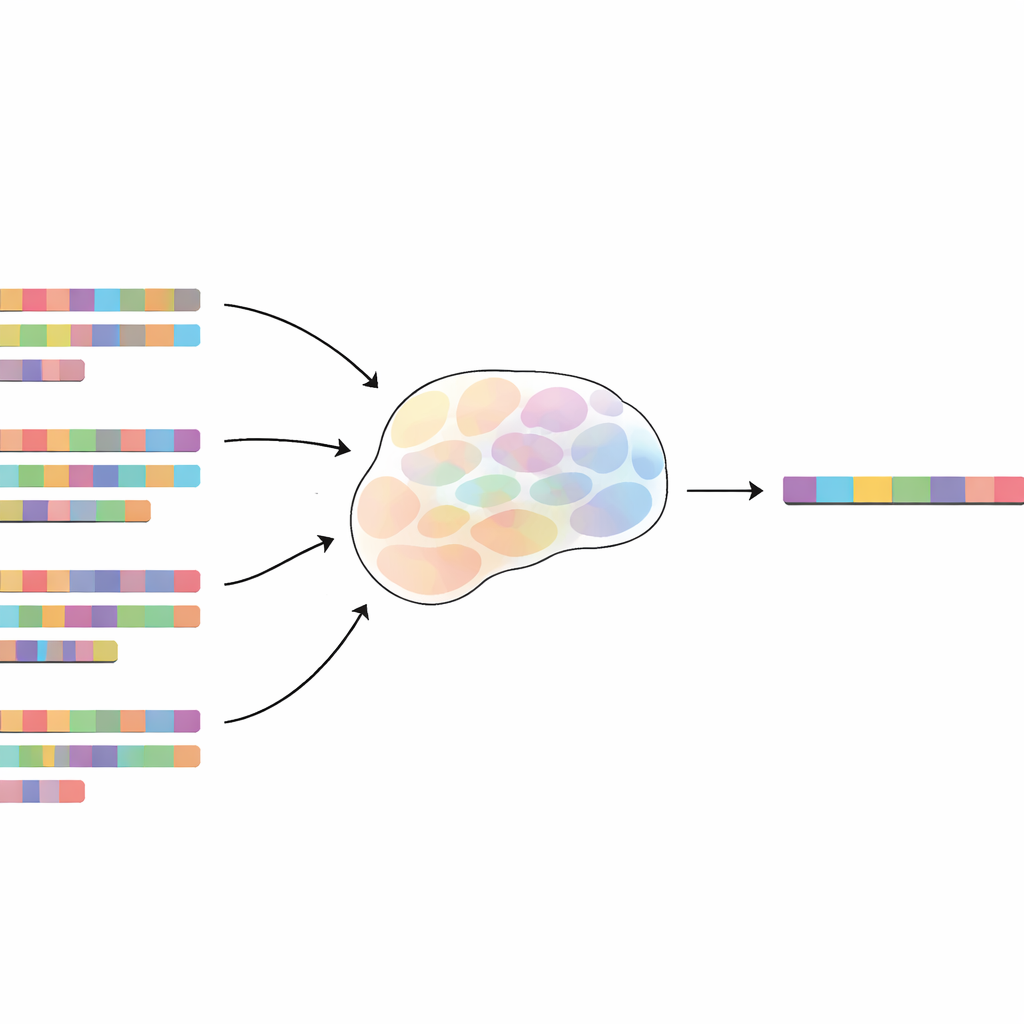

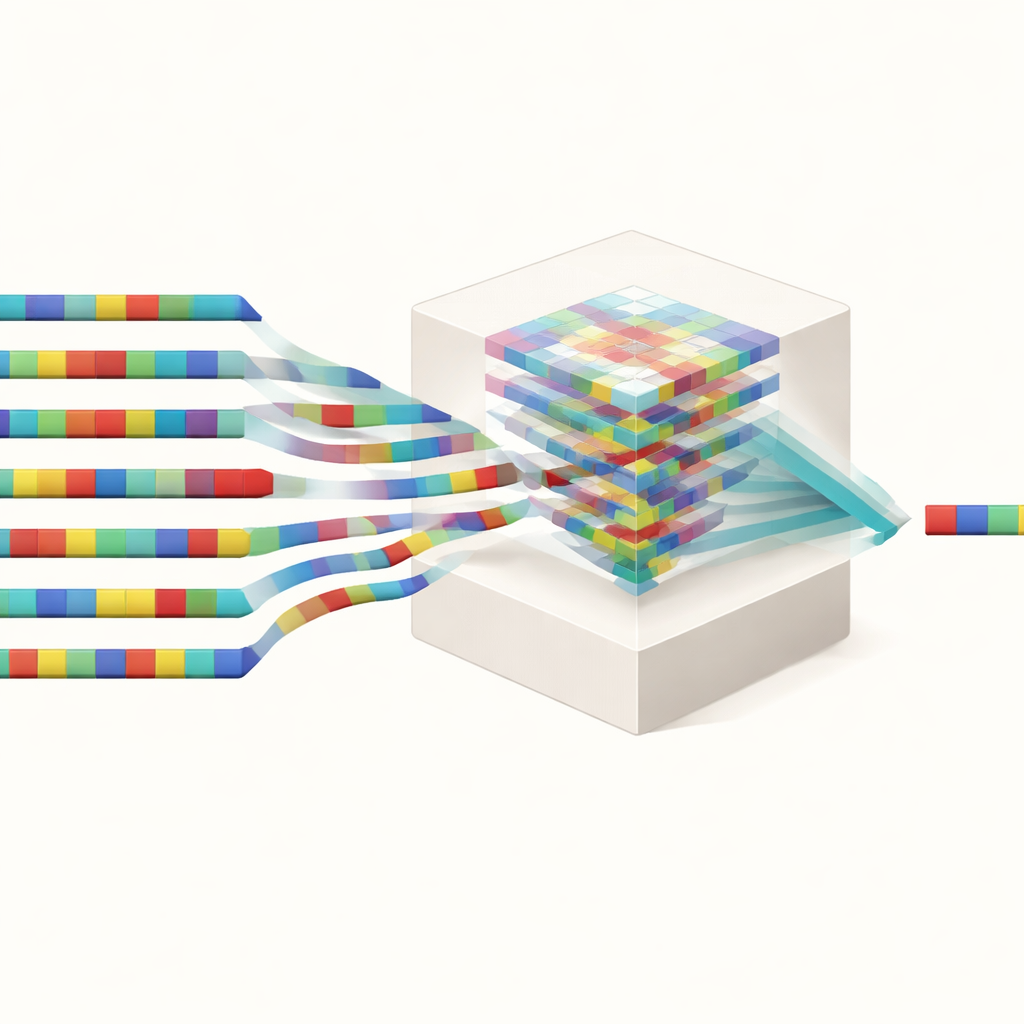

多くの人は、言語モデルが何かを記憶するのはまったく同一の文を何度も見たときだけだと想定します。著者らはこの見方に異議を唱え、「モザイク記憶」という概念を導入します。この考えでは、モデルは100語の文章を、完全に同一の繰り返しだけでなく、語が抜けたり置き換わったり順序が入れ替わったりした多数のあいまいな重複からも記憶できるとします。これを慎重に調べるために、彼らは「カナリア」と呼ばれる人工のテストフレーズを学習データに埋め込み、それに多数の変形版を加えます。学習後、メンバーシップ推定攻撃と呼ばれる一種のプライバシーテストを用いて、あるカナリアが学習セットに含まれていたかを判定する難易度を測定します。

あいまいなコピーでも鮮明な痕跡を残す仕組み

あいまいな重複と完全な繰り返しを比較することで、研究者らは「完全重複等価物」を定義します。これは、あいまいなコピーが完全なコピーと比べて記憶化にどれだけ寄与するかを示します。彼らは非常に軽微な変更でも記憶化の弱まりはほとんどないことを見いだします。各重複でランダムに約10%の語が置き換わる程度でも、単一のあいまいなコピーは完全な重複の約60〜65%程度の寄与を示します。半分の語が変更されても、各変形版は依然として完全なコピーの約15〜20%に相当します。この効果は頑健であり、重要なフレーズの間に無作為な埋め草語を挿入したり文の塊をシャッフルしたりしても、記憶化が減るものの完全には消えません。モデルはノイズを飛ばし、重なり合う断片に注目してそれらをつなぎ合わせる能力があるように見えます。

モデルが保存するのは意味よりも形

現代の言語モデルが数学問題を解いたり指示に従ったり翻訳したりできることを考えると、その記憶は意味に関するものだと期待するかもしれません。驚くべきことに、本研究は逆の結果を示しています。著者らが語を意味を保つ代替語に置き換えた場合、ランダム語に置き換えた場合と比べて記憶化がわずかしか改善しないことが分かりました。他のAIによって生成されたパラフレーズ(同じアイデアを残しつつ表層を変えたもの)は、元の文章と多くの短い語列を共有していない限り、記憶化にほとんど寄与しません。幅広いテストを通して、本当に記憶を駆動しているのは共通する正確なトークン(モデルの基本的な語片)の重なりであり、共有するアイデアではないことが示されます。言い換えれば、モデルのモザイク記憶は主に形(形式)に関するもので、意味ではないのです。

実世界の学習データに潜む隠れた重複

次に著者らは、言語モデルの学習に使われる人気のある大規模クリーニング済みウェブデータセット、SlimPajamaであいまいな重複がどれほど一般的かを問います。このデータセットはほぼ同一の文書が既に除去されているにもかかわらず、研究チームは、正確に1,000回出現する多くの100トークン連続列が、数千のニアミス版を持っていることを見つけました。小さな編集距離—文字の約10%が変更される程度—においては、平均で正確なものの約4倍のあいまいな重複が存在し、より大きいが影響力のある距離でも数万件の追加が確認されます。重要なのは、業界で使われる標準的な「重複除去」技術が、通常は長い完全な重複だけを除去するため、これらのあいまいなコピーの大半をそのままにしてしまう点です。つまり、モデルは多くのわずかに改変された出典から断片をつなぎ合わせることで、敏感情報や著作権のある資料を記憶してしまう可能性が残ります。

プライバシー、公平性、制御に対する含意

これらの発見は広範な含意を持ちます。プライバシーの観点では、学習データから正確な重複を単に取り除くだけでは不十分であることを示しています。個人情報や機密情報は類似した文の集合を通じて記憶され得ます。著作権やベンチマークの観点では、あいまいな重複によりモデルが保護されたテキストを再現したり、変装した形で既に見たテストによってスコアを人工的に押し上げたりする可能性があります。特定のデータを「忘れさせる」試みでも、多数の変形が残っていれば単一の問題例を削除するだけでは不十分です。全体として、この研究は言語モデルの記憶が多数の小さな重なりから成る複雑なモザイクであることを明らかにし、現行の安全対策に挑戦を突きつけ、より細粒度で賢明な学習データのクレンジングと監査の必要性を示しています。

引用: Shilov, I., Meeus, M. & de Montjoye, YA. The mosaic memory of large language models. Nat Commun 17, 2142 (2026). https://doi.org/10.1038/s41467-026-68603-0

キーワード: 言語モデルの記憶化, あいまいな重複, データプライバシー, 学習データの重複除去, ベンチマーク汚染