Clear Sky Science · it

Copilota chirurgico RARP: un modello visione-linguaggio per la prostatectomia radicale assistita da robot

Aiuto più intelligente in sala operatoria

La chirurgia moderna del cancro alla prostata viene eseguita con robot e telecamere sofisticate, eppure i chirurghi devono ancora gestire decisioni complesse, viste che cambiano rapidamente e domande costanti da parte dei tirocinanti e del personale. Questo articolo presenta un «copilota» di intelligenza artificiale in grado di osservare il video della chirurgia in tempo reale e rispondere a domande pronunciate sul posto, come farebbe un assistente altamente esperto. Per i pazienti, questo indica operazioni più sicure e coerenti; per i chirurghi, suggerisce un futuro in cui guida esperta e insegnamento sono disponibili in ogni sala operatoria.

Un assistente digitale che vede e parla

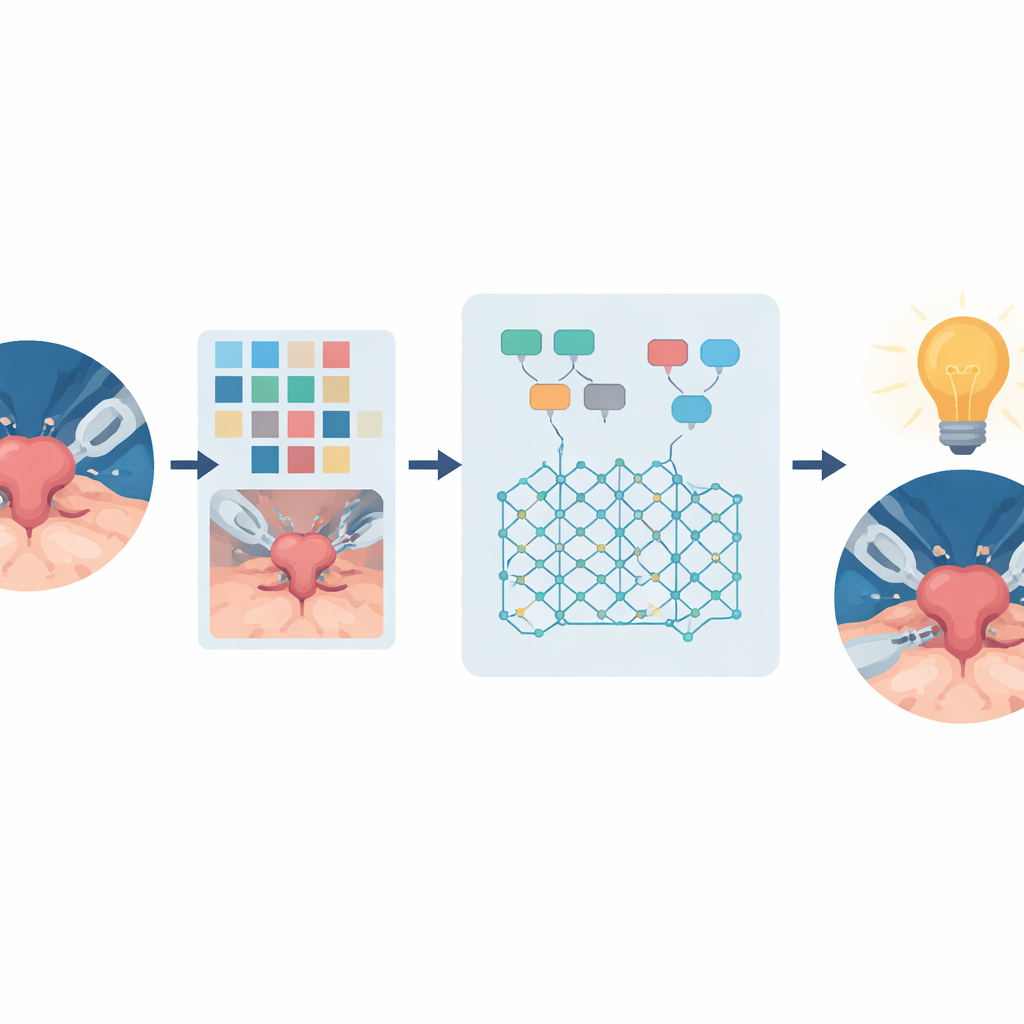

I ricercatori hanno costruito il Surgical RARP Copilot per un intervento specifico: la prostatectomia radicale assistita da robot, l’operazione standard per molti uomini con tumore prostatico localizzato. In questa procedura, un sistema robotico controllato dal chirurgo rimuove la prostata tramite piccole incisioni a “porta chiave”, guidato da una telecamera ad alta definizione all’interno del corpo. I sistemi di IA tradizionali basati solo su chat elaborano soltanto testo, quindi non possono interpretare ciò che mostra la telecamera chirurgica. Il Copilot invece combina la visione artificiale con un grande modello linguistico, permettendogli di “vedere” il campo operatorio e generare risposte in linguaggio naturale su ciò che sta accadendo, quali strumenti sono in vista o quali dovrebbero essere i passi successivi dell’operazione.

Insegnare conoscenze chirurgiche al Copilot

Per dotare il Copilot di competenze chirurgiche significative, il team ha assemblato un set di addestramento specializzato invece di affidarsi a immagini generiche prese da Internet. Hanno raccolto quasi 20.000 fotogrammi etichettati da operazioni prostatiche registrate, segnando le posizioni degli strumenti, degli organi e il passo corrente della procedura. Hanno inoltre aggiunto informazioni di profondità approssimative, così il sistema poteva dedurre quali oggetti sono davanti o sono a contatto fra loro. Usando regole progettate da esperti, queste etichette sono state convertite in didascalie scritte dettagliate che descrivevano cosa mostrava ciascun fotogramma e a che punto dell’intervento si trovava. Grandi modelli linguistici sono stati poi istruiti, con la voce di diverse “personae” che andavano da chirurghi senior a bambini curiosi, per generare oltre un milione di coppie domanda–risposta basate su quelle didascalie. Un modello separato ha verificato queste coppie per coerenza logica, e gli esempi difettosi sono stati filtrati prima dell’addestramento.

Quanto bene si comporta il Copilot

Una volta addestrato, il Copilot è stato testato in diversi modi. Su un insieme tenuto fuori di coppie domanda–risposta sintetiche, il fine-tuning ha aumentato la capacità del modello di dare risposte almeno parzialmente corrette dal circa 61% all’83%, e risposte completamente corrette dallo 0% al 59%. Revisori umani hanno poi posto 650 domande su immagini chirurgiche preregistrate; quasi sette risposte su dieci sono state giudicate completamente corrette. Il sistema ha affrontato anche compiti classici di visione artificiale senza riaddestramento aggiuntivo: ha identificato quale fase della prostatectomia fosse in corso a partire da un singolo fotogramma video con l’82% di accuratezza e ha riconosciuto gli strumenti chirurgici con un F1-score del 94%, stimando anche quanto tempo mancasse alla fine dell’intervento. Questi risultati suggeriscono che un singolo modello unificato può eguagliare strumenti specializzati su più compiti pur mantenendo la capacità di conversare in modo aperto.

Integrare l’IA in un’operazione dal vivo

La dimostrazione più impressionante ha avuto luogo in una sala operatoria reale. Il Copilot è stato distribuito su un potente computer edge collegato direttamente al flusso video della chirurgia robotica. Durante una prostatectomia dal vivo eseguita su una piattaforma robotica diversa da quella usata per l’addestramento, un pubblico di chirurghi e ingegneri ha inviato 276 domande tramite i propri smartphone. Dopo aver filtrato le domande irrilevanti e i duplicati, gli esperti hanno giudicato che il Copilot ha risposto correttamente a circa il 77% delle domande rimanenti—paragonabile alla sua performance offline. Il sistema ha risposto in circa mezzo secondo prima di iniziare la sua replica e ha prodotto testo abbastanza rapidamente da risultare interattivo, applicando nel contempo filtri di sicurezza e un comportamento prudente quando incerto.

Cosa significa questo per la chirurgia futura

Per i lettori non specialisti, il messaggio chiave è che un sistema di IA può ora osservare in tempo reale un delicato intervento oncologico e fornire risposte utili e contestualizzate su ciò che sta accadendo e su cosa dovrebbe succedere dopo. Sebbene l’attuale Copilot sia limitato a un tipo di intervento, si basi su istantanee piuttosto che su una memoria video completa e non abbia ancora accesso alle cartelle cliniche complete, dimostra che l’IA multimodale può essere portata in sicurezza in sala operatoria. Man mano che sistemi simili vengono estesi ad altre procedure, collegati a dati del paziente più ricchi e testati rigorosamente per l’impatto clinico, potrebbero supportare la formazione, migliorare la comunicazione del team e, in ultima istanza, contribuire a rendere la chirurgia complessa più sicura e trasparente.

Citazione: Bogaert, W., Remy, F., Tejero, J.G. et al. Surgical RARP copilot: a vision language model for robot-assisted radical prostatectomy. npj Digit. Surg. 1, 3 (2026). https://doi.org/10.1038/s44484-025-00003-1

Parole chiave: chirurgia robotica, carcinoma della prostata, IA chirurgica, modello visione-linguaggio, assistenza in sala operatoria