Clear Sky Science · it

Rilevare il linguaggio stigmatizzante nelle note cliniche con grandi modelli linguistici per l’assistenza nelle dipendenze

Perché le parole nella tua cartella clinica contano

Con l’aumento dell’accesso online dei pazienti alle loro cartelle cliniche, il linguaggio che i clinici usano non è più nascosto nei computer dell’ospedale: è visibile alle stesse persone di cui parla. Per le persone che vivono con una dipendenza, una singola espressione come “tossicodipendente” può rafforzare silenziosamente la vergogna, danneggiare la fiducia e persino influenzare le cure che ricevono. Questo studio pone una domanda attuale: l’intelligenza artificiale moderna può aiutare gli ospedali a individuare e ridurre il linguaggio stigmatizzante nelle note cliniche prima che danneggi i pazienti?

Etichette dannose nascoste nelle note quotidiane

Lo stigma nell’assistenza sanitaria non si manifesta solo nello sguardo o nel tono di voce; è anche incorporato nella documentazione scritta. Le cartelle cliniche elettroniche contengono milioni di note che seguono i pazienti tra ambulatori e ospedali. Termini come “abuso di alcol” o “comportamento in cerca di droga” possono influenzare come i clinici futuri vedono una persona molto tempo dopo una visita al pronto soccorso o un ricovero. I ricercatori si sono concentrati sulle note delle unità di terapia intensiva riguardanti pazienti con problemi di uso di sostanze, dove la posta in gioco è alta e la documentazione è densa. Sono partiti da linee guida nazionali che promuovono un linguaggio rispettoso e che mette la persona al primo posto, come “persona con disturbo da uso di sostanze” invece di “dipendente”, e hanno usato queste idee per creare un ampio dataset di note etichettate come stigmatizzanti o meno.

Insegnare a un’IA a leggere tra le righe

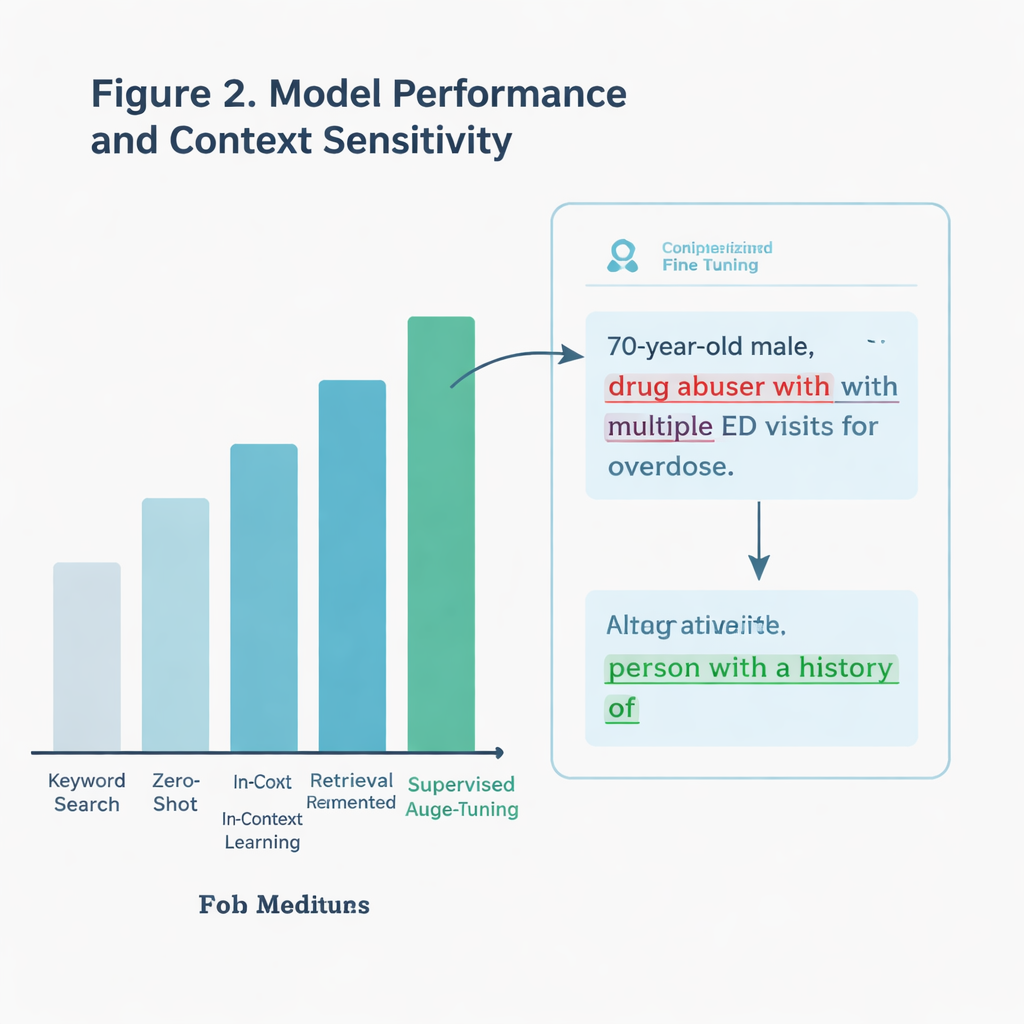

Piuttosto che limitarsi a cercare parole vietate, il team voleva un sistema di IA in grado di comprendere il contesto. Per esempio, una nota potrebbe riportare una citazione del paziente che si definisce “ubriaco”, il che non è la stessa cosa che un clinico che applica quell’etichetta. Gli autori hanno confrontato diversi approcci, tutti basati su un grande modello linguistico (un tipo di IA che elabora e genera testo). Un metodo di base cercava solo parole chiave specifiche tratte dalle linee guida. Metodi più avanzati chiedevano all’IA di giudicare direttamente ogni nota, senza esempi aggiuntivi, con indicazioni supplementari tratte da linee guida comunicative, o dopo essere stati appositamente addestrati — o “messi a punto” — su migliaia di note di terapia intensiva etichettate.

Ciò che ha funzionato meglio nel mondo reale

Il modello messo a punto è risultato il chiaro vincitore. Su un set di test tenuto separato di oltre 11.000 note, ha identificato correttamente il linguaggio stigmatizzante circa il 97% delle volte, molto meglio della semplice ricerca per parole chiave. Ha mantenuto inoltre un comportamento migliore su un sottoinsieme particolarmente insidioso di note che contenevano termini potenzialmente carichi ma non sempre usati in modo dannoso. Il modello è riuscito a distinguere tra frasi realmente giudicanti e usi neutrali o citati, dove una ricerca più grezza avrebbe fallito. Quando il team ha testato il sistema su note provenienti da un diverso sistema sanitario — quasi 300.000 note di terapia intensiva scritte in un altro stato — ha comunque superato l’approccio basato sulle parole chiave, nonostante il linguaggio stigmatizzante fosse raro in quel campione reale.

Trovare nuove frasi problematiche che i clinici avevano trascurato

I ricercatori sono andati oltre e hanno chiesto all’IA di spiegare perché aveva segnalato certe note. Un esperto in dipendenze ha poi rivisto queste spiegazioni. In dozzine di casi, i modelli hanno messo in evidenza linguaggio effettivamente stigmatizzante che gli annotatori umani avevano inizialmente trascurato, incluse frasi non elencate nelle linee guida esistenti. Esempi comprendevano descrizioni come “comportamento in cerca di droga” o menzioni casuali di “cirrosi alcolica” che colpevolizzano sottilmente la persona anziché la malattia. Questo suggerisce che strumenti di IA ben progettati potrebbero non solo far rispettare le migliori pratiche attuali, ma anche aiutarci a espandere la comprensione di cosa costituisca linguaggio dannoso man mano che la scrittura clinica evolve.

Da strumento di ricerca ad aiuto al letto del paziente

Lo studio ha valutato anche questioni pratiche. La ricerca per parole chiave è fulminea ma superficiale. Il modello di IA più accurato ha richiesto diverse ore di addestramento su potenti processori grafici, tuttavia una volta addestrato poteva analizzare le note in pochi secondi ciascuna — lento per un motore di ricerca, ma accettabile per un assistente in background in un sistema ospedaliero. Un altro approccio, meno personalizzato e basato solo su prompt attentamente formulati, ha funzionato ragionevolmente bene senza addestramento aggiuntivo, suggerendo opzioni più leggere per cliniche con risorse tecniche limitate. Nel complesso, questi risultati indicano sistemi in grado di segnalare formulazioni a rischio in tempo reale e suggerire alternative più rispettose mentre i clinici scrivono.

Un passo verso un’assistenza più rispettosa

Per un lettore non tecnico, la conclusione principale è semplice: le parole nella tua cartella clinica non sono solo gergo tecnico; contribuiscono a determinare come vieni trattato. Questo lavoro mostra che i grandi modelli linguistici possono individuare in modo affidabile molte forme di linguaggio stigmatizzante legate alle dipendenze nelle note di terapia intensiva, anche quando il problema è sottile. Pur non essendo perfetti, tali strumenti potrebbero fungere da editor sempre attivi, spingendo i clinici verso un linguaggio che riconosca le persone come più delle loro diagnosi. Sul lungo periodo, questo cambiamento — dalla colpa al rispetto — potrebbe essere importante per la guarigione tanto quanto qualsiasi farmaco o dispositivo.

Citazione: Sethi, R., Caskey, J., Gao, Y. et al. Detecting stigmatizing language in clinical notes with large language models for addiction care. npj Health Syst. 3, 15 (2026). https://doi.org/10.1038/s44401-026-00069-0

Parole chiave: stigma nelle dipendenze, note cliniche, grandi modelli linguistici, cartelle cliniche elettroniche, linguaggio che mette la persona al primo posto