Clear Sky Science · it

Framework spiegabile di ragionamento a multi-granularità per l’individuazione delle fake news

Perché individuare le fake news sta diventando più difficile

Ogni giorno milioni di post che combinano parole e immagini scorrono sui social media. Alcuni sono innocui, altri veri e alcuni sono falsi, progettati per attirare attenzione, suscitare emozioni o influenzare opinioni. Man mano che gli strumenti di fotoritocco e i generatori di IA diventano più economici e facili da usare, le fake news si fanno più raffinate e più pericolose. Questo articolo presenta un nuovo modo di osservare i sistemi di rilevamento delle fake news, in modo da poter capire non solo se un post è probabilmente falso, ma anche perché.

Come le fake news ingannano occhi e mente

I creatori di fake news sfruttano il modo in cui le persone scorrono rapidamente titoli e immagini. Possono falsificare o modificare foto, inserire dettagli parzialmente veri in una storia impossibile, unire pezzi provenienti da eventi diversi o mescolare luoghi e cronologie che non coincidono. Un singolo post su un evento in corso potrebbe mostrare un’immagine drammatica di un incidente avvenuto anni prima, oppure una foto convincente potrebbe essere generata interamente dall’IA. I sistemi tradizionali di rilevamento di solito trattano tutti i post falsi allo stesso modo e comprimono testo e immagine in un’unica “zuppa” di caratteristiche. L’approccio può funzionare abbastanza bene, ma si comporta come una scatola nera: è difficile per giornalisti, piattaforme o utenti capire gli indizi specifici che hanno attivato l’allarme.

Un nuovo modo di chiedere: “Perché questo è falso?”

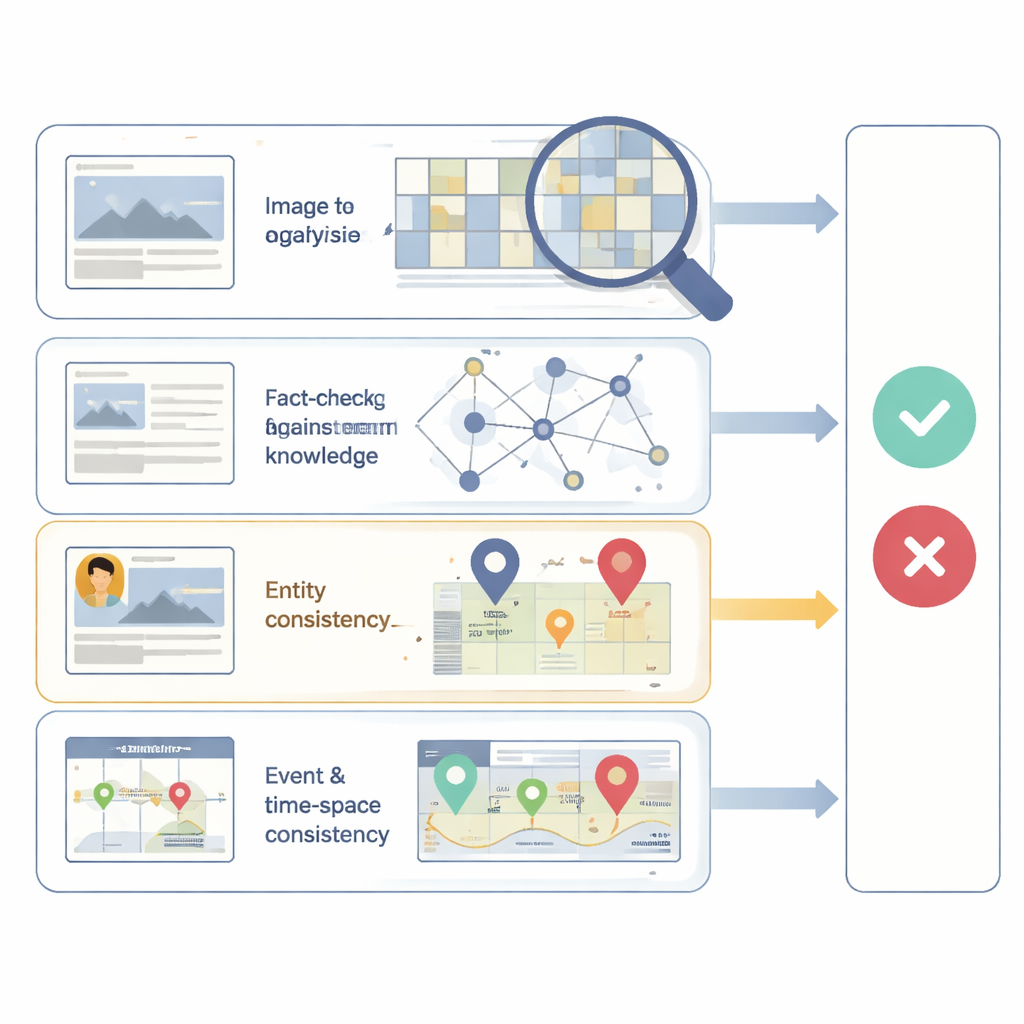

Gli autori propongono un framework spiegabile chiamato EMAR‑FND che osserva i post di cronaca da quattro angolazioni distinte, ciascuna collegata a un modo comune in cui si costruiscono le falsificazioni. Primo, esamina se l’immagine mostra segni di manomissione o di generazione sintetica, concentrandosi sui sottili pattern di rumore a livello di fotocamera che cambiano quando una foto viene alterata. Secondo, verifica se i fatti della storia sono coerenti con conoscenze esterne affidabili, come relazioni note tra persone, luoghi ed eventi. Terzo, controlla se le entità chiave menzionate nel testo — per esempio una figura pubblica o una città — corrispondono effettivamente a ciò che appare nell’immagine allegata. Quarto, valuta se l’evento descritto quadra nel tempo e nello spazio, per esempio individuando una discrepanza tra la località dichiarata e indizi visivi nell’immagine, o tra la cronologia riportata e altre prove.

Mettendo insieme indizi da più prospettive

Ognuno di questi quattro controlli è gestito da un modulo di ragionamento dedicato, che esprime un giudizio parziale su quanto quell’aspetto specifico sia affidabile. Un modulo si concentra sulle manipolazioni visive; un altro ragiona su grafi di conoscenza esterni; un terzo costruisce una rete ricca che collega parole, oggetti nell’immagine ed eventi estratti; e un quarto confronta il post con prove correlate nel tempo e nello spazio. Invece di nascondere questi segnali all’interno di una singola rappresentazione fusa, EMAR‑FND mantiene separate le loro contributi e le combina poi in un passo decisionale finale che può pesare quanto ciascuna prospettiva sia importante per il caso specifico. Il risultato non è solo un punteggio finale vero‑o‑falso, ma anche un’attribuzione che mostra, per esempio, che un post è segnalato principalmente perché l’immagine sembra contraffatta oppure perché l’evento descritto non corrisponde ai fatti noti.

Testare il sistema sul campo

Per valutare l’efficacia dell’approccio, i ricercatori hanno applicato EMAR‑FND a due raccolte pubbliche di post veri e falsi che includono sia testo sia immagini. Nei dataset considerati, il loro metodo ha superato diversi sistemi consolidati, raggiungendo maggiore accuratezza e un miglior equilibrio tra catturare post falsi ed evitare falsi allarmi. Quando hanno analizzato come i post si raggruppavano all’interno del modello, le notizie vere tendevano a formare gruppi compatti e coerenti, mentre le fake news risultavano più disperse — riflettendo i molteplici stratagemmi usati dai contraffattori. Anche le uscite di attribuzione si sono dimostrate utili in esempi difficili e realistici: post in cui testo e immagine sembravano coerenti a prima vista sono stati smascherati perché l’immagine mostrava tracce di manipolazione nascoste o perché conoscenze esterne contraddicevano i fatti dichiarati.

Cosa significa per i lettori di tutti i giorni

In termini semplici, lo studio mostra che è possibile costruire rilevatori di fake news che agiscono meno come oracoli e più come investigatori attenti. Invece di fornire una risposta secca sì‑o‑no, EMAR‑FND mette in evidenza quale parte di un post è sospetta: l’immagine, i fatti, le persone menzionate o l’evento stesso. Questo tipo di spiegazione può aiutare fact‑checker, piattaforme e lettori a fidarsi delle decisioni del sistema e a imparare a riconoscere i modelli comuni di inganno. Man mano che le fake news evolvono, strumenti in grado sia di individuare sia di spiegare le manipolazioni saranno cruciali per mantenere gli ecosistemi informativi online più sani e trasparenti.

Citazione: Ji, W., Lv, H., Zhao, H. et al. Explainable multi-granularity attribution reasoning framework for fake news detection. npj Artif. Intell. 2, 38 (2026). https://doi.org/10.1038/s44387-026-00093-3

Parole chiave: individuazione delle fake news, disinformazione multimodale, IA spiegabile, integrità dei social media, analisi di falsificazione delle immagini