Clear Sky Science · it

Scoprire l’emergere del comportamento collettivo in reti di agenti cognitivi

Perché gli sciami pensanti contano

Dai collettivi di robot alle comunità online, gruppi di unità semplici possono mostrare comportamenti sorprendentemente ricchi. Ma cosa succede quando ogni unità non è affatto semplice, e possiede invece potenti capacità di ragionamento basate sul linguaggio come gli attuali modelli di IA? Questo studio esplora come si comportano gli sciami di tali “agenti cognitivi” rispetto alle particelle classiche che seguono regole, e cosa ciò implica per compiti come la risoluzione di problemi e la simulazione di società.

Dalle particelle semplici agli agenti parlanti

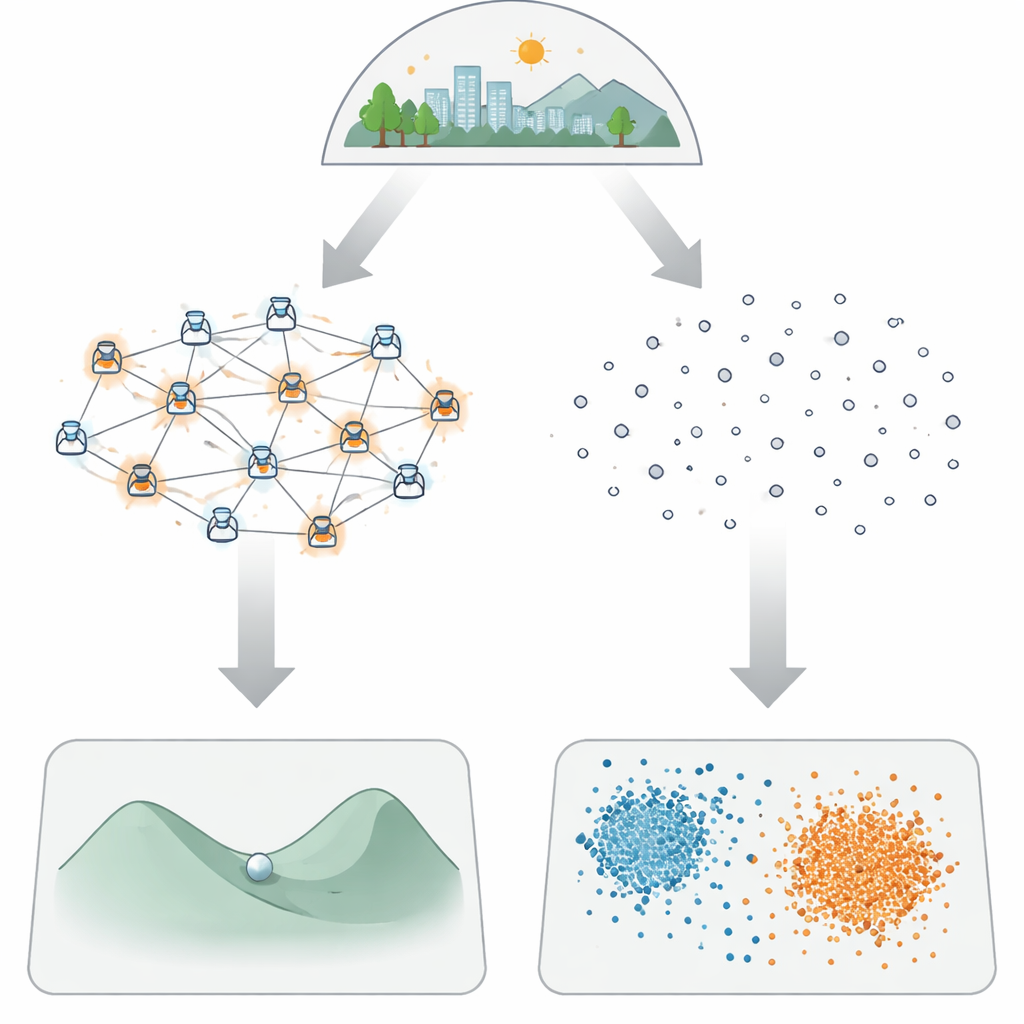

I modelli tradizionali di folle, stormi o sciami trattano gli individui come particelle di base che seguono regole fisse: muoversi verso un vicino, evitare collisioni, preferire vicini simili, e così via. Al contrario, gli agenti studiati qui sono alimentati da grandi modelli linguistici (LLM). Percepiscono l’ambiente a parole, ragionano su cosa fare dopo, ricordano esperienze passate e persino comunicano tra loro. Gli autori pongono una domanda centrale: quando ogni unità possiede questa “intelligenza” incorporata, i modelli che emergono a livello di gruppo cambiano, e in che modo?

Testare gli sciami su problemi difficili

Per indagare questa domanda, i ricercatori confrontano agenti cognitivi con particelle classiche su due sfide molto diverse. La prima è l’ottimizzazione di funzioni, una metafora per problemi di ricerca difficili in cui l’obiettivo è trovare la soluzione migliore in un paesaggio irregolare pieno di trappole locali. Introducono LLM Agent Swarm Optimization (llmASO), in cui una rete di agenti LLM propone e condivide soluzioni candidate in linguaggio naturale. Questo viene confrontato con un metodo ben noto basato su particelle chiamato Particle Swarm Optimization, oltre che con un singolo ottimizzatore LLM che agisce da solo. In paesaggi più semplici, singoli agenti LLM trovano rapidamente buone risposte individuando schemi nei tentativi passati. Ma in terreni più accidentati con molte buche locali, gli agenti solitari tendono ad assestarsi troppo in fretta su punti “abbastanza buoni” nelle vicinanze. Gli sciami di agenti parlanti, al contrario, scoprono in modo affidabile la vera regione migliore—sebbene lo facciano più lentamente e risultino sensibili a come l’informazione scorre attraverso la loro rete di comunicazione.

Come il parlare cambia i modelli sociali

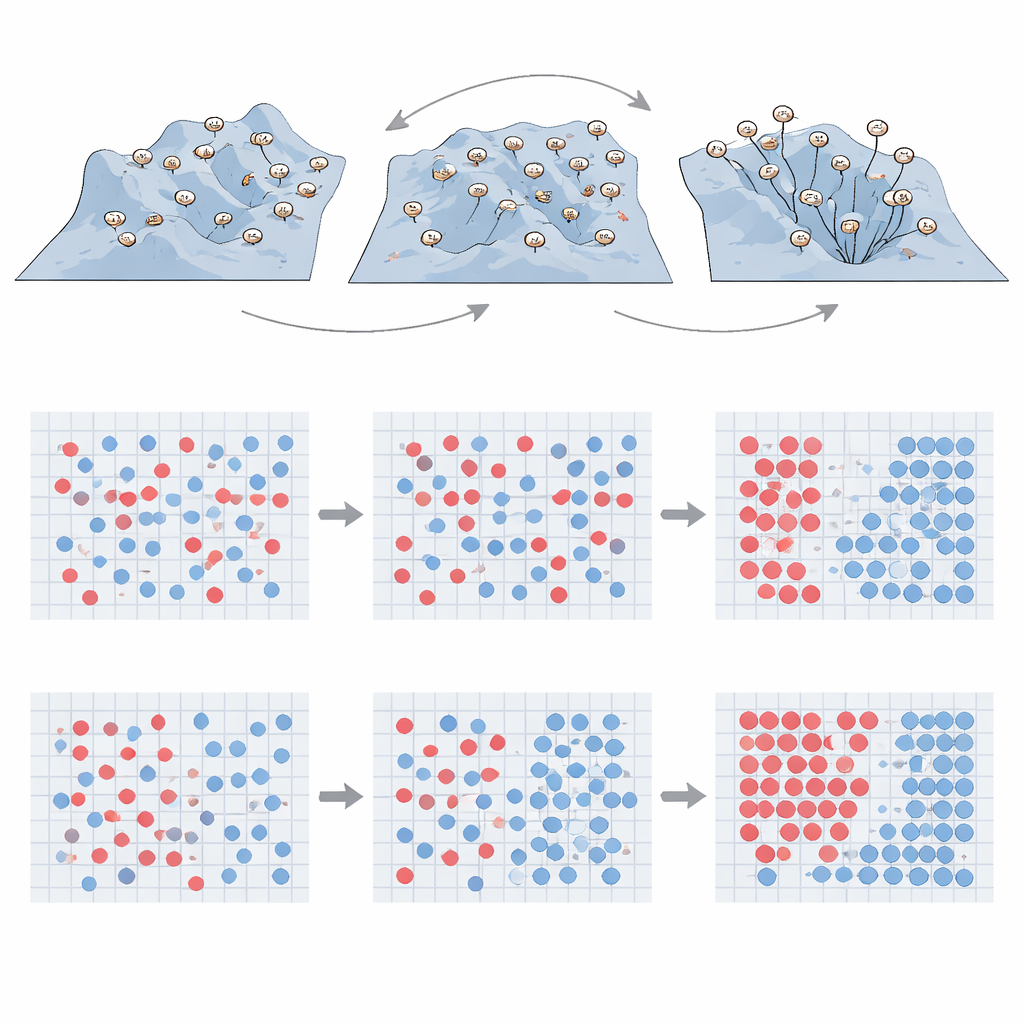

Il secondo test rivede il classico modello di segregazione di Schelling, che mostra come preferenze lievi per vicini simili possano portare a una netta separazione tra gruppi. Qui, gli agenti si muovono su una griglia e appartengono a uno di due tipi; sono “soddisfatti” se pochi vicini sono diversi da loro. Per le particelle standard che seguono semplici regole di rilocazione emergono tre fasi familiari al variare della tolleranza: uno stato misto con continuo rimescolamento, uno stato segregato con cluster distinti e uno stato congelato in cui il movimento si arresta in gran parte. Gli agenti cognitivi obbediscono alla stessa regola di soddisfazione di base ma decidono dove muoversi dopo aver scambiato messaggi con altri agenti. Quando ogni agente può parlare con tutti gli altri, l’esito a grandi linee appare sorprendentemente simile al caso delle particelle, suggerendo che aggiungere semplicemente linguaggio e ragionamento non ribalta automaticamente i noti schemi di segregazione.

Reti ed effetti “uccelli dello stesso piumaggio”

La storia cambia quando la struttura delle conversazioni diventa più realistica. Gli autori ricollegano la rete di comunicazione in modo che gli agenti parlino per lo più con pari vicini, o in modo che le connessioni seguano schemi osservati in molti sistemi sociali reali con pochi hub altamente connessi. Sperimentano anche con omofilia (gli agenti che preferiscono parlare con lo stesso tipo) e eterofilia (preferendo il tipo opposto). Queste variazioni hanno conseguenze forti: quando gli agenti conversano principalmente con simili, si coordinano rapidamente, formano cluster in modo efficiente e possono persino evitare la fase costantemente mista. Quando parlano principalmente attraverso i tipi, il percorso verso la soddisfazione è più lento e complesso, ma può comunque emergere una forte segregazione—nonostante ogni conversazione attraversi le linee di gruppo. Nel complesso, le conversazioni locali e le tendenze “uccelli dello stesso piumaggio” rimodellano il modo in cui la segregazione emerge, in modi che non sono accessibili alle particelle non pensanti.

Cosa significa per i futuri sciami di IA e le simulazioni sociali

Gli autori concludono che dotare ogni agente di avanzate capacità basate sul linguaggio non rende semplicemente i gruppi universalmente migliori. Piuttosto, queste capacità introducono nuove forze—come il rapido consenso e lo sfruttamento di schemi—che possono essere utili o dannose a seconda di come gli agenti sono collegati. Nei compiti di ottimizzazione, reti mal progettate possono spingere agenti intelligenti a concordare troppo in fretta su soluzioni mediocri; limitare con cura il flusso informativo aiuta a esplorare più ampiamente, a costo di velocità. Nelle simulazioni sociali, pattern di comunicazione realistici e l’omofilia possono generare comportamenti diversi dai modelli classici e potrebbero rispecchiare meglio le società umane. Con l’aumento di sciami di robot guidati dall’IA e di reti di agenti virtuali, comprendere e regolare questi effetti collettivi sarà cruciale per progettare sistemi sicuri ed efficaci.

Citazione: Zomer, N., De Domenico, M. Unraveling the emergence of collective behavior in networks of cognitive agents. npj Artif. Intell. 2, 36 (2026). https://doi.org/10.1038/s44387-026-00091-5

Parole chiave: agenti cognitivi, modelli linguistici di grandi dimensioni, ottimizzazione a sciame, dinamiche di segregazione, topologia di rete