Clear Sky Science · it

DeepKoopFormer: un'architettura basata su Transformer migliorata dal Koopman per la previsione di serie temporali

Perché previsioni più intelligenti sono importanti

Dalla meteorologia e pianificazione energetica ai mercati finanziari, molte delle nostre decisioni più rilevanti dipendono dalla capacità di prevedere come le cose cambieranno nel tempo. Queste “serie temporali” — flussi di misure come la velocità del vento, la produzione elettrica o i prezzi delle criptovalute — stanno diventando sempre più lunghe, rumorose e complesse. Gli strumenti moderni di IA chiamati Transformer possono elaborare questi dati, ma spesso agiscono come scatole nere e possono diventare instabili quando vengono spinti a prevedere a lungo termine. Questo articolo presenta DeepKoopFormer, un metodo di previsione che mantiene la potenza predittiva dei Transformer aggiungendo una struttura matematica che rende il loro comportamento più stabile, interpretabile e affidabile su orizzonti temporali estesi.

Un nuovo modo per stabilizzare modelli potenti

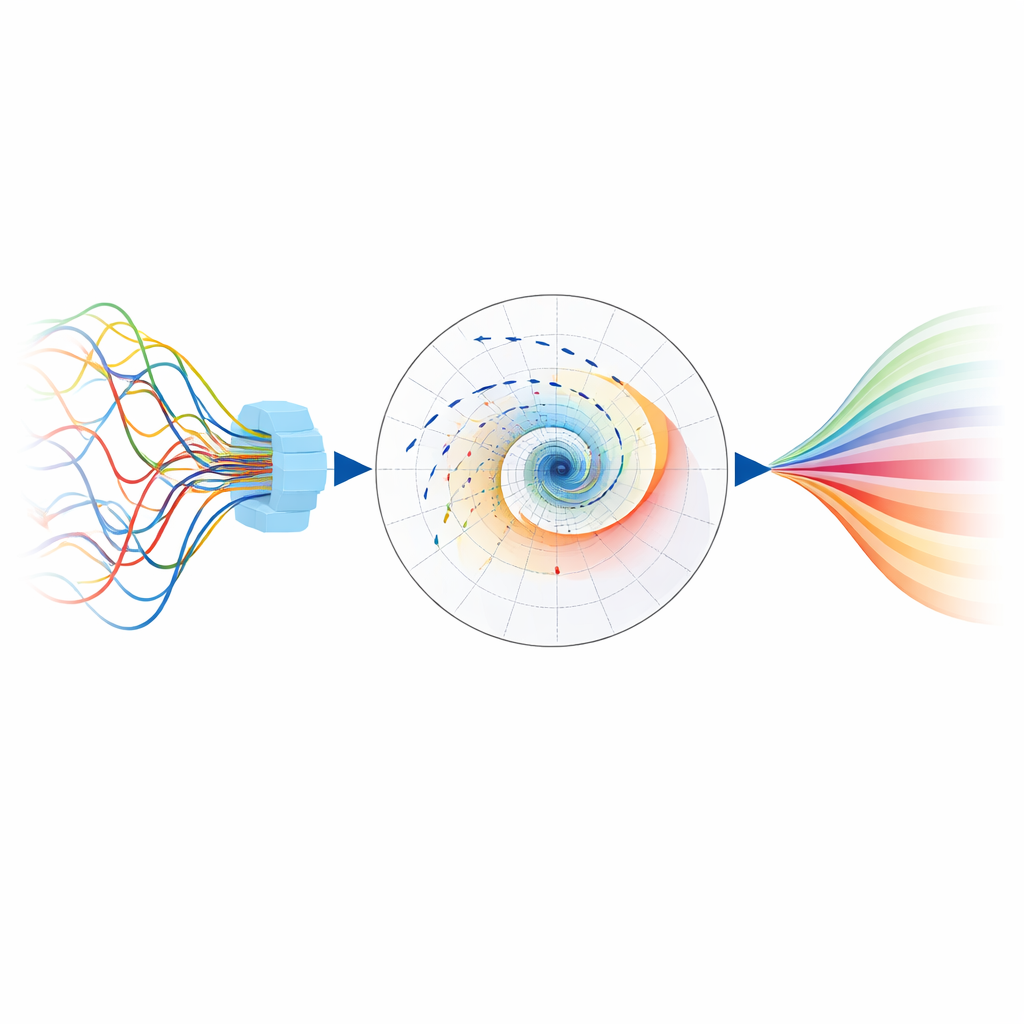

Gli autori partono da un’idea nota nell’IA odierna: usare un Transformer per trasformare serie temporali grezze in una rappresentazione interna ricca. DeepKoopFormer inserisce quindi uno strato intermedio progettato con cura, ispirato a un concetto dei sistemi dinamici noto come operatore di Koopman. Invece di lasciare che il modello evolva in modo complesso e completamente non lineare, questo strato intermedio aggiorna lo stato interno usando una semplice trasformazione lineare in uno spazio nascosto. Elemento cruciale, questa trasformazione è costruita in modo che la sua influenza si riduca gradualmente nel tempo invece di amplificarsi incontrollabilmente, il che garantisce matematicamente che le previsioni a lungo termine non esplodano né oscillino senza controllo.

Come il modello mantiene l’equilibrio

Per imporre questa stabilità, DeepKoopFormer vincola il passaggio lineare in diversi modi. La trasformazione è fattorizzata in tre componenti: due matrici ortogonali (che preservano lunghezze e angoli) che circondano una matrice diagonale di fattori di scala, tutti forzati a essere inferiori a uno. Ciò significa che lo stato nascosto viene delicatamente contratto invece che amplificato a ogni aggiornamento. Un secondo ingrediente, chiamato regolarizzazione di Lyapunov, aggiunge una penalità durante l’addestramento ogni volta che l’energia dello stato nascosto cresce da un passo al successivo. Insieme, questi meccanismi assicurano che la dinamica interna sia calma e ben comportata, mentre il Transformer precedente e il decoder lineare successivo rimangono liberi di essere espressivi. La capacità del modello di apprendere pattern complessi e la sua stabilità sono controllate da impostazioni separate, così che gli utenti possano regolare l’una senza compromettere l’altra.

Mettere il metodo alla prova

I ricercatori valutano DeepKoopFormer su problemi controllati e su casi reali. Prima lo testano su sistemi caotici classici come l’attrattore di Lorenz, dove piccole variazioni possono portare a futuri molto diversi, aggiungendo rumore casuale per imitare misure reali. Attraverso diversi backbone Transformer, le versioni migliorate con Koopman seguono da vicino le traiettorie vere mantenendo un comportamento interno stabile su molti passi di previsione a breve termine. Gli autori passano poi a dataset reali impegnativi: proiezioni climatiche e reanalisi per la Germania (velocità del vento e pressione superficiale), prezzi di criptovalute e produzione elettrica da più fonti in Spagna. In questi casi, le varianti di DeepKoopFormer vengono confrontate con una rete LSTM standard e baseline lineari più semplici, su molte scelte di lunghezza della finestra di input, orizzonte di previsione e dimensione del modello.

Cosa rivelano gli esperimenti

In ambito climatico, finanziario ed energetico, i Transformer aumentati con il modulo Koopman ottengono in genere errori di previsione inferiori e un comportamento più stabile rispetto alla baseline LSTM, soprattutto quando si prevedono molti passi avanti o si lavora con dati ad alta dimensionalità. Per vento e pressione in Germania e per la generazione elettrica, le versioni PatchTST e Informer di DeepKoopFormer tendono a dare le migliori prestazioni, catturando in modo affidabile sia le tendenze lente sia le fluttuazioni rapide. In alcuni casi particolari, dove i pattern sottostanti sono quasi interamente lineari, un metodo lineare molto semplice risulta ancora vincente in termini di accuratezza sul test, sottolineando che nessun modello è universalmente ottimale. Tuttavia, i progetti basati su Koopman mostrano costantemente andamenti di errore più regolari con l’aumentare dell’orizzonte di previsione, indicando un migliore controllo dell’incertezza a lungo termine e una minore tendenza a sovradattarsi a dettagli eccentrici nei dati di addestramento.

Perché questo approccio è promettente

In conclusione, DeepKoopFormer dimostra che è possibile combinare la flessibilità del deep learning con le garanzie della teoria classica dei sistemi dinamici. Inserendo uno step lineare strutturato e stabile in una pipeline Transformer altrimenti standard, gli autori ottengono previsioni accurate, robuste al rumore e matematicamente più semplici da analizzare. Per i professionisti che dipendono da previsioni a lungo termine in scienze del clima, sistemi energetici o finanza — dove stabilità e interpretabilità sono importanti quanto l’accuratezza pura — questo framework offre un modo per riporre maggiore fiducia nei potenti modelli neurali e per capire come e perché le loro previsioni evolvono nel tempo.

Citazione: Forootani, A., Khosravi, M. & Barati, M. DeepKoopFormer: a Koopman enhanced transformer based architecture for time series forecasting. npj Artif. Intell. 2, 35 (2026). https://doi.org/10.1038/s44387-026-00085-3

Parole chiave: previsione di serie temporali, modelli Transformer, operatore di Koopman, dinamiche stabili, dati climatici e energetici