Clear Sky Science · it

Un quadro variazionale per l’adattività basata sul residuo nei solver neurali di PDE e nell’apprendimento di operatori

IA più intelligente per equazioni difficili

Molte delle scoperte scientifiche odierne — dalla modellazione climatica alla progettazione di nuovi materiali — dipendono dalla risoluzione di equazioni complesse che descrivono come si muovono fluidi, onde o fronti chimici. Le reti neurali sono recentemente diventate strumenti potenti per affrontare queste equazioni, ma spesso faticano quando la fisica diventa insidiosa: discontinuità nette, strutture molto piccole e previsioni a lungo termine possono farle fallire. Questo articolo introduce un modo sistematico per far concentrare questi solver di IA esattamente dove incontrano più difficoltà, così da renderli sia più veloci sia più accurati.

Perché le reti neurali hanno bisogno di guida

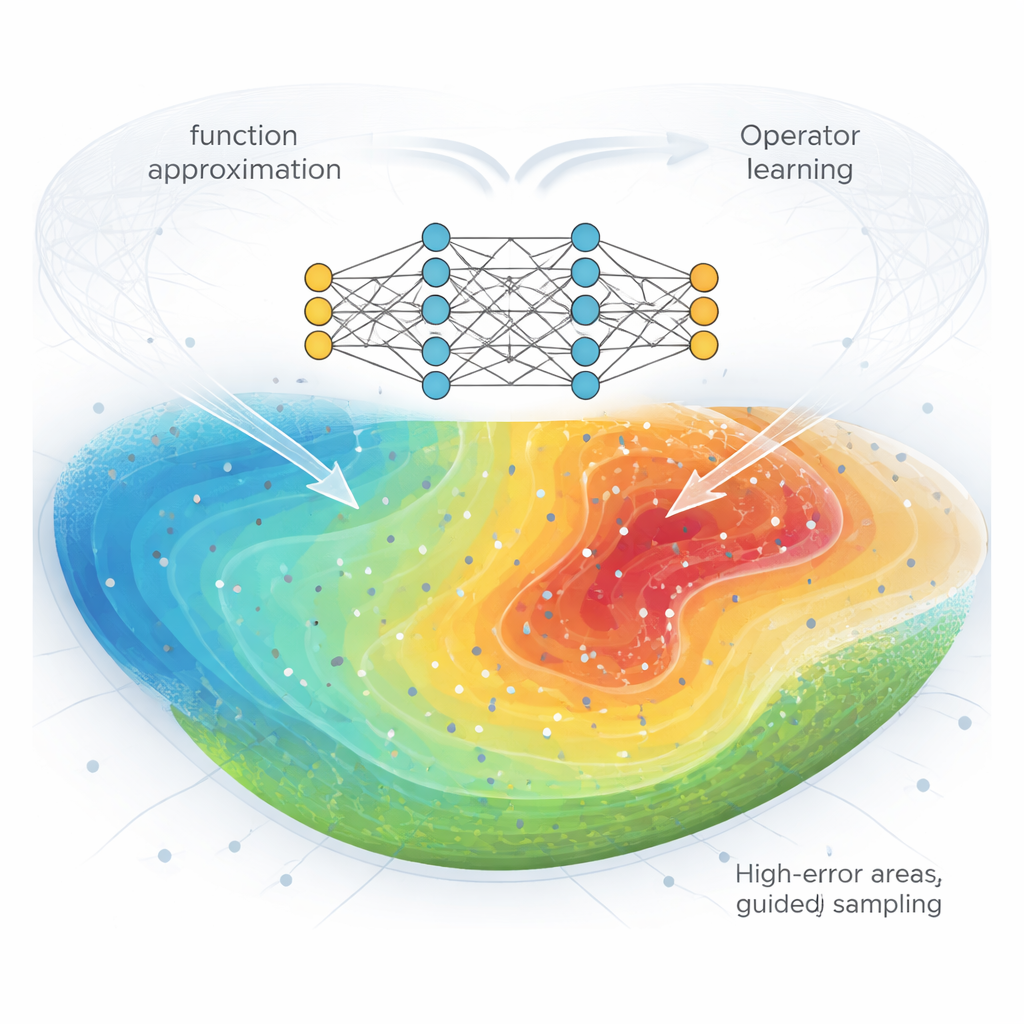

Nell’ambito del machine learning scientifico, le reti neurali vengono addestrate o per riprodurre la soluzione di una singola equazione (come nelle physics-informed neural networks, PINN) o per imparare una mappatura completa dagli input alle soluzioni (conosciuto come operator learning). In entrambi i casi, la rete è valutata da un “residuo”, una misura di quanto male viola l’equazione sottostante in ciascun punto dello spazio e del tempo. L’addestramento standard tratta tutti i punti alla pari, minimizzando l’errore medio. Questo funziona per problemi semplici, ma per equazioni con gradienti ripidi, fronti in movimento o strutture localizzate, un basso valore medio può nascondere errori gravi in regioni critiche. I ricercatori hanno risposto con regole ad hoc che collocano più punti di addestramento dove il residuo è grande, ma finora queste regole sono rimaste euristiche e solo vagamente motivate.

Una ricetta unificata per l’attenzione adattiva

Gli autori sviluppano un quadro variazionale che trasforma queste euristiche in una ricetta fondata. L’idea chiave è vedere il campionamento e la pesatura come scelte sulla distribuzione di probabilità nello spazio (e sugli esempi di addestramento) a cui la rete dovrebbe prestare maggiore attenzione. Introducono una famiglia di funzioni “potenziale” che trasformano il residuo in un nuovo obiettivo. Scelte diverse di potenziale corrispondono a priorità differenti: un potenziale esponenziale spinge la rete a ridurre il singolo peggior errore, mentre un potenziale quadratico enfatizza la riduzione della dispersione, o varianza, dell’errore sull’intero dominio. Matematicamente, ottimizzare questi obiettivi trasformati conduce naturalmente a campionare più spesso nelle regioni dove il residuo corrente è grande. Il metodo risultante, chiamato variational residual-based attention (vRBA), ingloba molti schemi adattivi esistenti e fornisce un modo chiaro per inventarne di nuovi.

Estendere all’apprendimento di mappe fisiche intere

I solver di IA moderni mirano sempre più a imparare non solo una soluzione, ma un intero operatore: una mappatura dagli input, come condizioni iniziali o forzanti, ai campi spazio‑temporali completi. Questo è l’obiettivo di architetture per operatori neurali come DeepONet, Fourier Neural Operators (FNO) e U‑Net condizionati nel tempo. Qui la sfida raddoppia: c’è variazione tra diverse funzioni di input e variazione nello spazio e nel tempo all’interno di ciascun esempio. Gli autori adattano il loro quadro a questo prodotto combinando due livelli di adattività. Primo, ripesano i punti spaziali all’interno di ogni esempio affinché le aree con residui elevati contino di più. Secondo, usano i residui accumulati per risamplare preferenzialmente gli interi esempi di addestramento più difficili da apprendere. Questo schema ibrido può essere inserito direttamente nei modelli di operator learning più diffusi senza ridisegnarne l’architettura.

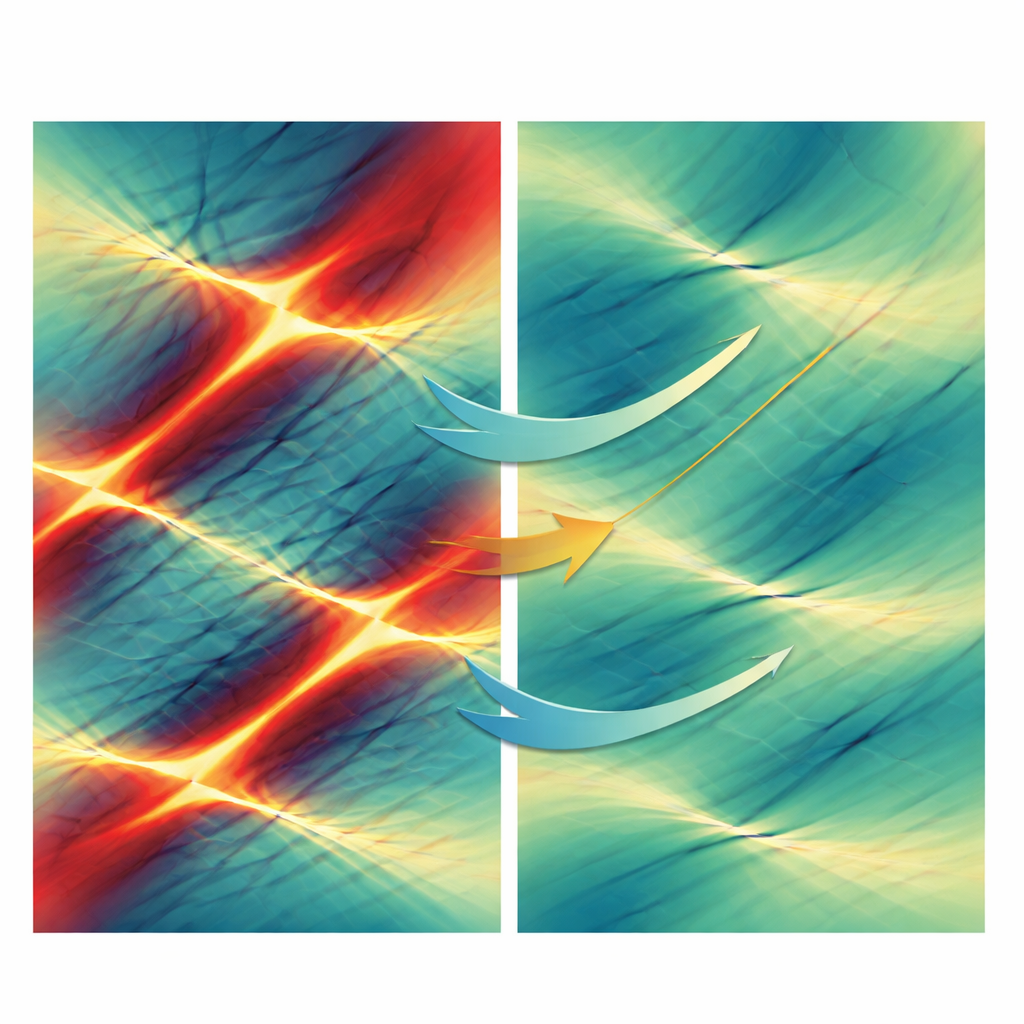

Dettagli più nitidi, crescita dell’errore più lenta

Su un’ampia serie di benchmark, l’approccio vRBA supera costantemente l’addestramento tradizionale. Per le PINN, il gruppo testa equazioni non lineari classiche come Allen–Cahn, Burgers’ e Korteweg–De Vries. Alcuni di questi problemi sono notoriamente ostici per le PINN standard, sia a causa di strati interni netti sia per pulsazioni d’onda interagenti. Con vRBA, le stesse reti convergono più rapidamente e raggiungono errori significativamente inferiori, e nei casi difficili in cui il metodo base fallisce di fatto, i metodi adattivi recuperano soluzioni accurate. Per l’operator learning, applicano vRBA alla crescita di bolle nei liquidi, a flussi in tubi d’urto ad alta pressione, alla turbolenza bidimensionale e alla propagazione d’onda. Qui il beneficio principale non è solo un errore finale migliore, ma un’accumulazione degli errori molto più lenta nel tempo, cruciale quando l’output di un modello viene reinserito ripetutamente come suo stesso input.

Ripulire il rumore nel segnale di apprendimento

Gli autori ricondurranno questi miglioramenti a due effetti principali. Primo, cambiando come i punti di addestramento vengono campionati o pesati, vRBA riduce il rumore statistico nella stima della loss: batch casuali di punti danno un quadro più affidabile di quanto la rete stia effettivamente facendo. Questo riduce direttamente l’errore di discretizzazione, il divario tra l’obiettivo ideale continuo e il numero finito di punti usati in pratica. Secondo, il metodo migliora il rapporto segnale‑rumore dei gradienti che guidano l’apprendimento, così che le diverse regioni del dominio “concordino” di più sulla direzione in cui i parametri dovrebbero muoversi. Di conseguenza, le reti escono molto prima da fasi di addestramento lente e indecise ed entrano in un regime in cui l’errore cala rapidamente. Il quadro chiarisce anche quando strategie aggressive — che penalizzano fortemente i residui più alti — possono aiutare e quando invece possono destabilizzare l’addestramento.

Cosa significa per la futura IA scientifica

Per i non esperti, il messaggio è che una attenzione più intelligente ai punti in cui un solver di IA sbaglia può trasformarlo in uno strumento molto più affidabile per la scienza e l’ingegneria. Piuttosto che affidarsi a regole di prova ed errore, questo lavoro offre una mappa matematica per indirizzare le reti neurali verso le parti più informative di un problema, siano esse fronti d’urto, fini oscillazioni o comportamenti a lungo termine. Man mano che i modelli scientifici crescono in dimensione e vengono impiegati in contesti critici per la sicurezza, strategie così fondate per ridurre l’errore e stabilizzare l’apprendimento saranno essenziali per trasformare potenti reti neurali in strumenti scientifici affidabili.

Citazione: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

Parole chiave: reti neurali informate dalla fisica, apprendimento di operatori, campionamento adattivo, machine learning scientifico, equazioni alle derivate parziali