Clear Sky Science · it

Attenzione visiva umana e algoritmica nei compiti di guida

Perché è importante per la guida quotidiana

Con l’aumento dell’automazione nei veicoli, resta una domanda chiave: i sistemi di guida autonoma «vedono» davvero la strada come la vedono gli esseri umani? Questo studio esamina come i conducenti umani e l’intelligenza artificiale focalizzano la propria attenzione visiva nel traffico e mostra che aggiungere con cura un frammento di attenzione di tipo umano può rendere gli algoritmi di guida più intelligenti e sicuri—senza richiedere modelli di intelligenza artificiale enormi e ad alto consumo energetico.

Come si muovono gli occhi degli umani sulla strada

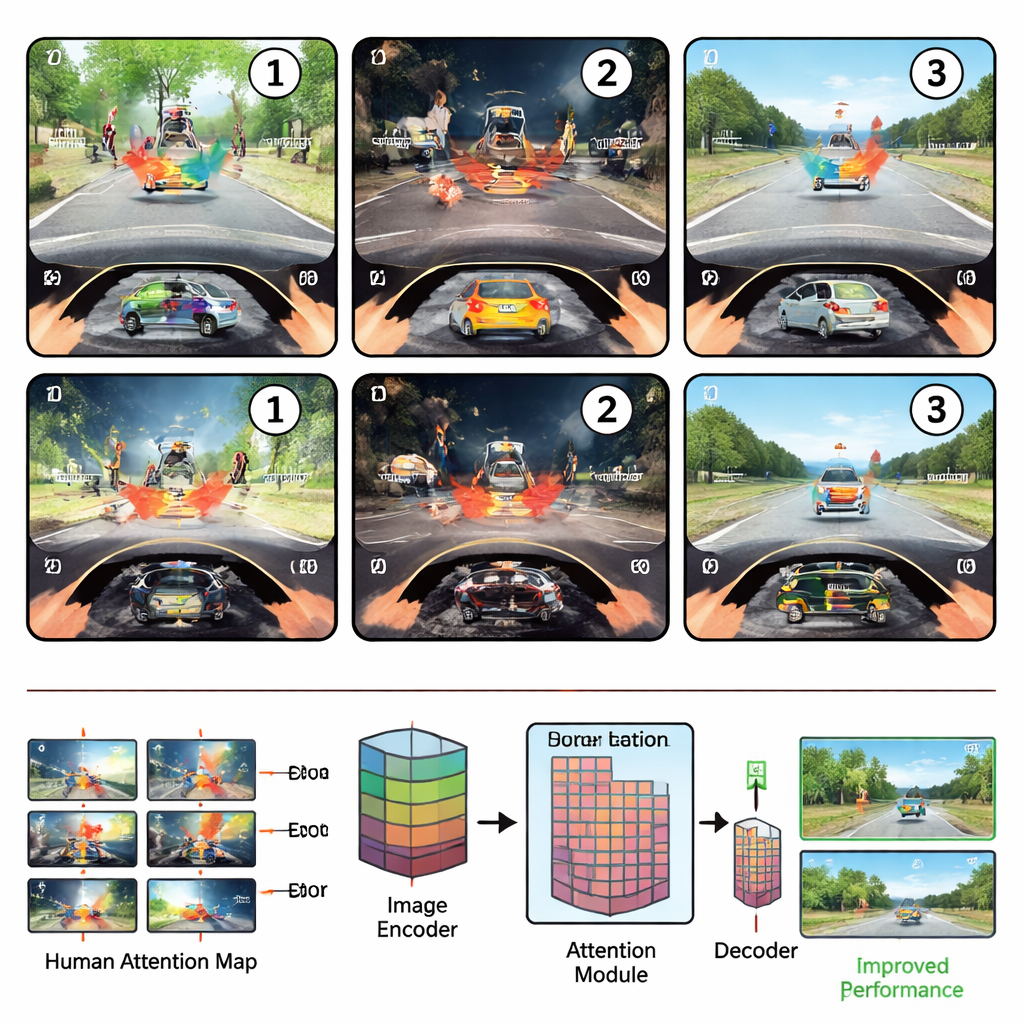

I ricercatori hanno prima messo guidatori alle prime armi e guidatori esperti in un ambiente di guida simulato e hanno tracciato i loro movimenti oculari mentre eseguivano tre compiti di sicurezza comuni: individuare pericoli, giudicare se è sicuro girare o cambiare corsia e rilevare oggetti strani o fuori posto. Hanno scoperto che l’attenzione dei guidatori segue un ritmo affidabile in tre fasi. Nella fase di scansione, subito dopo la comparsa della scena, gli occhi esplorano ampiamente il campo visivo, guidati principalmente dalla posizione degli elementi. Nella fase di esame, l’attenzione si concentra sulla singola regione più informativa—come un pedone che attraversa o un’auto che ostruisce la strada—e ne studia i dettagli e il significato. Infine, nella fase di rivalutazione, i guidatori confrontano quell’oggetto chiave con gli altri, spostando lo sguardo avanti e indietro per confermare la loro decisione.

Dove guardano le macchine rispetto alle persone

Il team ha poi costruito un modello di deep learning basato sull’attenzione per scene di guida e ha confrontato le sue “mappe di attenzione” interne con quelle derivanti dai movimenti oculari umani. Addestrare il modello sul rilevamento generale degli oggetti ha reso la sua attenzione in qualche misura più simile a quella umana, ma il fine-tuning su compiti specifici di guida spesso l’ha allontanato dai modelli umani, specialmente nella ricca e semantica fase di esame. Nel complesso, le correlazioni tra attenzione umana e algoritmica sono rimaste modeste, suggerendo che le attuali IA per la guida faticano a scoprire i principi organizzativi dietro il dove e il perché gli umani guardano in un certo modo.

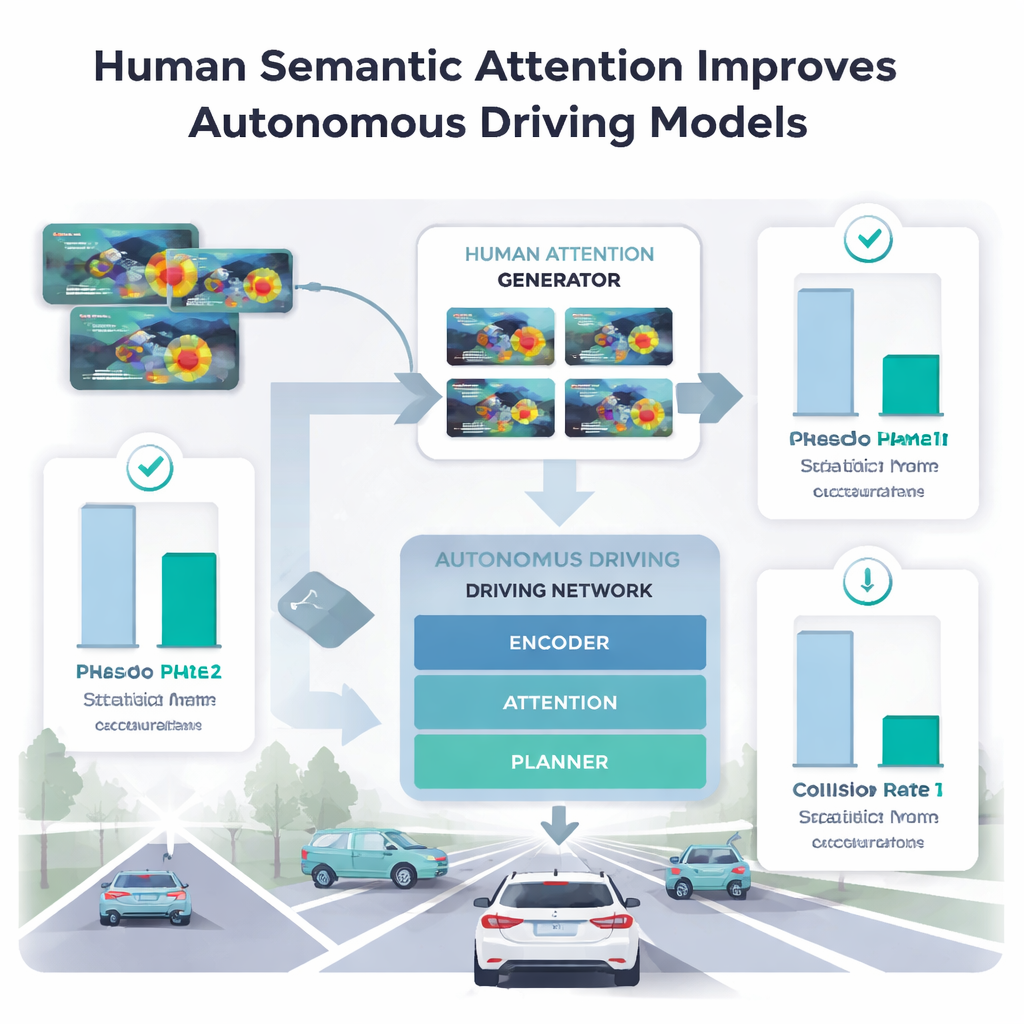

Insegnare alle auto a prendere in prestito la focalizzazione umana

Per capire quali parti dell’attenzione umana aiutano effettivamente le macchine, gli autori hanno fornito al loro modello di guida diverse fasi dello sguardo umano. Raccogliere direttamente dati di eye-tracking per milioni di immagini è impraticabile, quindi hanno addestrato un separato «generatore di attenzione umana» su un piccolo campione di soli cinque guidatori. Questo generatore ha imparato a predire mappe di calore dell’attenzione simili a quelle umane per nuove scene. Quando il modello principale di guida ha usato solo la fase spaziale e iniziale di scansione, le sue prestazioni nel rilevamento di anomalie e nella pianificazione delle traiettorie sono spesso peggiorate o hanno prodotto percorsi che, pur sembrando più sicuri, erano più soggetti a collisioni. Al contrario, quando ha utilizzato la fase di esame—in cui gli umani si concentrano sulla singola regione più significativa—l’accuratezza è migliorata oltre i metodi precedenti che usavano lo sguardo per tutta la durata, e i tassi di collisione nelle attività di pianificazione sono diminuiti.

Cosa manca ancora ai grandi modelli visione-linguaggio

I ricercatori hanno anche testato grandi modelli visione–linguaggio che rispondono a domande sulla guida o generano didascalie dettagliate per scene stradali 3D. Per un compito di question answering che enfatizza il ragionamento ad alto livello, aggiungere l’attenzione umana ha aiutato a malapena e a volte ha peggiorato i risultati, implicando che tali modelli catturano già gran parte della conoscenza astratta necessaria. Ma per un impegnativo compito di didascalia che richiede di associare parole precise a oggetti precisi, l’attenzione umana della fase di esame ha comunque fornito grandi miglioramenti. Questo suggerisce che i grandi modelli possono ragionare bene in generale, ma inciampano ancora quando devono legare strettamente le parole ai punti esatti in una scena visiva affollata—una lacuna che lo sguardo umano può contribuire a colmare.

Cosa significa per auto automatizzate più sicure

In termini semplici, lo studio sostiene che ciò che davvero separa le persone dall’IA di guida odierna non è solo dove guardiamo, ma come giudichiamo istantaneamente cosa conta in una scena. Quella breve esplosione di attenzione semantica—quando scrutiamo la singola regione che rende una situazione sicura o pericolosa—si rivela esattamente il segnale che molti algoritmi non possiedono. Imparando a imitare questa fase a partire da una piccola quantità di dati di tracciamento oculare, i sistemi di guida possono acquisire una comprensione delle scene stradali simile a quella umana senza fare affidamento esclusivo su modelli di IA sempre più grandi e costosi. Questa «scorciatoia semantica» potrebbe essere un modo efficiente per rendere le future auto automatizzate più affidabili nelle condizioni disordinate e imprevedibili del traffico reale.

Citazione: Zheng, C., Li, P., Jin, B. et al. Human and algorithmic visual attention in driving tasks. npj Artif. Intell. 2, 23 (2026). https://doi.org/10.1038/s44387-026-00079-1

Parole chiave: guida autonoma, attenzione visiva, tracciamento oculare umano, modelli visione-linguaggio, sicurezza stradale