Clear Sky Science · it

Agenti IA in sanità: applicazioni, valutazioni e direzioni future

Perché gli assistenti digitali intelligenti in medicina contano

Gli ospedali sono sommersi dai dati, i medici sono sovraccarichi e i pazienti desiderano risposte più chiare sulla loro salute. Un nuovo tipo di intelligenza artificiale, basato su modelli linguistici di grandi dimensioni in grado di leggere e scrivere come gli esseri umani, viene ora trasformato in “agenti IA” capaci di ragionare su compiti a più fasi. Questo articolo di revisione spiega come questi assistenti digitali stiano iniziando ad aiutare nella diagnosi, nelle decisioni terapeutiche, nella gestione della documentazione, nelle conversazioni con i pazienti e persino nell’educazione medica—indicando al tempo stesso le precauzioni necessarie per mantenerli accurati, equi e sicuri.

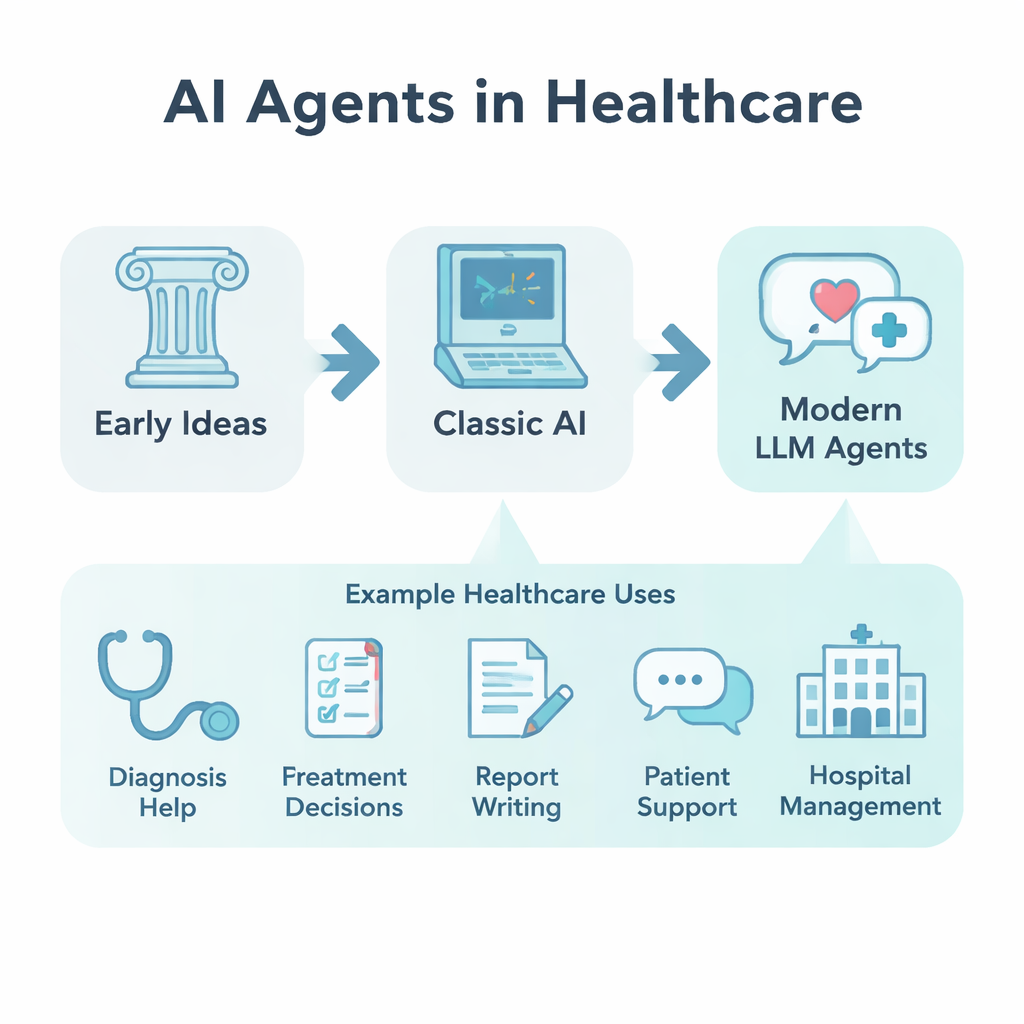

Dai pensieri teorici ai colleghi digitali pratici

L’idea di un “agente” che possa agire con obiettivi e intenzioni risale alla filosofia antica. Le versioni moderne sono arrivate con l’intelligenza artificiale iniziale, i sistemi esperti e, più tardi, con l’apprendimento automatico e il deep learning, che hanno permesso ai computer di apprendere schemi dai dati. La svolta dei modelli linguistici di grandi dimensioni (LLM) dopo il 2022 ha spinto oltre queste capacità: invece di limitarsi a rispondere a domande, ora i modelli possono pianificare, ricordare passaggi precedenti e chiamare altri strumenti software. In sanità, ciò significa che un agente IA può leggere cartelle cliniche, consultare linee guida, redigere note e suggerire azioni successive, comportandosi meno come un motore di ricerca e più come un giovane collega digitale.

Che cosa rende questi agenti diversi dall’IA ordinaria

Secondo la definizione adottata nell’articolo, un agente IA in ambito sanitario è più di un singolo modello. Ha un LLM al suo nucleo, circondato da quattro capacità chiave: pianificazione, memoria, uso di strumenti e auto-riflessione. La pianificazione gli permette di scomporre un compito medico complesso in passaggi più piccoli. La memoria gli consente di tenere traccia della storia del paziente o di un lungo processo decisionale. L’uso di strumenti significa che può, per esempio, estrarre risultati di laboratorio da una cartella elettronica o cercare in un database medico. I moduli di auto-riflessione verificano e revisano le proprie risposte. Insieme alle solide competenze linguistiche e a una crescente capacità di ragionamento logico, queste abilità rendono gli agenti abbastanza flessibili da passare tra compiti e specialità mediche.

Come gli agenti IA vengono testati nel lavoro sanitario reale

I ricercatori stanno costruendo e simulando ora molti tipi di agenti per capire dove portano maggior beneficio. Alcuni sono pensati per supportare la diagnosi recitando conversazioni tra medici e pazienti virtuali, o facendo dibattere più agenti specialisti su un caso difficile. Altri si concentrano sulle decisioni terapeutiche, combinando input da virtuali medici generalisti, specialisti e farmacisti per giungere a un piano condiviso. Esistono agenti che redigono referti radiologici a partire da radiografie del torace, o che traducono risultati tecnici in un linguaggio semplice e adatto ai pazienti. Sistemi in stile chatbot vengono sperimentati per il supporto alla salute mentale, il coaching per la perdita di peso e i promemoria per la terapia farmacologica. Ulteriori agenti aiutano a gestire le prescrizioni, a individuare effetti collaterali dei farmaci, a snellire le cartelle elettroniche o a formare gli studenti di medicina con pazienti simulati realistici.

Valutare se questi sistemi sono pronti per i pazienti

Poiché gli errori in medicina possono mettere in pericolo la vita, la revisione sostiene che gli agenti IA debbano essere valutati su più aspetti oltre alla sola brillantezza. Gli autori raggruppano i test in due livelli. I controlli di base chiedono: le risposte sono fattualmente corrette? La formulazione corrisponde ai referti degli esperti? L’agente completa affidabilmente il compito, incluso l’utilizzo degli strumenti giusti? I controlli orientati allo sviluppo valutano velocità, chiarezza e quanto bene il sistema comunica con le persone, compresi rispetto, empatia ed equità tra diversi gruppi di pazienti. Gli studi confrontano gli agenti sia con altri modelli linguistici di punta sia con i medici umani, e i regolatori in Europa, Regno Unito, Cina e altrove stanno cominciando a progettare programmi ufficiali di “sandbox” per testare la sicurezza, l’equità e il beneficio clinico prima della diffusione.

Passi successivi: robot, regole e fiducia umana

Guardando avanti, l’articolo evidenzia sette priorità: collegare gli agenti a robot fisici che possano agire nel mondo reale; combinare modelli di uso generale con modelli esperti più piccoli; ampliare la valutazione includendo costi, eventi di sicurezza e soddisfazione del paziente; costruire salvaguardie e supervisione più solide; integrare protezioni etiche e della privacy; progettare per la fiducia dell’utente e il feedback continuo; e aiutare il personale medico ad adattare le proprie carriere per lavorare accanto all’IA invece di esserne sostituito. Gli autori concludono che gli agenti IA potrebbero diventare partner potenti nella sanità, ma solo se sviluppati, testati e governati con la stessa cura che la società richiede a qualsiasi nuova tecnologia medica.

Citazione: Zhao, L., Liu, S., Xin, T. et al. AI agent in healthcare: applications, evaluations, and future directions. npj Artif. Intell. 2, 31 (2026). https://doi.org/10.1038/s44387-026-00076-4

Parole chiave: agenti IA in sanità, modelli linguistici di grandi dimensioni, supporto alle decisioni cliniche, chatbot medici, salute digitale