Clear Sky Science · it

Migliorare il riconoscimento delle entità nominative in pochi esempi per modelli di linguaggio di grandi dimensioni usando prompting dinamico strutturato con retrieval-augmented generation

Perché una lettura più intelligente del testo medico conta

La medicina moderna produce oceani di testo — dalle note di terapia intensiva alle conversazioni online sull’uso di farmaci. Nelle parole nascoste ci sono indizi vitali su malattie, terapie ed effetti collaterali. Individuare e etichettare automaticamente questi frammenti informativi, un compito chiamato “riconoscimento delle entità nominate”, può aiutare i ricercatori a monitorare focolai, rilevare problemi farmacologici più precocemente e supportare i medici in tempo reale. Ma i sistemi tradizionali richiedono grandi dataset annotati a mano, costosi da costruire e spesso assenti per problemi di salute rari o emergenti. Questo studio esplora come i modelli di linguaggio di grandi dimensioni, come quelli alla base degli attuali chatbot, possano essere guidati con prompt accuratamente progettati e con un recupero intelligente di esempi in modo da eseguire bene questo compito di etichettatura anche quando sono disponibili solo pochi campioni annotati.

Insegnare alle macchine a riconoscere parole importanti

Gli autori si concentrano sul riconoscimento delle entità nominate biomediche — identificare menzioni di malattie, farmaci, sintomi e impatti sociali nel testo. Questo è difficile perché il linguaggio medico è altamente specializzato, varia tra ospedali o sotto-discipline e spesso coinvolge condizioni rare che compaiono solo poche volte in qualsiasi dataset. I modelli di apprendimento automatico esistenti possono raggiungere prestazioni simili a quelle umane ma di solito richiedono corpora ampi e ben annotati, costosi da creare e condividere, soprattutto sotto severe regole di privacy. Il few-shot learning, in cui i modelli apprendono da una manciata di esempi etichettati, offre una via d’uscita da questo collo di bottiglia. I modelli di linguaggio di grandi dimensioni sono particolarmente promettenti qui perché possono apprendere schemi direttamente dalle istruzioni e dagli esempi forniti nel prompt, senza dover riaddestrare i propri pesi interni.

Costruire istruzioni migliori per i modelli di linguaggio

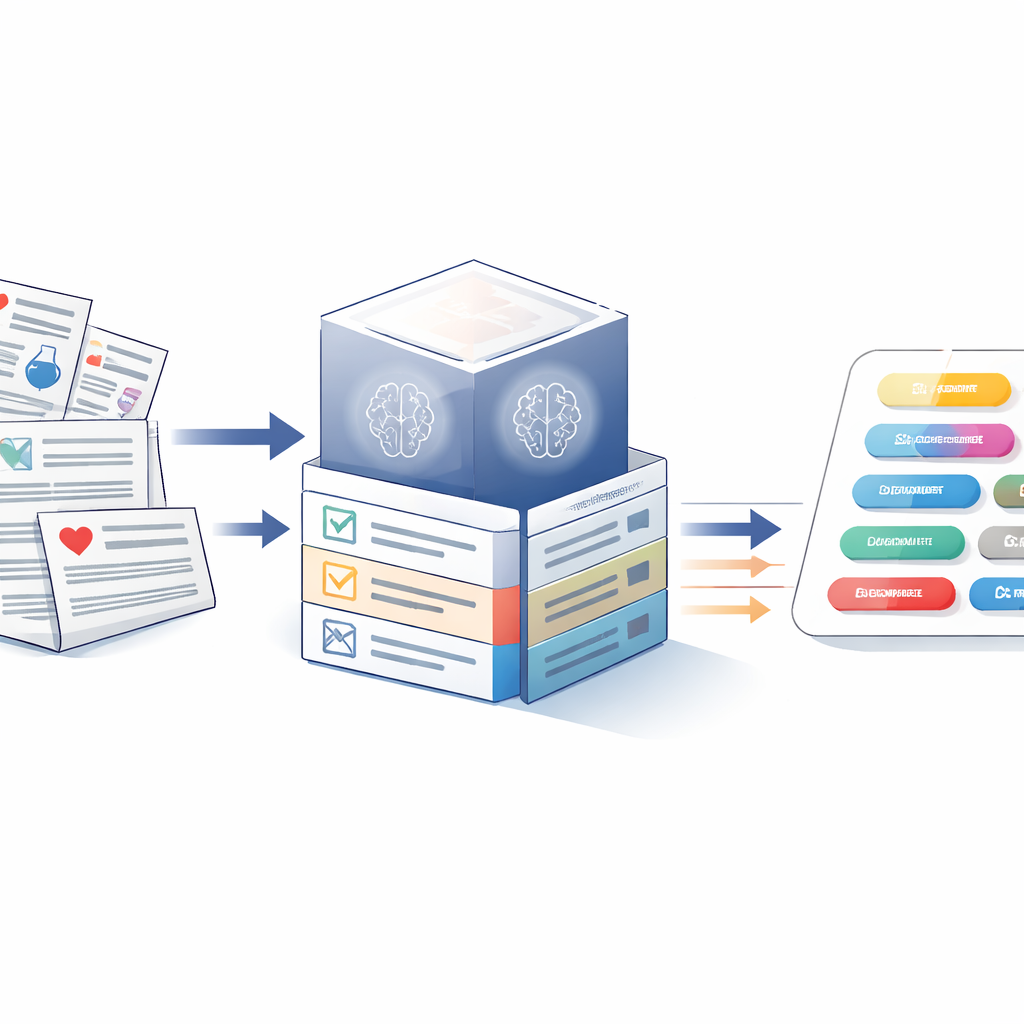

La prima parte del lavoro progetta un prompt “statico” altamente strutturato — un blocco riutilizzabile di istruzioni ed esempi presentato al modello per ogni frase che deve etichettare. Invece di limitarsi a dire al modello di taggare le entità, il prompt è suddiviso in sei elementi: una descrizione chiara del compito e definizioni dei tipi di entità; una breve descrizione della fonte e del tema del dataset; parole di esempio ad alta frequenza tipiche di ogni entità; conoscenze mediche di contesto opzionali; feedback sintetizzato dagli errori del modello in precedenza; e una manciata di frasi completamente annotate. Il team ha testato questo framework con tre modelli di linguaggio di grandi dimensioni — GPT-3.5, GPT-4 e LLaMA 3-70B — su cinque dataset biomedici che spaziano da cartelle cliniche e abstract scientifici a post su Reddit sull’uso di oppiacei. L’accurata stratificazione di questi componenti ha aumentato gli F1 (un bilanciamento tra precisione e richiamo) di circa 11–12 punti percentuali rispetto a un prompt di base, con GPT-4 che ha ottenuto le migliori prestazioni complessive.

Permettere al modello di trovare esempi migliori al volo

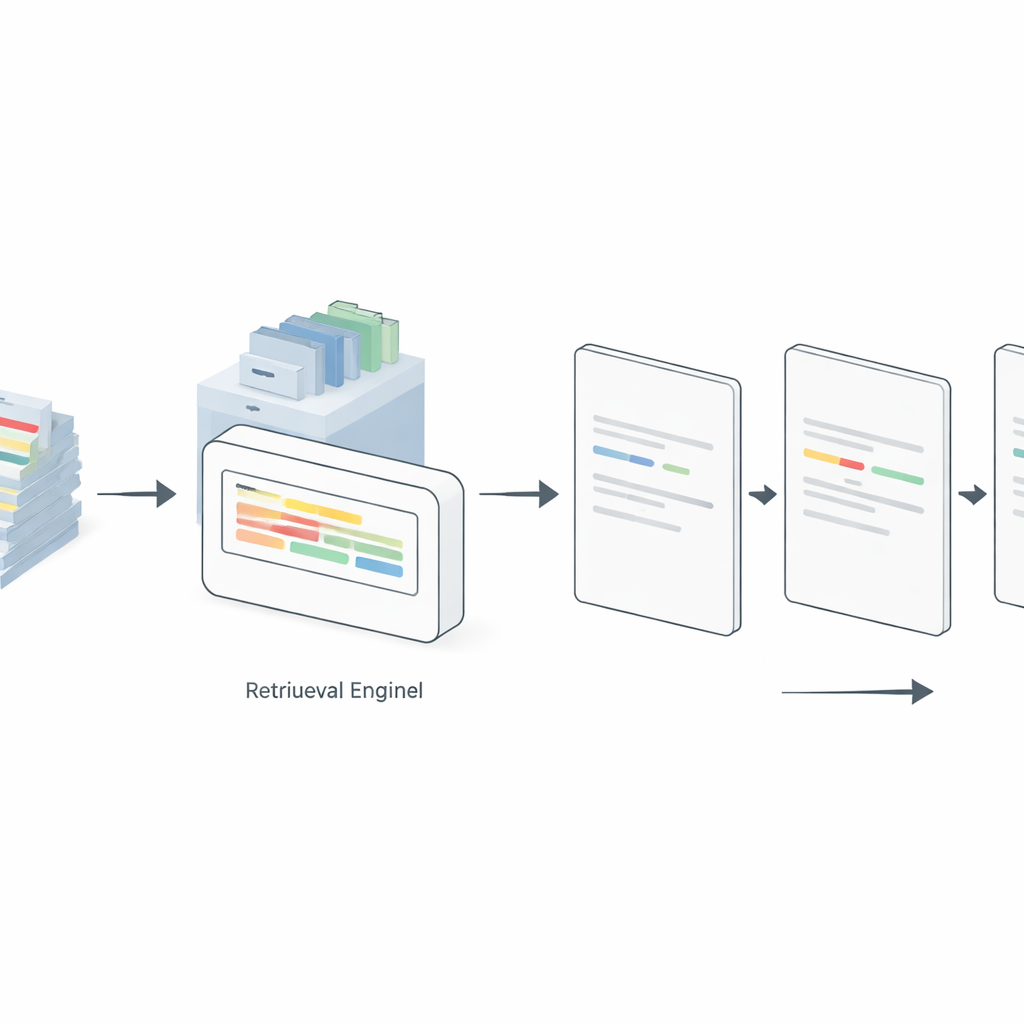

I prompt statici, tuttavia, mostrano sempre gli stessi esempi, anche quando non corrispondono bene alla nuova frase da etichettare. Per affrontare questo problema, gli autori introducono una strategia di prompting “dinamica” alimentata da retrieval-augmented generation. Qui, un motore di retrieval separato indicizza tutti gli esempi annotati disponibili. Per ogni nuova frase in input, il sistema cerca in questo archivio le frasi etichettate più simili e inserisce soltanto quelle nel prompt. Lo studio confronta diversi metodi di retrieval, da uno schema semplice basato sulla frequenza dei termini (TF–IDF) a modelli di embedding neurali come Sentence-BERT (SBERT), ColBERT e Dense Passage Retrieval. Su GPT-4, LLaMA 3 e un modello a pesi aperti chiamato GPT-OSS-120B, la selezione dinamica di esempi rilevanti ha costantemente superato il prompting statico in impostazioni da 5, 10 e 20 esempi. Sorprendentemente, il semplice metodo TF–IDF spesso ha eguagliato o superato approcci più complessi, specialmente su dataset più puliti e standardizzati, mentre SBERT ha brillato sui testi più rumorosi dei social media.

Ottenere di più con meno esempi etichettati

Poiché annotare testo medico è costoso, gli autori hanno anche studiato quanti esempi etichettati il motore di retrieval deve indicizzare per essere utile. Usando LLaMA 3-70B, hanno variato la pool di retrieval da 50 esempi fino all’intero set di addestramento. Le prestazioni in generale miglioravano con l’aumentare della pool, ma i guadagni si appiattivano rapidamente: pool di circa 100–200 esempi raggiungevano quasi la stessa accuratezza di indicizzare tutti i dati disponibili, spesso entro il margine statistico di errore. In alcuni casi, pool estremamente grandi peggioravano leggermente le prestazioni, probabilmente perché introducevano più esempi irrilevanti o confondenti e allungavano il prompt. Questi risultati suggeriscono che, se abbinati a un modello di linguaggio potente e a prompt ben progettati, anche sforzi di annotazione modesti possono produrre un riconoscimento delle entità biomediche robusto, rendendo l’approccio fattibile per malattie rare, nuovi concetti clinici o istituzioni con risorse limitate.

Cosa significa per la medicina nel mondo reale

Nel complesso, lo studio mostra che i modelli di linguaggio di grandi dimensioni possono identificare in modo affidabile concetti medici rilevanti nel testo usando solo una manciata di esempi annotati, a condizione che siano guidati da prompt strutturati e da un sistema di retrieval che faccia emergere i casi precedenti più pertinenti. GPT-4 offre le prestazioni generali più robuste, mentre i modelli open e più piccoli traggono comunque vantaggio in modo sostanziale dalla stessa ricetta di prompting e retrieval. Per i professionisti, ciò significa che non è necessario costruire dataset massivi ogni volta che emerge un nuovo tipo di entità o una nuova preoccupazione di salute; un set compatto e accuratamente curato di esempi insieme a un prompting intelligente può essere sufficiente. Con la progressiva digitalizzazione delle cartelle cliniche e i pazienti che discutono le loro esperienze online, strumenti efficienti e adattabili di questo tipo potrebbero rendere molto più semplice estrarre conoscenze clinicamente utili dal vasto e disordinato mondo del testo medico.

Citazione: Ge, Y., Guo, Y., Das, S. et al. Improving few-shot named entity recognition for large language models using structured dynamic prompting with retrieval augmented generation. npj Artif. Intell. 2, 39 (2026). https://doi.org/10.1038/s44387-025-00062-2

Parole chiave: riconoscimento delle entità nominate biomediche, few-shot learning, modelli di linguaggio di grandi dimensioni, retrieval-augmented generation, estrazione di testo clinico