Clear Sky Science · it

Con le loro parole: casi clinici sul linguaggio da smartphone di adolescenti prima di ricoveri correlati al suicidio

Perché i messaggi di tuo figlio possono contare più di quanto pensi

Con gli smartphone che diventano compagni costanti, catturano silenziosamente le parole, gli stati d’animo e le preoccupazioni quotidiane dei giovani. Questo studio pone una domanda urgente: il linguaggio che gli adolescenti digitano sui loro telefoni, nelle settimane e nei giorni precedenti a una crisi di salute mentale, può rivelare quando sono in serio pericolo di tentare il suicidio? Esaminando i modelli di messaggistica reali di adolescenti ad alto rischio, i ricercatori indagano se gli strumenti di intelligenza artificiale possano aiutare i clinici a individuare segnali di allarme a breve termine — e dove questi strumenti sono ancora carenti.

Seguire cinque adolescenti attraverso un mese pericoloso

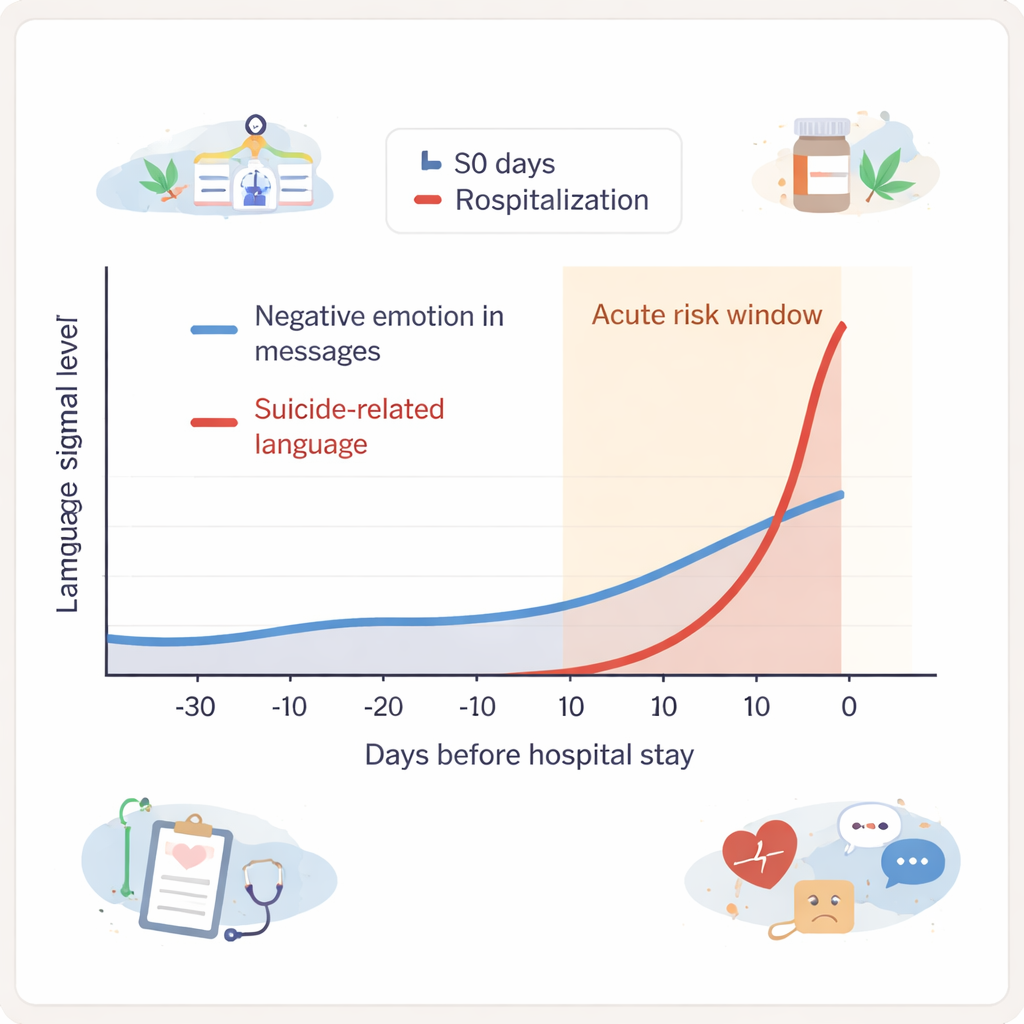

Lo studio si è concentrato su cinque adolescenti già considerati ad alto rischio di suicidio e che in seguito hanno subito un ricovero correlato al suicidio. Per circa sei mesi, un’app in esecuzione silenziosa sui loro telefoni ha registrato tutto ciò che digitavano sulla tastiera — messaggi, ricerche, note — escludendo però ciò che altri inviavano a loro. Sono state raccolte in media oltre 21.000 voci di testo in uscita per adolescente e i dati sono stati fortemente de-identificati per proteggere la privacy. I ricercatori hanno quindi focalizzato l’attenzione sui 30 giorni precedenti a ogni ricovero, suddividendo questo periodo in una fase di “baseline” di 20 giorni e una fase di “rischio acuto” di 10 giorni immediatamente prima del ricovero.

Cosa hanno rivelato le parole prima della crisi

Utilizzando l’elaborazione del linguaggio naturale (NLP), il team ha cercato diversi tipi di segnali nel testo digitato. Un insieme di strumenti ha ricercato linguaggio correlato al suicidio, usando un dizionario focalizzato sui giovani che riconosceva non solo frasi standard ma anche gergo ed emoji. Un altro strumento, basato su modelli di IA moderni, ha stimato se i messaggi esprimevano emozioni negative. Un terzo metodo ha raggruppato i messaggi in temi ampi, come scuola, trattamento, sonno, uso di sostanze o morte. Per quattro dei cinque adolescenti, sia il linguaggio correlato al suicidio sia le emozioni negative sono aumentati nei 10 giorni precedenti il ricovero, rispetto al modello medio di ciascun adolescente nell’arco dello studio. Il linguaggio correlato al suicidio spesso è aumentato bruscamente negli ultimi cinque giorni, mentre l’emozione negativa è salita più gradualmente nell’ultimo decennio di giorni.

Segnali di rischio — e segnali di sofferenza

I modelli erano promettenti ma complessi. Gli stessi segnali di allarme — linguaggio suicidario e tono cupo — apparivano anche in altri momenti al di fuori della finestra di crisi immediata. Ciò suggerisce che questi segnali possono indicare periodi di seria sofferenza, ma non sempre momenti in cui un tentativo di suicidio è imminente. Quando i clinici hanno esaminato direttamente le cronologie dei messaggi, hanno osservato che i picchi di linguaggio correlato al suicidio spesso coincidevano con pensieri suicidari, tentativi reali o richieste di aiuto urgenti. I modelli di topic hanno individuato temi utili come l’uso di sostanze e discussioni sul trattamento, che talvolta coincidevano con momenti rischiosi.

Cosa i computer non colgono che gli esseri umani vedono

Tuttavia, gli strumenti di IA hanno frequentemente mancato aspetti che i clinici ritenevano fattori scatenanti centrali, come litigi con amici o familiari, bullismo, conflitti romantici o sentimenti di rifiuto. Queste situazioni si sviluppavano attraverso molti messaggi brevi, e i modelli trattavano per lo più ogni singola voce in isolamento, senza comprendere la storia più ampia. Di conseguenza, i conflitti interpersonali, i cambiamenti nel modo in cui gli adolescenti percepivano eventi chiave o i passaggi sottili dal fare battute sul suicidio all’esprimere disperazione genuina spesso sfuggivano agli algoritmi. I ricercatori sostengono che i sistemi futuri debbano fare di più che leggere singoli messaggi: devono collegare le conversazioni nel tempo e idealmente combinare il testo con altri dati passivi come i modelli di sonno o i movimenti per migliorare l’accuratezza.

Prospettive future: promesse con limiti importanti

Questo lavoro mostra che il linguaggio da smartphone può fornire una finestra ricca e a basso onere su ciò che gli adolescenti stanno vivendo tra una visita clinica e l’altra. I metodi automatizzati già riescono abbastanza bene a individuare segnali evidenti — discorsi suicidari diretti ed emozione fortemente negativa — specialmente nei giorni immediatamente precedenti una crisi. Ma sono molto meno capaci di comprendere il contesto personale, sociale e situazionale che i clinici umani usano per valutare il rischio. Per famiglie e operatori sanitari, il messaggio è duplice: i dati linguistici digitali potrebbero un giorno aiutare a fornire supporto tempestivo ai giovani in pericolo, ma devono essere sviluppati con grande cautela, solide protezioni della privacy e in collaborazione con i clinici, non come loro sostituti.

Citazione: Treves, I.N., Bloom, P.A., Salem, S. et al. In their own words: case studies of adolescent smartphone language preceding suicide-related hospitalizations. NPP—Digit Psychiatry Neurosci 4, 5 (2026). https://doi.org/10.1038/s44277-026-00057-0

Parole chiave: rischio di suicidio adolescenziale, linguaggio da smartphone, fenotipizzazione digitale, elaborazione del linguaggio naturale, monitoraggio della salute mentale